一、LaneNet 算法详解

1.1 LaneNet 简介

传统的车道线检测方法依赖于手工提取的特征来识别,如颜色的特征、结构张量、轮廓等,这些特征还可能与霍夫变换、各种算子或卡尔曼滤波器相结合。在识别车道线之后,采用后处理技术来过滤错误检测并将其分组在一起以形成最终车道。然而,由于道路场景的变化,这些传统的方法容易出现鲁棒性问题!

学习资源地址 https://gitee.com/studywangke/zdjs

更新的方法利用深度学习模型,这些模型被训练用于像素级车道分割。但这些方法仅限于检测预定义的固定数量的车道,例如当前车道,并且不能应对车道改变。

基于此,2018 年 Davy Neven 等人提出一种新的车道线检测网络 LaneNet,LaneNet 主要做出了如下两个贡献:

- 将车道检测问题归结为一个实例分割问题,其中每条车道都形成了自己的实例,可以端到端地进行训练。

- 构建了一个新的网络 H-Net,用于学习给定输入图像的透视变换参数,该透视变换能够对坡度道路上的车道线进行良好地拟合,克服了鲁棒性不好的问题。

1.2 整体结构分析

作者提出了一个多分支的网络结构,包含一个二值化分割网络 (lane segmentation) 和一个实例分割网络 (lane embedding),从而实现端到端、任意数量的车道线检测。具体来说,二值分割网络输出所有的车道线像素,而实例分割网络将输出的车道线像素分配到不同的车道线实例中。整体的网络结构图如下:

另一方面,数据集输入到 H-Net 网络中,学习到透视变换参数 H 矩阵。用于不同车道线实例的像素,进行车道线拟合,从而得到上图所示连续点状的车道线。

1.3 LaneNet 网络结构

LaneNet 的整体网络结构如下:

二值化分割网络

Lanenet 的一个分支为二值化分割网络,该网络将车道线像素与背景区分开。由于目标类别是 2 类(车道 / 背景),并且高度不平衡,因此参考了 ENet,损失函数使用的是标准的交叉熵损失函数。

实例分割网络

该分支网络参考了《Semantic Instance Segmentation with a Discriminative Loss Function》,使用基于 one-shot 的方法做距离度量学习,将该方法集成在标准的前馈神经网络中,可用于实时处理。该分支网络训练后输出一个车道线像素点距离,基于归属同一车道的像素点距离近,不同车道线像素点距离远的基本思想,利用聚类损失函数聚类得到各条车道线。

聚类损失函数

损失函数如下:

[ x ] + = m a x ( 0 , x ) [x]_+=max(0, x) [x]+=max(0,x)

L t o t a l = L v a r + L d i s t L_{total}=L_{var}+L_{dist} Ltotal=Lvar+Ldist

其中,各个参数表示如下:

- C—— 表示车道线实例个数;

- N c N_c Nc—— 每个车道线实例中像素的个数;

- u c u_c uc—— 每个车道线实例的像素中心;

- L v a r L_{var} Lvar是方差损失,他的目的是为了降低类内距离;

- L d i s t L_{dist} Ldist是距离损失,它的目的是增大类间距离 (不同车道线之间的距离);

网络结构图

LaneNet 的架构基于编码器 - 解码器网络 ENet,该网络是由 5 个阶段组成。前 3 个阶段是编码器网络,进行了两次下采样;后两个阶段是解码器网络,进行了两次上采样。

LaneNet 在该网络的基础上修改成了双分支网络。由于 ENet 的编码器比解码器包含更多的参数,完全在两个任务之间共享完整的编码器将导致不令人满意的结果。因此,LaneNet 只在两个分支之间共享前两个阶段 (1 和 2),留下 ENet 编码器的阶段 3 和完整的 ENet 解码器作为每个单独分支的主干。分割分支的最后一层输出单通道图像,用于二值化分割;而实例分割分支的最后一层输出 N 通道图像,其中 N 是实例维度。每个分支的损失项都是相等加权的,并通过网络反向传播。

1.4 H-Net 网络结构

LaneNet 网络输出的是每条车道线的像素集合,常规的处理是将图像转为鸟瞰图,然后用二次或三次多项式拟合出弯曲的车道线。然而,目前所使用的透视变换矩阵的参数通常是预先设定、不会改变的,在面对水平线波动的影响(如上下坡)等情况下的车道线拟合并不准确,鲁棒性不强。因此,作者提出了 H-net 模型,用来学习透视变换矩阵的参数 H。

H 有 6 个自由度,放置零是为了强制约束,即在变换下水平线保持水平。

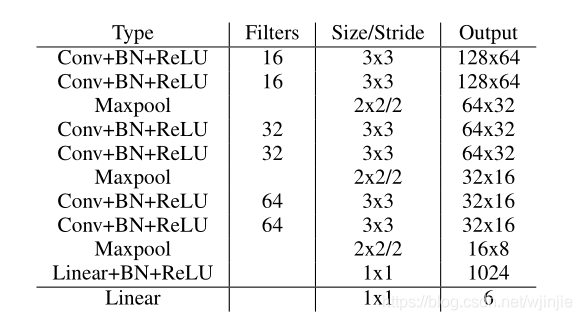

H-NET 的网络体系结构较小,由 3x3 卷积、BN 层 和 Relu 的连续块构成。使用最大池化层来降低维度,并在最后添加 2 个全连接层。完整的网络结构如下图所示:

最后一个全连接层的结点数是 6,对应的就是 H 矩阵中的 6 个参数。

1.5 LaneNet 性能优点

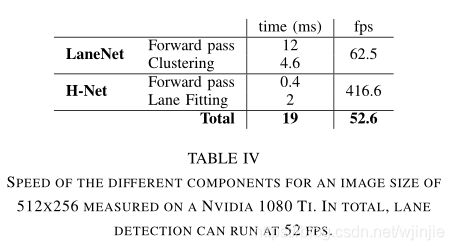

检测速度。在英伟达 1080Ti 显卡上进行测试,检测一帧大小为 512x512 的彩色图片,耗时 19ms,因此每秒可处理 50 帧左右。

检测精度。 通过使用 LaneNet 结合三阶多项式拟合和 H-Net 的变换矩阵,在 tuSimple 挑战中检测精度达到 96.4%,获得了第四名,与第一名相比只有 0.5% 的差异。结果可以在下表中看到。

二、手把手带你实现 LaneNet

2.1 项目介绍

该项目在 github 上已经开源,获得了 1.3k 的星标,想试试的同学可克隆下来:https://github.com/MaybeShewill-CV/lanenet-lane-detection,如果打不开,也可以从我的百度云网盘下载:LaneNet 资料合集 ,提取码:1024

代码结构和各部分功能如下:

<span style="background-color:#f6f6f6"><span style="color:#333333"><code class="language-cpp">lanenet-lane-detection

├── config <span style="color:#6a737d">//配置文件</span>

├── <span style="color:#d73a49">data</span> <span style="color:#6a737d">//一些样例图片和曲线拟合参数文件</span>

├── data_provider <span style="color:#6a737d">// 用于加载数据以及制作 tfrecords</span>

├── lanenet_model

│ ├── lanenet.py <span style="color:#6a737d">//网络布局 inference/compute_loss/compute_acc</span>

│ ├── lanenet_front_end.py <span style="color:#6a737d">// backbone 布局</span>

│ ├── lanenet_back_end.py <span style="color:#6a737d">// 网络任务和Loss计算 inference/compute_loss</span>

│ ├── lanenet_discriminative_loss.py <span style="color:#6a737d">//discriminative_loss实现</span>

│ ├── lanenet_postprocess.py <span style="color:#6a737d">// 后处理操作,包括聚类和曲线拟合</span>

├── model <span style="color:#6a737d">//保存模型的目录semantic_segmentation_zoo</span>

├── semantic_segmentation_zoo <span style="color:#6a737d">// backbone 网络定义</span>

│ ├── __init__.py

│ ├── vgg16_based_fcn.py <span style="color:#6a737d">//VGG backbone</span>

│ └─+ mobilenet_v2_based_fcn.py <span style="color:#6a737d">//mobilenet_v2 backbone</span>

│ └── cnn_basenet.py <span style="color:#6a737d">// 基础 block</span>

├── tools <span style="color:#6a737d">//训练、测试主函数</span>

│ ├── train_lanenet.py <span style="color:#6a737d">//训练</span>

│ ├── test_lanenet.py <span style="color:#6a737d">//测试</span>

│ └──+ evaluate_dataset.py <span style="color:#6a737d">// 数据集评测 accuracy</span>

│ └── evaluate_lanenet_on_tusimple.py <span style="color:#6a737d">// 数据集检测结果保存</span>

│ └── evaluate_model_utils.py <span style="color:#6a737d">// 评测相关函数 calculate_model_precision/calculate_model_fp/calculate_model_fn</span>

│ └── generate_tusimple_dataset.py <span style="color:#6a737d">// 原始数据转换格式</span>

├─+ showname.py <span style="color:#6a737d">//模型变量名查看</span>

├─+ change_name.py <span style="color:#6a737d">//模型变量名修改</span>

├─+ freeze_graph.py<span style="color:#6a737d">//生成pb文件</span>

├─+ convert_weights.py<span style="color:#6a737d">//对权重进行转换,为了模型的预训练</span>

└─+ convert_pb.py <span style="color:#6a737d">//生成pb文</span>

</code></span></span>2.2 环境搭建

根据开源作者描述,其测试的环境为:

- ubuntu 16.04

- python3.5

- cuda-9.0

- cudnn-7.0

- GTX-1070 GPU

- tensorflow 1.12.0

我使用的环境与配置为:

- ubuntu16.04 系统

- PyCharm 2020

- python3.6

- tensorflow1.13.1-gpu

- cuda-10.0

- cudnn7.6.4

- opencv4.0.0

- RTX 2070 GPU

想尝试的朋友,可以参考上面两种配置,也可以自行尝试其他的版本。

2.3 准备工作

如果想要自行训练的同学,可以下载 TuSimple 数据集,进行训练。同样,我们也可以直接使用官方训练好的模型,来输入图片,看看测试效果。为了方便,下面我们直接加载已经训练好的模型,进行本地测试。

(1) 下载 TuSimple 数据集,如果不训练可以跳过这一步。

(2) 下载训练好的模型,下载链接:LaneNet 资料合集 ,提取码:1024

下载完后,我们将模型文件 tusimple_lanenet 放在工程目录下的 model 文件中,如下图所示:

2.4 模型测试

完成环境配置和模型部署后,我们就可以进行测试了!

(1) 先对 TusSample 数据集中的图片进行测试

- 第一步,在原工程目录下的 data 文件中新建一个 Mytest 文件夹,然后任意选取 TusSample 数据集中的一张图片放入其中,例如 1.jpg,如下图所示:

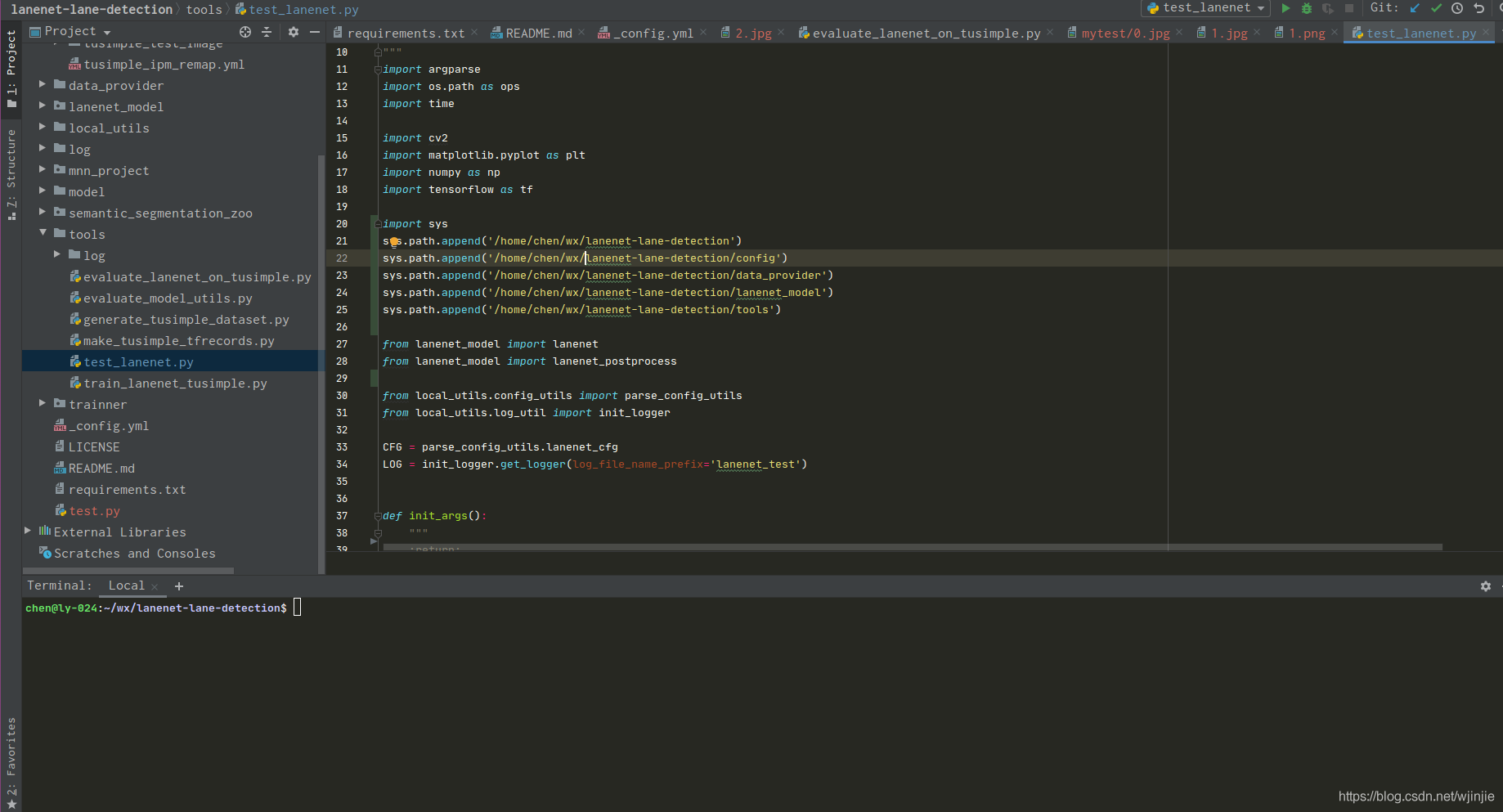

- 第二步,使用 PyCharm 打开下载好的项目工程,配置好环境后,打开终端,如下图所示:

- 第三步,在终端输入以下命令,执行程序:

<span style="background-color:#f6f6f6"><span style="color:#333333"><code class="language-cpp"><span style="color:#6f42c1">python</span> <span style="color:#032f62">tools</span><span style="color:#032f62">/</span><span style="color:#032f62">test_lanenet</span><span style="color:#032f62">.</span><span style="color:#032f62">py </span><span style="color:#032f62">--</span><span style="color:#032f62">weights_path model</span><span style="color:#032f62">/</span><span style="color:#032f62">tusimple_lanenet</span><span style="color:#032f62">/</span><span style="color:#032f62">tusimple_lanenet</span><span style="color:#032f62">.</span><span style="color:#032f62">ckpt </span><span style="color:#032f62">--</span><span style="color:#032f62">image_path data</span><span style="color:#032f62">/</span><span style="color:#032f62">Mytest</span><span style="color:#032f62">/</span><span style="color:#032f62">1.</span><span style="color:#032f62">jpg</span>

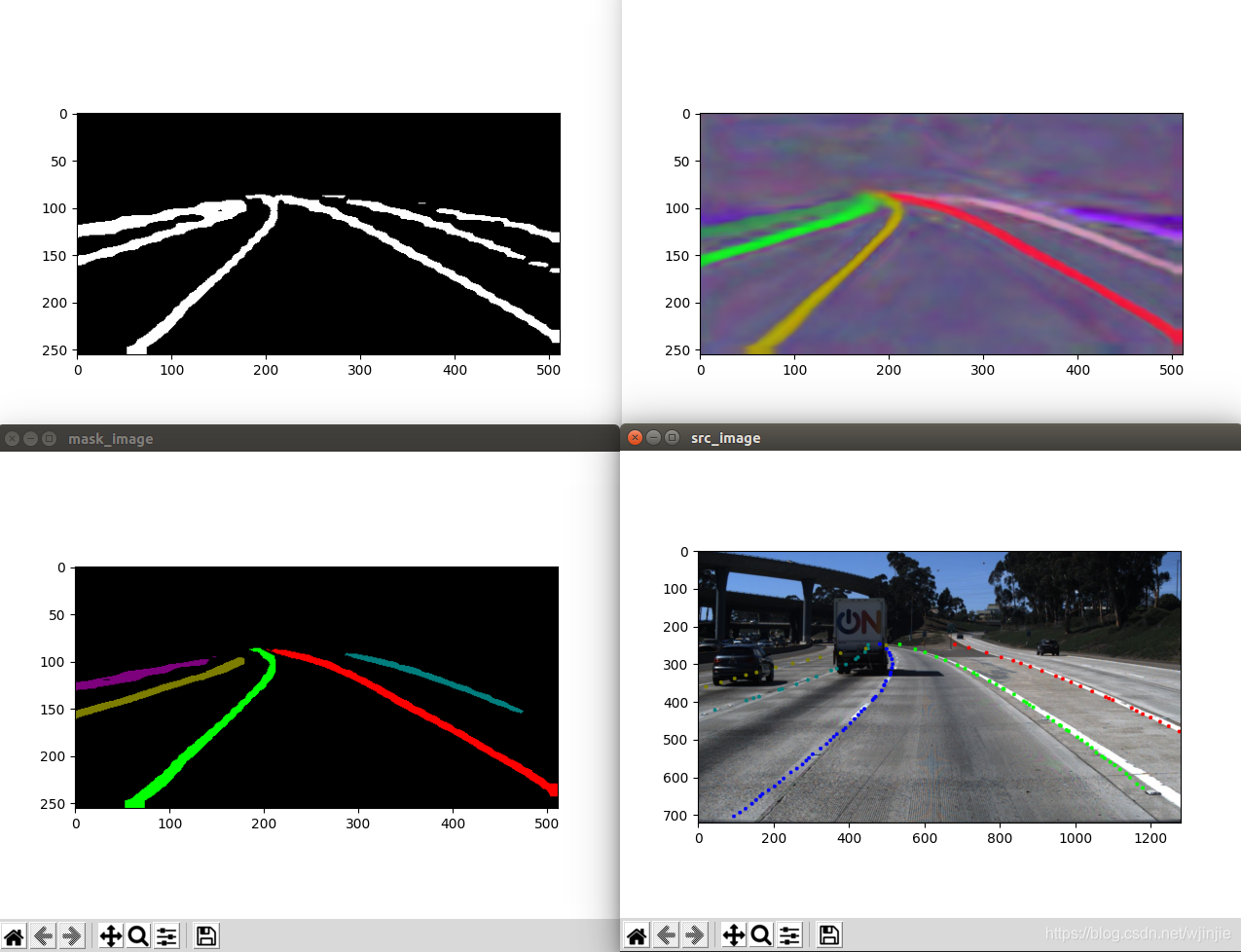

</code></span></span>最后车道线检测效果如下:

(2)对自己的图片进行测试

- 第一步,选择自己拍摄的一张车道线图片 2.jpg,放入刚才新建好的 Mytest 文件夹下,如下图所示:

第二步,打开终端,输入命令,执行程序:

<span style="background-color:#f6f6f6"><span style="color:#333333"><code class="language-cpp"><span style="color:#6f42c1">python</span> <span style="color:#032f62">tools</span><span style="color:#032f62">/</span><span style="color:#032f62">test_lanenet</span><span style="color:#032f62">.</span><span style="color:#032f62">py </span><span style="color:#032f62">--</span><span style="color:#032f62">weights_path model</span><span style="color:#032f62">/</span><span style="color:#032f62">tusimple_lanenet</span><span style="color:#032f62">/</span><span style="color:#032f62">tusimple_lanenet</span><span style="color:#032f62">.</span><span style="color:#032f62">ckpt </span><span style="color:#032f62">--</span><span style="color:#032f62">image_path data</span><span style="color:#032f62">/</span><span style="color:#032f62">Mytest</span><span style="color:#032f62">/</span><span style="color:#032f62">2.</span><span style="color:#032f62">jpg</span>

</code></span></span>对自己的拍摄的图片检测效果如下:

测试分析:

从图中可以看出,对自己的图片进行检测时,最终的检测结果虽然能够完美地与实际车道线重合,但是延伸至了空中。

产生这种情况最主要的原因是:没有自己制作数据集进行训练,从而得到更有针对性的模型造成的。由于这里我使用的测试模型是在 TuSimple 数据集下训练得到的,所以我们对 TuSimple 中的图片测试效果会很好,比如前面的 1.jpg。

如果我们想要对自己的图片进行测试,得到更好的效果,那么就需要自己的数据集。比较好的办法是:

- 首先在 TuSimple 数据集下进行训练,得到的训练模型作为预训练模型,这一部分工作其实已经做好了,大家直接下载预训练模型即可

- 然后,在预训练模型的基础上,加载自己制作的数据集,再进行训练,直到达到预期的效果。

采用这种迁移学习的思想,往往能够事半功倍!

8316

8316

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?