提升 RAG 效果的实践

0. 引言

AI 大语言模型的主要应用方式之一就是 RAG,接下来计划陆续分享工作中提升 RAG 效果的一些实践。

首先分享一些测试结果,这些测试结果可以帮助我们去做一些技术上的选型和模型上的选型。

- 此博文会持续更新,如果你觉得这个文章对你有帮助,欢迎点赞和收藏。

- 工作上我主要支持的区域是日本,所以博文中会或多或少包括一些日语。

1. 测试数据

测试数据使用的是公开的 AWS 词汇表,我测试的是日语的 AWS 用語集。

2. cohere/embed-multilingual-v3.0 的几组测试结果

2-1. 第1组测试

前提条件:

- テスト・データ:AWS 用語集

- チャンク・サイズ(Chunk Size):1000

- チャンク・オーバーラップ(Chunk Overlap):200

- Embedding 模型:cohere/embed-multilingual-v3.0

- Rerank 模型:BAAI/bge-reranker-v2-minicpm-layerwise-28

- LLM 模型:Cohere Command-r、Claude Opus、Claude Sonnet、Google Gemini Pro

第1个问题的答案截图:

第1个问题:Kendraとは?

结果评论:Cohere Command-r回答正确、Claude Opus回答正确、Claude Sonnet 回答正确。Google Gemini Pro回答正确。

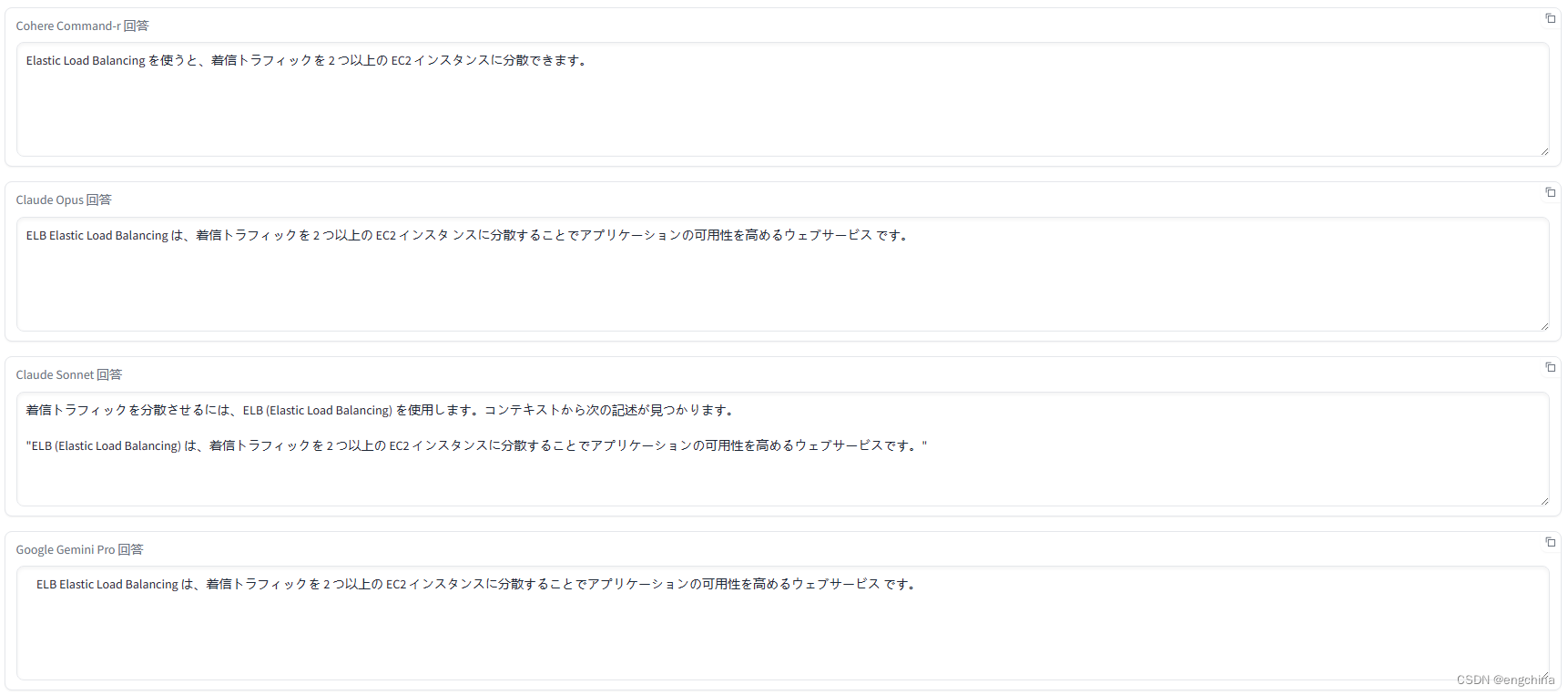

第2个问题的答案截图:

第2个问题:着信トラフィックを分散させるには?

结果评论:Cohere Command-r 回答正确 。Claude Opus回答正确。Claude Sonnet回答正确,但是啰嗦 。Google Gemini Pro回答正确。

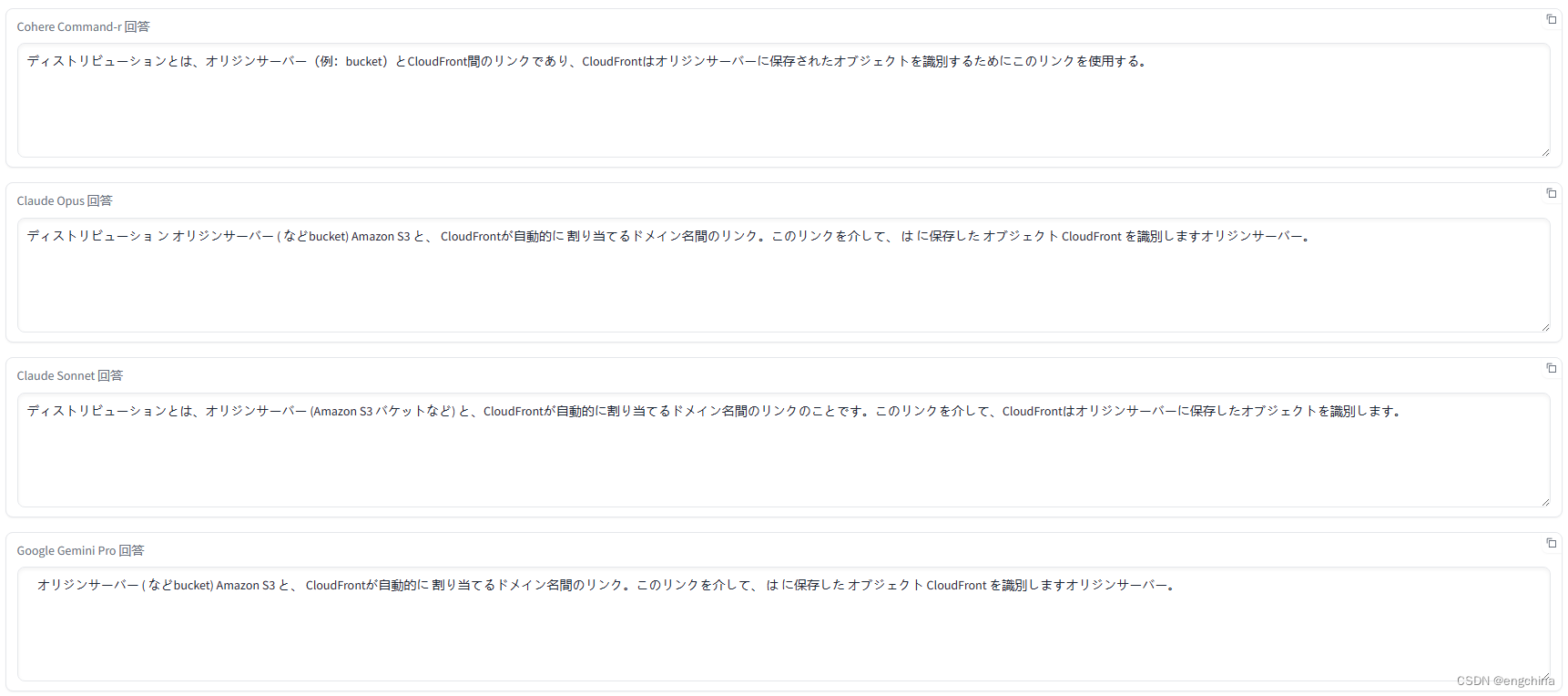

第3个问题的答案截图:

第3个问题:ディストリビューションとは?

结果评论:Cohere Command-r回答正确 。Claude Opus回答正确。Claude Sonnet回答正确。Google Gemini Pro回答正确。

第4个问题的答案截图:

第

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1203

1203

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?