支持向量机的最终求解可以化为一个具有线性约束的二次凸规划问题,不存在局部极小。通过引人核方法,可以将线性支持向量机简单地推广到非线性支持向量机,而且对于高维样本几乎不增加额外的计算量。算法首先随机选用一部分样本作为工作集即训练集,得到一组乘子。然后用条件对其余的样本进行检验,再把违反条件的样本加人到工作集中,同时删去前一次训练集合中的非支持向量机,重复这一过程,直到所有的样本满足条件为止。2000年Platt提出了快速支持向量机(SMO)的训练算法为支持向量机的广泛应用奠定了稳健的基础。

一、线性可分的支持向量(分类)机

设有如下两类样本的训练集:

线性可分情况意味着存在超平面使训练点中的正类和负类样本分别位于该超平面的两侧。

如果能确定这样的参数对(w,b),就可以构造决策函数来进行识别新样本。

这样的参数对(w,b)有许多。解决的方法是采用最大间隔原则。

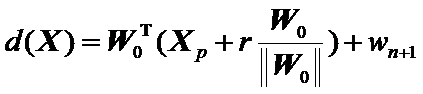

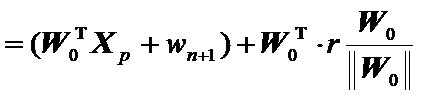

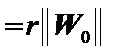

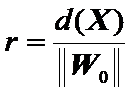

r:X到超平面的垂直距离。有

X到超平面的距离:

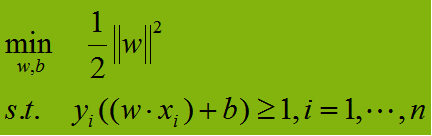

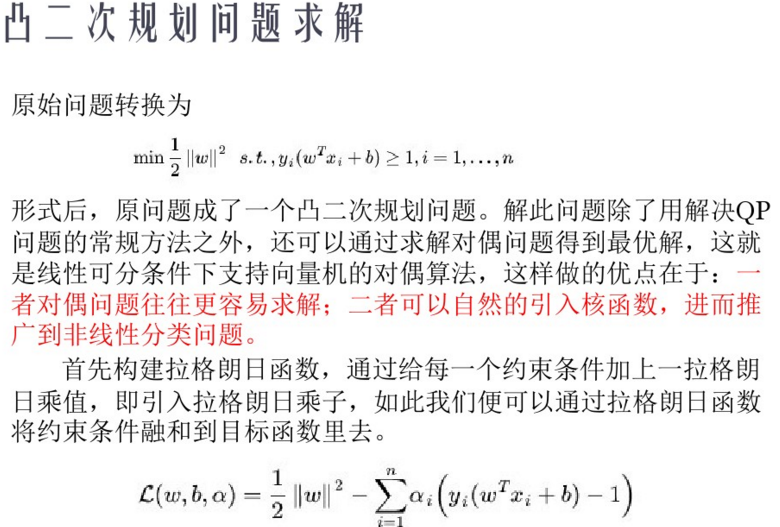

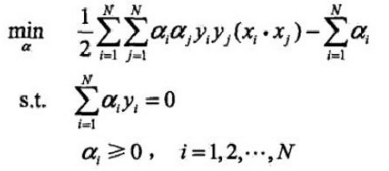

最大间隔原则:选择使得训练集D对于线性函数(w·x)+b的几何间隔取最大值的参数对(w,b),并由此构造决策函数。在规范化下,超平面的几何间隔为于是,找最大几何间隔的超平面表述成如下的最优化问题:

机器学习(Machine Learning)&深度学习(Deep Learning)资料

https://github.com/ty4z2008/Qix/blob/master/dl.md

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?