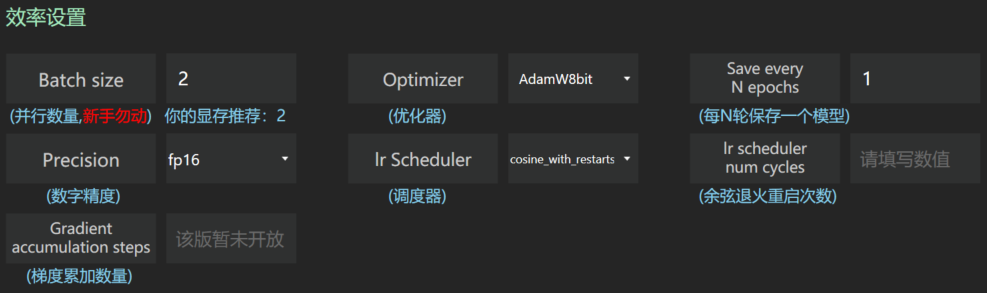

效率设置-优化器

优化器可以分为4类:

第一类

AdamW :梯度下降算法,结合自适应学习率,既可以快速收敛,又可以避免 Loss值 震荡

AdamW8bit:能降低显存占用,并略微加快训练速度,适合显卡配置不太好的电脑使用

第二类

Adafactor 与 DAdaptation:能自动调整学习率,常用来测试学习率使用。

第三类

Lion:能节省更多显存、速度更快,相比 AdamW 有15%左右的速度提升

第四类

SGDNesterov 与 SGDNesterov8bit:基于梯度下降方法进行优化,引入了动量的概念来加速收敛速度

优化器推荐:AdamW8bit 与 Lion

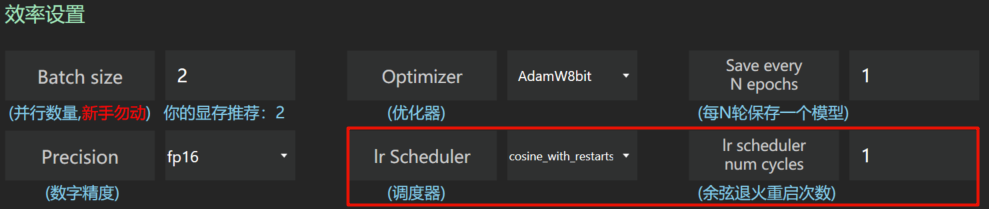

效率设置–调度器

adafator:自适应学习率,自动调配学习效率

constant:设定一个学习强度,让 AI 一直保持这个学习率来学习

constant_with_warmup:一开始预热期间学习率会增大,然后退回恒定的学习率不变

linear:让学习率以线性的方式下降

Polynomial:使用多项式函数来调整学习率

cosine:余弦学习率,一开始保持一个较高的学习率,然后逐渐降低学习率

consine with restart(推荐):余弦退火重启,在余弦学习方法基础上定期重启,帮助AI逃脱学习平坦区域

搭配 余弦退火重启次数 使用,一般建议设置为1:

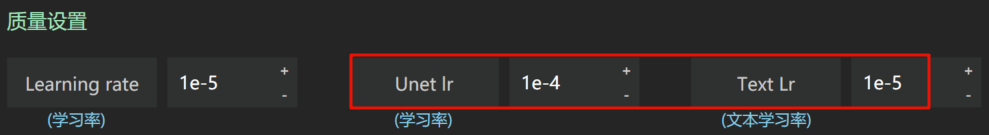

质量设置

一般建议设置 Unet lr 与 Text Lr,保持默认即可,设置这两个值之后,Learning rate 这个值的设置就失效了:

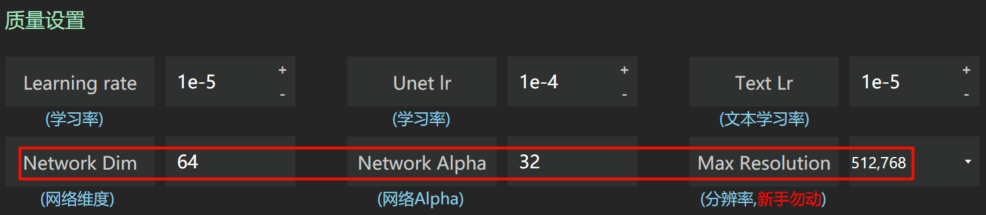

Network Dim

推荐设置值:

- 二次元:32

- 人物:32-128

- 实物风景:128

Network Alpha

建议设置为 Network Dim 的½,或者相等

Max Resolution

根据选择的基础模型进行选择,分辨率越大,显存的负担越大:

SD1.5模型:建议选择 512*512 或者 512*768

SDXL 模型:建议选择 1024*xxx 的分辨率

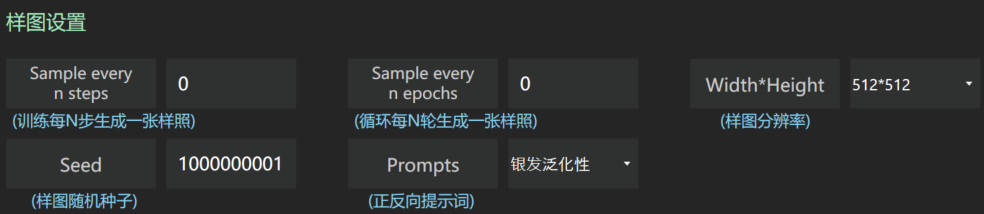

样图设置

主要是设置参考图片生成的频率等,保持默认即可,不影响训练模型的质量:

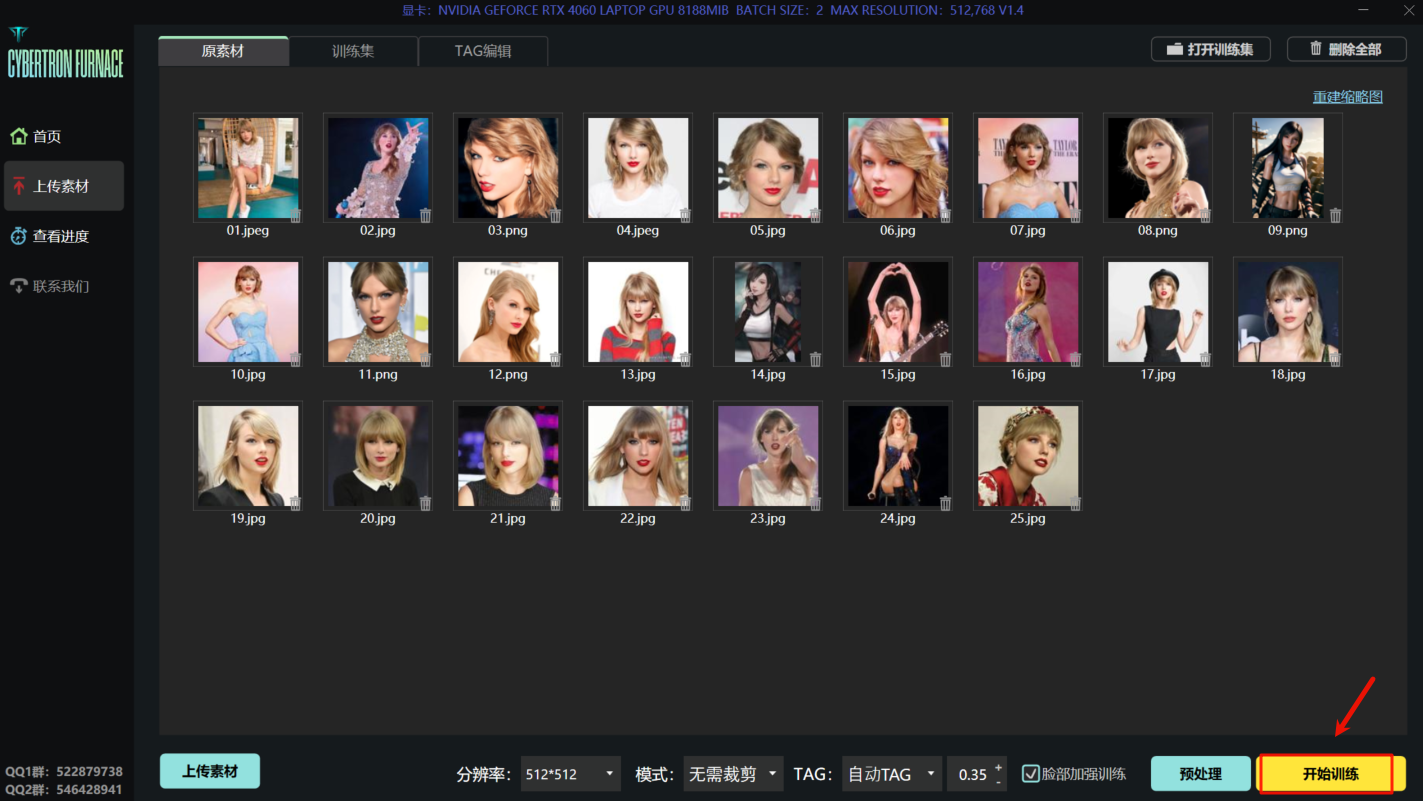

开始训练

经过前面几轮辛苦的准备工作之后,现在开始进入终篇的炼丹环节。

在「上传素材」页面,点击「开始训练」:

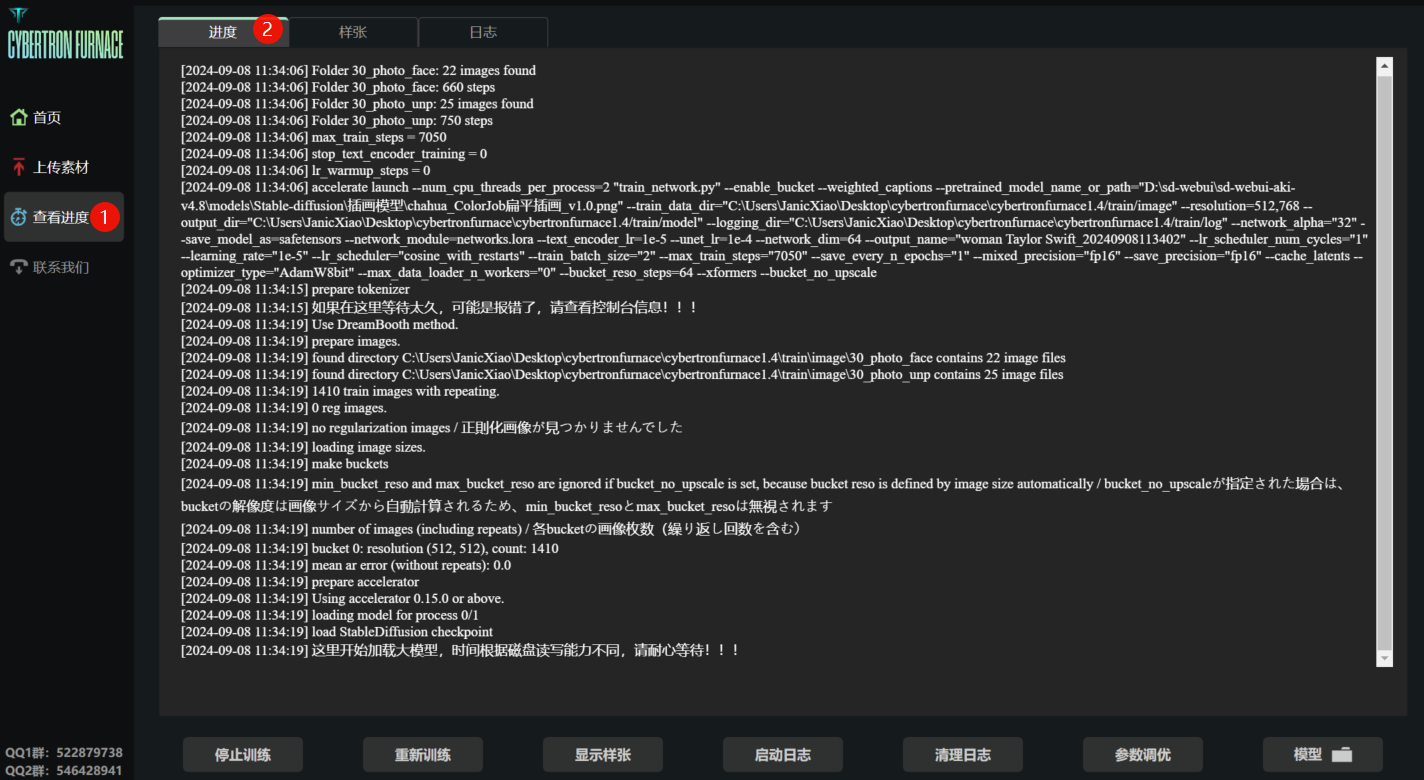

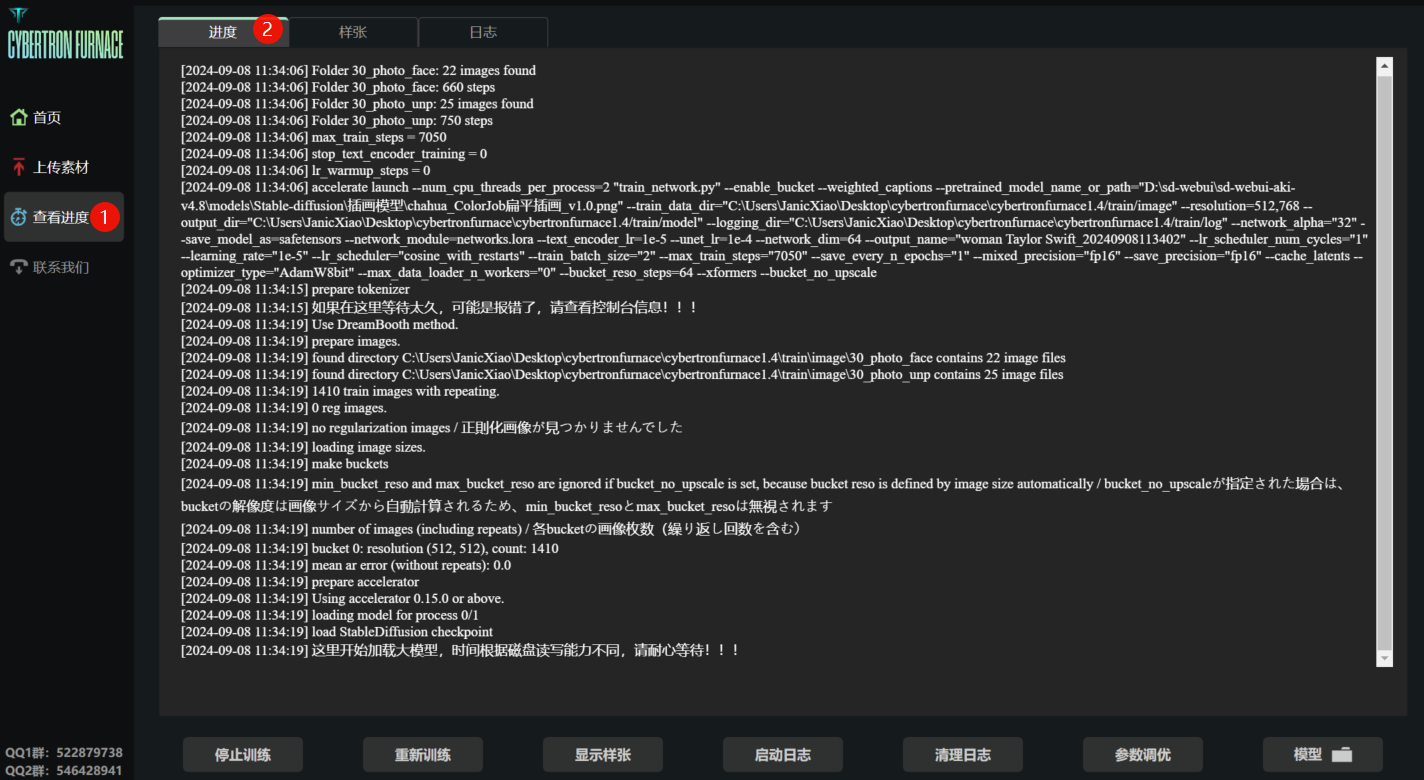

可以在「查看进度-进度」中,查看模型训练的整体进度:

开始训练

经过前面几轮辛苦的准备工作之后,现在开始进入终篇的炼丹环节。

在「上传素材」页面,点击「开始训练」:

可以在「查看进度-进度」中,查看模型训练的整体进度:

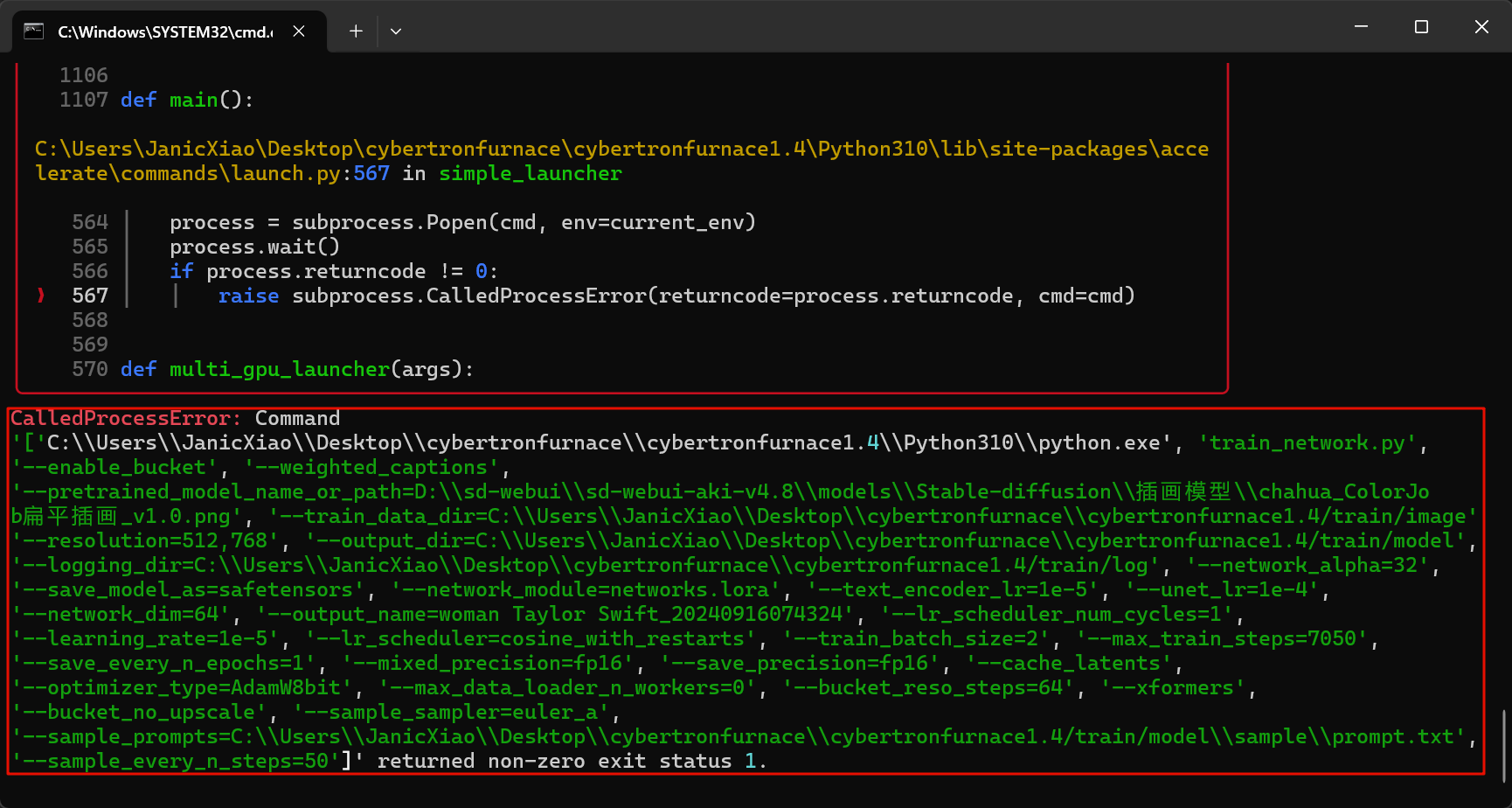

求助!!!操作「开始训练」之后,出现以下报错,如果大家有解决方案,欢迎留言或私信告诉我,谢谢~

今天先分享到这里~

开启实践:SD绘画 | 为你所做的学习过滤

354

354

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?