动态组卷积(Dynamic Group Convolution):迈向更高效的神经网络加速方案

dgc项目地址:https://gitcode.com/gh_mirrors/dg/dgc

在追求高精度与高效能的深度学习领域,一个名为“动态组卷积”(Dynamic Group Convolution, DGC)的开源项目脱颖而出。该项目由一组国际研究人员共同开发,并在欧洲计算机视觉会议(ECCV)上发表,其目的是通过智能化选择卷积层中输入通道的方式来提升模型效率和性能。本文将从项目介绍、技术分析、应用场景和技术特点四个维度深度剖析这一创新技术。

项目介绍

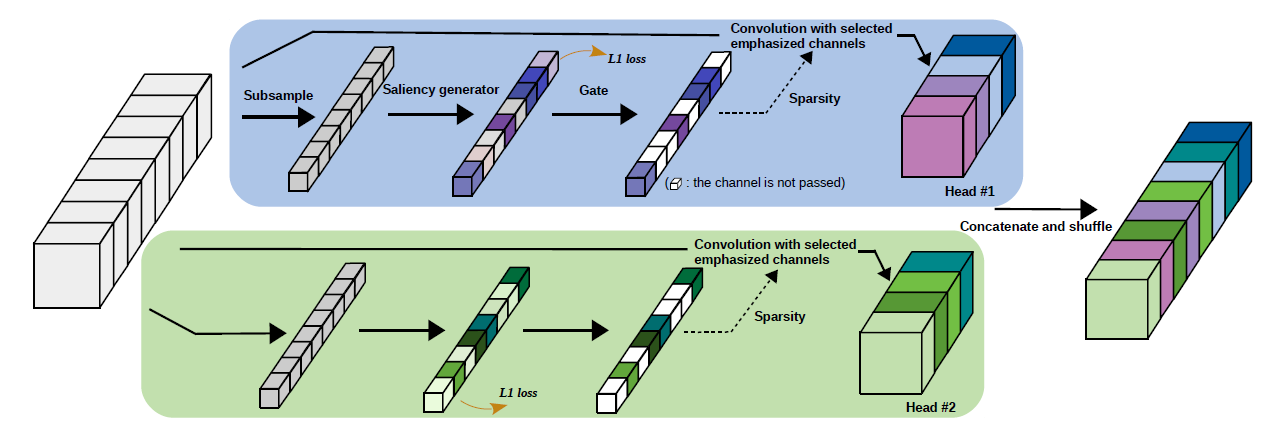

动态组卷积(DGC)是由苏卓等研究人员提出,该技术基于PyTorch框架实现,灵感源于 CondenseNet。DGC引入了一种新颖机制,能够根据不同输入图像动态调整每一组卷积中的连接通道,从而捕获更加丰富且互补的特征信息。这种智能选择不仅保持了原有网络结构的简洁,同时还达到了与传统组卷积相似的计算效率,展现了在图像分类任务上的优越性。

技术分析

DGC的核心在于每个卷积组内置的小型特征选择器,它根据输入图像自动筛选最相关输入通道,这实现了按需分配计算资源。不同于固定分组策略,DGC允许网络自适应地决定数据流路径,减少了冗余运算。通过无偏门控策略,确保了训练过程的稳定性,仅对前向传播中选中的通道进行梯度计算,其他未选通道的梯度则被安全置零,这大大优化了内存使用和训练时间。

应用场景

DGC特别适用于那些对速度和资源敏感的应用场合,如移动设备上的实时图像识别、自动驾驶汽车的即时物体检测以及大规模服务器端的高并发图像处理任务。它的高效性和自适应性使得模型在不牺牲准确率的前提下,能够快速运行于资源受限的环境,从而拓宽了CNN应用的可能性。

项目特点

- 自适应性:能够针对不同的输入动态调整卷积结构,提高了模型的泛化能力和计算效率。

- 保留原始架构:在增强功能的同时,不改变现有网络的基本框架,便于集成进多种模型。

- 易训练:支持端到端训练,无需预训练模型即可直接启动,降低了使用的门槛。

- 渐进式优化:通过在训练过程中平滑地关闭非关键通道,有效避免了训练波动,保证了模型的稳定学习。

- 提高效率与性能:在多个基准数据集上验证了DGC的有效性,如CIFAR-10、CIFAR-100和ImageNet,展现出比传统和动态执行方法更好的性能。

如何开始?

对于想立即体验DGC魅力的研究者和开发者,仓库提供了详尽的训练和评估脚本,以及已训练好的模型链接。无论是想要实验DGC在ResNet还是CondenseNet上的效果,你都能找到对应的配置和预训练权重,快速上手,探索这个高效加速工具的强大潜力。

在深度学习持续演进的今天,DGC无疑为加速神经网络处理速度与提高效率开辟了新路径,是每个致力于优化AI应用性能团队的宝贵工具箱之一。随着社区的讨论和贡献增加,我们期待看到DGC在更多领域的实践成果,进一步推动AI技术的发展。

5687

5687

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?