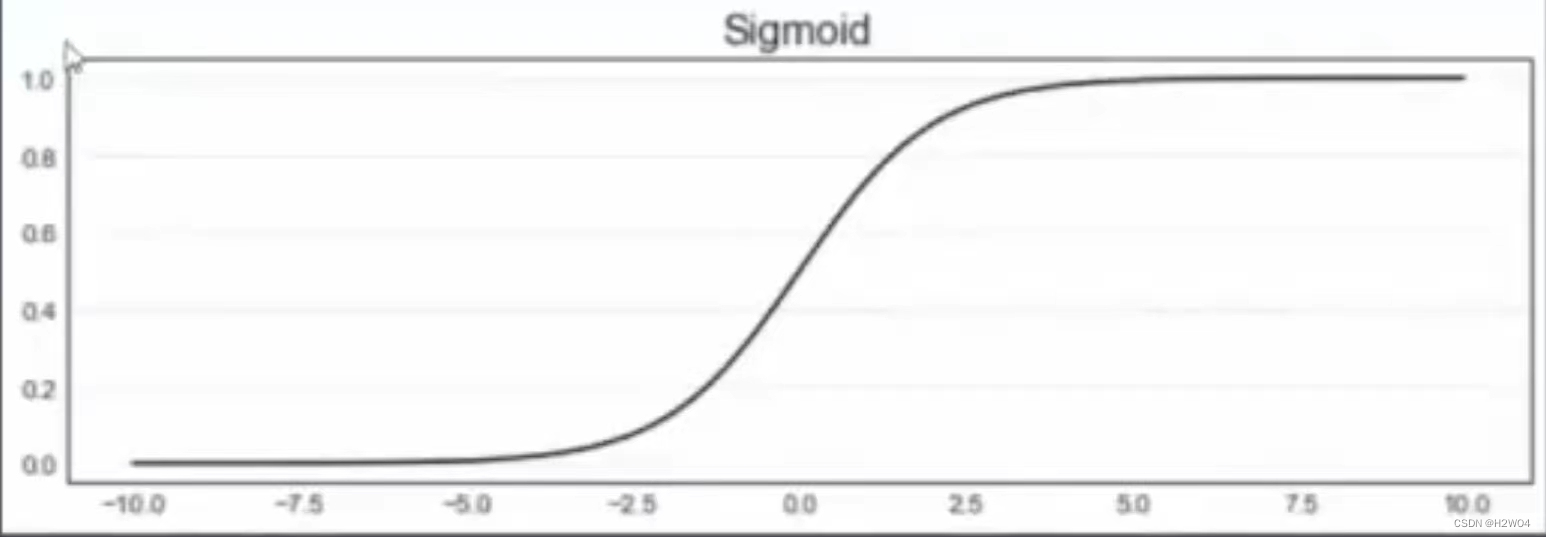

Sigmoid函数

可以将回归算法转化为分类算法:当 值大于设定阈值(如0.5)时,预测结果为1类;

时,预测结果为0类

Pytorch调用:

import torch

from torch.nn import functional as F

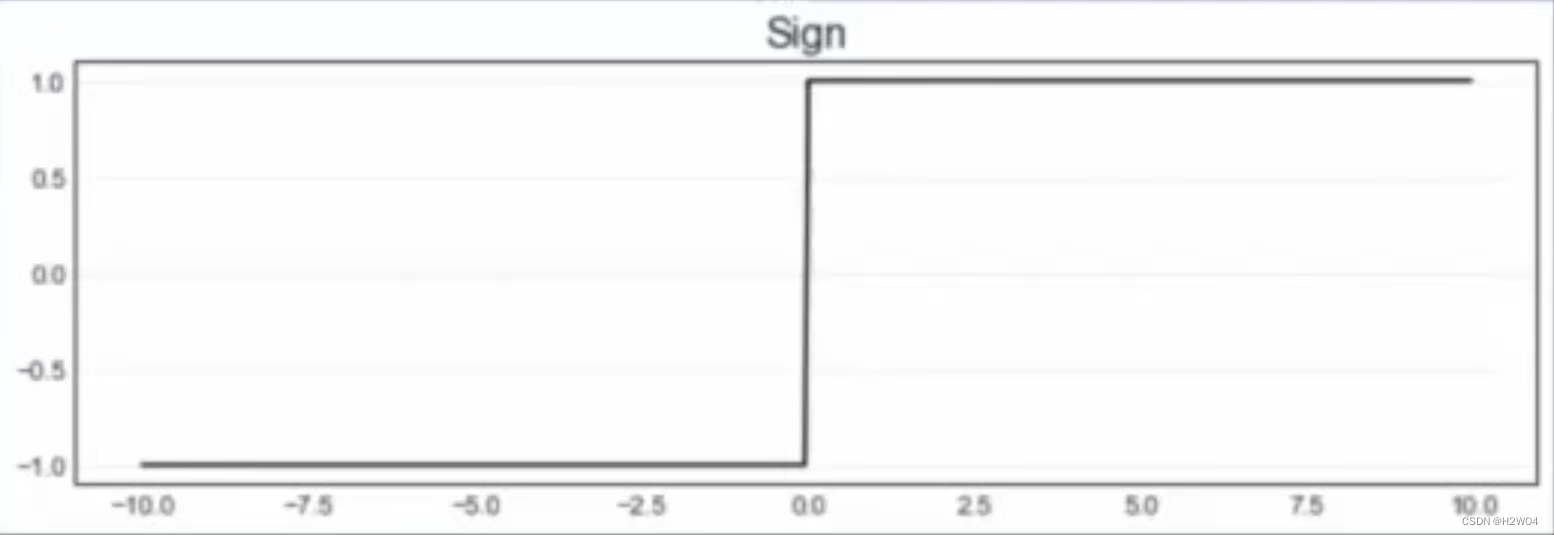

F.sigmoid(zhat)符号函数sign

Pytorch调用:

torch.sign(zhat)ReLu

保留正数元素,将负元素清零

Pytorch调用:

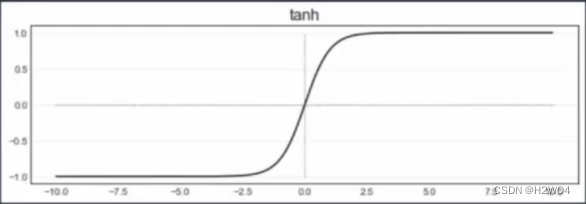

F.relu(zhat)tanh

双曲正切函数,与sigmoid性质类似,能将数值压缩到区间

torch.tanh(zhat)注意sigmoid和ReLu都在torch.nn.functional模块下

5102

5102

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?