梯度下降的线性回归

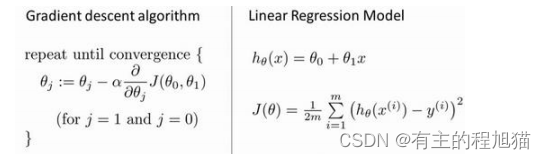

梯度下降算法和线性回归算法比较如图:

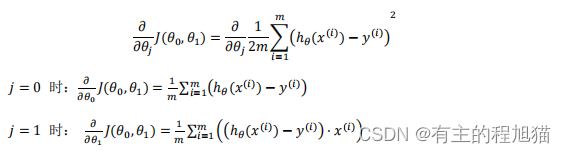

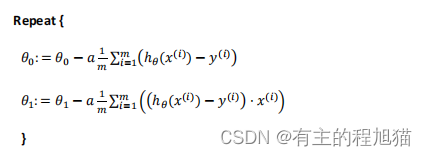

对于线性问题运用梯度下降算法,关键就在于代价函数的导数

这个算法有时也被成为批量梯度下降算法,这里的批量指在每一步我们更新的𝜃都用到所有的训练样本,当然有时对于其他类型的梯度下降罚,不是这种“批量”型的,不需要考虑整个训练集,而是只关注其中一些子集,这个我们以后会学到。

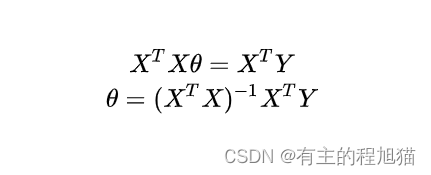

正规方程

可以在不需要多步梯度下降的情况下,也能解出代价函数𝐽的最小值,这是另一种称为正规方程(normal equations)的方法。实际上在数据量较大的情况下,梯度下降法比正规方程要更适用一些。正规方程我们会在以后的博客中进行详解,现在写给出公式:

读者如有兴趣可以查看链接:

974

974

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?