本文重点

为了帮助大家理解神经网络的反向传播算法,本节课程我们将再次学习一下反向传播算法。

前向传播

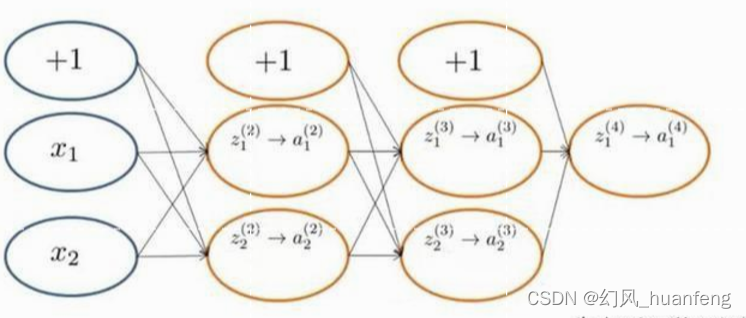

前向传播我个人觉得它就是从输入样本x开始到下一层的z->a然后再到下一层的z->a,逐渐到最后一层输出层的z->a(hθ(x))的过程。每层的每个神经元都是先计算z,然后计算a。

神经网络的损失函数

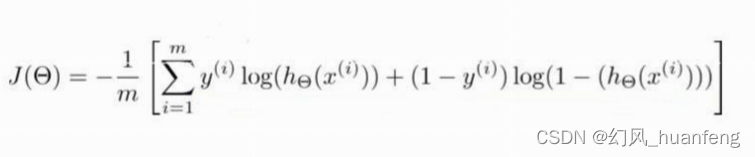

这个神经网络只有一个输出单元,如果此时不考虑正则化,那么此时神经网络的损失函数为:

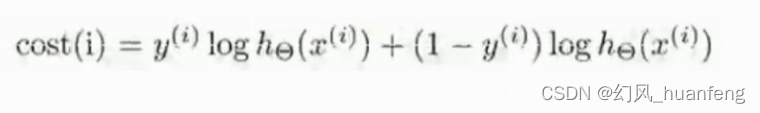

这个代价函数是由m个样本决定的,它是m个样本损失加和,则第i个样本的损失将由下面的这个式子决定:

第i个样本的损失约等于神经网络输出值与实际值的差的平方(hθ(x(i))-y(i))²

这里的cost(i)表示了神经网络是否能够准确的预测第i样本,也就是输出值hθ(x(i))和实际观测值y(i)的接近程度

订阅专栏 解锁全文

订阅专栏 解锁全文

722

722

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?