决策树(Decision Tree)是一种简单但是广泛使用的分类器。通过训练数据构建决策树,可以高效的对未知的数据进行分类。决策数有两大优点:1)决策树模型可以读性好,具有描述性,有助于人工分析;2)效率高,决策树只需要一次构建,反复使用,每一次预测的最大计算次数不超过决策树的深度。

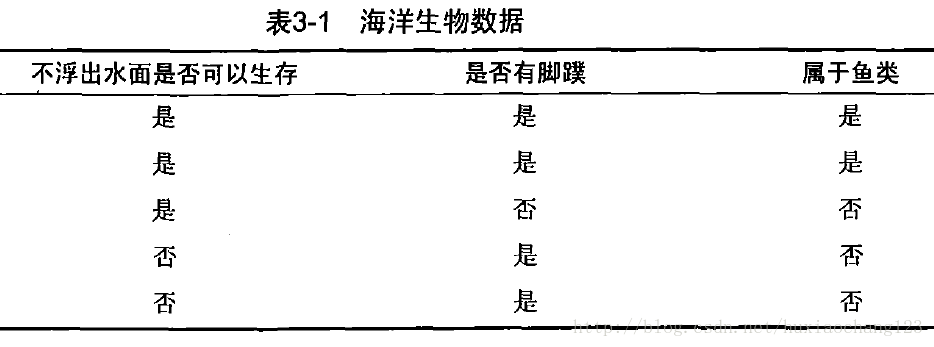

训练数据如下表:

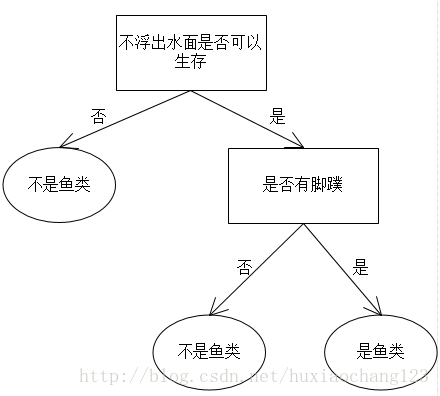

根据训练数据集的数据,构造决策树

比如新发现一种动物,通过决策树就可以判断它是否是鱼类

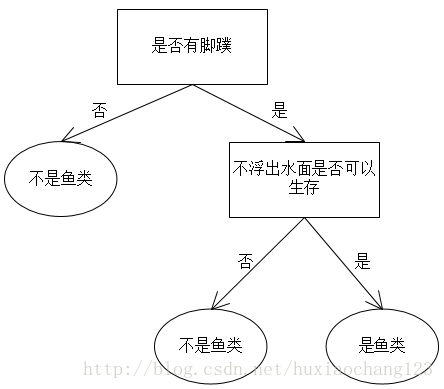

但是在本例中决策树的划分也不止上图的一种,还有另一种

我们通过表能看出第二种分类也能正确分类

但是计算机最终只生成一种决策树,那么如何选择呢?在这里就要使用信息熵来决定使用哪种方案

下面代码给出了选择哪个特征(不浮出水面是否可以生存、是否有脚蹼)能最好的划分数据集

# coding:utf-8

from math import log

import operator

##创建训练数据集

def createDataSet():

dataSet = [[1, 1, 'yes'],

[1, 1, 'yes'],

[1, 0, 'no'],

[0, 1, 'no'],

[0, 1, 'no']] #数据集的最后一个元素作为该数据的标签,是否是鱼

labels = ['no surfacing','flippers'] #不浮出水面是否可以生存、是否有脚蹼

return dataSet, labels

##计算信息熵

def calcShannonEnt(dataSet):

numEntries = len(dataSet)

labelCounts = {}

for featVec in dataSet: #计算每一个标签出现的次数

currentLabel = featVec[-1] #数据集的最后一个元素是该数据的标签,表示是否是鱼

if currentLabel not in labelCounts.keys(): labelCounts[currentLabel] = 0

labelCounts[currentLabel] += 1

shannonEnt = 0.0

for key in labelCounts: #计算信息熵

prob = float(labelCounts[key])/numEntries

shannonEnt -= prob * log(prob,2) #log base 2

return shannonEnt

##分割数据集 axis即为在每一行中第axis个元素作为特征值划分并选出值与value相等的那一行,但要除去第axis个元素

def splitDataSet(dataSet, axis, value):

retDataSet = []

for featVec in dataSet:

if featVec[axis] == value:

reducedFeatVec = featVec[:axis] #输出的数据中要剔除该行第axis个元素

reducedFeatVec.extend(featVec[axis+1:])#输出的数据中要剔除该行第axis个元素

retDataSet.append(reducedFeatVec)

return retDataSet

##选择最好的数据集划分方式

def chooseBestFeatureToSplit(dataSet):

numFeatures = len(dataSet[0]) - 1 #每一行的最后一个元素作为该行的标签

baseEntropy = calcShannonEnt(dataSet)

bestInfoGain = 0.0; bestFeature = -1

for i in range(numFeatures): #遍历每一个特征

featList = [example[i] for example in dataSet]#取出特征值数组,即取出数据集每行的第i列组成一个数组

uniqueVals = set(featList) #使用set数据类型来去除重复项

newEntropy = 0.0

for value in uniqueVals:

subDataSet = splitDataSet(dataSet, i, value) #分割数据集

prob = len(subDataSet)/float(len(dataSet))

newEntropy += prob * calcShannonEnt(subDataSet)

infoGain = baseEntropy - newEntropy #计算数据集的基础信息熵与所选特征信息熵的差值,越大表示选择的特征所具有的信息熵越小,就选择该特征

if (infoGain > bestInfoGain):

bestInfoGain = infoGain

bestFeature = i

return bestFeature #返回能最好划分数据集的特征, 如dataSet = [[1, 1, 'yes'], [1, 1, 'yes'],[1, 0, 'no'], [0, 1, 'no'],[0, 1, 'no']] 一行中的第一个元素或第二个元素

dataSet, labels=createDataSet()

print chooseBestFeatureToSplit(dataSet)计算出的结果为 0,说明选择不浮出水面是否可以生存该特征

635

635

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?