一、背景

大语言模型(LLM)的复杂性和开放性带来了诸多评估挑战。准确、全面地评估大语言模型的性能,对于确保其在实际应用中的可靠性、安全性和有效性至关重要。本文将深入探讨大语言模型评估的现状、挑战以及未来的发展方向,旨在为相关领域的研究人员和实践者提供有价值的参考。

二、大语言模型评估的现状

(一)评估的重要性

大语言模型在部署前必须经过严格的评估。评估不仅能够验证模型的准确性、公平性和可靠性,还能帮助开发者发现潜在问题并加以改进。通过评估,可以确保模型在真实世界的应用中不会产生误导性信息、偏见内容或其他不良输出,从而赢得用户的信任。

(二)主要评估维度

- 准确性(Accuracy)

-

事实正确性:大语言模型常常出现“幻觉”现象,即自信地生成错误的事实。因此,必须衡量模型输出与真实事实的一致性,以识别和减少这类错误。

-

评估方法:通常采用与参考答案的匹配度(如 BLEU、ROUGE 等)或事实核查(如 FactCC)等方法来评估准确性。

- 公平性与偏见(Fairness and Bias)

-

背景与影响:训练数据中存在的偏见可能会被模型无意中反映或放大,导致对某些群体的不公平对待或刻板印象的传播。

-

评估方法:通过测试模型在不同人群、情境下的表现,识别潜在的偏见。例如,对比不同性别、种族等群体的输出结果,检查是否存在显著差异。

- 真实世界可用性(Real-world Usability)

-

多轮对话与上下文理解:真实场景中的用户输入往往包含模糊查询、对话式背景或跨语言输入。评估需要模拟这些复杂场景,确保模型在多轮对话中保持连贯性和有用性。

-

安全性:评估模型产生有害或不适当内容的频率,以最小化对最终用户的风险。

- 性能(Performance)

-

效率:包括模型的响应速度、计算资源消耗等。在实际应用中,模型需要在合理的时间内给出高质量的输出。

-

可扩展性:评估模型在不同负载下的表现,确保其能够适应大规模应用的需求。

(三)评估方法

- 传统统计指标

-

困惑度(Perplexity):衡量模型对测试数据的预测能力。较低的困惑度表明模型对测试数据的不确定性更小,预测更准确。

-

BLEU(Bilingual Evaluation Understudy):通过比较模型输出与参考文本的 n-gram 重叠度来评估生成文本的质量。虽然 BLEU 在机器翻译领域应用广泛,但对开放性生成任务的适用性有限。

-

ROUGE(Recall-Oriented Understudy for Gisting Evaluation):主要用于文本摘要任务,衡量模型输出与参考摘要之间的 n-gram 重叠度。ROUGE 能够较好地反映摘要的召回率,但同样无法直接衡量语义一致性。

-

METEOR(Metric for Evaluation of Translation with Explicit ORdering):通过灵活的匹配策略,考虑词干、同义词等因素,对机器翻译和文本摘要任务的评估结果与人类判断的相关性更高。

-

F1 分数:适用于输出可以被视为一组项目的任务(如实体抽取、问答系统等)。F1 分数是精确率和召回率的调和平均值,能够平衡模型输出的准确性和完整性。

- 基于模型的评估指标

-

BERTScore:利用预训练语言模型(如 BERT)的嵌入向量来评估文本相似性。BERTScore 能够捕捉语义信息,对生成文本的质量评估与人类判断的相关性更强。

-

COMET:通过训练神经网络来预测机器翻译输出的质量,其评估结果与人类评分的相关性较高。

-

其他学习型指标:如 BLEURT、PRISM、BARTScore 等,这些指标借助大型语言模型的力量,能够更全面地评估文本的质量。

-

LLM 自身作为评估器:利用强大的 LLM(如 GPT-4)作为评估器,通过给定的评分标准或详细说明来评价其他模型的输出。这种方法能够更好地捕捉文本的语义和逻辑一致性。

- 人类评估方法

-

偏好测试(Pairwise Comparison):让评估者比较两个模型或模型与参考答案之间的输出,选择更优的选项。这种方法简单直观,能够直接反映模型之间的相对优劣。

-

Likert 量表评分:评估者根据特定标准对模型输出进行评分,如质量、信息量、有害性等。Likert 量表评分能够提供更细致的评估结果,但需要确保评分标准的清晰性和一致性。

-

A/B 测试:在实际应用中,将不同模型部署给不同用户群体,通过用户反馈来评估模型的性能。A/B 测试能够真实地反映模型在实际使用场景中的表现,但需要谨慎处理用户隐私和伦理问题。

(四)评估框架与工具

- 自动化基准测试

-

GLUE 和 SuperGLUE:用于评估模型在多种自然语言理解任务上的性能,涵盖情感分析、语义相似性、问答等任务。

-

MMLU(Massive Multitask Language Understanding):测试模型在多个学科领域的知识和推理能力,通过多项选择题的形式评估模型的知识深度。

-

HellaSwag、PIQA、WinoGrande 等:针对常识推理和逻辑能力的评估基准,能够测试模型在日常生活场景中的推理能力。

-

BIG-bench(Beyond the Imitation Game):包含多种复杂任务,旨在挑战模型的高级能力,如数学问题、逻辑谜题等。

-

HELM(Holistic Evaluation of Language Models):提供一个综合评估框架,涵盖准确性、鲁棒性、校准、公平性、偏见、毒性等多个维度,为模型的全面评估提供了一个平台。

- 自定义评估工具

-

OpenAI Evals:允许开发者根据具体需求定义评估逻辑,如检查模型输出是否包含关键信息等。

-

W&B Weave:作为一个轻量级工具包,能够跟踪和评估 LLM 应用,记录模型的输入输出、中间步骤以及自定义指标,为评估提供了一个系统化的平台。

三、大语言模型评估的挑战

(一)模型复杂性与输出开放性

大语言模型的复杂结构和开放性输出使得评估变得极具挑战性。传统评估指标(如分类任务的准确率)难以适用于长文本生成任务,因为这些任务往往没有唯一的“正确”答案。例如,在故事生成或对话任务中,模型输出的多样性使得评估标准难以统一。此外,模型输出的质量还受到主观性的影响,如什么是“好的”总结或“有帮助的”回答,这需要依赖人类的判断,而人类判断往往成本高昂且可能存在不一致性。

(二)评估指标的局限性

-

依赖参考输出:许多评估指标(如 BLEU、ROUGE)需要参考输出作为比较基准。然而,在开放性任务(如开放域对话、创意写作)中,定义参考输出是非常困难的。即使有参考输出,这些指标也主要评估表面相似性,无法直接衡量语义一致性、逻辑连贯性或风格适当性等重要属性。例如,一个与参考文本单词重叠度高的输出可能在语义上与参考文本完全不同,而一个与参考文本单词重叠度低但语义相同的输出可能会被低估。

-

模型过拟合风险:如果仅依赖这些传统指标进行优化,模型可能会过度适应这些指标,而没有真正提高输出质量。例如,模型可能会通过复制参考文本中的单词来提高 BLEU 分数,而不是生成真正高质量的文本。

-

人类评估的局限性:虽然人类评估被认为是“黄金标准”,但它存在成本高、时间长、难以规模化等问题。此外,人类评估者之间可能存在主观差异,导致评估结果不一致。例如,不同的评估者可能对同一个输出的“有用性”或“自然性”有不同的看法。

(三)模型行为的动态性

大语言模型的行为可能会随着输入提示的微小变化或对话流程的改变而发生变化。这使得可重复的评估变得困难,因为即使在相同的条件下,模型输出也可能因提示的细微差异而有所不同。因此,评估时需要仔细控制提示和条件的版本,以确保评估结果的可重复性。

四、大语言模型评估的未来方向

(一)更精细、动态的评估方法

未来的评估方法将不再局限于单一的分数,而是能够生成更丰富的模型行为报告。例如,通过生成“能力报告”来突出模型在多个维度上的优势和劣势。此外,评估系统可能会根据模型的表现动态调整测试难度,以更准确地评估模型的能力边界。

(二)AI 辅助评估与可解释性

随着 LLM 在评估中的应用不断深入,未来可能会开发出更符合人类判断的评估模型。这些模型不仅能够对输出进行评分,还能检测特定问题(如逻辑谬误或偏见)。此外,评估可能会包括对模型内部结构的解释性检查,例如通过分析模型的内部激活来预测错误,或评估模型推理路径的一致性。

(三)持续实时评估

随着模型更新频率的增加,评估可能会变得更加持续和实时化。未来的评估工具将能够实时监控模型输出流,并实时计算指标。例如,部署的聊天机器人可以有一个实时更新的性能仪表板,包括用户满意度分数、话题成功率等。

(四)用户中心和上下文评估

未来的评估将更加关注用户需求和上下文环境。例如,模型的性能可能会根据不同的用户群体或偏好进行个性化评估。此外,评估将考虑模型在不同上下文长度(如 10K 令牌与 1K 令牌)或用户设置不同语调时的表现。

(五)基准测试的演变和元评估

新的基准测试将继续涌现,以测试模型在推理、常识、多模态理解等方面的能力。同时,元评估(即对评估方法本身的评估)将成为一个重要方向。研究人员将探索各种指标与人类判断的相关性,以指导更可靠的评估指标的选择。

(六)可解释性评估标准

未来的评估不仅会关注模型是否正确,还会关注模型是否能够解释其答案或推理过程。例如,模型可能会因为能够提供正确且连贯的解释而获得更高的分数。这种对可解释性的评估将鼓励模型不仅产生正确的输出,还能以可验证的方式进行推理。

(七)多模态和具身评估

随着 LLM 与其他模态(如图像、视频、机器人技术)的融合,评估也将跨越模态。例如,评估一个能够描述图像的模型需要结合图像字幕生成和视觉问答的基准测试。未来的评估框架将整合这些多模态模型的评估,以确保模型在不同模态下的表现。

大模型岗位需求

大模型时代,企业对人才的需求变了,AIGC相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

可能大家都想学习AI大模型技术,也想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把全套AI技术和大模型入门资料、操作变现玩法都打包整理好,希望能够真正帮助到大家。

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

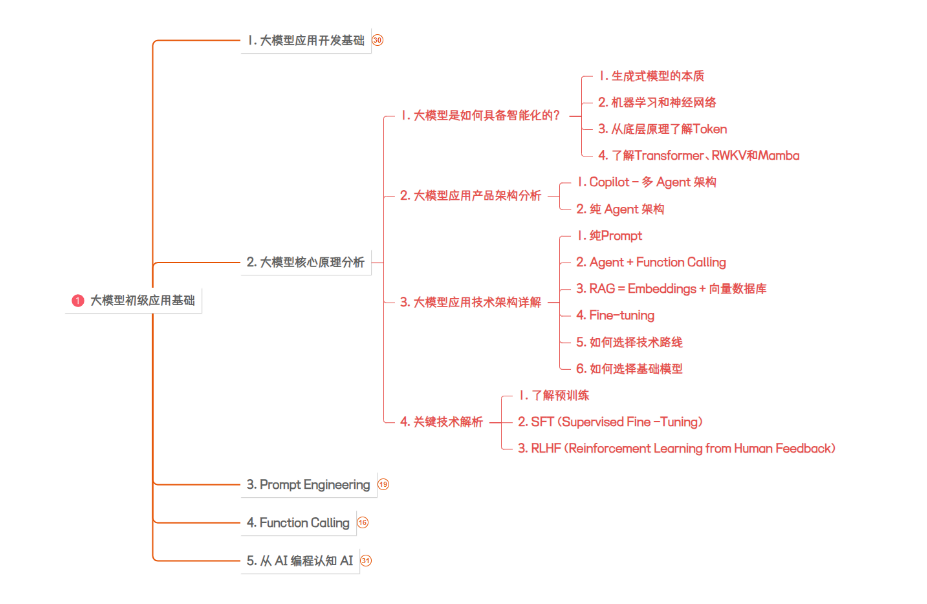

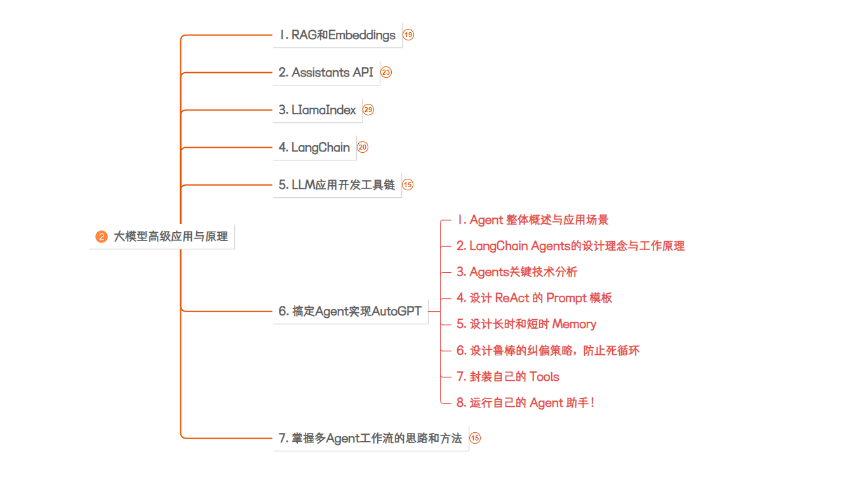

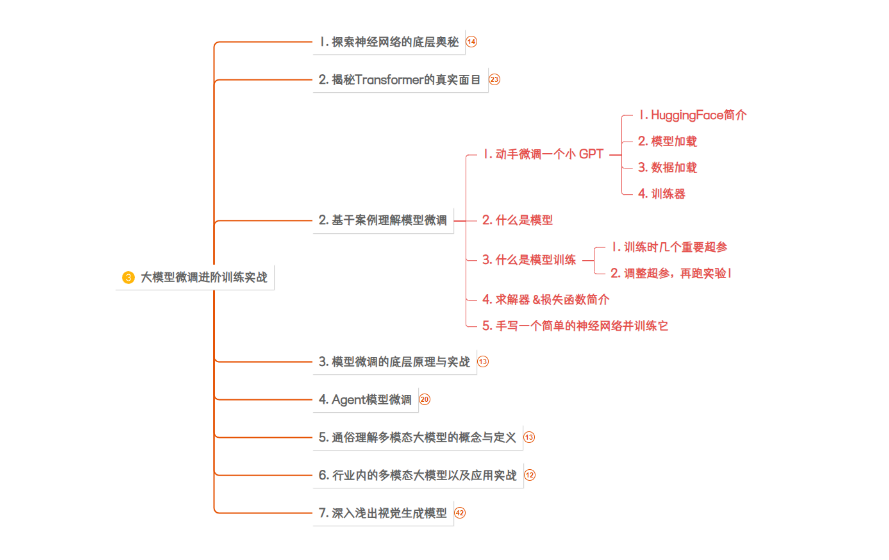

零基础入门AI大模型

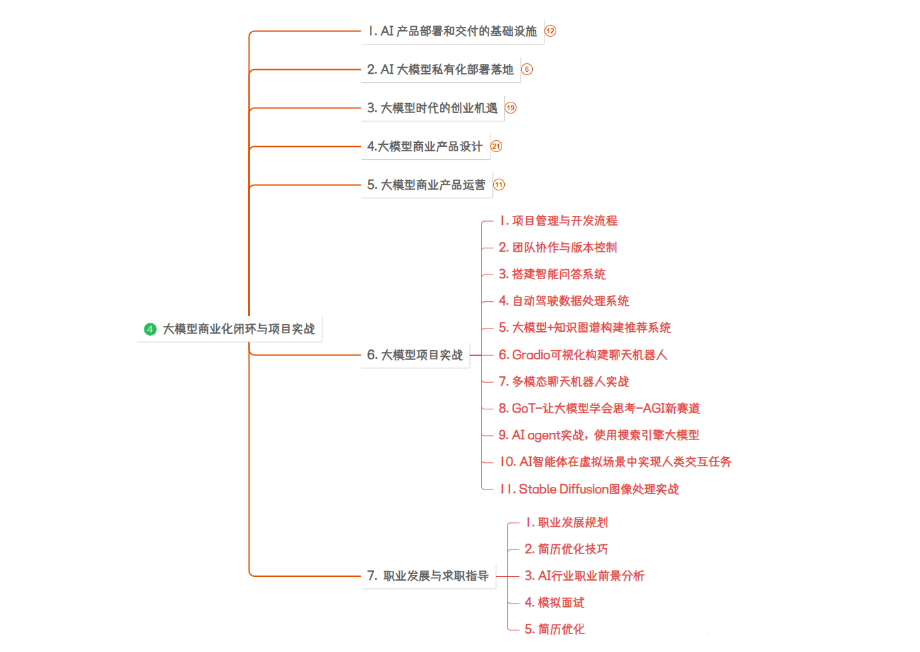

今天贴心为大家准备好了一系列AI大模型资源,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

有需要的小伙伴,可以点击下方链接免费领取【保证100%免费】

1.学习路线图

如果大家想领取完整的学习路线及大模型学习资料包,可以扫下方二维码获取

👉2.大模型配套视频👈

很多朋友都不喜欢晦涩的文字,我也为大家准备了视频教程,每个章节都是当前板块的精华浓缩。(篇幅有限,仅展示部分)

大模型教程

👉3.大模型经典学习电子书👈

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。(篇幅有限,仅展示部分,公众号内领取)

电子书

👉4.大模型面试题&答案👈

截至目前大模型已经超过200个,在大模型纵横的时代,不仅大模型技术越来越卷,就连大模型相关的岗位和面试也开始越来越卷了。为了让大家更容易上车大模型算法赛道,我总结了大模型常考的面试题。(篇幅有限,仅展示部分,公众号内领取)

大模型面试

**因篇幅有限,仅展示部分资料,**有需要的小伙伴,可以点击下方链接免费领取【保证100%免费】

**或扫描下方二维码领取 **

1603

1603

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?