一、前言

最近由于研究需要,要用到线性判别分析(LDA)。于是找了很多资料来看,结果发现大部分讲的都是理论知识,因此最后还是看的一知半解,后来终于找到了个英文的文档,作者由PCA引入LDA,看过后豁然开朗,主要是文档中有详细的例子,为了保持原版在此就直接粘贴过来了——后面的例子是结合MATLAB实现的!

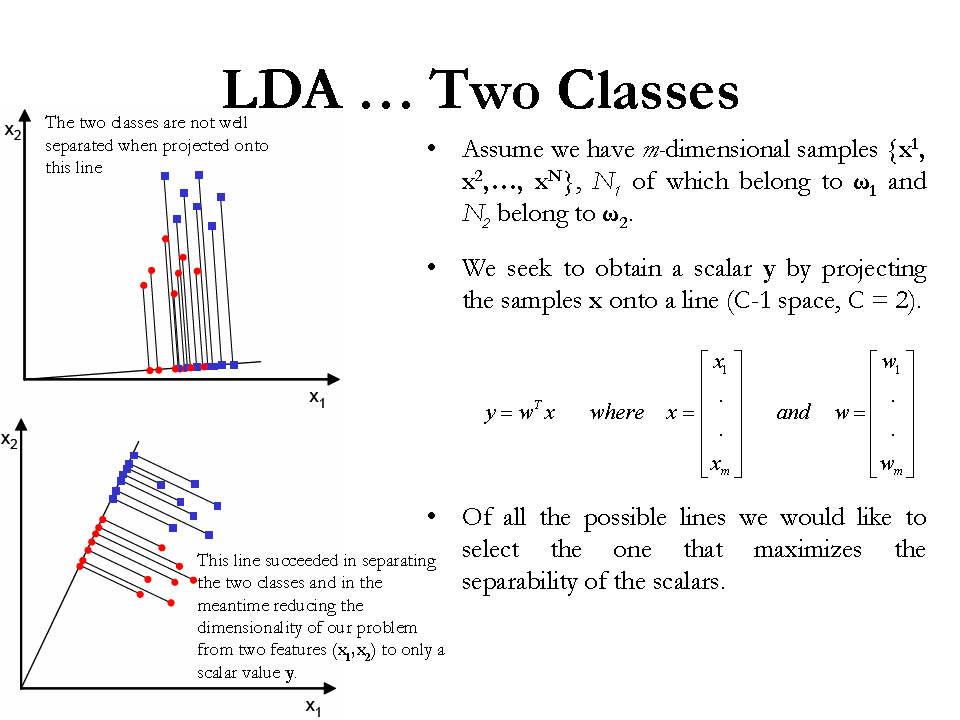

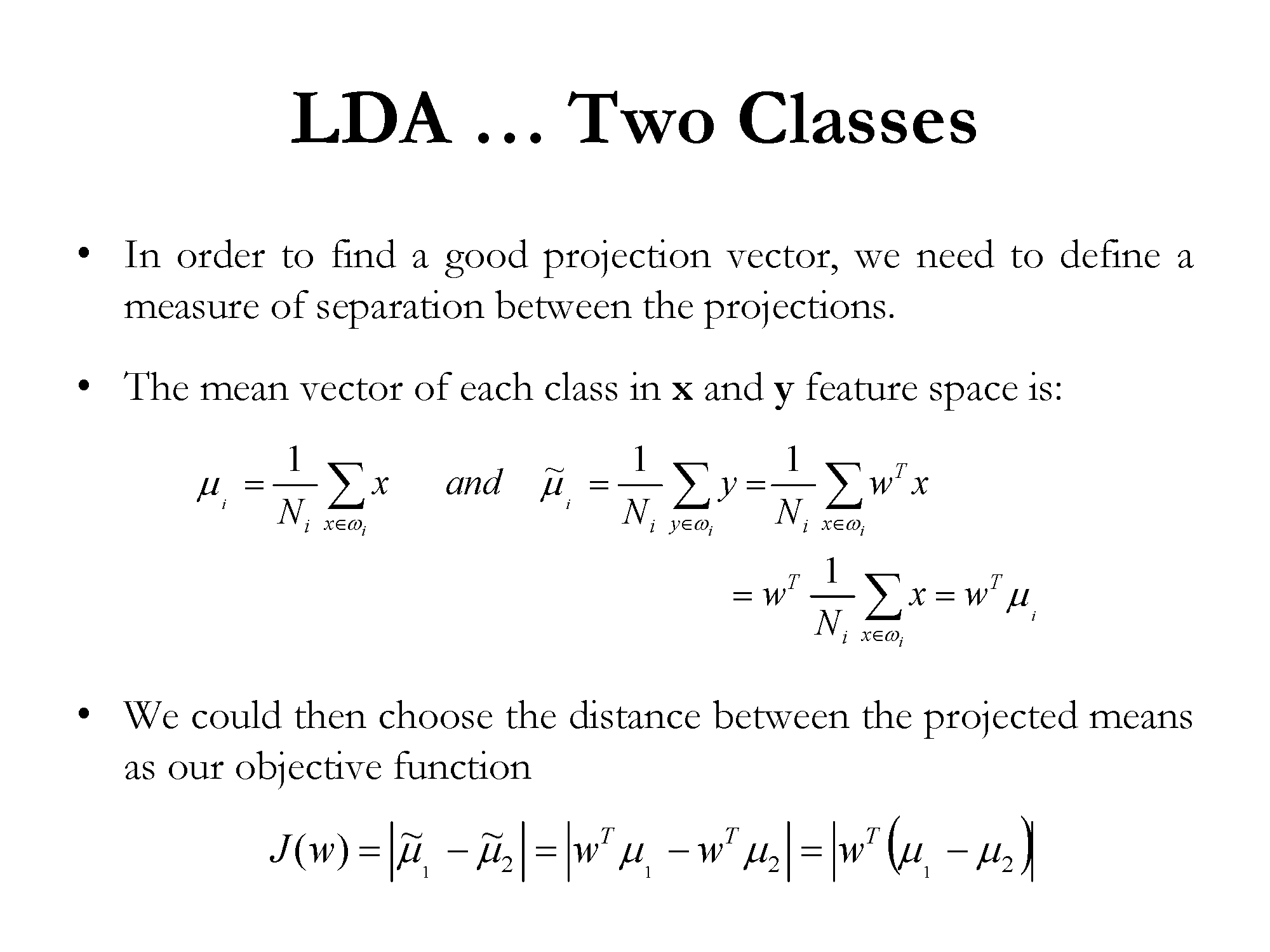

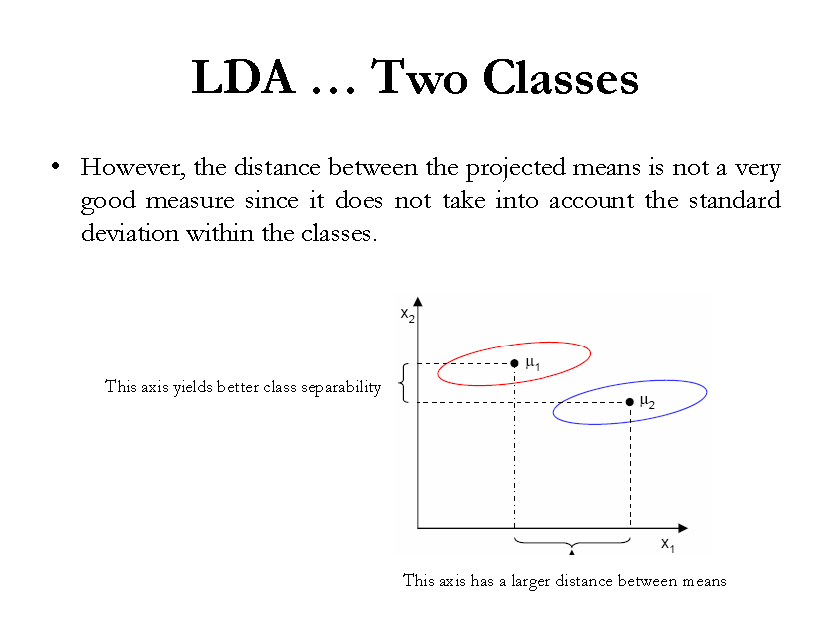

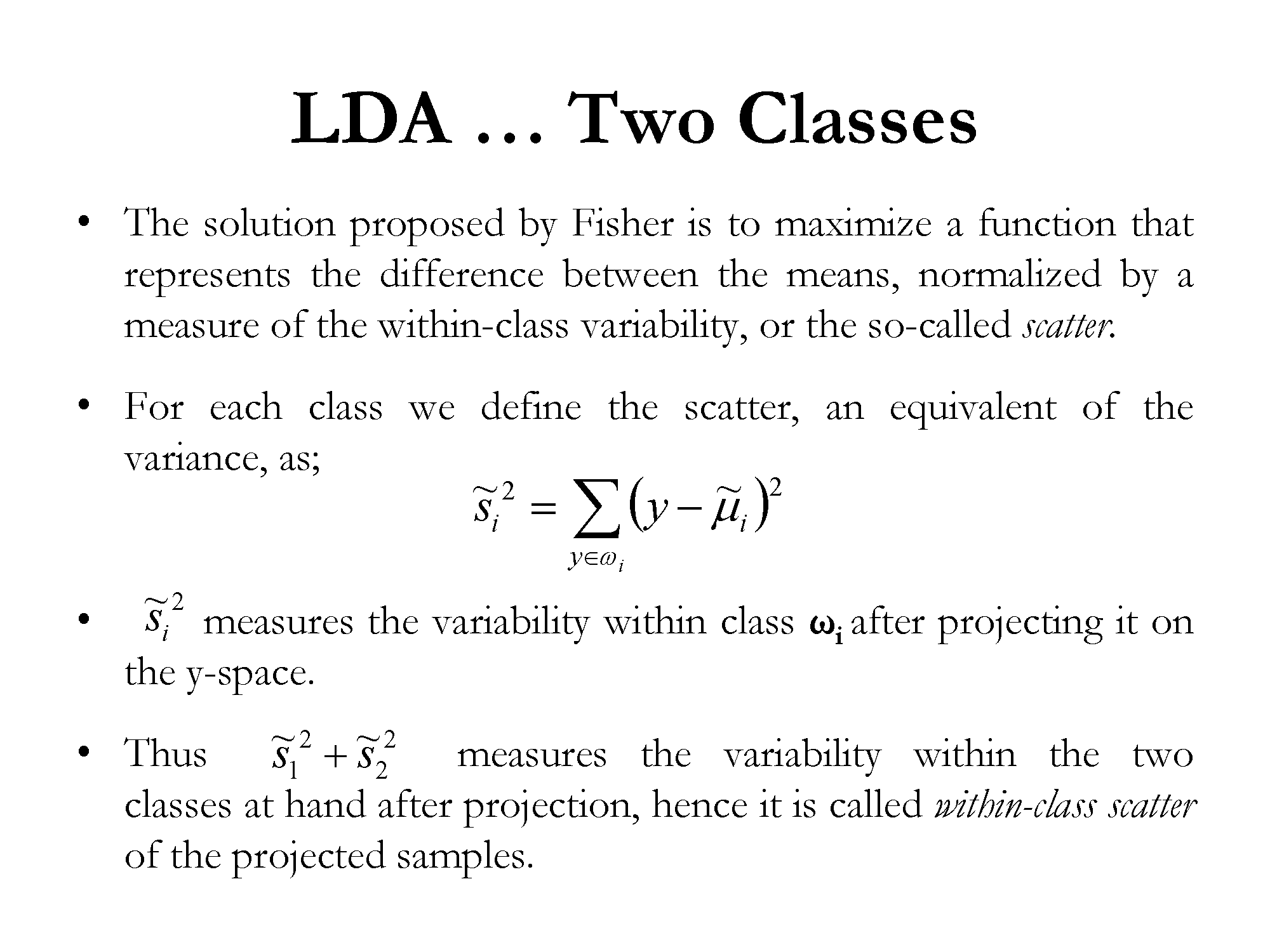

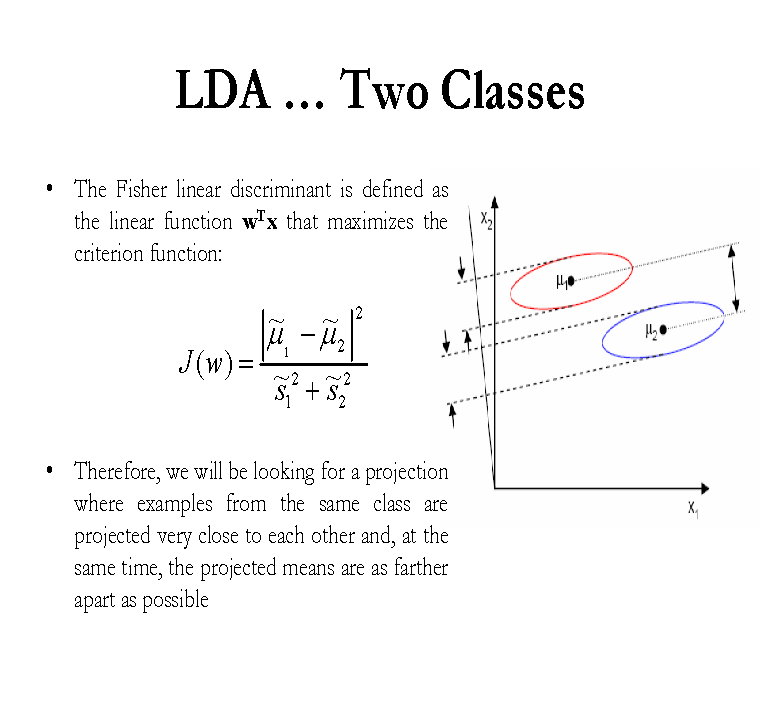

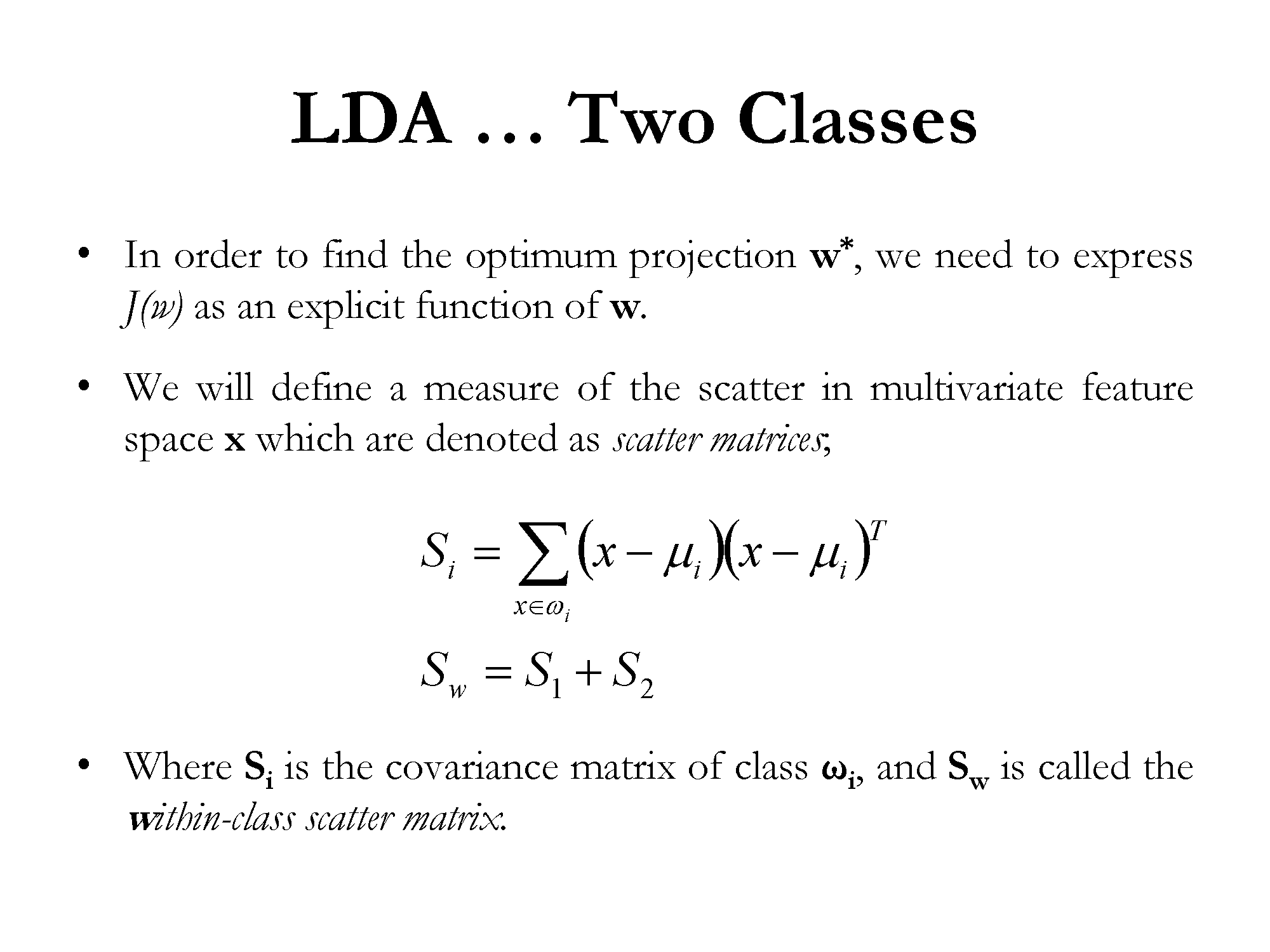

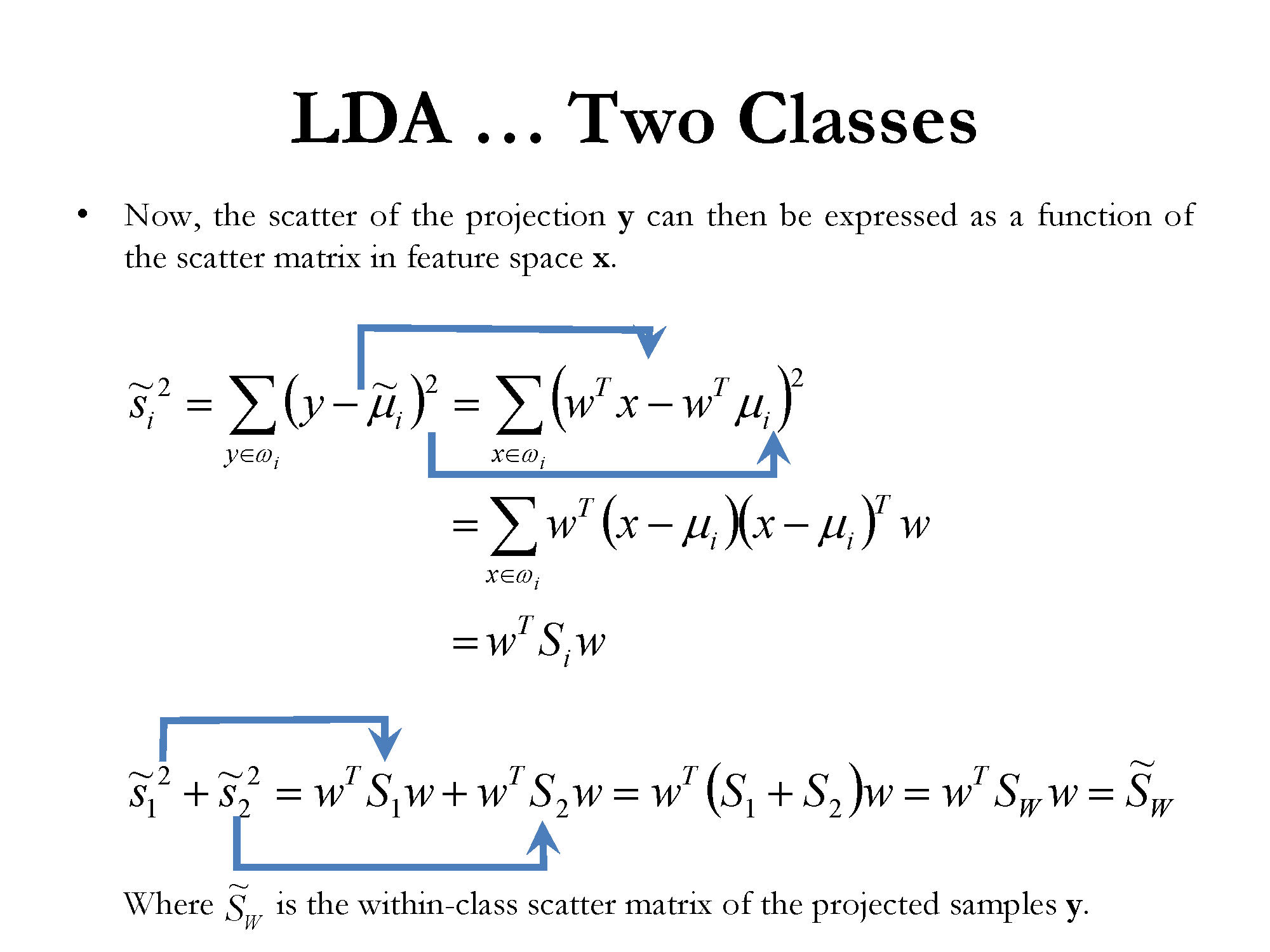

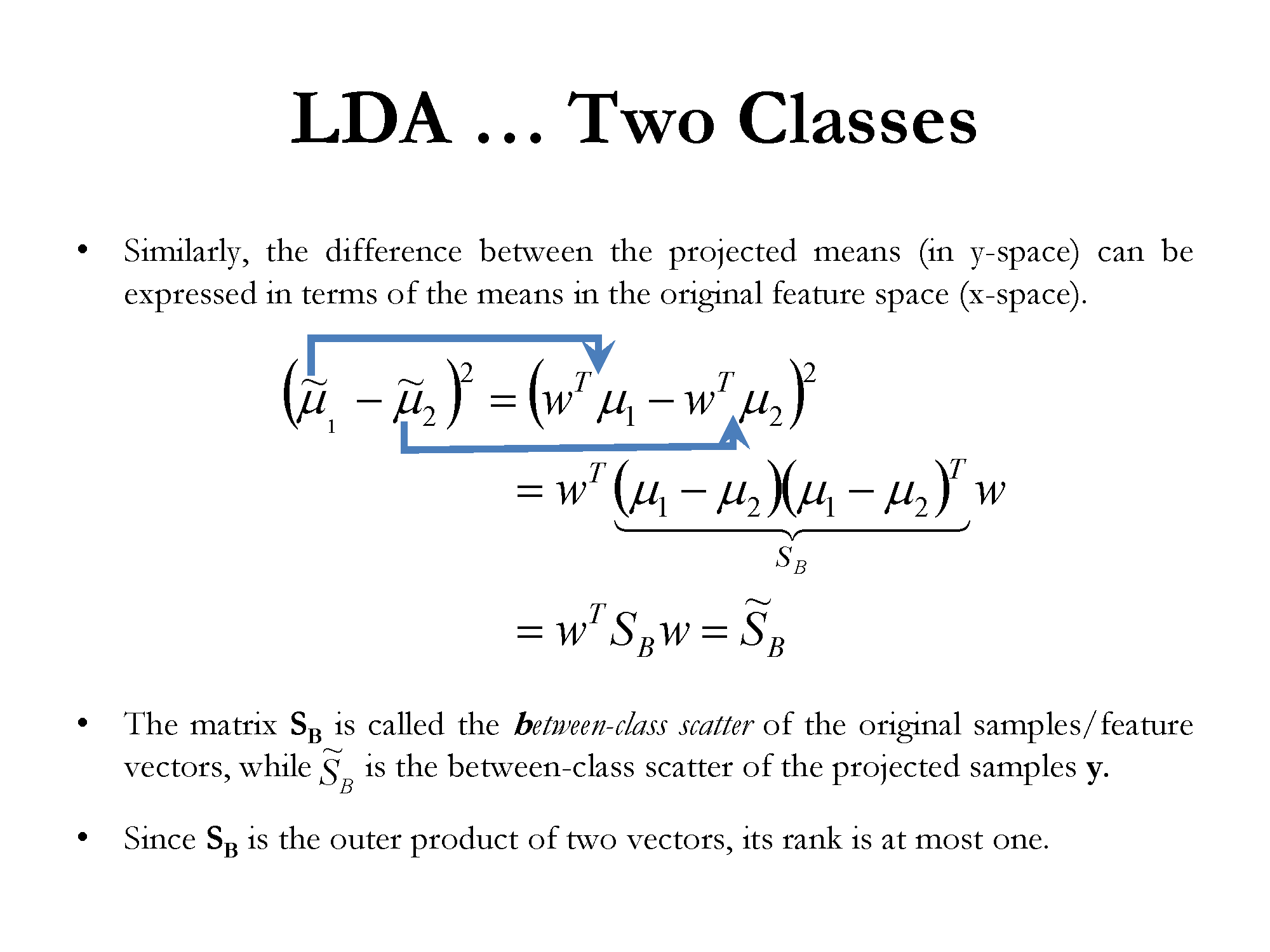

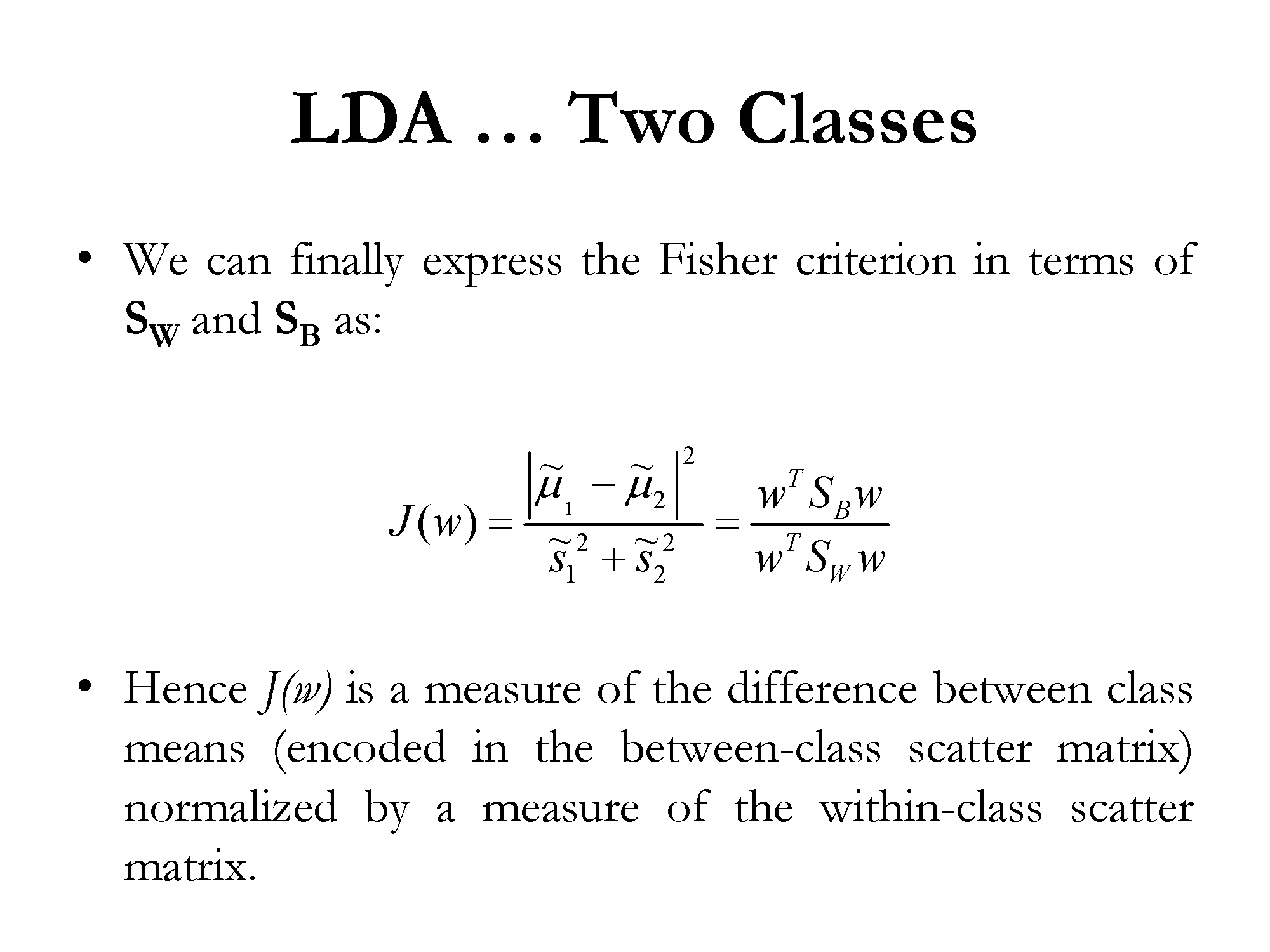

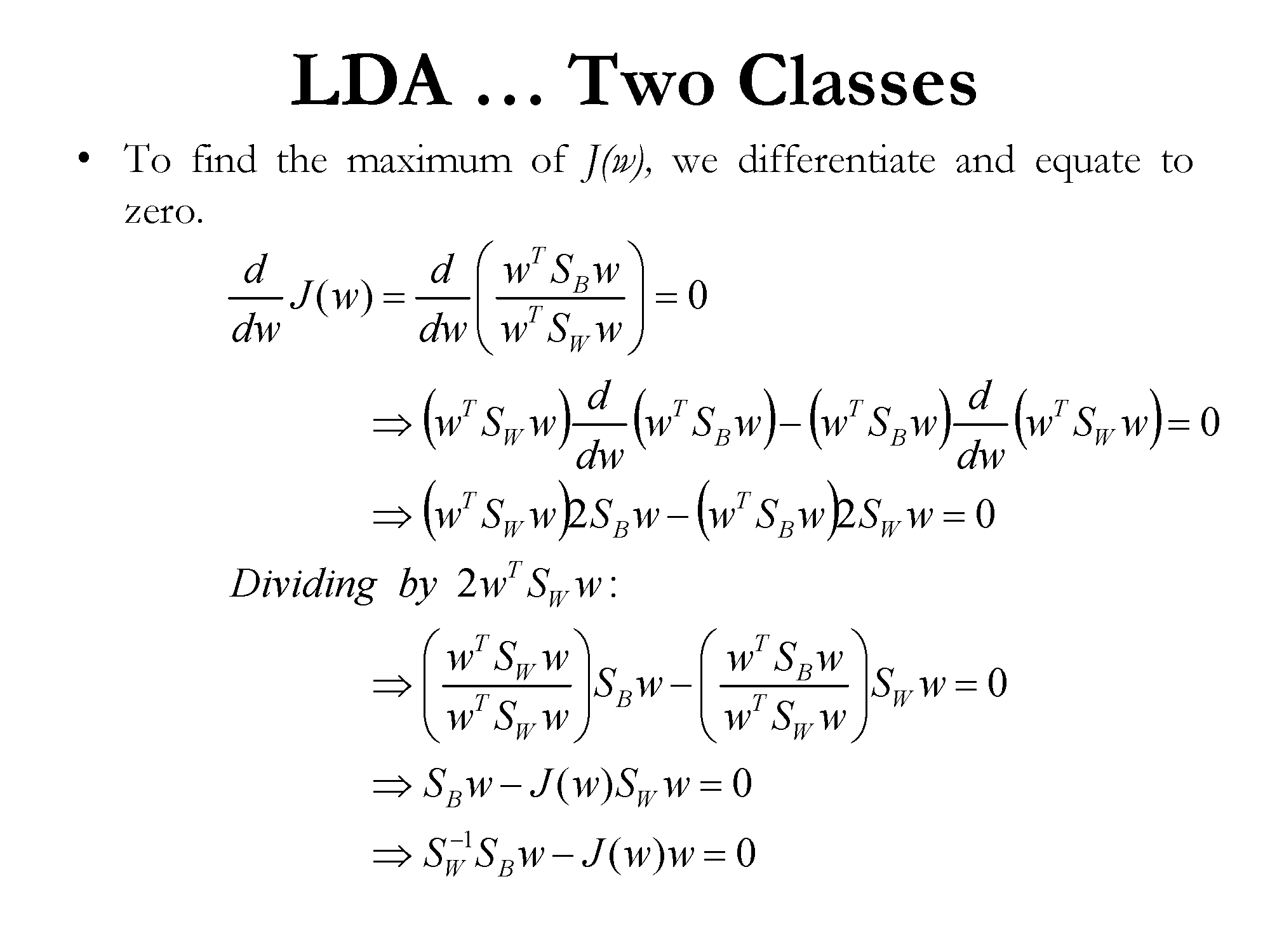

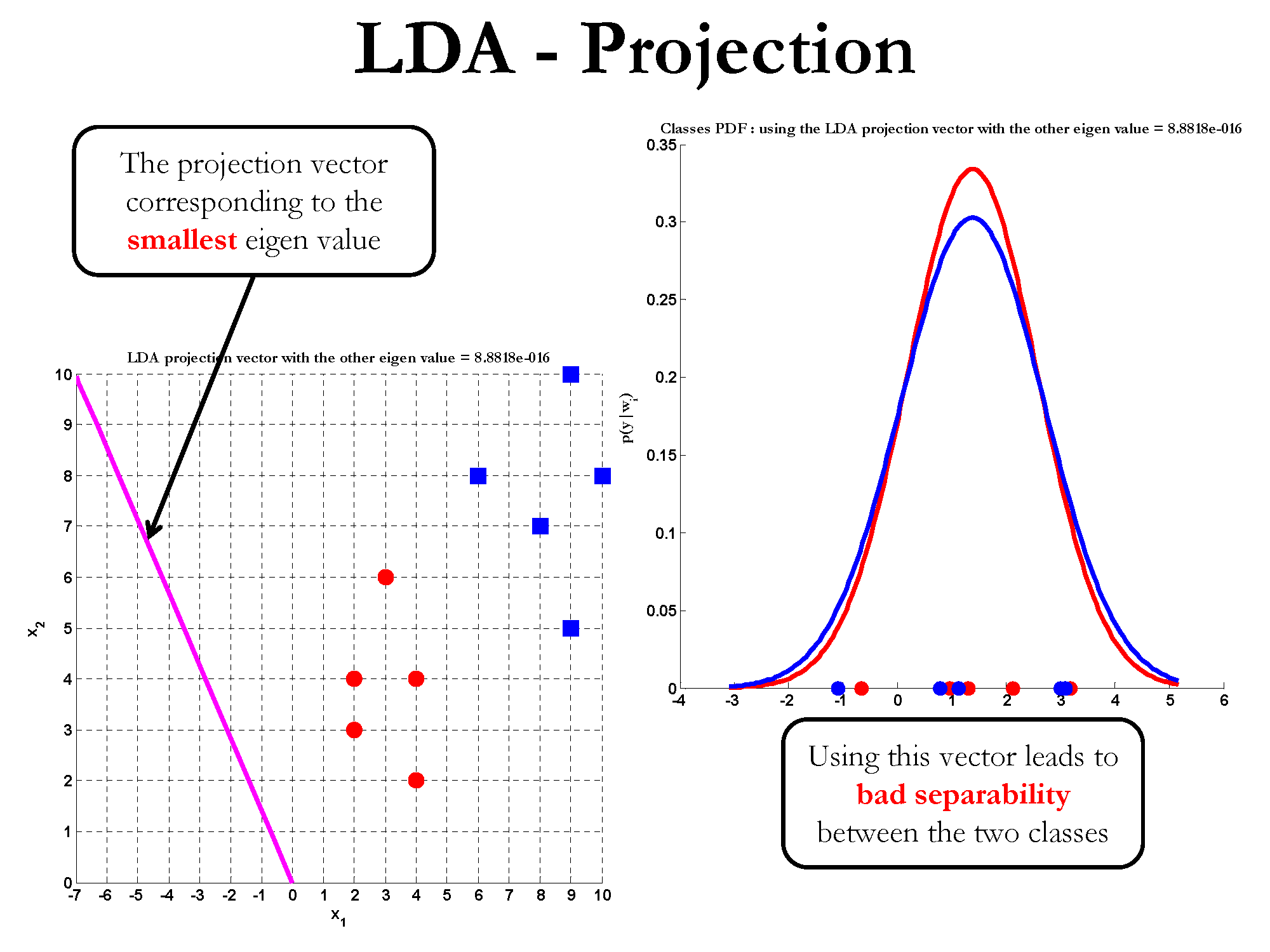

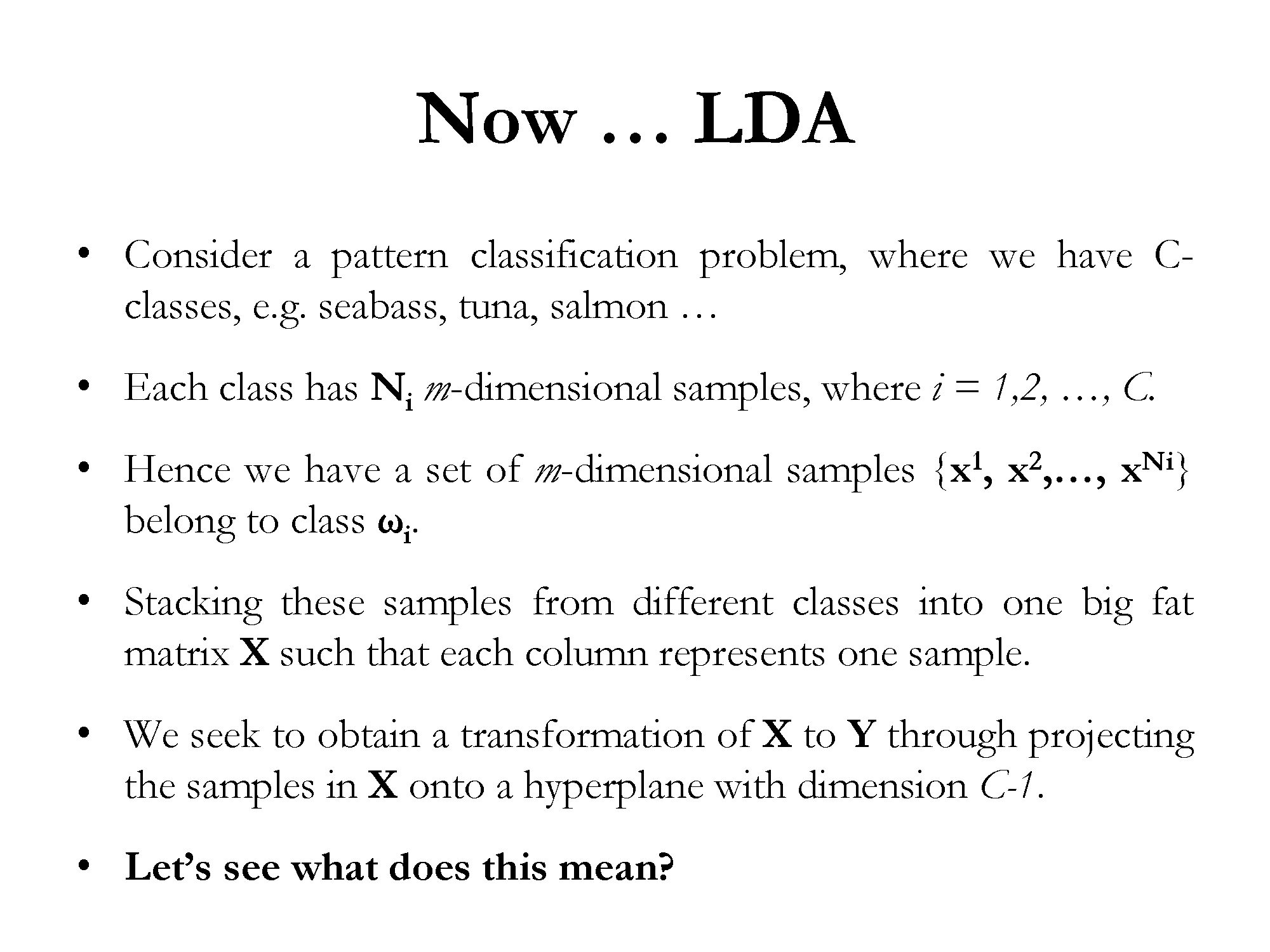

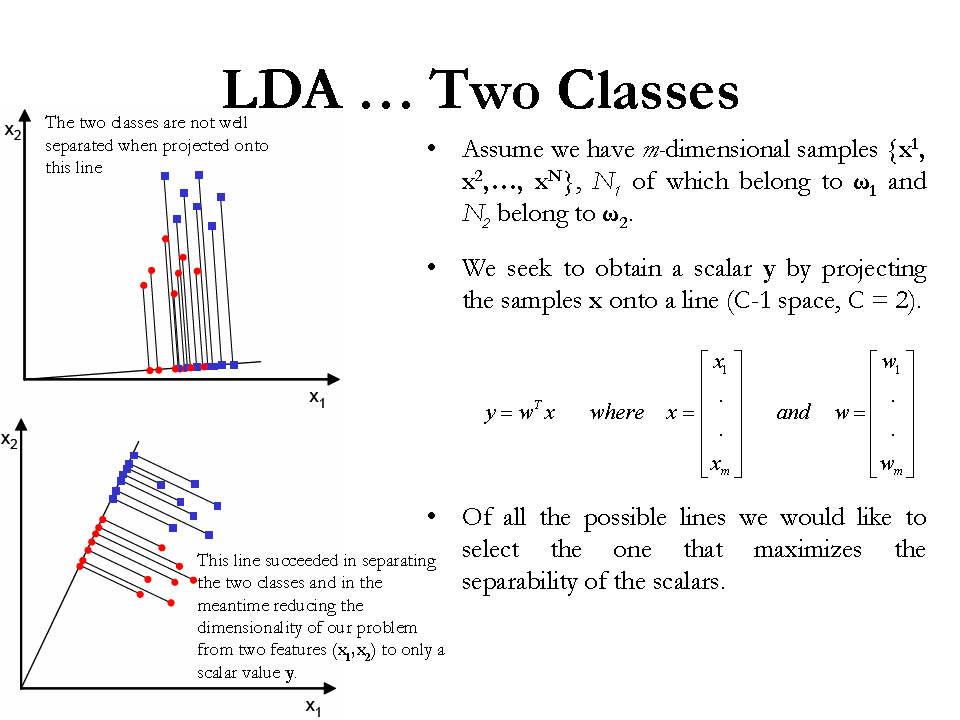

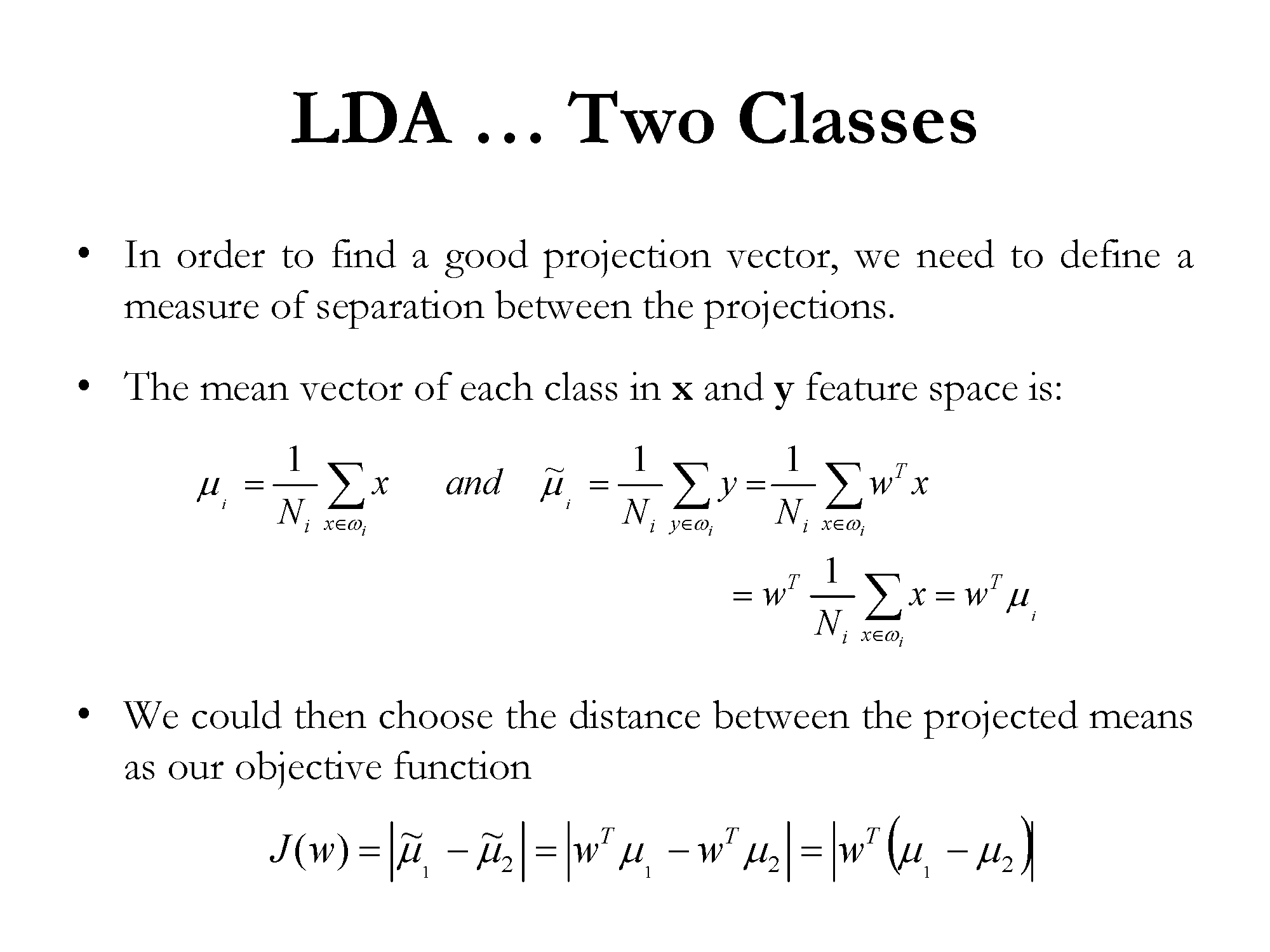

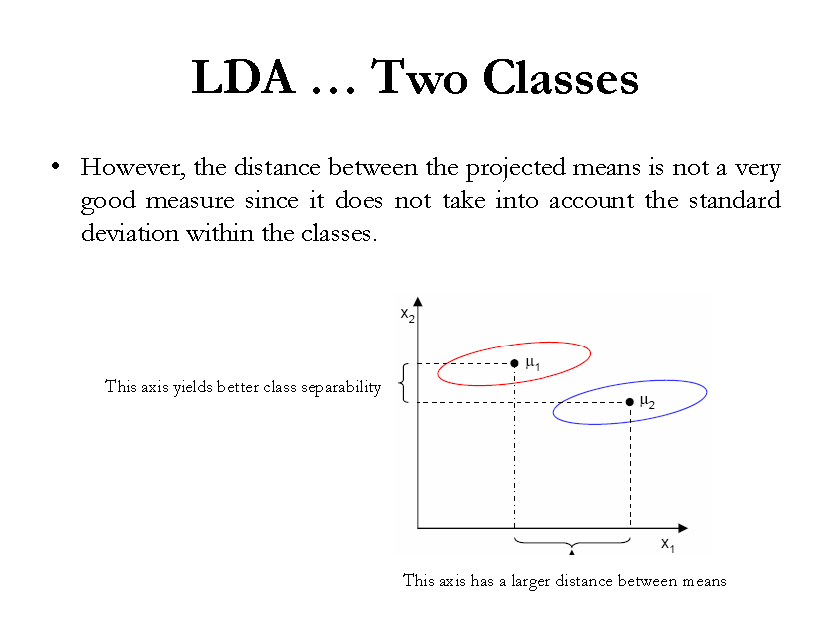

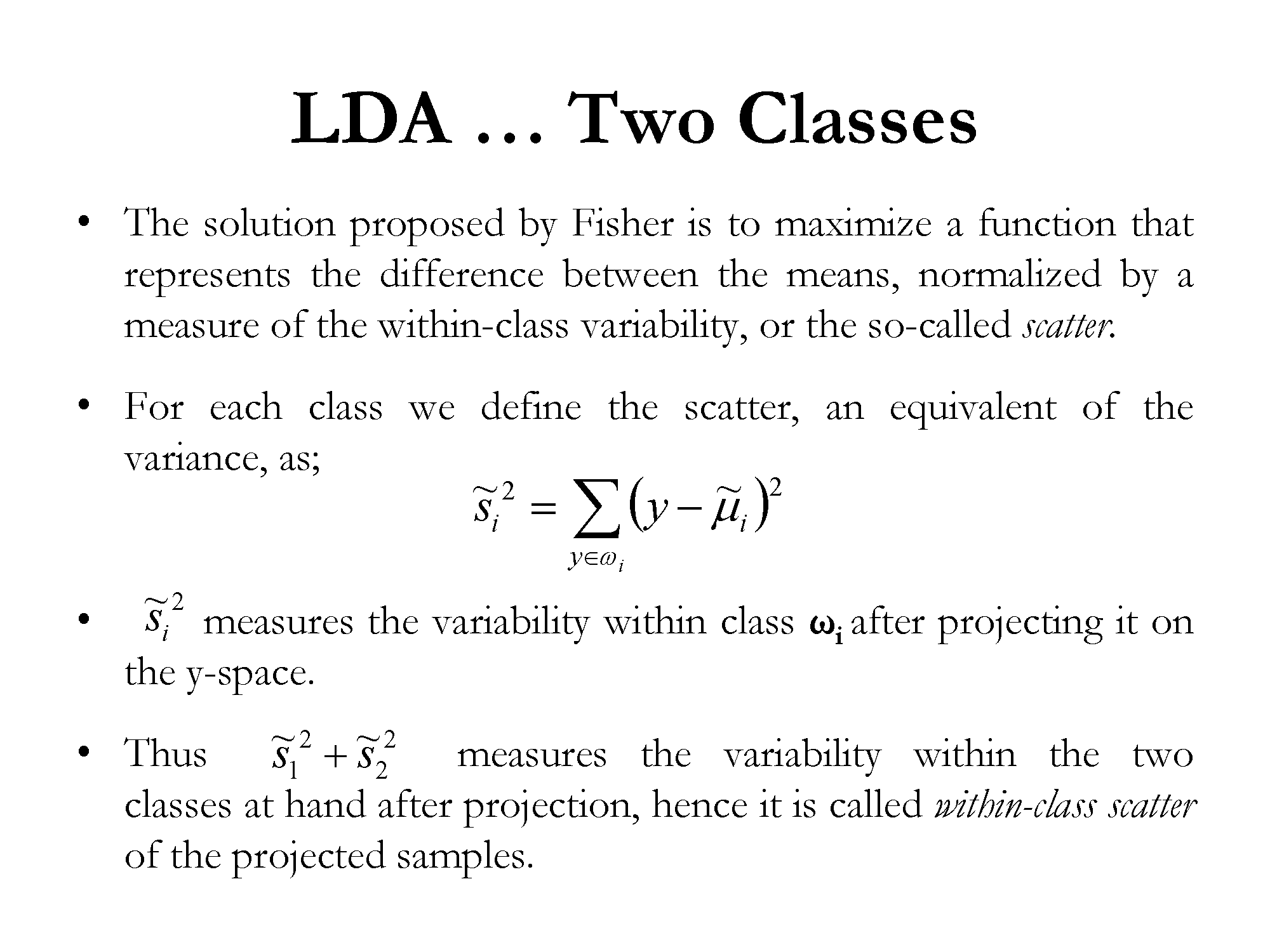

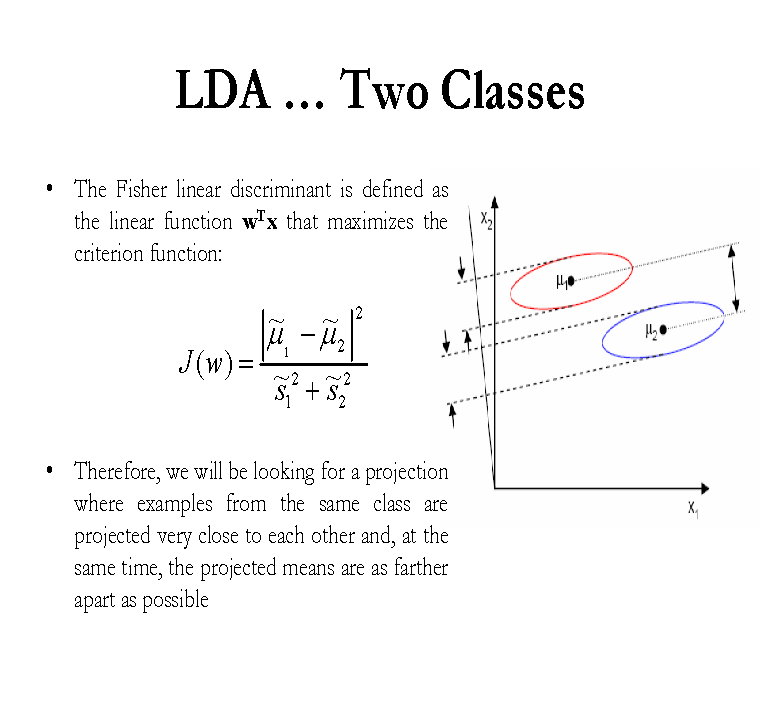

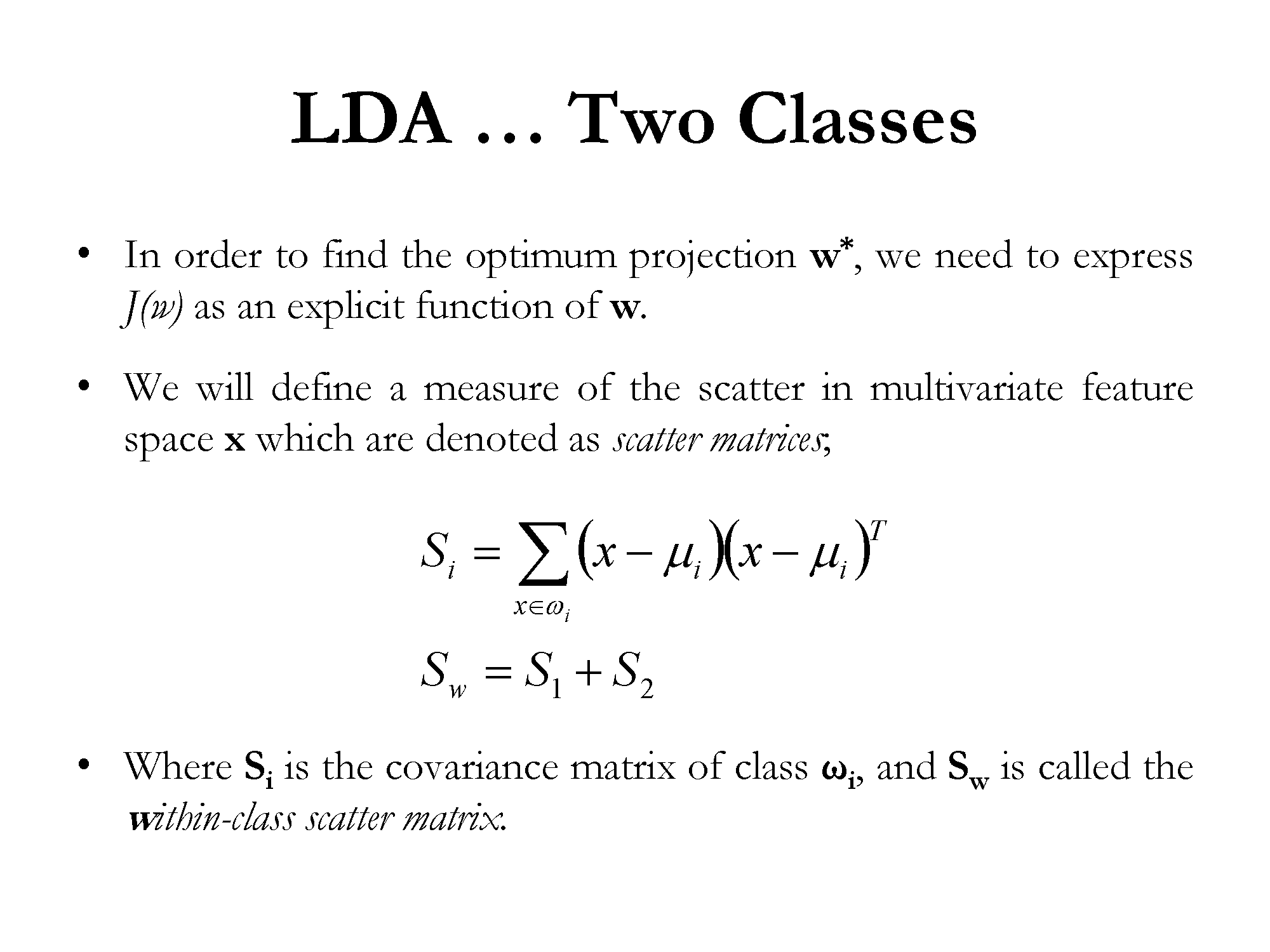

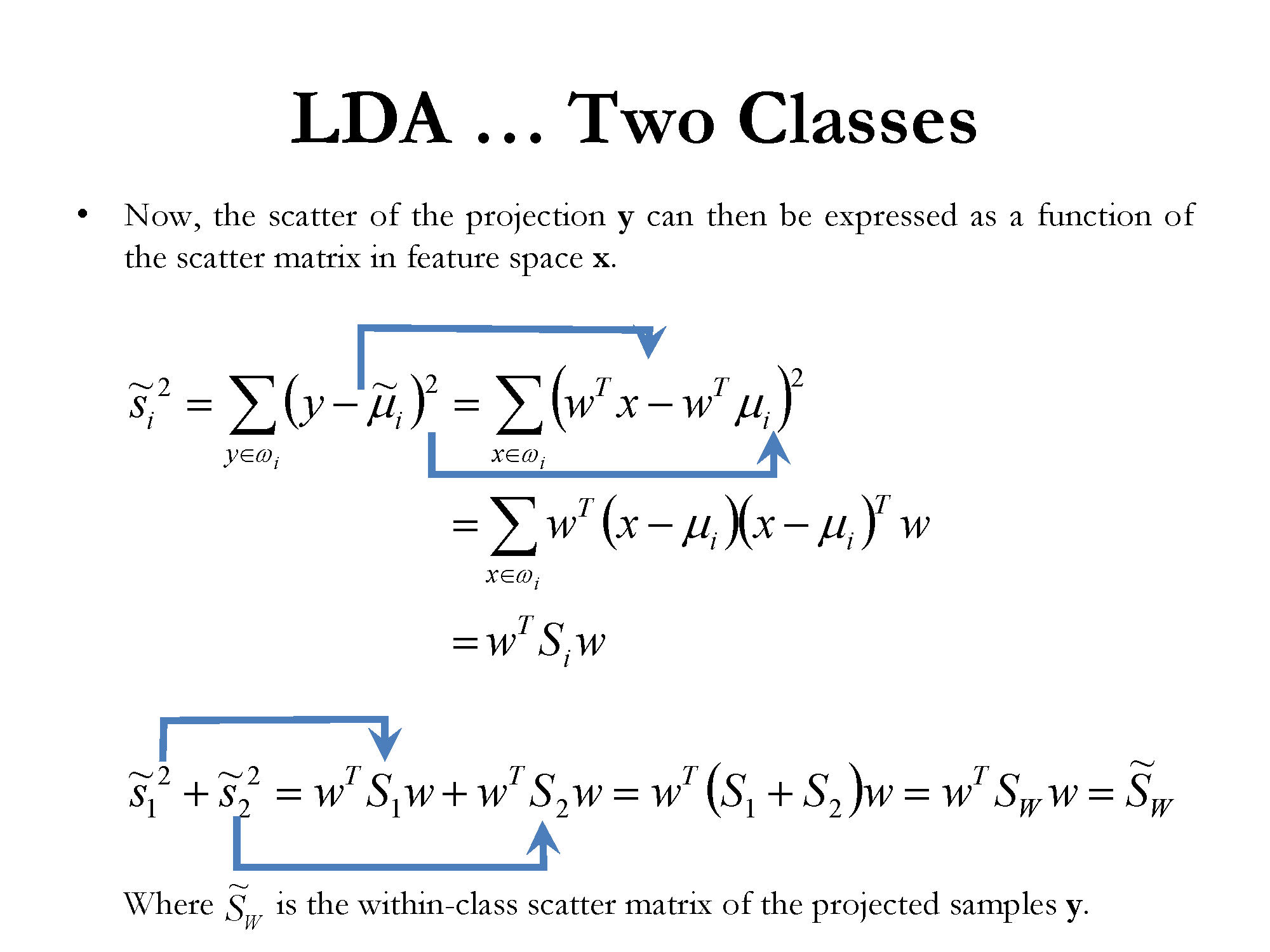

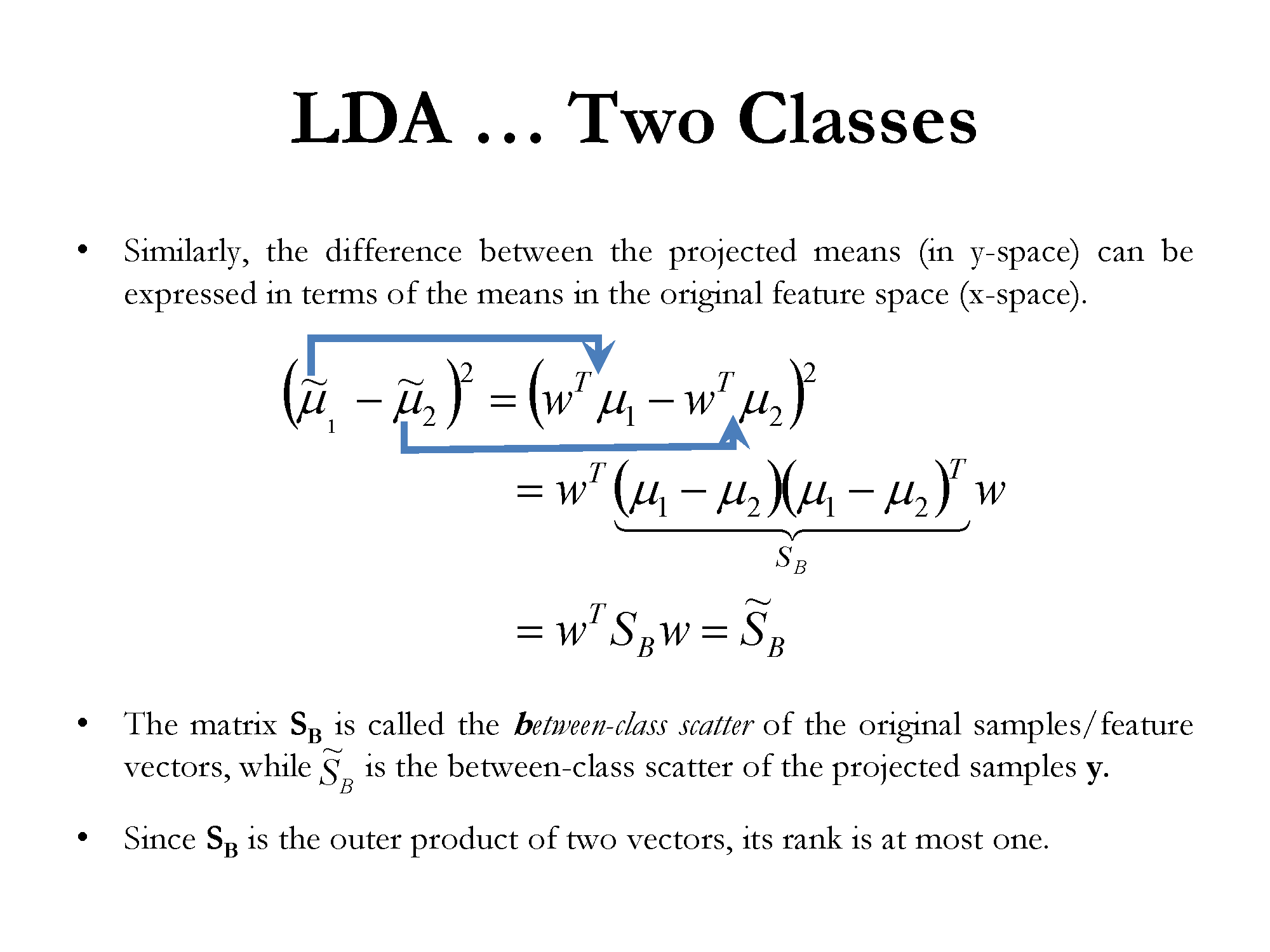

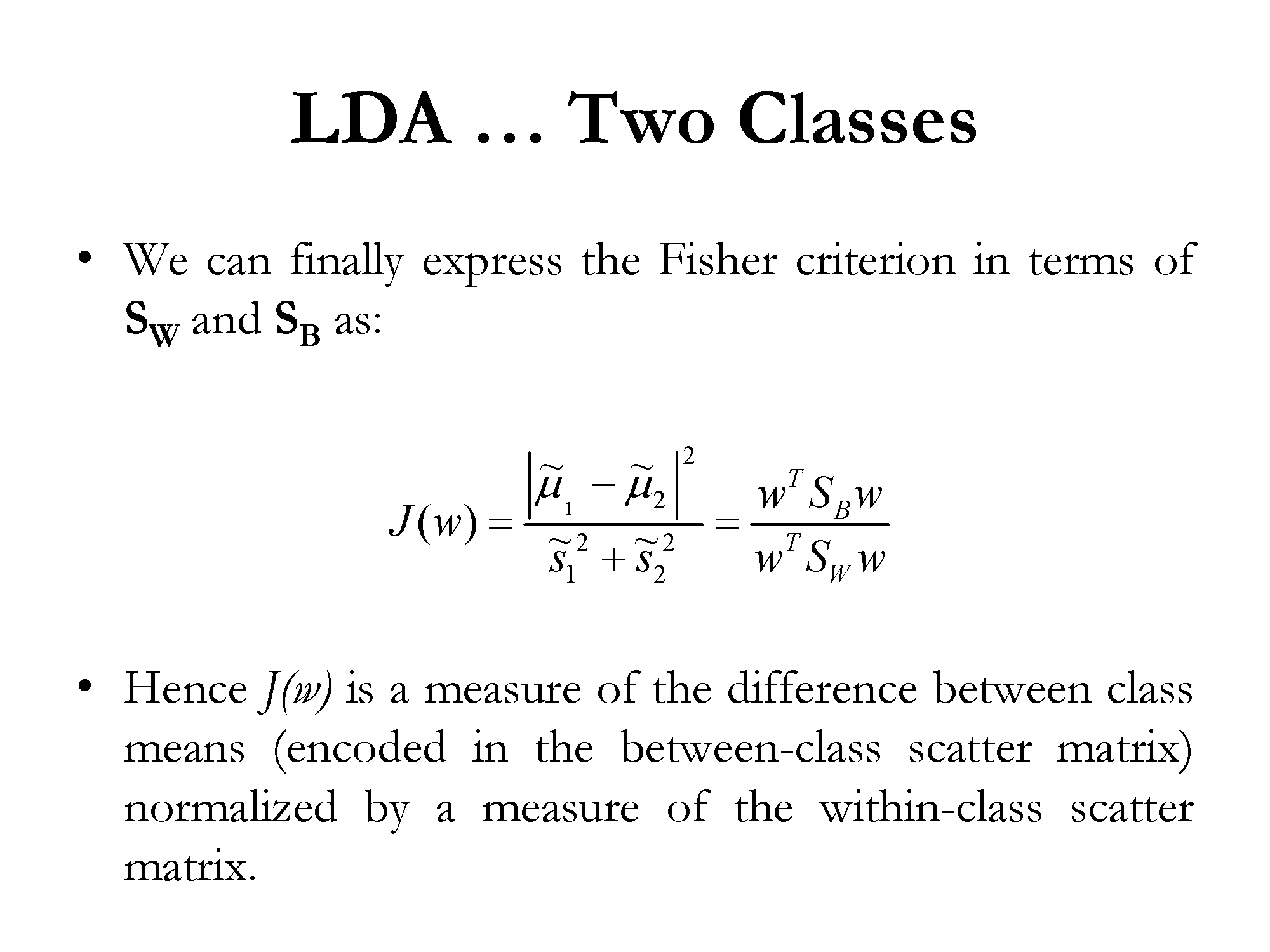

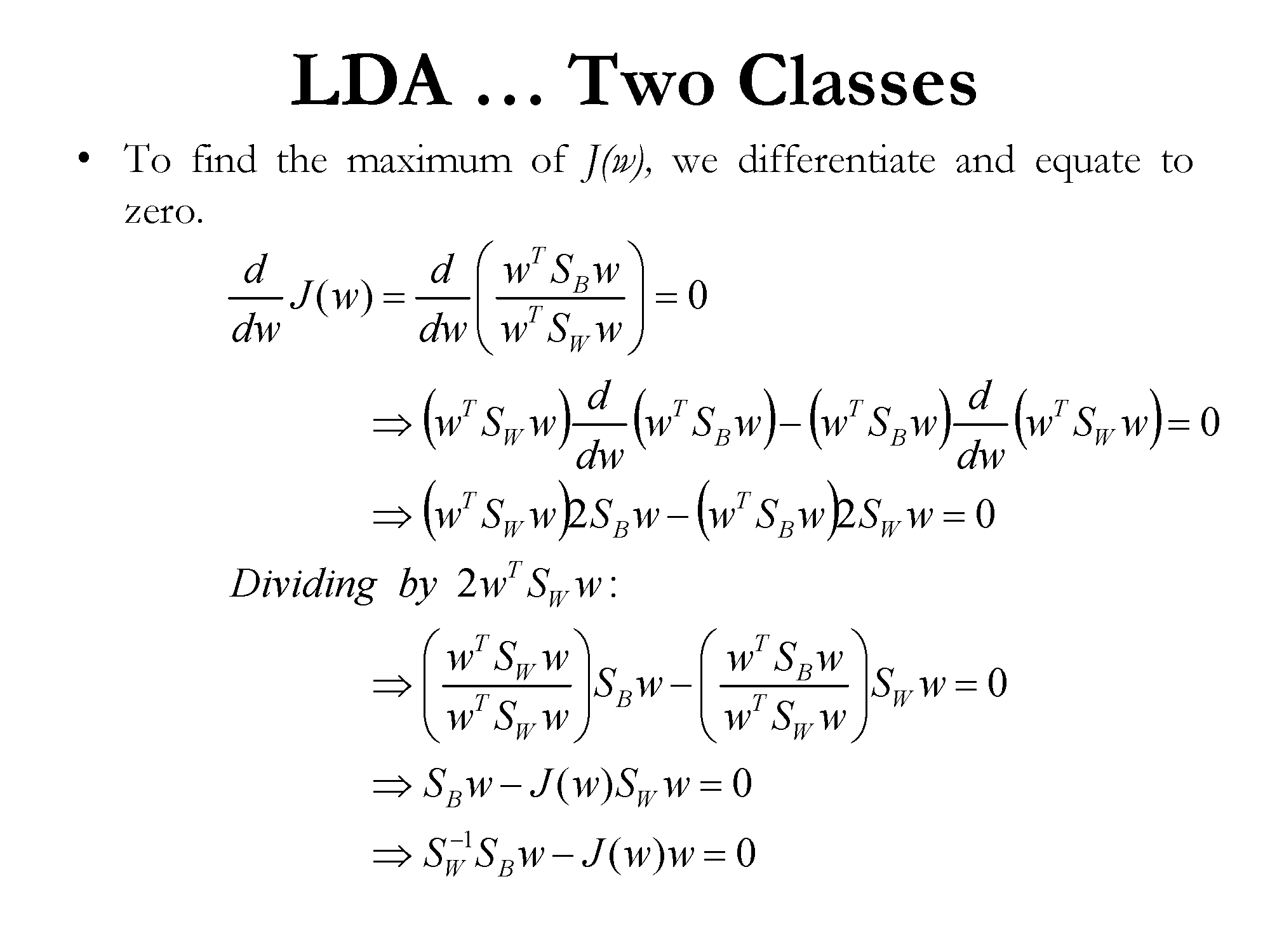

二、LDA理论详解

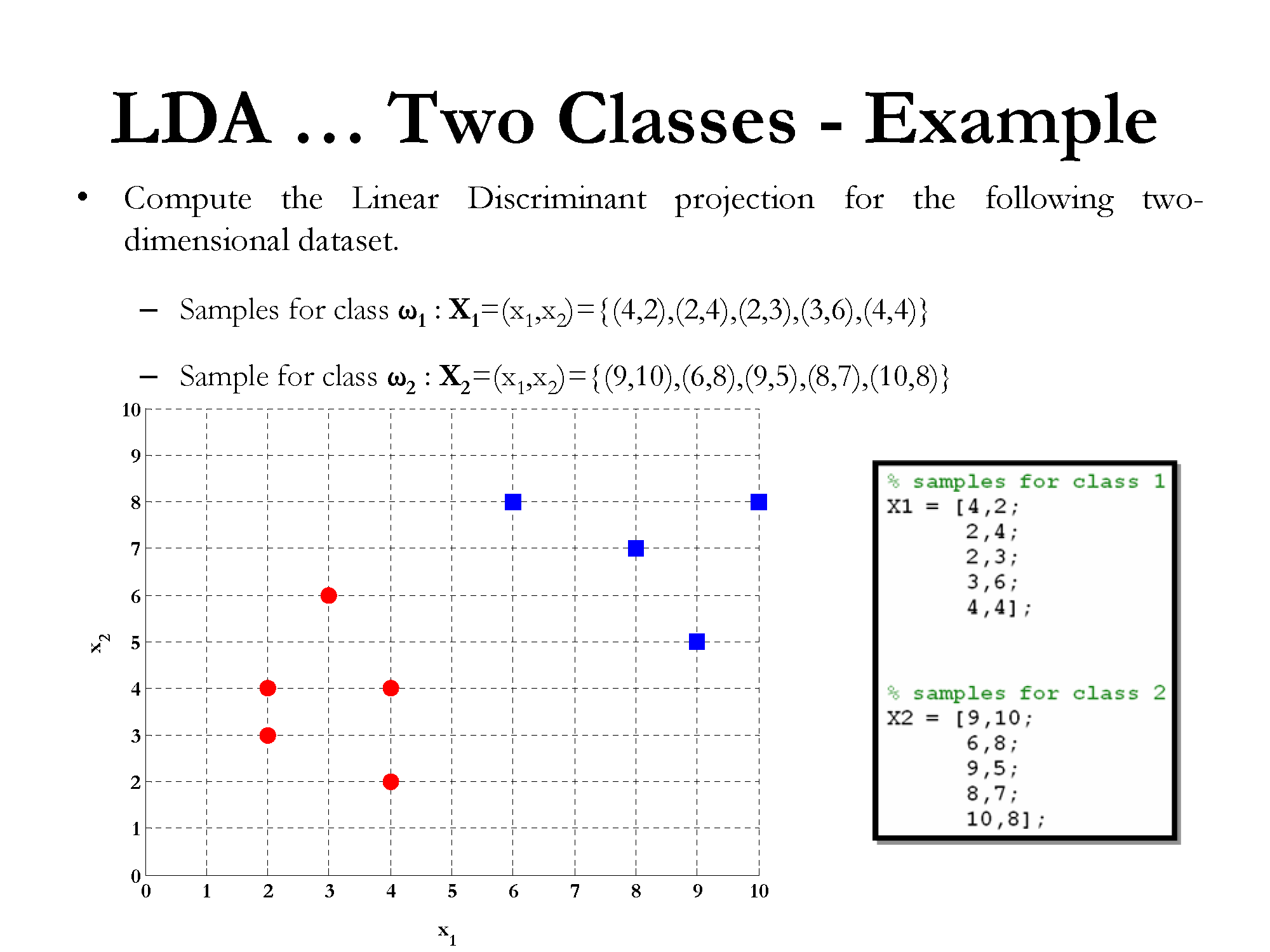

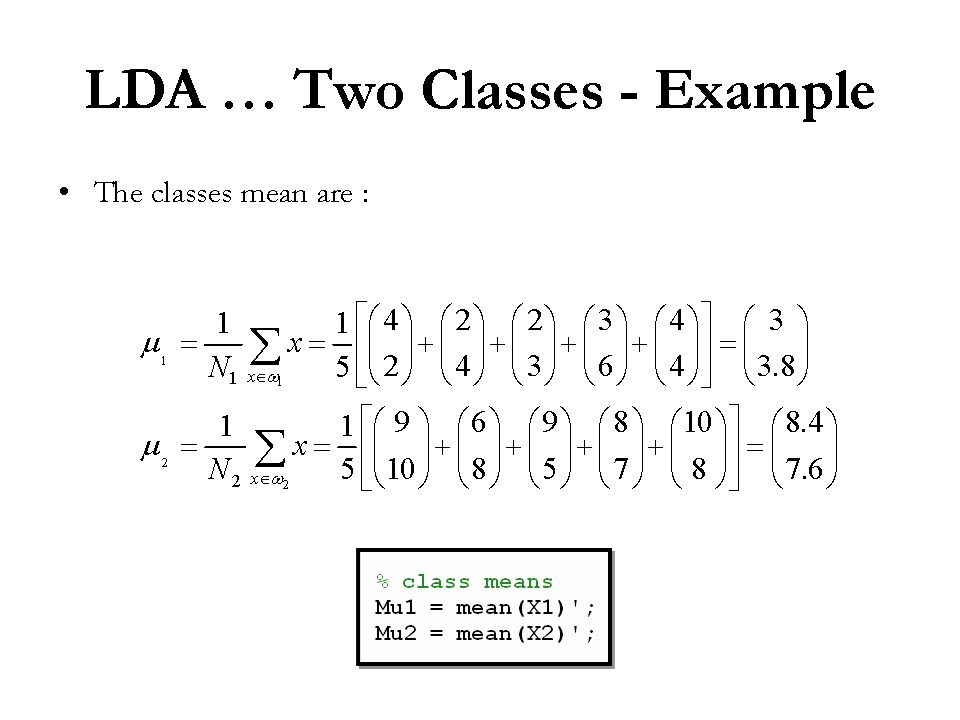

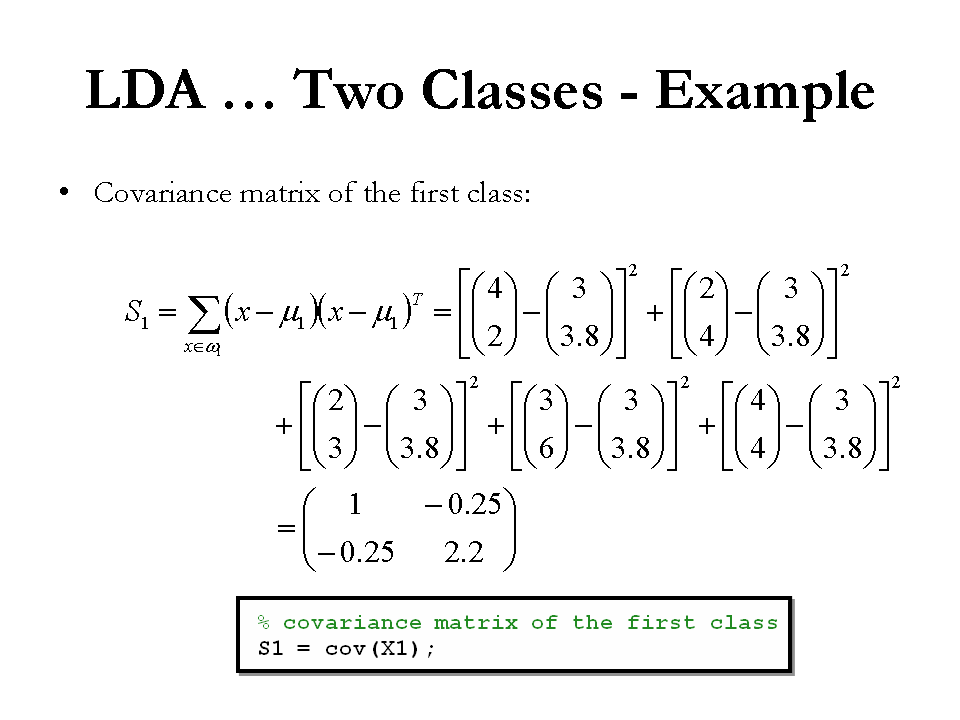

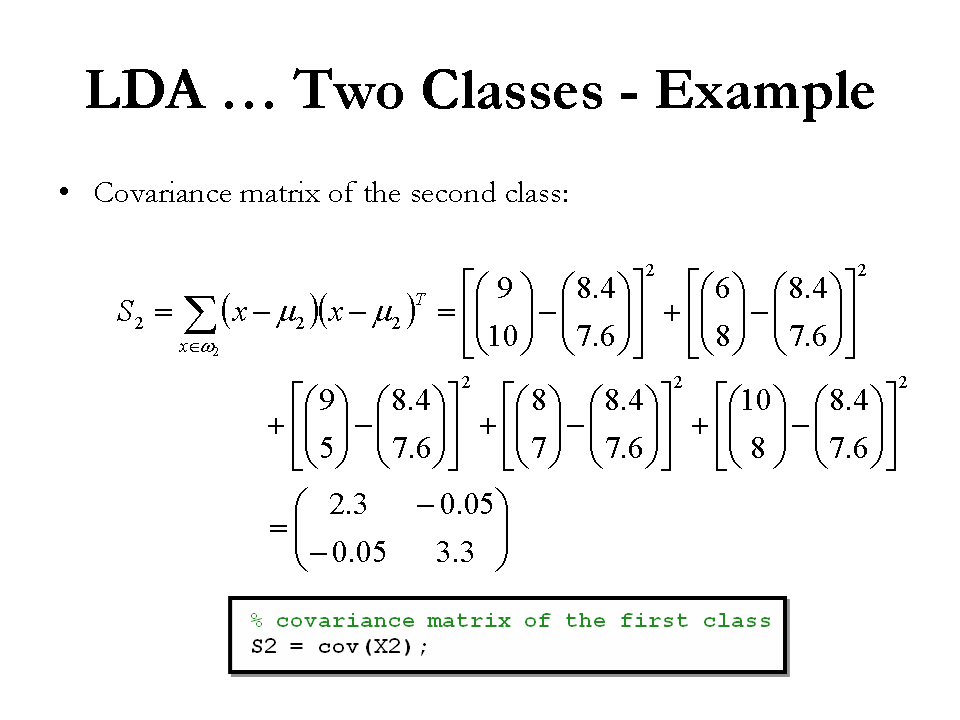

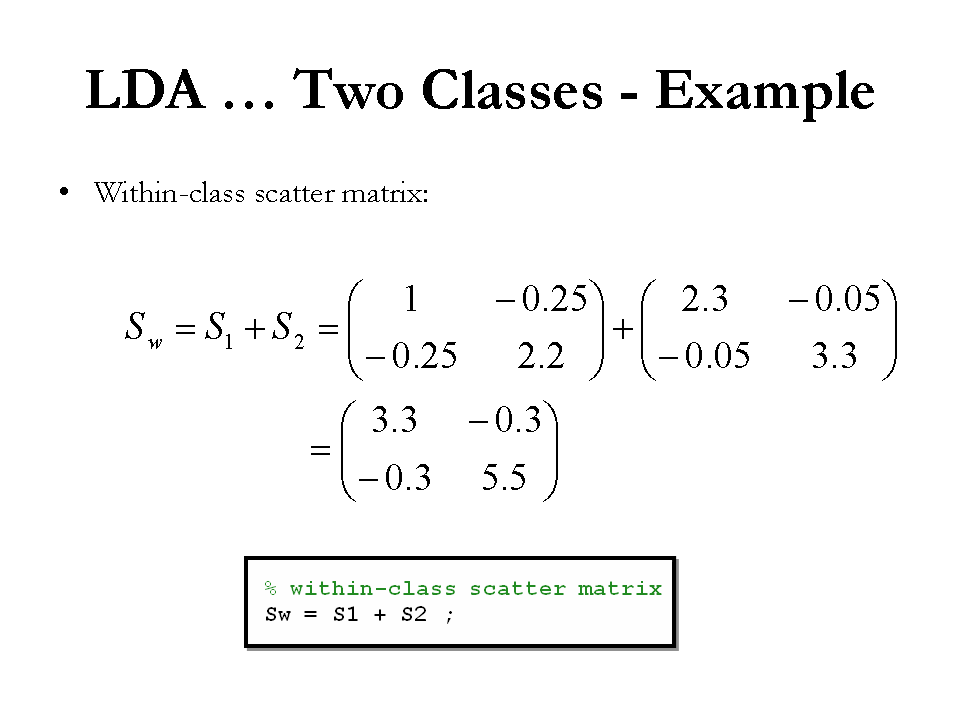

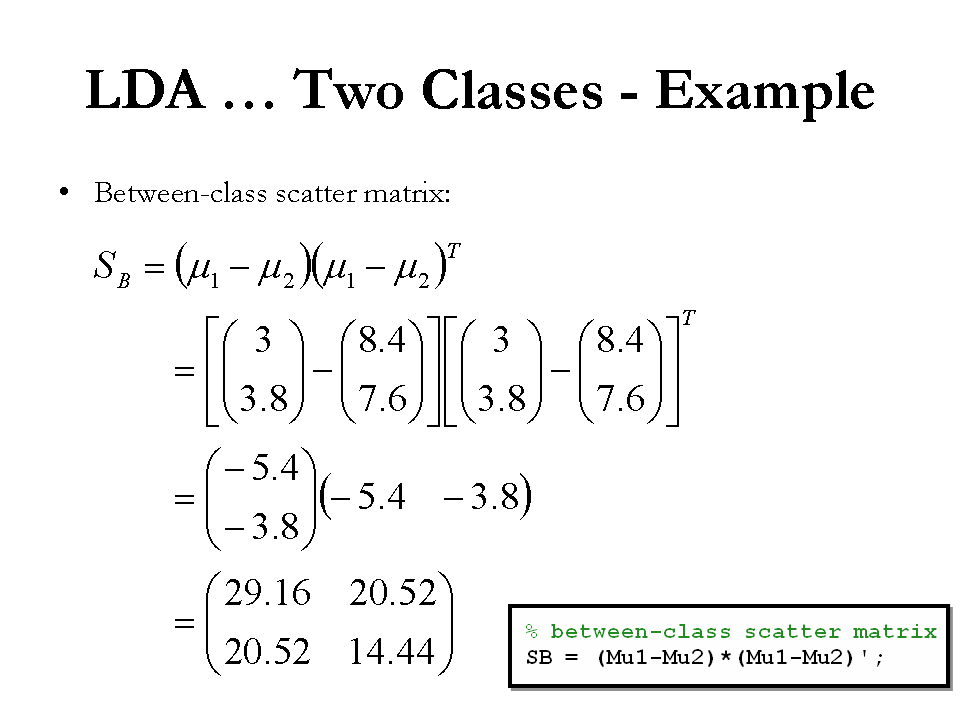

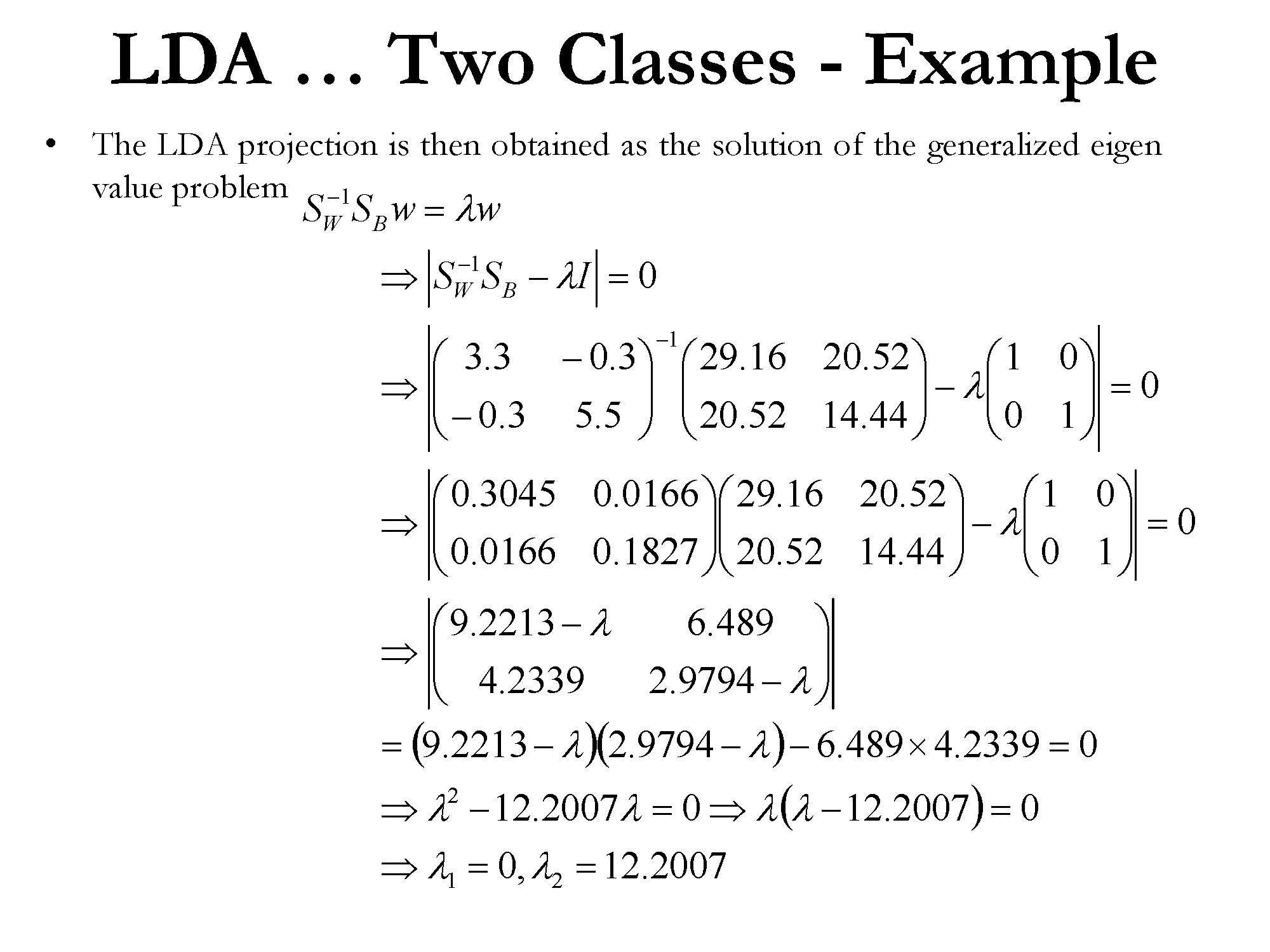

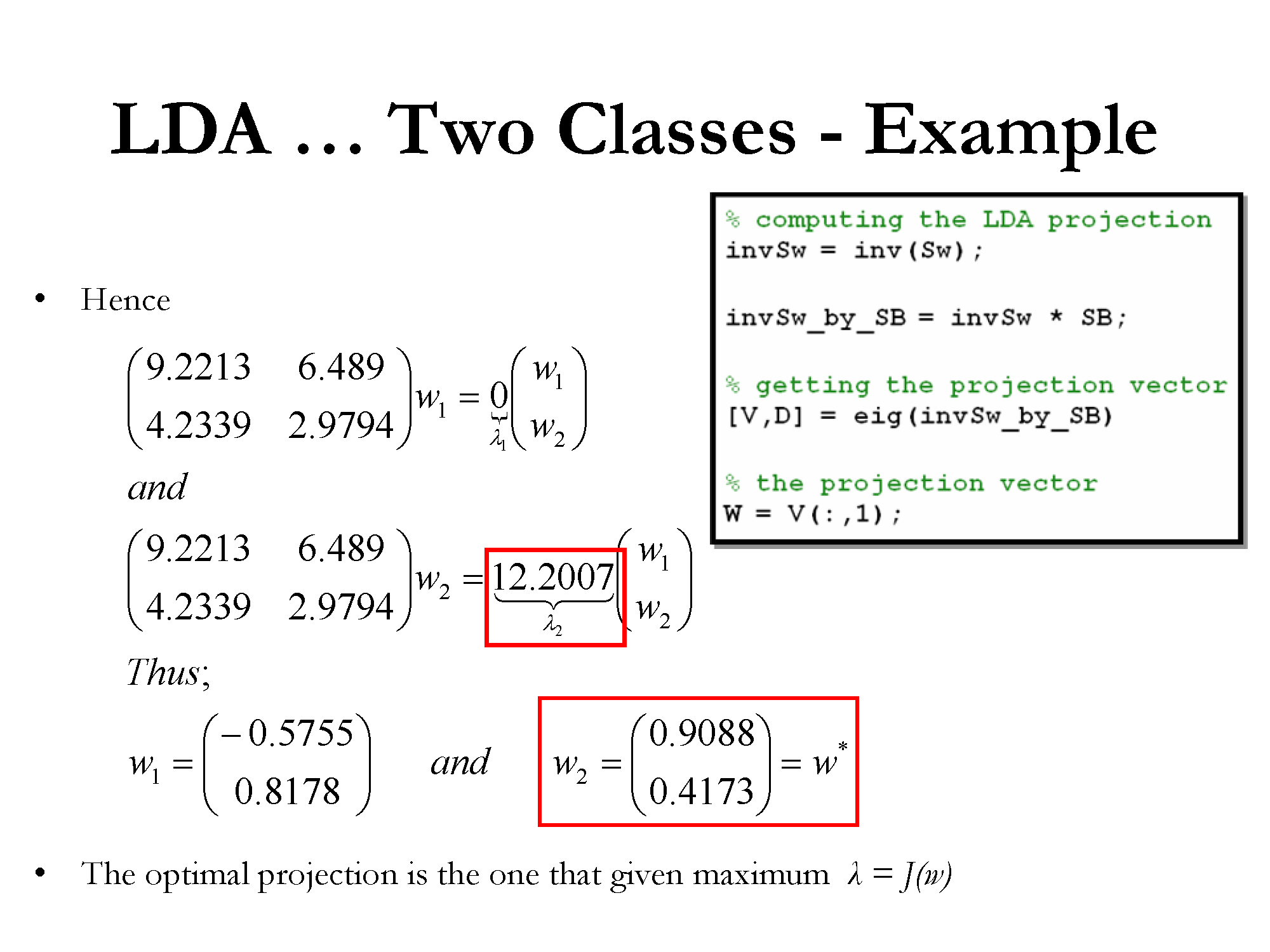

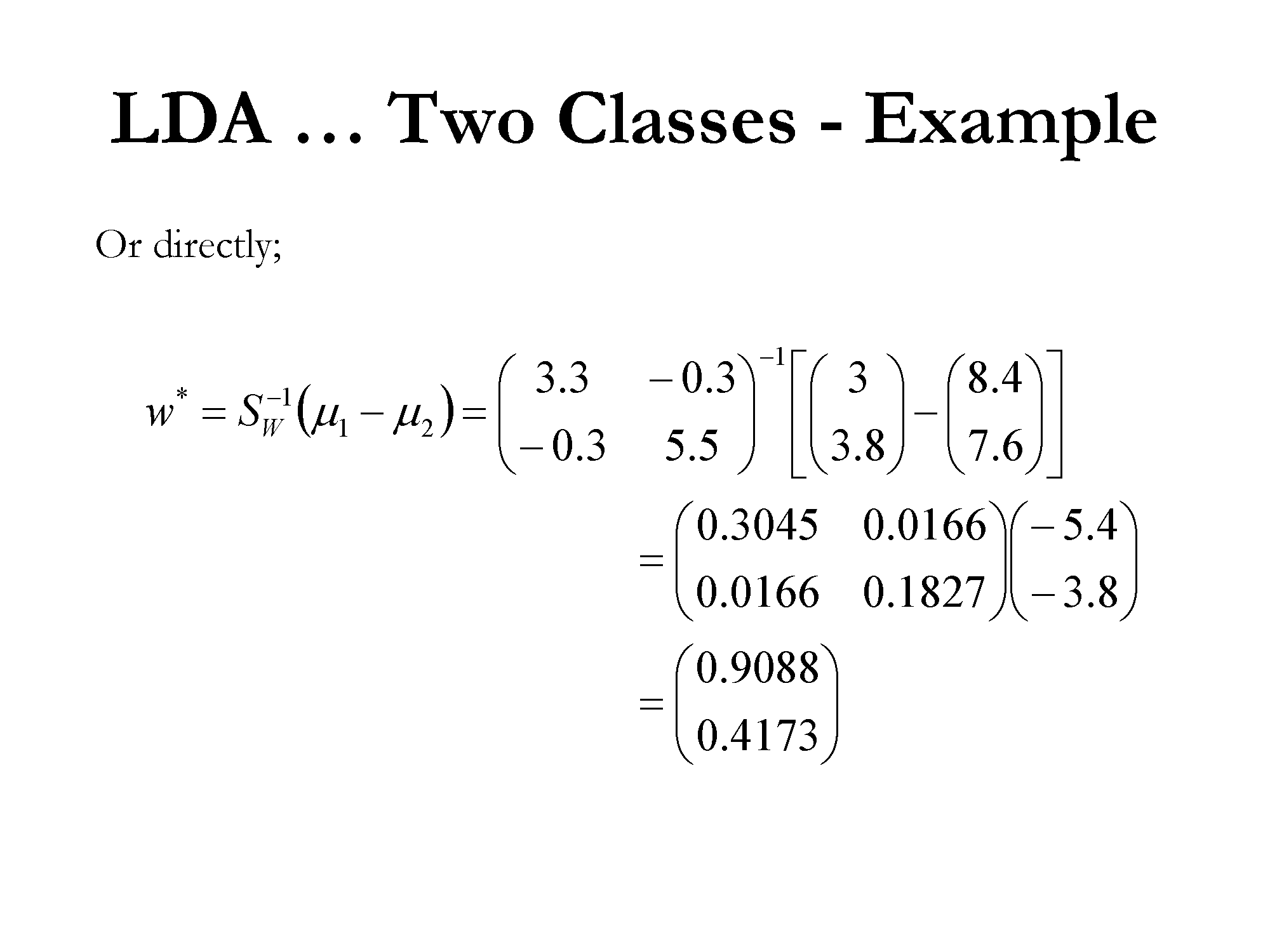

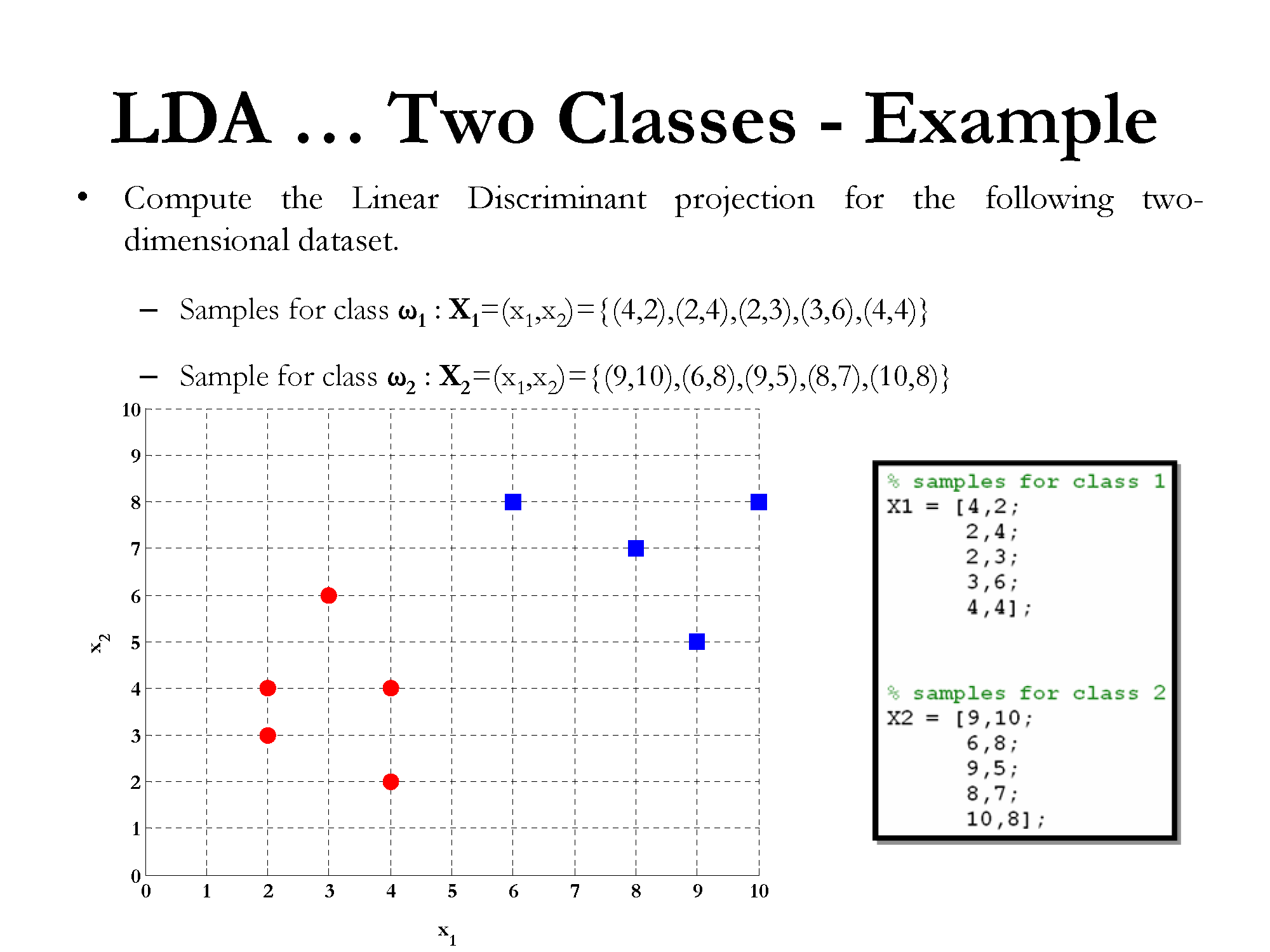

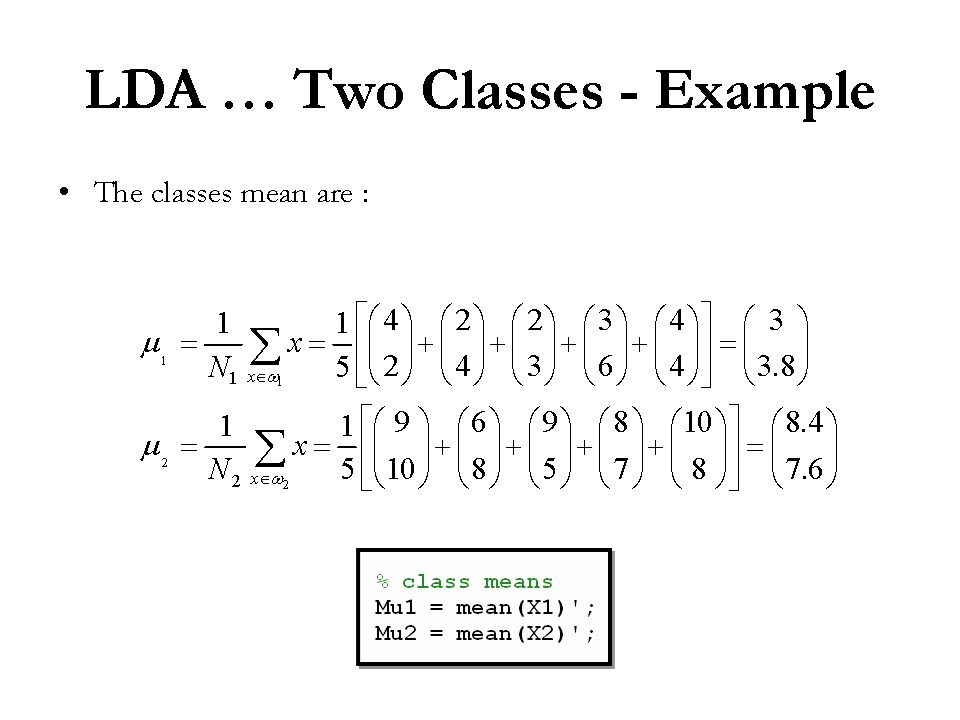

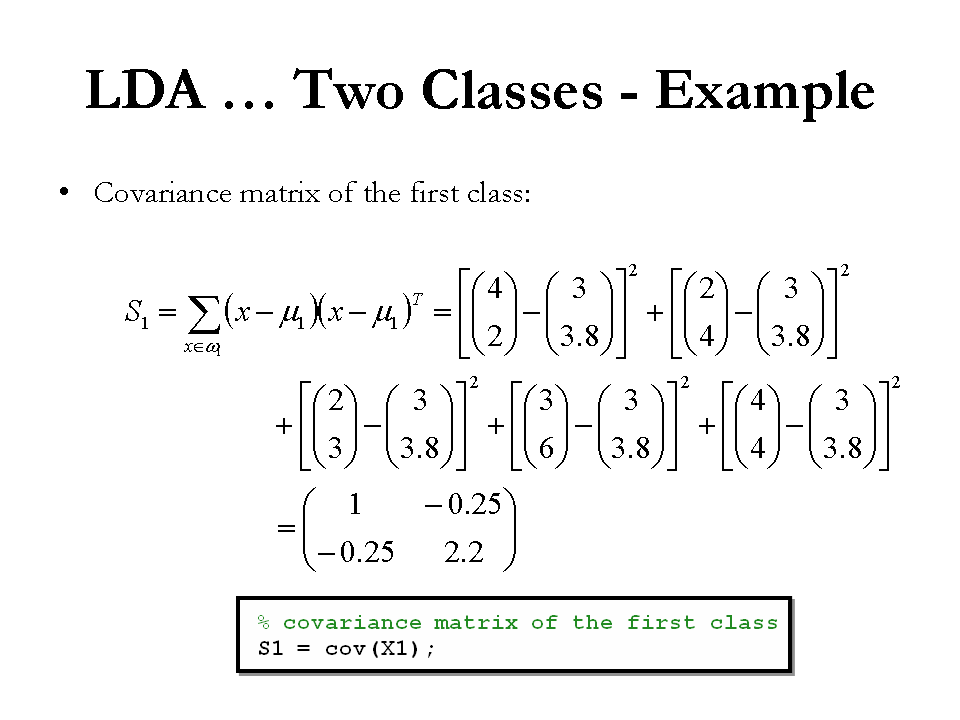

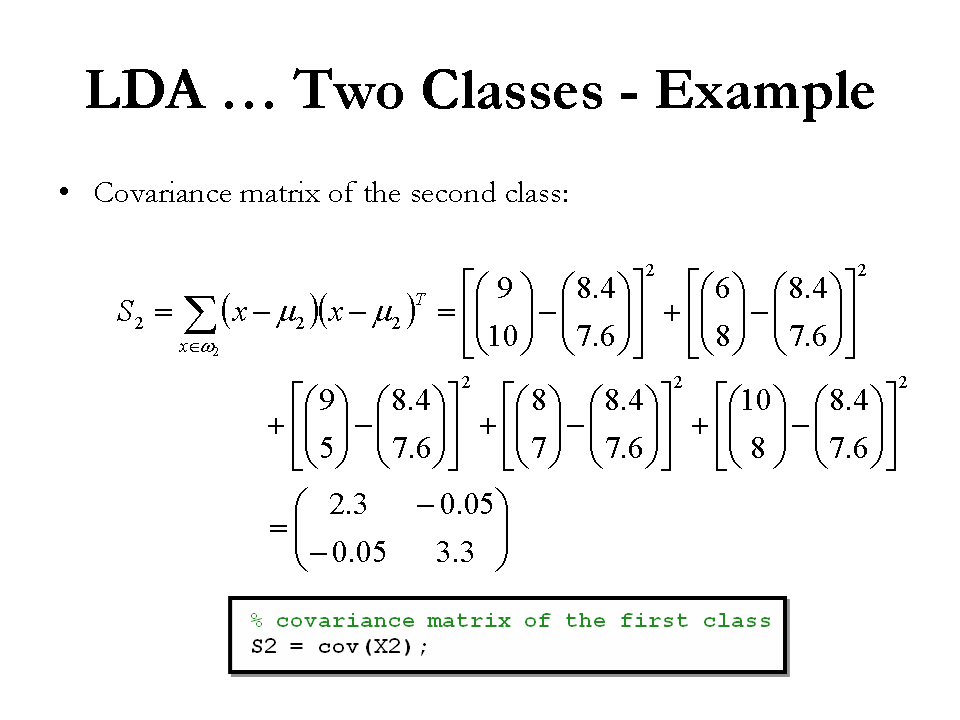

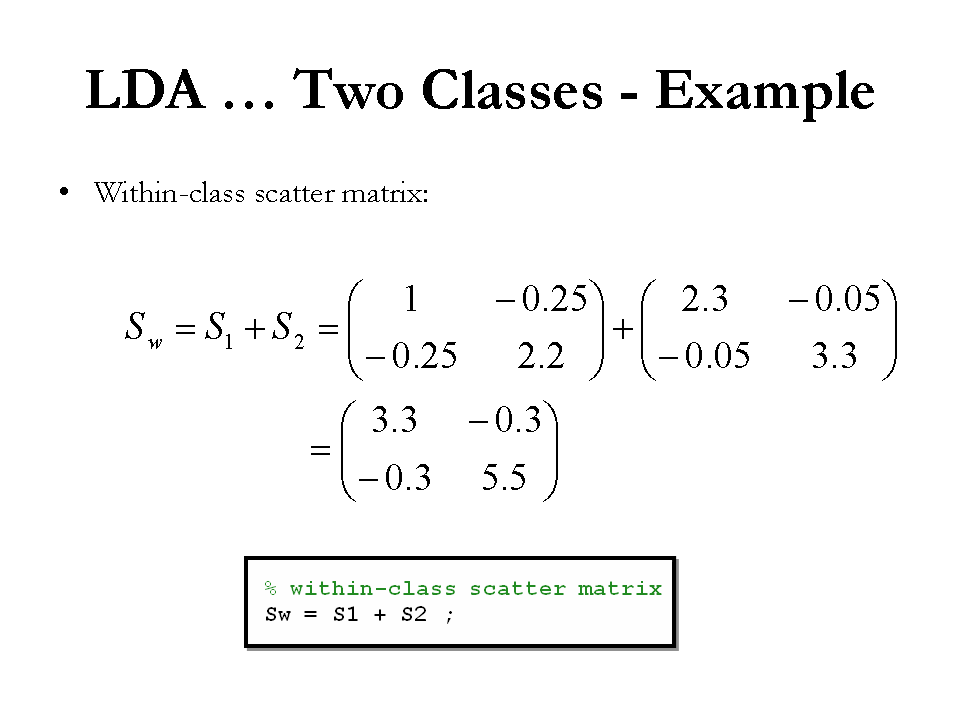

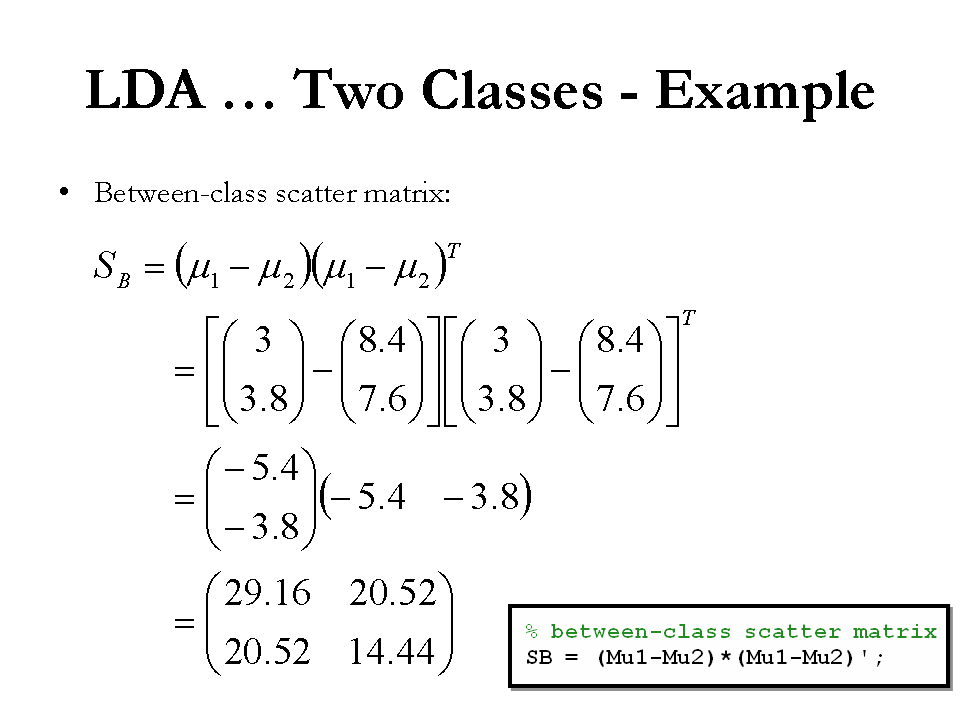

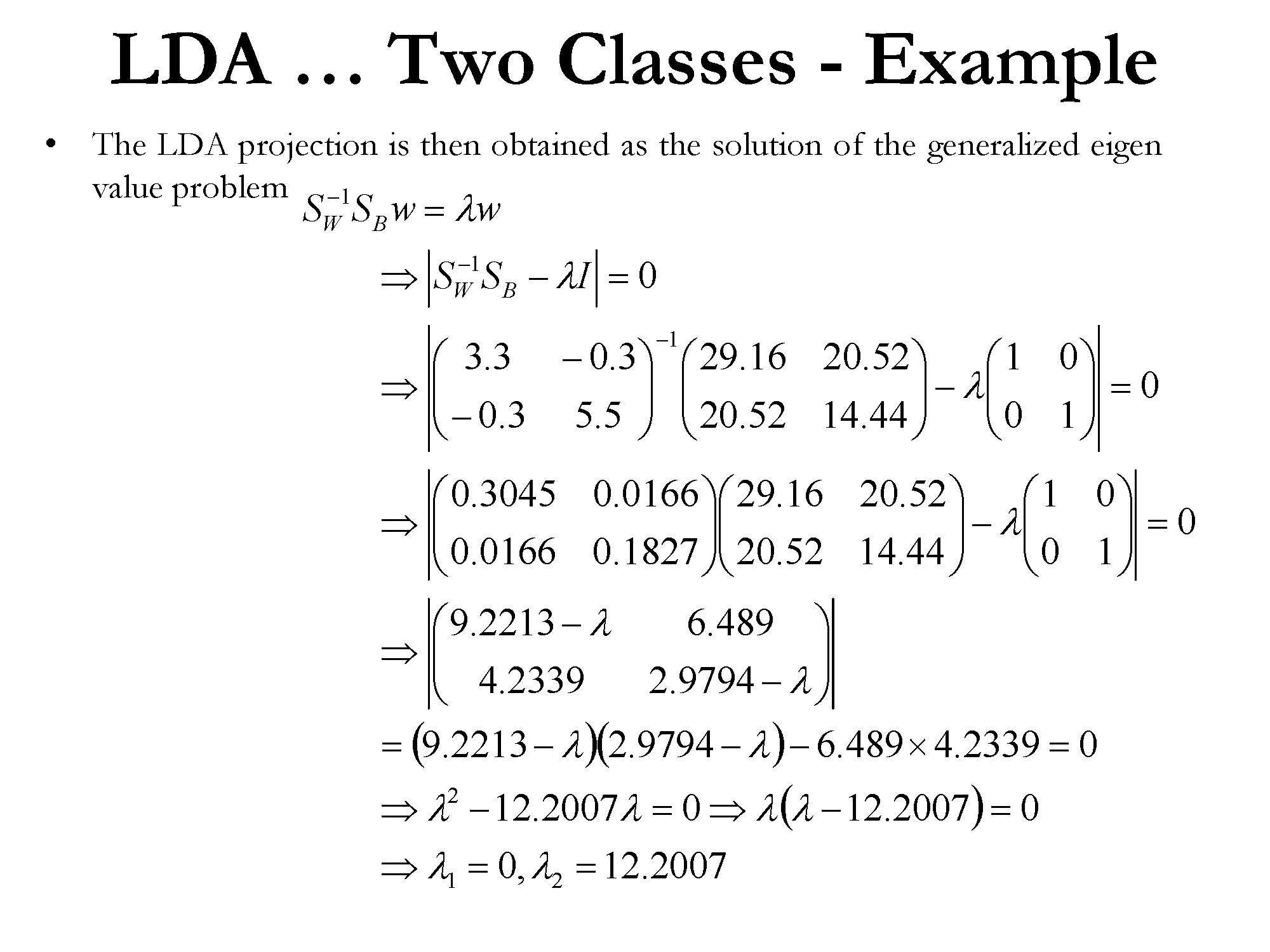

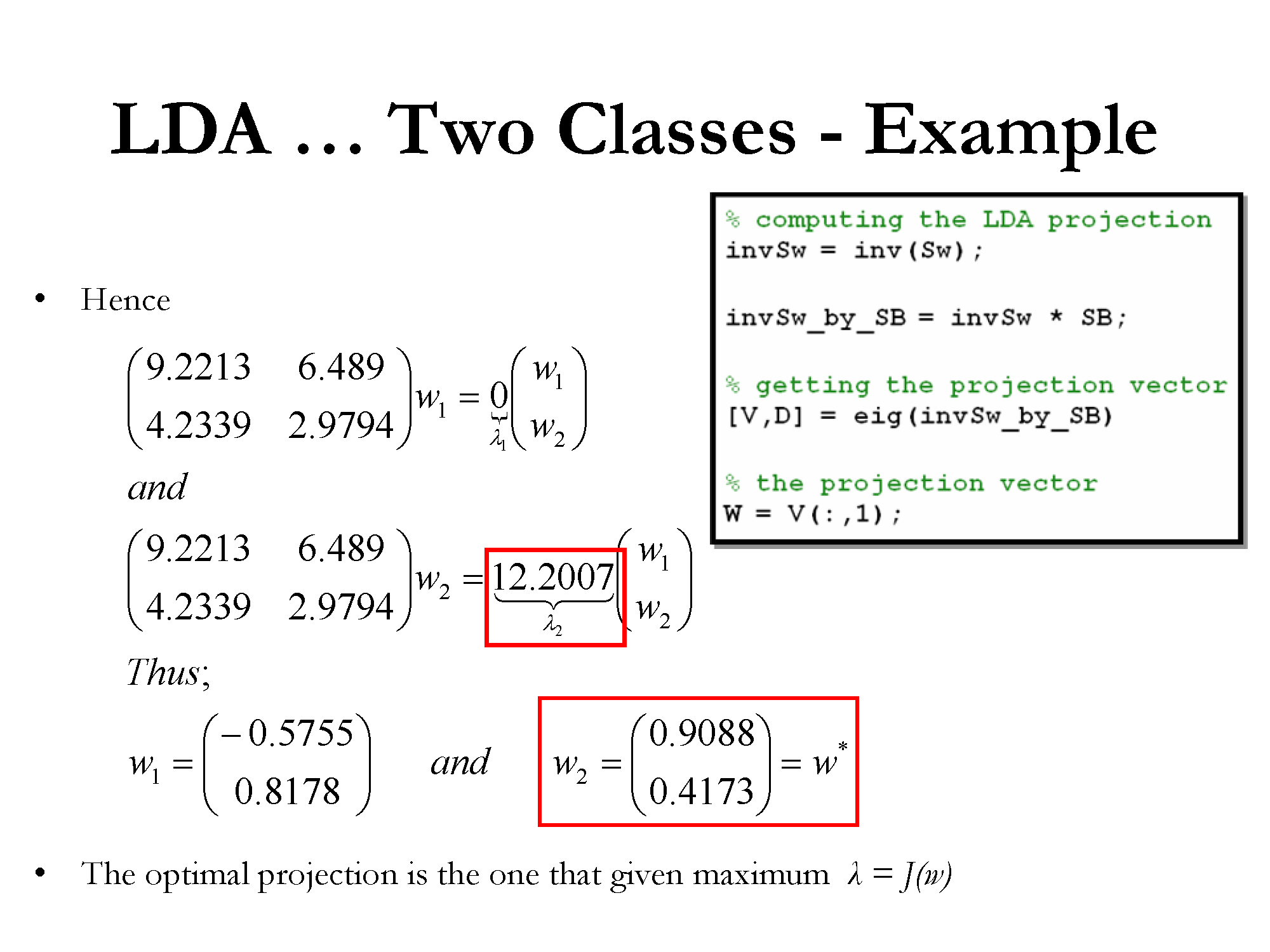

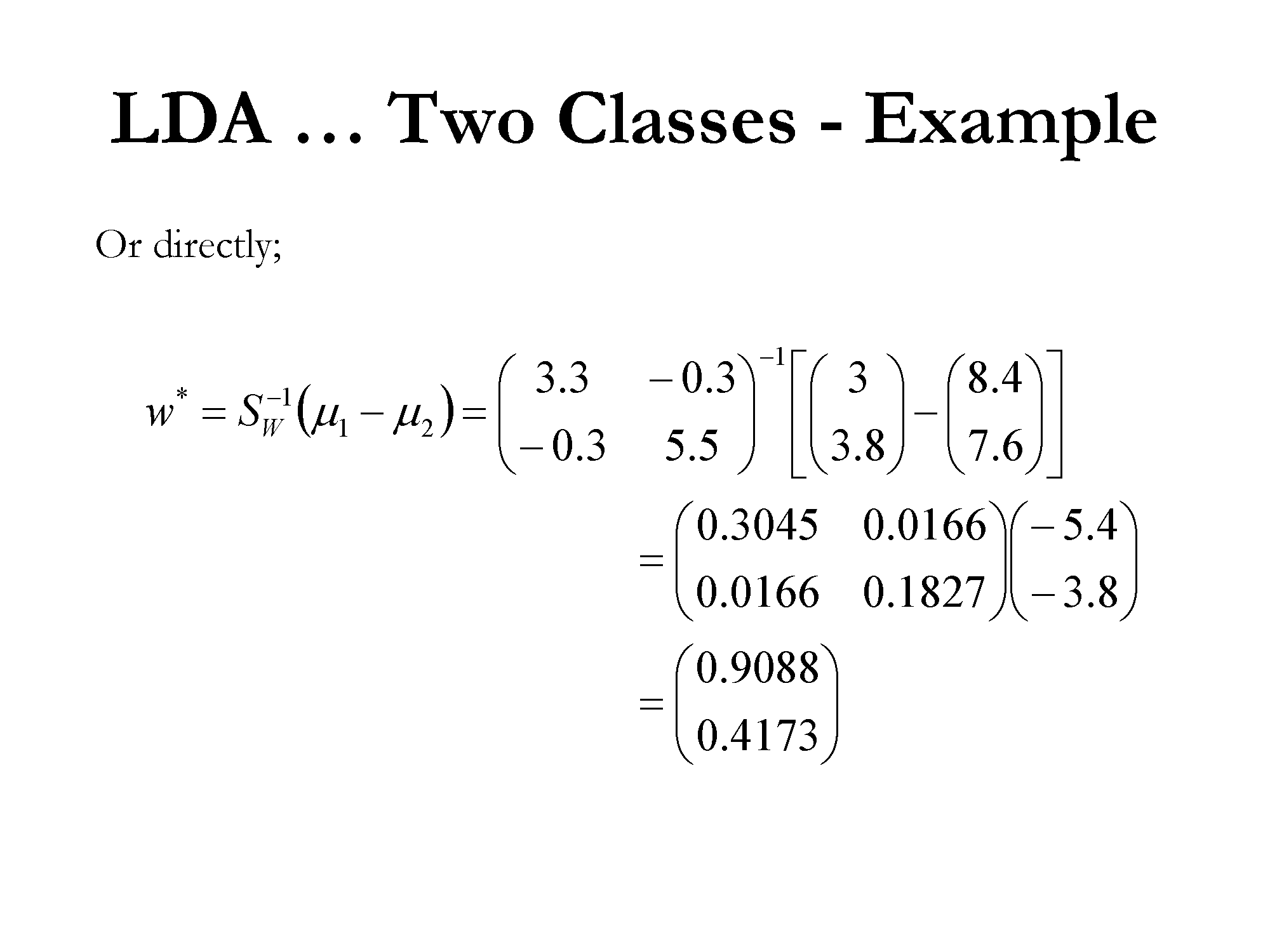

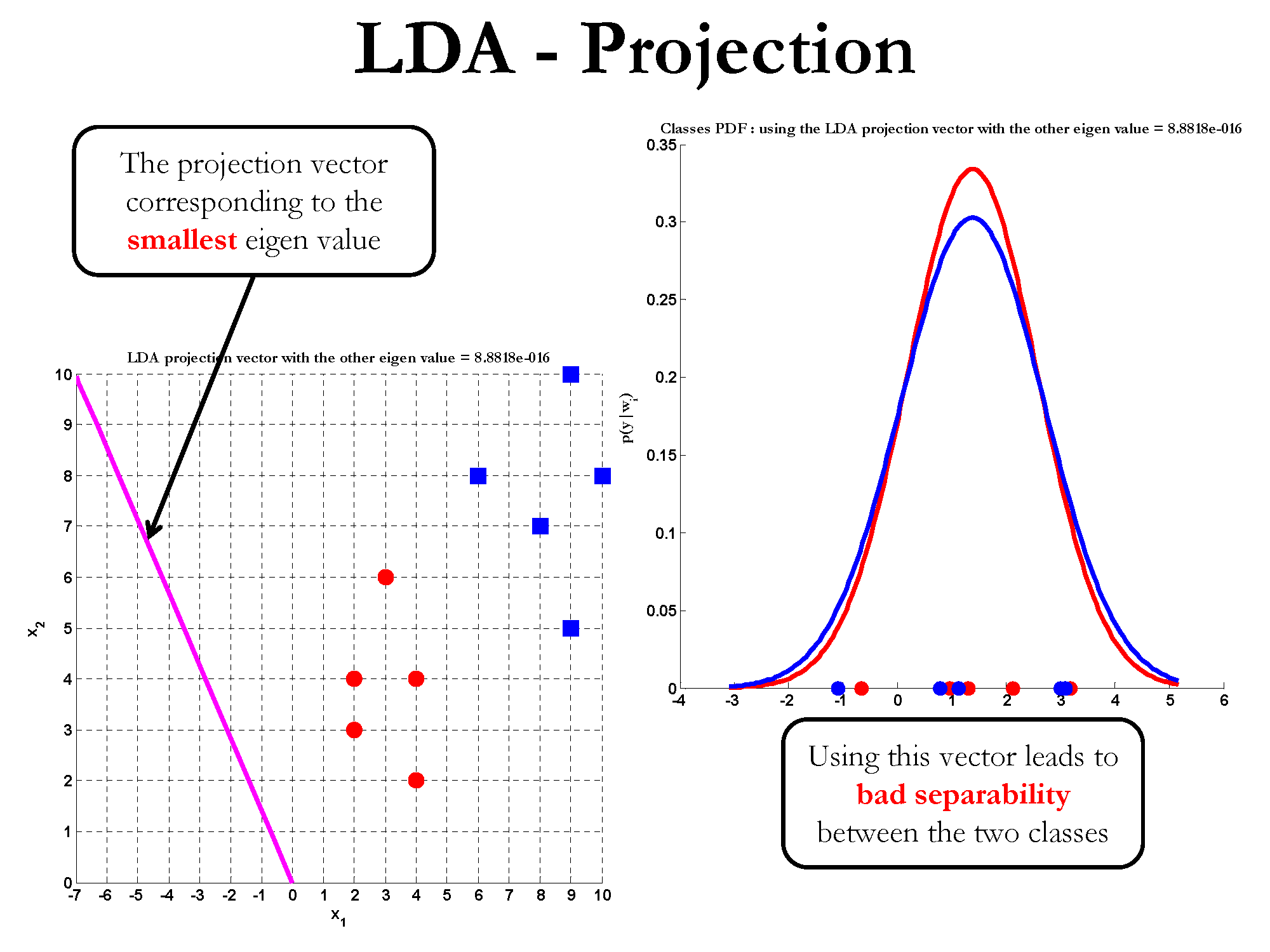

三、LDA实例详解

下面是作者文档中配的一个具体例子,其中的代码是MATLAB代码。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?