R-CNN是一个系列教程,而Faster R-CNN更是有了质的突破,我们看一下,这之间的区别。

从RCNN到fast RCNN,再到本文的faster RCNN,目标检测的四个基本步骤(候选区域生成,特征提取,分类,位置精修)终于被统一到一个深度网络框架之内。所有计算没有重复,完全在GPU中完成,大大提高了运行速度。

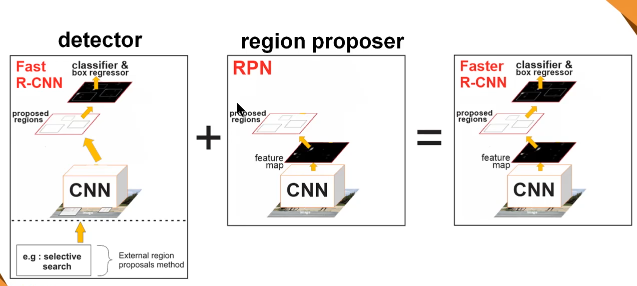

faster RCNN可以简单地看做“区域生成网络+fast RCNN“的系统,用区域生成网络代替fast RCNN中的Selective Search方法。

下面我们来看整个faster R-CNN的体系,区域网络生成中的特征提取网络,即下面的CNN提取得到feature map,

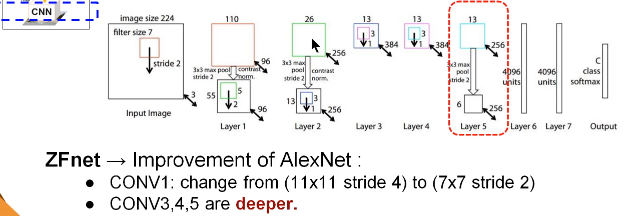

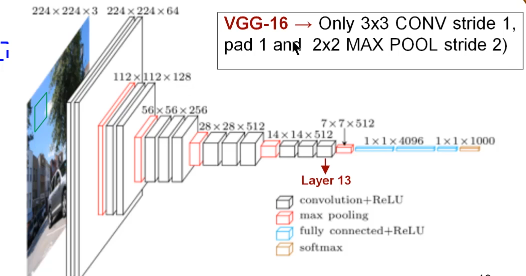

这里文章使用了两种特征提取的网络,其中网络结构可以通过如下的图片展示:

ZF网络结构,详细的介绍可以从图中看到,前面一共5层,红框之前。

这是VGG16的网络详细图,其中一共含有13层的网络,用来共享。

然后就是进行RPN,RPN的过程如下图:

为了生成区域建议框,我们在最后一个共享的卷积层输出的卷积特征映射上滑动小网络,这个网络全连接到输入卷积特征映射的nxn的空间窗口上。每个滑动窗口映射到一个低维向量上(对于ZF是256-d,对于VGG是512-d,每个特征映射的一个滑动窗口对应一个数值)。这个向量输出给两个同级的全连接的层——包围盒回归层(reg)和包围盒分类层(cls)。本文中n=3,注意图像的有效感受野很大(ZF是171像素,VGG是228像素)。图1(左)以这个小网络在某个位置的情况举了个例子。注意,由于小网络是滑动窗口的形式,所以全连接的层(nxn的)被所有空间位置共享(指所有位置用来计算内积的nxn的层参数相同)。这种结构实现为nxn的卷积层,后接两个同级的1x1的卷积层(分别对应reg和cls),ReLU[15]应用于nxn卷积层的输出。

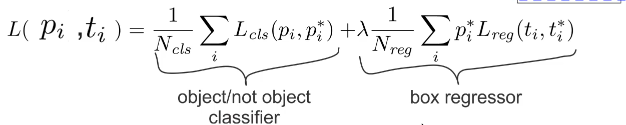

损失函数的计算:

代价函数分为两部分,对应着RPN两条支路,即目标与否的分类误差和bbox的回归误差,其中Leg(ti,ti*) = R(ti-ti*)采用在Fast-RCNN中提出的平滑L1函数,作者认为其比L2形式的误差更容易调节学习率。注意到回归误差中Leg与pi相乘,因此bbox回归只对包含目标的anchor计算误差。也就是说,如果anchor不包含目标,box输出位置无所谓。所以对于bbox的groundtruth,只考虑判定为有目标的anchor,并将其标注的坐标作为ground truth。此外,计算bbox误差时,不是比较四个角的坐标,而是tx,ty,tw,th,具体计算如下:

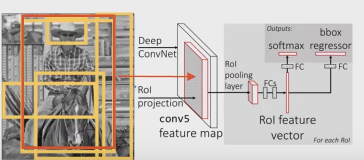

Fast RCNN进行分类和检测器

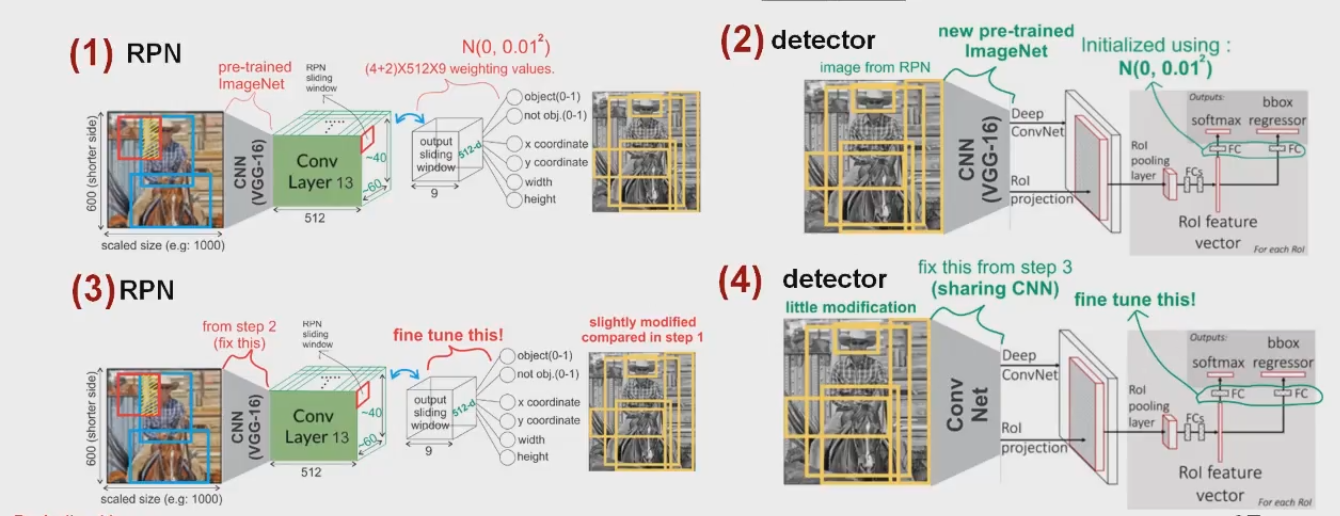

训练Faster RCNN,下面的图片真是太经典了,能能够很好的说明faster rcnn的训练过程:

其中一些参数的初始化,和固定一些参数,作为另外参数的fine turn的条件,图中包含所有过程的详细过程。仔细阅读此图就可以了。

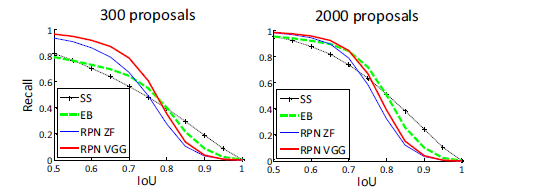

剩下的就是实验结果,与Selective Search方法(黑)相比,当每张图生成的候选区域从2000减少到300时,本文RPN方法(红蓝)的召回率下降不大。说明RPN方法的目的性更明确。

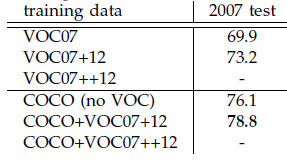

使用更大的Microsoft COCO库[7]训练,直接在PASCAL VOC上测试,准确率提升6%。说明faster RCNN迁移性良好,没有over fitting。

643

643

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?