本教程将介绍如何在Stable Diffusion中使用控制网络(controlNet)的IP-Adapter功能。通过详细的步骤和创意提示,学习如何运用这个功能,实现对AI绘图中的特定部分进行精准修改和重绘,提升您的AI绘图技能。

1. 介绍

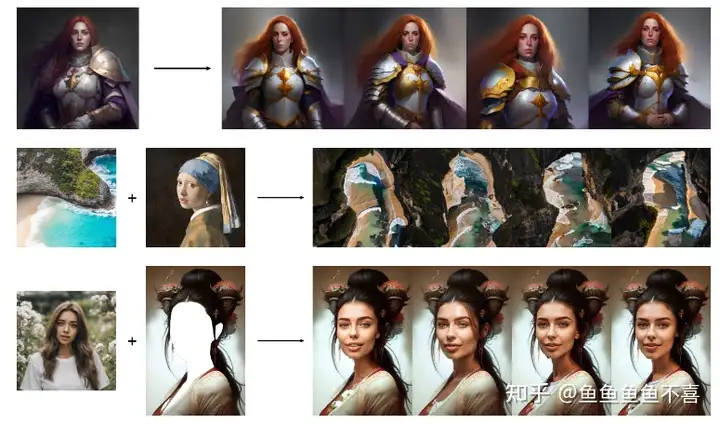

IP-Adapter是腾讯AI实验室发布的一个专门为预训练的文本到图像扩散模型(如Stable Diffusion)设计的适配器。其主要功能是通过图像提示来生成图像,能够复制参考图像的风格、构图或人物特征。

IP-Adapter的核心设计包括一个图像编码器和解耦的交叉注意力机制,这使得它能够将图像特征嵌入到预训练的文本到图像扩散模型中,从而实现图像提示的生成能力。此外,IP-Adapter还可以与其他控制器如ControlNet结合使用,以进一步增强其功能。

在实际应用中,用户可以通过Stable Diffusion的WebUI界面选择IP-Adapter,并上传参考图像来生成具有相似艺术风格和内容的作品。这种技术不仅可以用于风格迁移,还可以用于面部一致性处理等多种场景。

通俗的说IP-Adapter 就是垫图

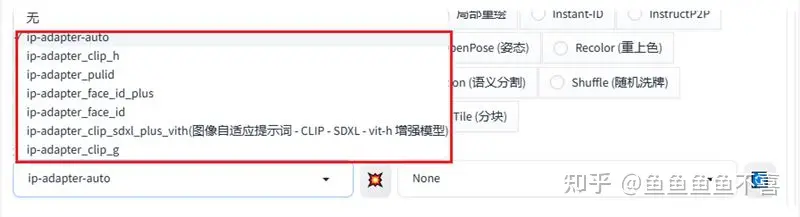

2. 预处理器

IP-Adapter 有非常多的预处理器,我们该如何选择呢

主要分两类:

1. 将人物面部特征作为提示词 face_id 类型

2. 将参考图整体看做提示的 clip 类型

一般选择 auto 或者ip-adapter_clip_sd15

如果你是 sdxl 大模型就选对应 ip-adapter_clip_sdxl 的预处理器就可以啦

而IP-Adapter的控制模型比较简单,可以选择:ip-adapter_sd15

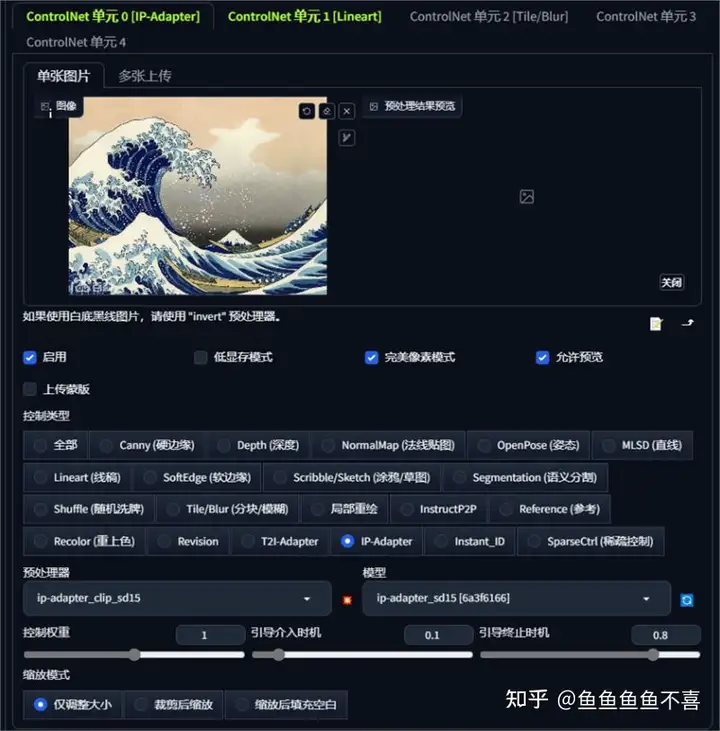

3. 使用方法

使用方法非常简单,大模型可以选择 awpainting 或者其他与你参考图画风类似的大模型

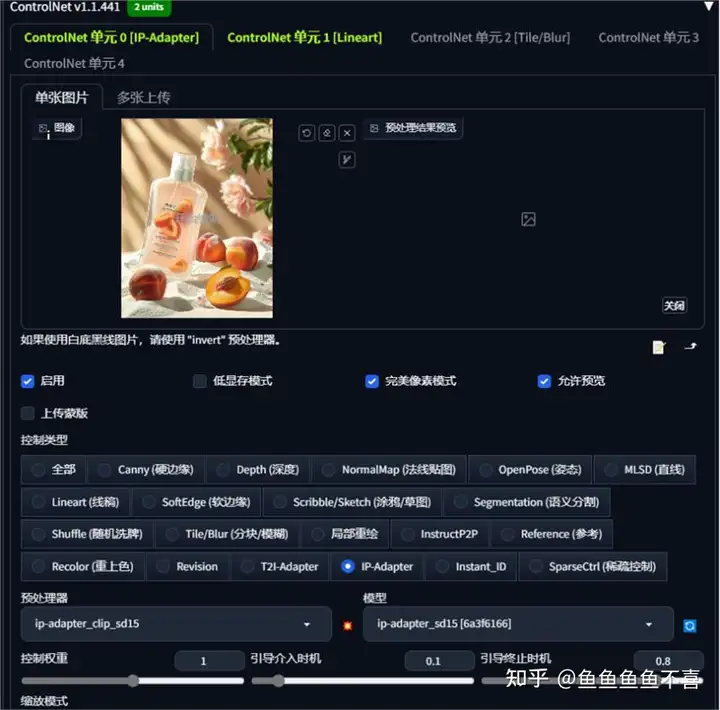

开启两个控制单元,第一个是参考单元

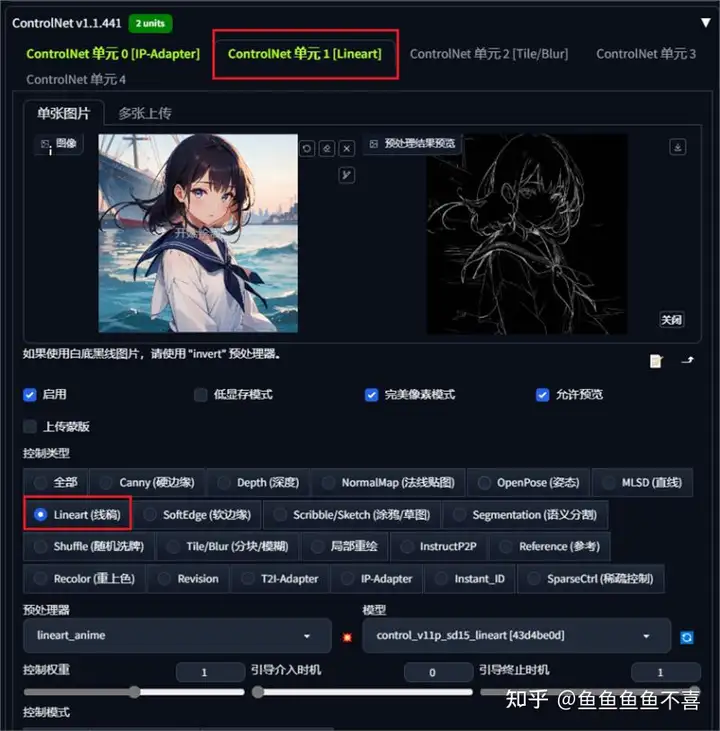

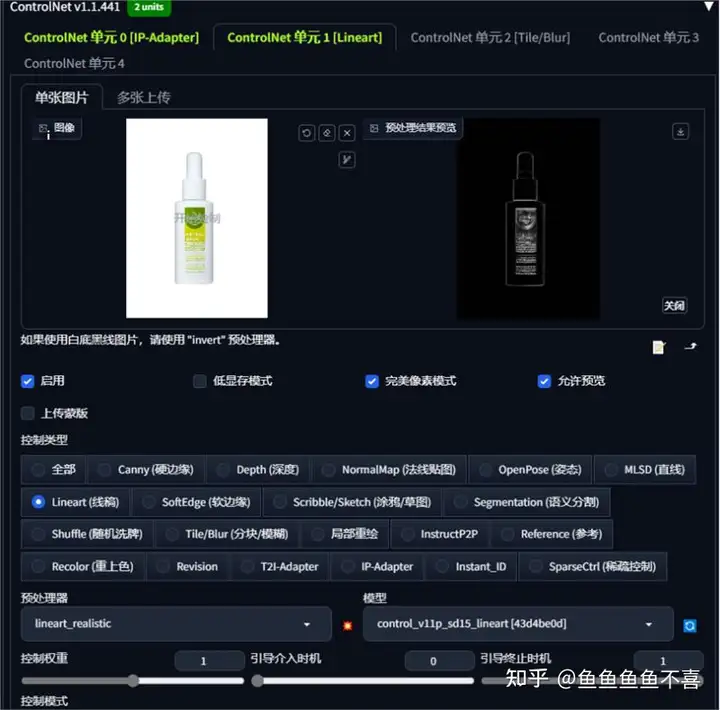

第二个是线稿单元

4. 点击生成

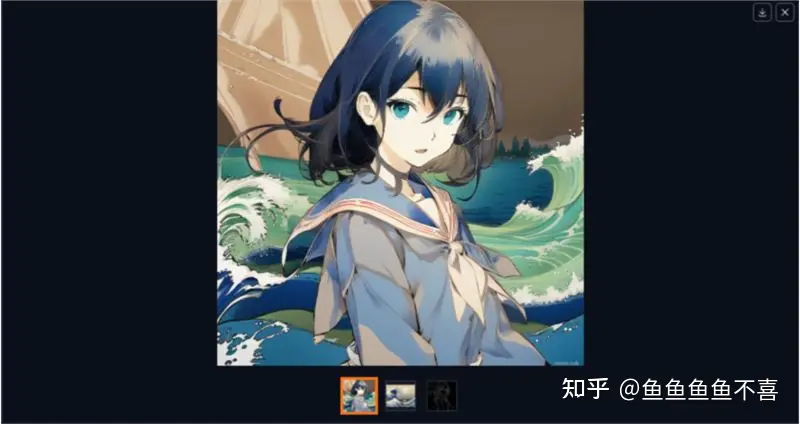

可以看到我们没有使用任何的提示词和 Lora,生成的图像就参考了我们上传的神奈川冲浪里的风格,包括颜色海浪

5. 其他示例

像这种效果可以使用在室内设计,或者产品设计中

参考图

线稿图

生成效果

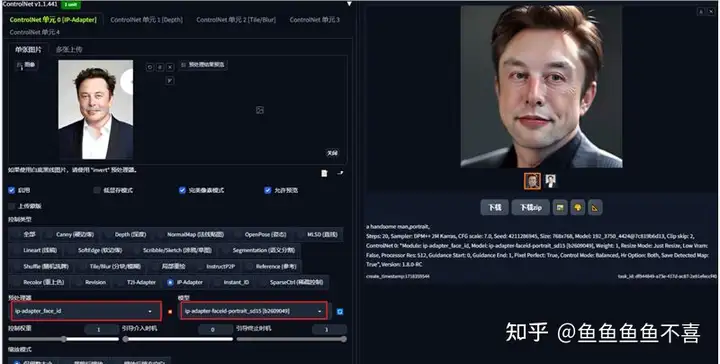

我们在试试人像模型

效果还是不错的

6. 总结

通过本教程,你已经学会了如何在Stable Diffusion WebUI中使用ControlNet的IP-Adapter预处理器进行图像处理。这个工具为你提供了更多的控制和定制选项,让你能够生成更符合需求的图像。希望这个教程对你有所帮助,祝你在图像创作中取得更好的成果!

关于AI绘画技术储备

学好 AI绘画 不论是就业还是做副业赚钱都不错,但要学会 AI绘画 还是要有一个学习规划。最后大家分享一份全套的 AI绘画 学习资料,给那些想学习 AI绘画 的小伙伴们一点帮助!

感兴趣的小伙伴,赠送全套AIGC学习资料和安装工具,包含AI绘画、AI人工智能等前沿科技教程,模型插件,具体看下方。

需要的可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、AIGC所有方向的学习路线

AIGC所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照下面的知识点去找对应的学习资源,保证自己学得较为全面。

二、AIGC必备工具

工具都帮大家整理好了,安装就可直接上手!

三、最新AIGC学习笔记

当我学到一定基础,有自己的理解能力的时候,会去阅读一些前辈整理的书籍或者手写的笔记资料,这些笔记详细记载了他们对一些技术点的理解,这些理解是比较独到,可以学到不一样的思路。

四、AIGC视频教程合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

五、实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

这份完整版的学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

1103

1103

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?