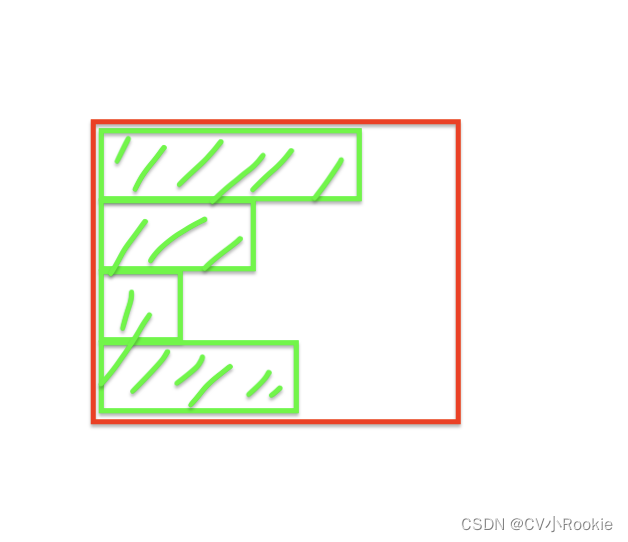

以二维输入情况为例:

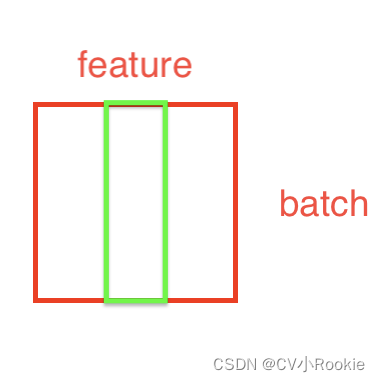

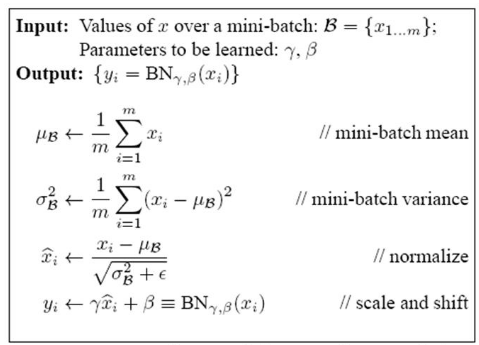

BatchNorm:

对一列,也就是某一个特征进行操作:均值变为0,方差变为1;

变换后某个神经元的激活x形成了均值为0,方差为1的正态分布,目的是把值往后续要进行的非线性变换的线性区拉动,增大导数值,增强反向传播信息流动性,加快训练收敛速度。

但是这样会导致网络表达能力下降,为了防止这一点,每个神经元增加两个调节参数(scale和shift),这两个参数是通过训练来学习到的,用来对变换后的激活反变换,使得网络表达能力增强,即对变换后的激活进行如下的scale和shift操作。

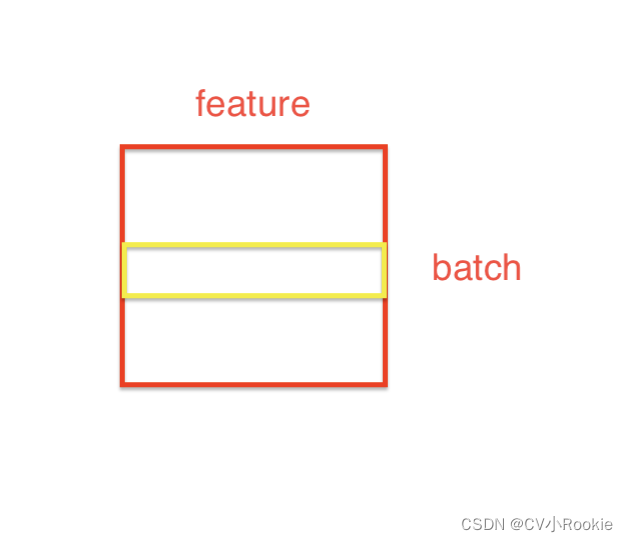

LayerNorm:

对每一个样本(也就是一行)进行与BatchNorm一样的操作。

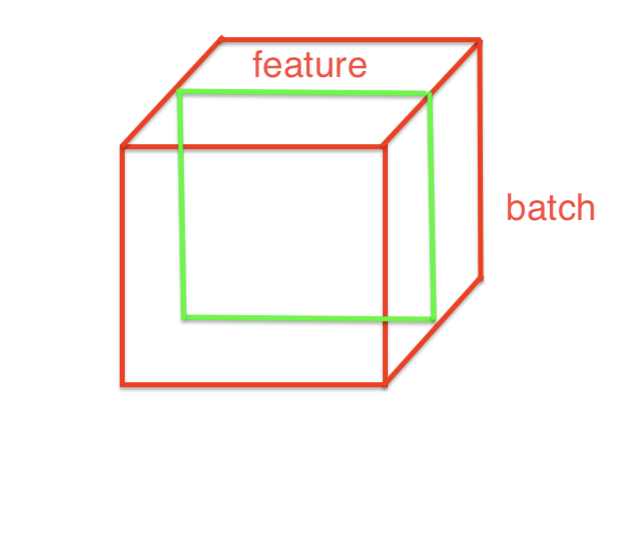

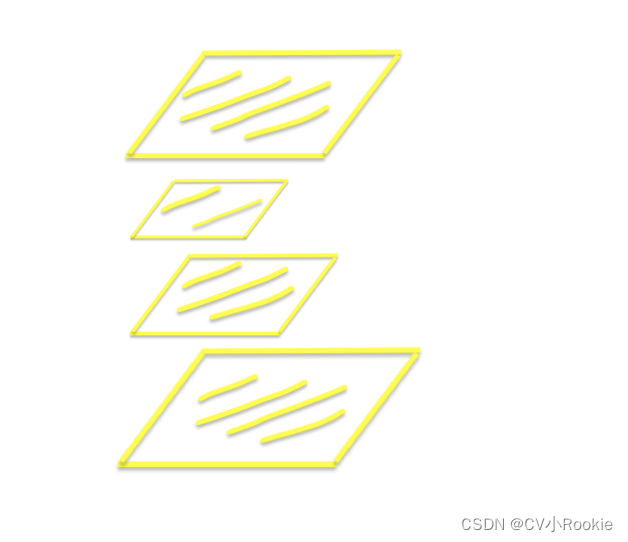

以三维输入情况为例:

BatchNorm:

右图为截面图,可以看到由于样本长度不定,所以在计算mini_batch的均值与方差的时候抖动特别大。预测时是需要记住全局的均值与方差,当预测时碰倒未见过的样本,训练出来的方差与均值不好用 。

LayerNorm:

LayerNorm计算的是样本的方差与均值,不需要计算全局的。相对来说比较稳定。

本文深入探讨了二维输入情况下BatchNorm和LayerNorm的工作原理。BatchNorm通过对每一列(特征)进行标准化,加速训练过程,但可能导致网络表达能力下降,为此引入可学习的scale和shift参数。LayerNorm则针对每个样本进行标准化,解决了BatchNorm在样本长度不固定时的稳定性问题。这两种技术在神经网络中用于优化激活函数的线性区域,提高训练效率。

本文深入探讨了二维输入情况下BatchNorm和LayerNorm的工作原理。BatchNorm通过对每一列(特征)进行标准化,加速训练过程,但可能导致网络表达能力下降,为此引入可学习的scale和shift参数。LayerNorm则针对每个样本进行标准化,解决了BatchNorm在样本长度不固定时的稳定性问题。这两种技术在神经网络中用于优化激活函数的线性区域,提高训练效率。

690

690

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?