🍹 Insight Daily 🪺

Aitrainee | 公众号:AI进修生

Hi,这里Aitrainee,欢迎阅读本期新文章。

Mistral 又搞了个 “小而美” 的狠货: Mistral Small 3.1 发布并开源:

号称 “小 3.1”,但能力不 “小”。 多模态、开源 Apache 2.0 协议,关键是性能还杠杠的,直接 PK 掉 Gemma 3 和 GPT-4o mini。

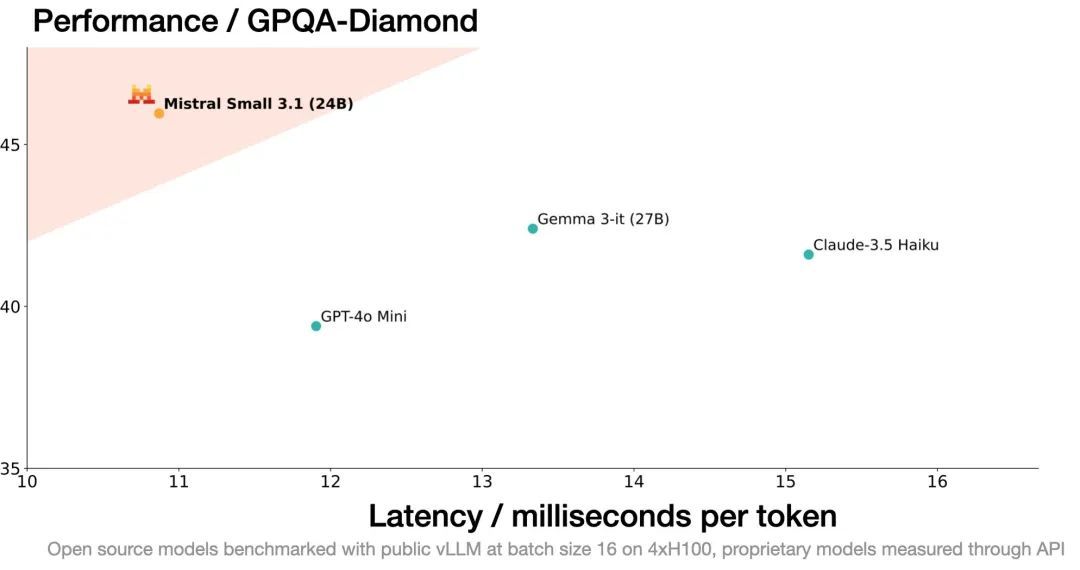

看 Benchmark 图: 横坐标是速度,越小越快; 纵坐标是知识,越大越强。 Mistral Small 3.1,直接霸榜左上角,速度、知识双 Buff 加持。

有人分析 Mistral Small 3.1,觉得这模型潜力巨大。 虽然现在还不是原生多模态,但 Mistral 可能会憋个大的,直接搞个原生多模态模型出来。

参数 30B 左右,各种模态都支持。 要是真成了,说不定能再现 Mistral 7B 的 “经典时刻”。

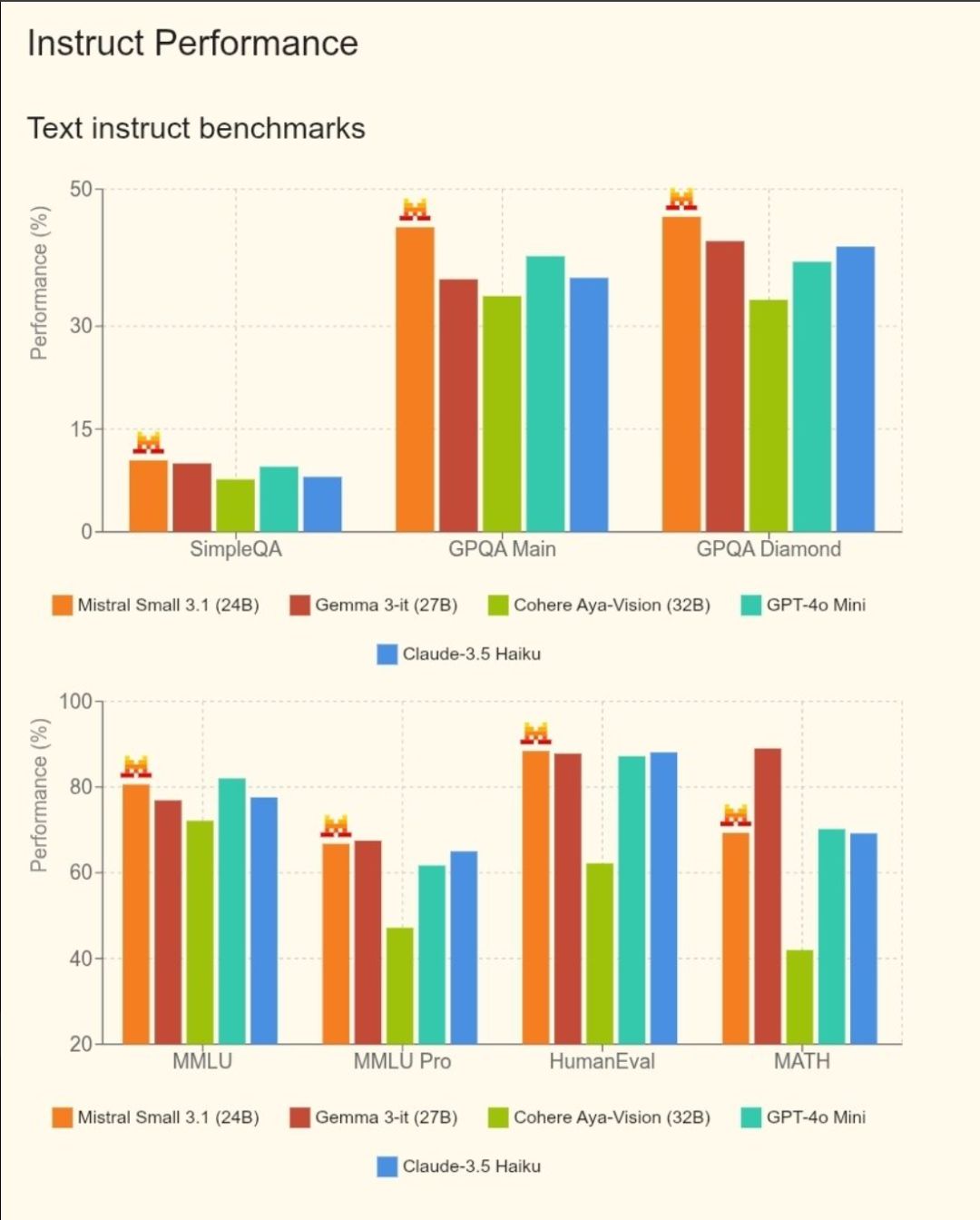

Mistral Small 3.1 的基准测试成绩

多张图。

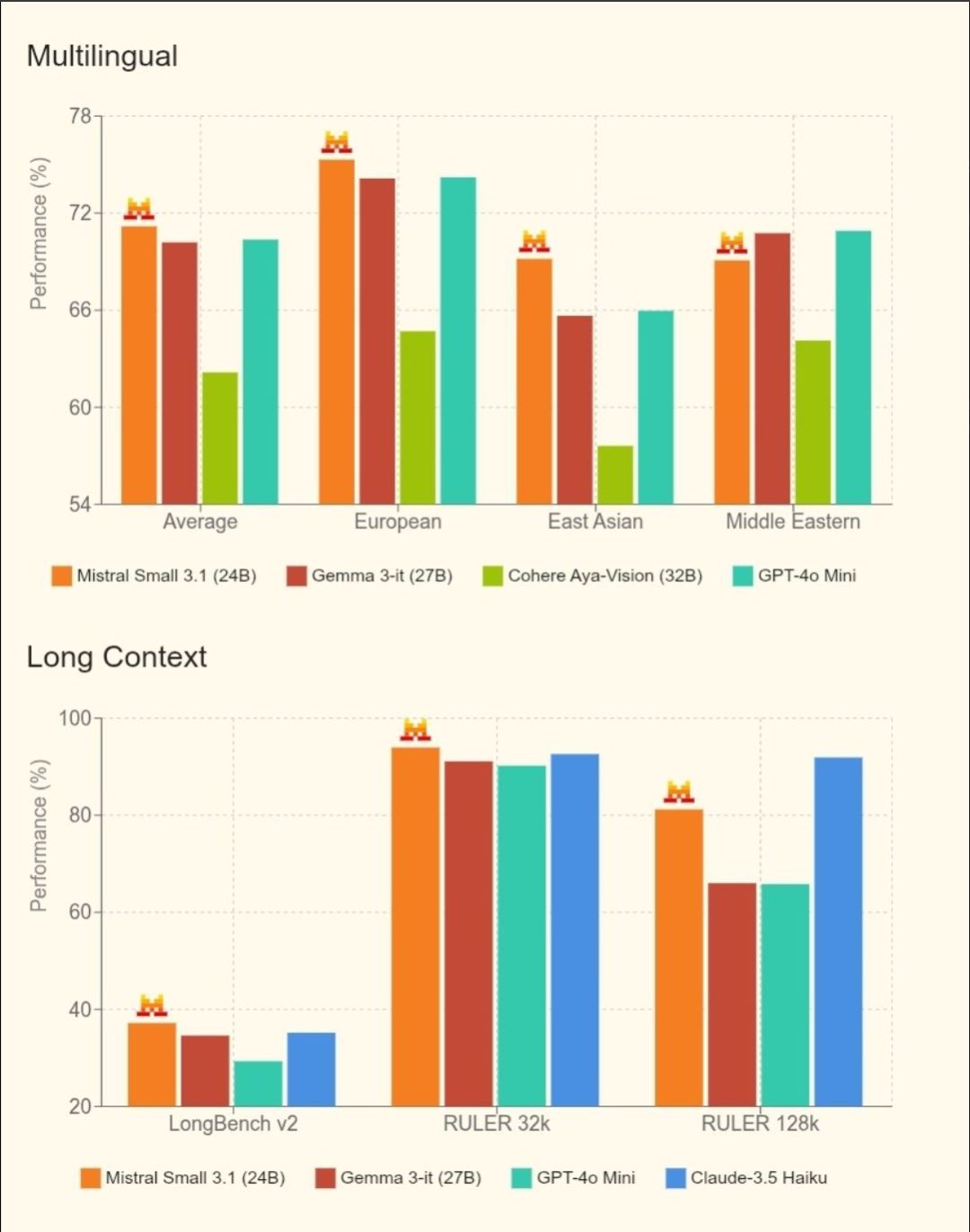

先看多语言能力,Mistral Small 3.1 在欧洲、东亚、中东语言上平均值领先。 长上下文方面,Mistral Small 3.1 只有在RULER 上不如 Claude-3.5 Haiku。

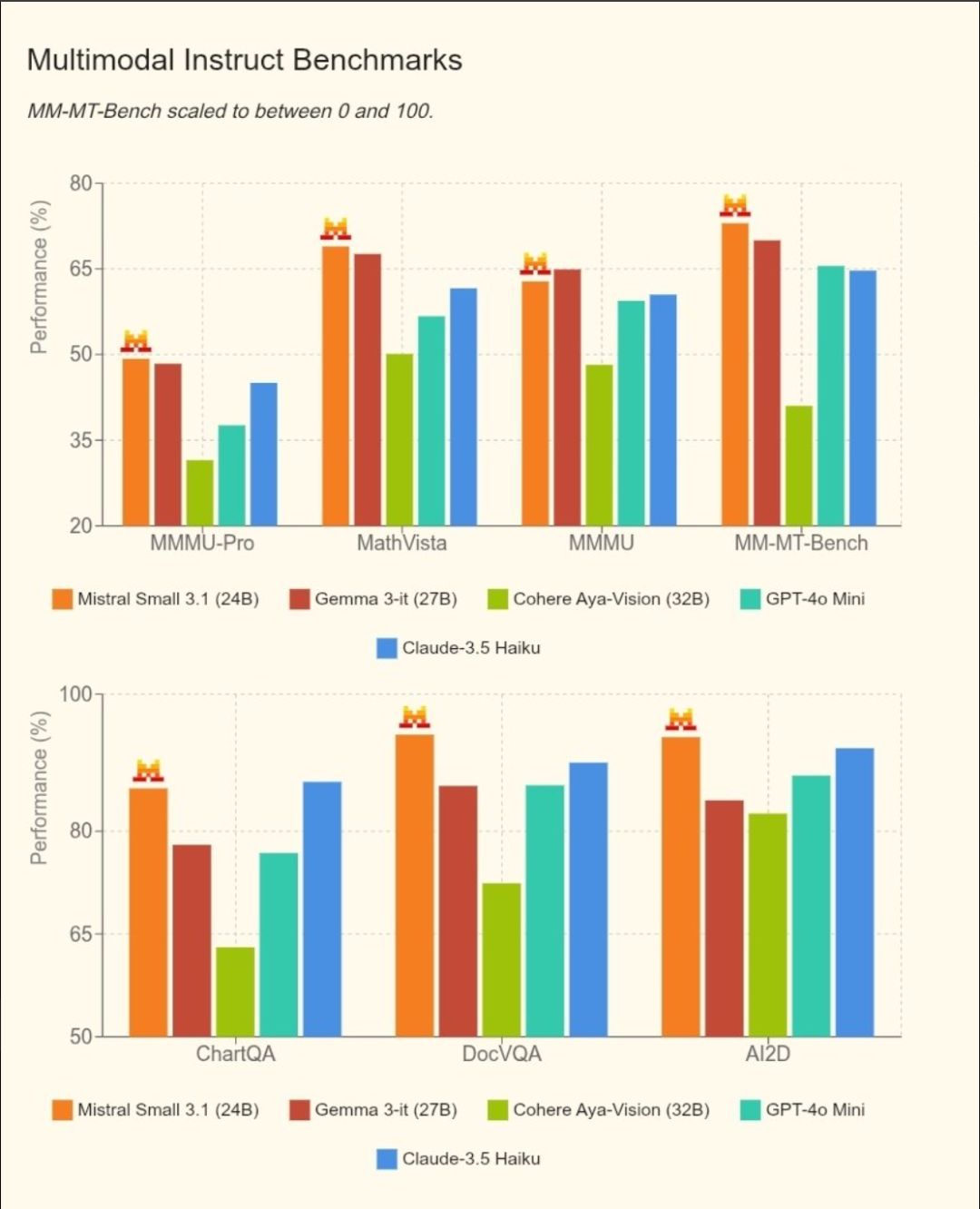

多模态指令上,Mistral Small 3.1 都有显著优势。

长上下文方面,Mistral Small 3.1 只有在RULER 上不如 Claude-3.5 Haiku。

多模态指令上,Mistral Small 3.1 都有显著优势。

文本指令上,Mistral Small 3.1 在 SimpleQA 、GPQA Main、GPQA Diamond 上领先。在 MMLU、MMLU Pro、HumanEval、MATH 上,也是有高有低。

文本指令上,Mistral Small 3.1 在 SimpleQA 、GPQA Main、GPQA Diamond 上领先。在 MMLU、MMLU Pro、HumanEval、MATH 上,也是有高有低。

有网友指出,Mistral Small 3.1 参数多、支持多语言、多模态,还没啥限制,就是推理能力差点意思。

但马上有人泼冷水,说简单任务用推理模型就是 “高射炮打蚊子”, 太啰嗦。 他们更喜欢轻量级的模型处理日常小事。

但马上有人泼冷水,说简单任务用推理模型就是 “高射炮打蚊子”, 太啰嗦。 他们更喜欢轻量级的模型处理日常小事。

推理能力不是万金油。 像低延迟翻译,速度才是硬道理,要啥推理?

并且这个模型还开源:

有人觉得 Mistral 完胜, gpt4o-mini 不行。

反方表示,GPT-4 级别大模型的 “底蕴” 还是在那儿,小模型就算加了 RL 也比不了, “隐含知识” 就是值钱。

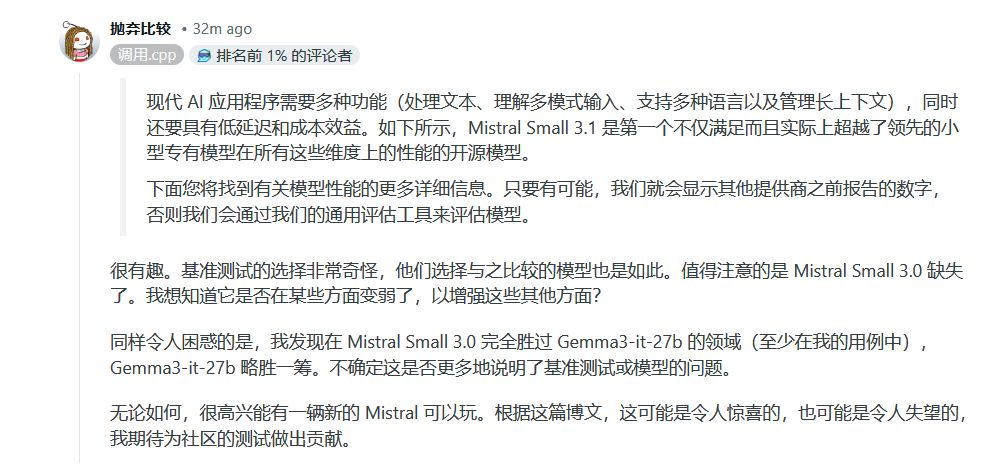

而又说到基准测试,有眼尖的网友表示:

“ 这测试选的,也太奇怪了吧?对比的模型也怪怪的。Mistral Small 3.0 呢?藏哪儿去了?是不是怕露馅?”

“ 还有,有些地方 Mistral Small 3.1 只是勉强赢了 Gemma3-it-27b,之前 3.0 可是碾压的啊,这啥情况?”

对此,网友表示:“ 最近的模型,都喜欢挑对自己有利的测试,Mistral 更狠,直接无视中国的模型… ”

对此,网友表示:“ 最近的模型,都喜欢挑对自己有利的测试,Mistral 更狠,直接无视中国的模型… ”

🌟 知音难求,自我修

炼亦艰,抓住前沿技术的机遇,与我们一起成为创新的超级个体(把握AIGC时代的个人力量)。

🌟 知音难求,自我修

炼亦艰,抓住前沿技术的机遇,与我们一起成为创新的超级个体(把握AIGC时代的个人力量)。

点这里👇关注我,记得标星哦~

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?