Contextual Transformer Networks for Visual Recognition

论文地址: CoTNet

源码地址: CoTNet

1. Abstract

今天来介绍一篇京东AI研究院的一篇基于Transformer的backbone的论文。

论文提出现有的Transformer设计是在二维特征图上使用Attention,来获得在每个空间位置上的孤立的query和key的注意力矩阵,但是相邻之间的key的上下文信息并没有被充分考虑到。本文提出一种新的Transformer机制说的很玄乎,其实就是一种新的self-Attention机制,即论文中提出的CoT block。该block充分利用了输入key之间的上下文关系,来指导动态注意力矩阵的学习,从而增加了视觉表示的能力,用于各种视觉任务上。

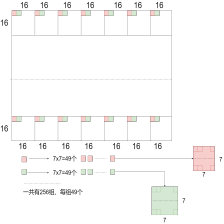

CoT block的实现:首先对输入的feature map使用3x3conv进行上下文编码,得到输出feature的静态上下文表示;其次将这个static key与输入feature map进行concat操作,进行两个连续的1x1conv来得到动态的multi-head attention matrix,然后将这个动态注意力矩阵与输入value矩阵进行相乘得到动态的上下文表示;最后将动态特征表示与第一步得到的静态特征表示进行特征融合得到该block的输出。

其实这篇论文的工作与之前的一篇论文Bottleneck Transformers for Visual Recognition非常相似,因为都是用来替换

订阅专栏 解锁全文

订阅专栏 解锁全文

2121

2121

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?