(引用)

论文所在期刊: Information Fusion

所在级别:

影响因子:

论文笔记

关键词

Multispectral image fusion,Lightweight model,Joint optimization,Real-time,Embedded platform

多光谱图像融合,轻量级模型,联合优化,实时,嵌入式平台

核心思想

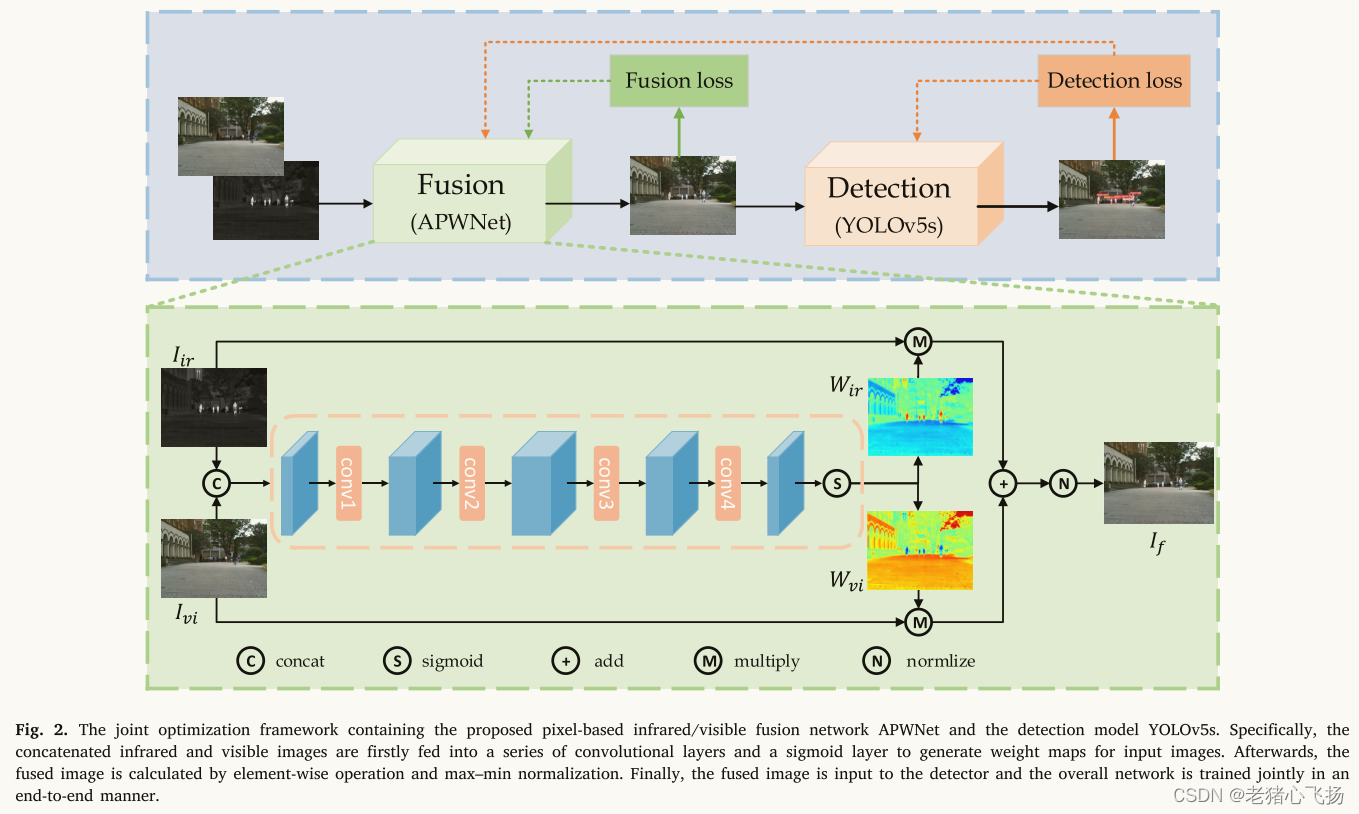

网络APWNet以逐像素自适应权重分配机制来提高融合质量和效率,这个网络的核心在于它能够自适应地为每个像素赋予权重

网络结构

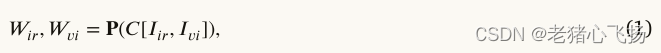

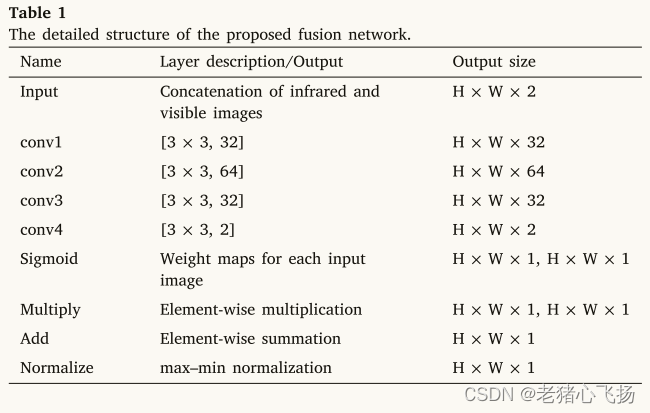

C[⋅]是concatenation,即维度通道拼接,𝐏表示自适应像素权值生成模块,在这一步计算出可见光与红外光对应像素的权值

然后,通过将源图像与其对应的逐像素权重相乘并将其相加来计算融合结果

再对图像进行归一化处理

最后将融合后的图像输入到检测网络中,得到检测结果

网络详细结构

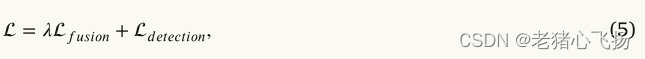

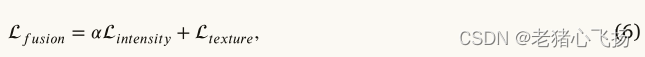

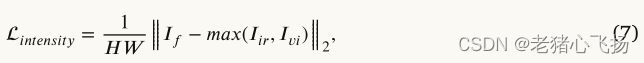

损失函数

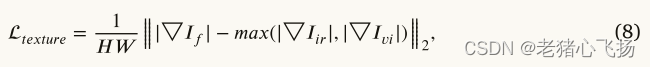

倒三角表示寻找测量图像纹理信息的梯度图的操作

融合策略

数据集

- TNO, RoadScene和MSRS数据集

- 检测后续目标检测所用到的标注数据集MSRS dataset with detection labels

训练设置

- 模型在PyTorch框架中实现,并以端到端方式进行训练。使用在COCO数据集上预训练的YOLOv5s作为检测模型。

- 超参数λ为0.15

- 超参数α为0.01

- 学习率为1.0 × 10−3,并呈指数衰减

- epoch设置为50

- batch大小为16

- 采用Adam优化器𝛽1 = 0.9,𝛽2 = 0.999进行参数优化

实验

评价指标

- MI

- FMIdct

- FMIw

- Mutinf

- Qcv

- Var

- Qabf

- mAP@0.5

- mAP@[0.5:0.95]

Baseline

- SOTA方法:U2Fusion ,RFNNest , MFEIF , PIAFusion

- 还对比了三个轻量网络:SeAFusion, SDNet, IFCNN

实验结果

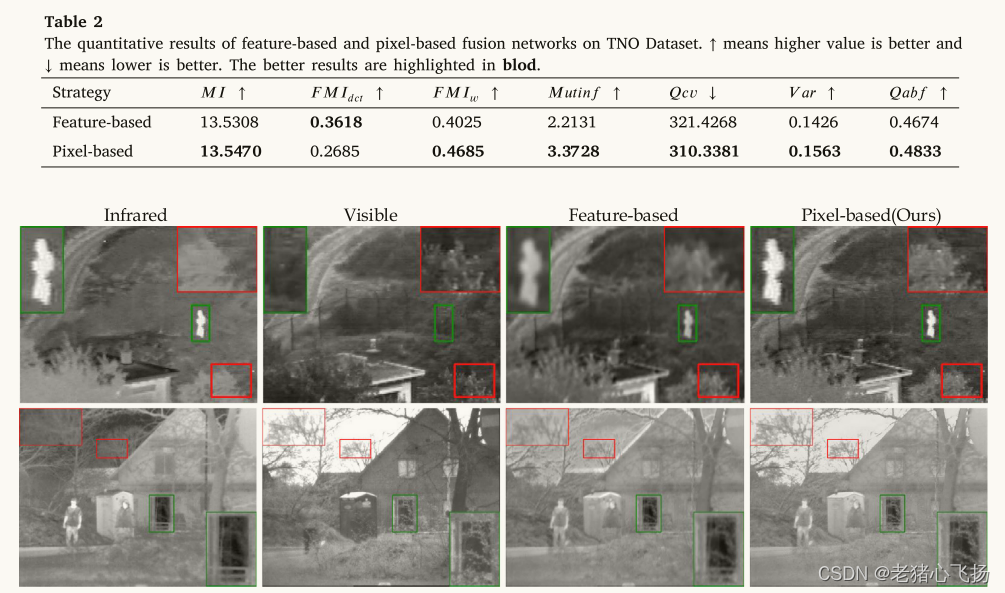

对比特种融合和像素融合:除各项指标的数据值F𝑀𝐼𝑑𝑐𝑡外,其他6个指标的融合效果均优于特征融合

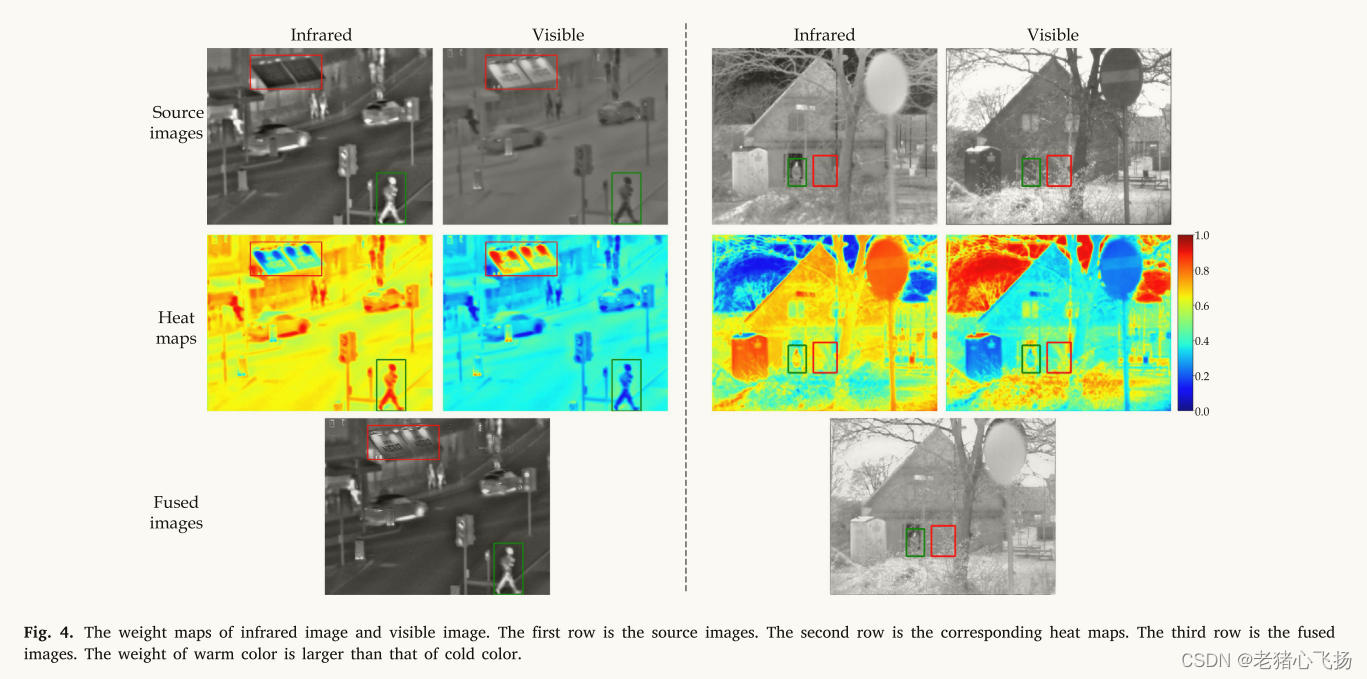

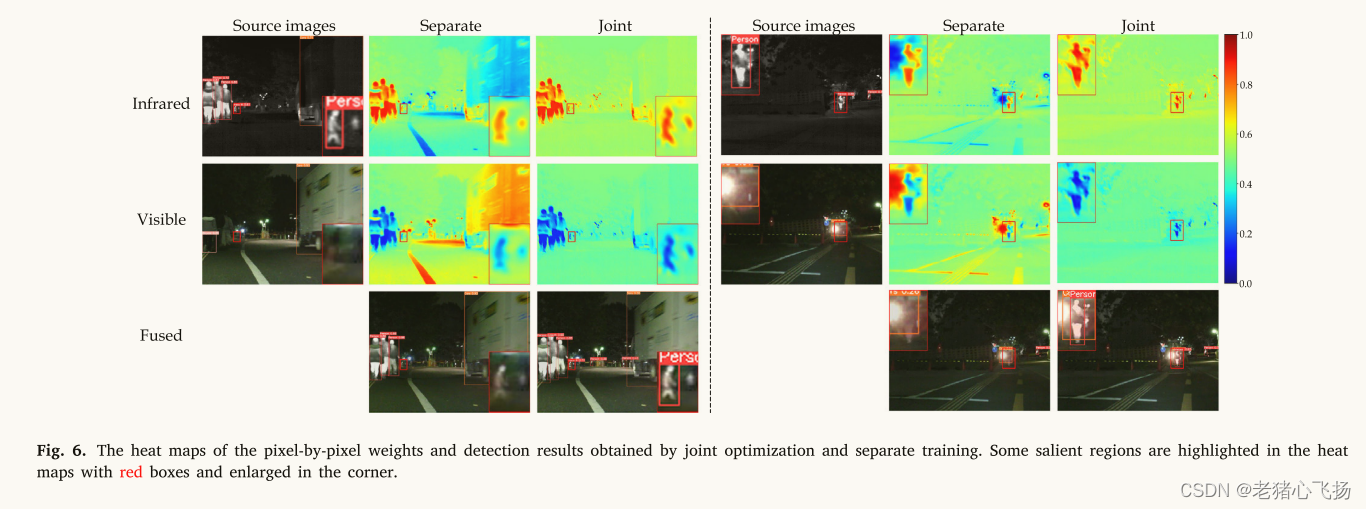

- 热图中的像素颜色清楚地反映了红外和可见光图像中对应位置对最终融合结果的不同贡献,其中暖色权重大于冷色权重

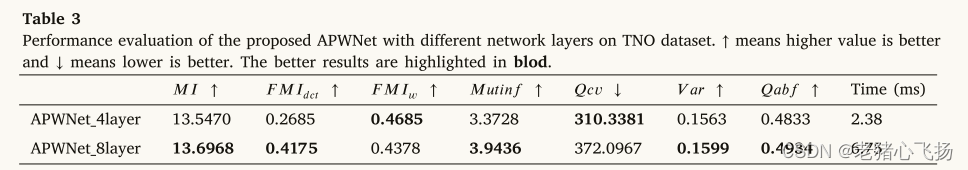

对比4层和8层带来的好处和坏处:APWNet_8layer在𝑀𝐼、F𝑀𝐼𝑑𝑐𝑡、𝑀𝑢𝑡𝑛𝑓、V𝑎𝑟和𝑄𝑎𝑏𝑓指标上比APWNet_4layer略有提高,而APWNet_4layer在F𝑀𝐼𝑤和𝑄𝑐𝑣指标上仍保持领先。然而,在RTX 2080Ti上,APWNet_8layer在512 × 512分辨率下的处理速度降至6.75 ms,几乎是APWNet_4layer的2倍。当部署在嵌入式平台上时,apwnet_8层的效率将进一步降低。可见选4层的网络更好

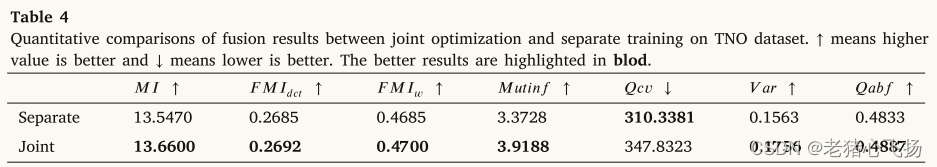

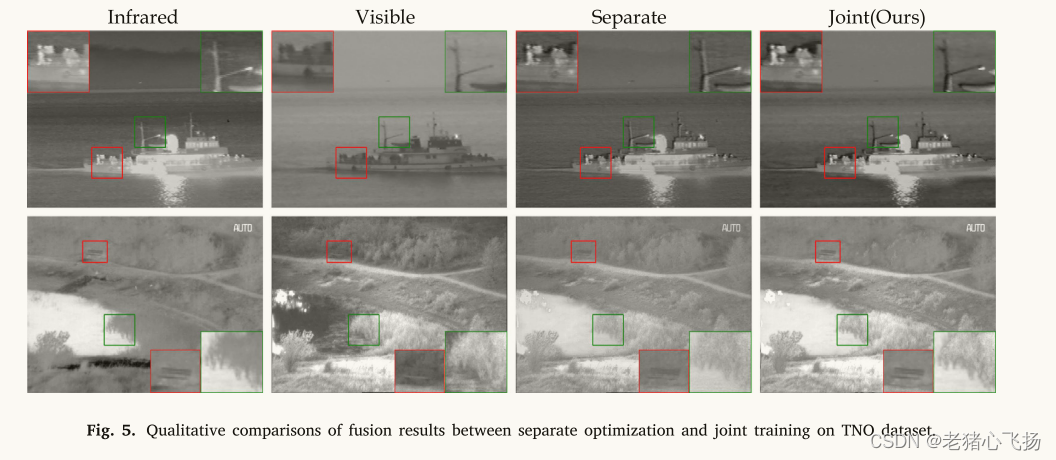

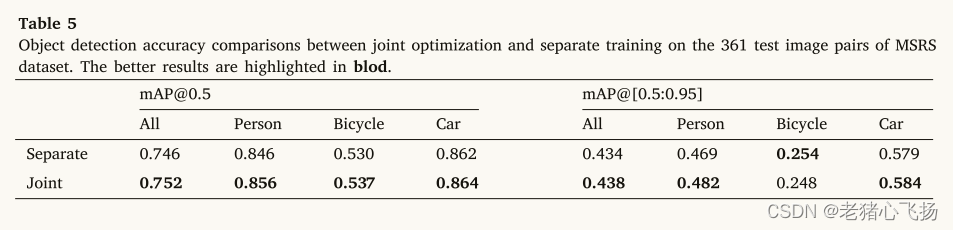

联合优化vs.单独训练:除了𝑄𝑐𝑣之外,联合优化在几乎所有指标上的融合性能都优于单独训练,对于后续的目标检测任务,也是联合优化的准确率更高

- 由于联合优化框架在训练阶段为图像融合任务提供了额外的目标感知约束,因此这些红框中的热图呈现出明显的差异,远处物体由于低照度或强光晕的影响,在源可见光图像中无法检测到,但在源红外图像中可以正确检测到

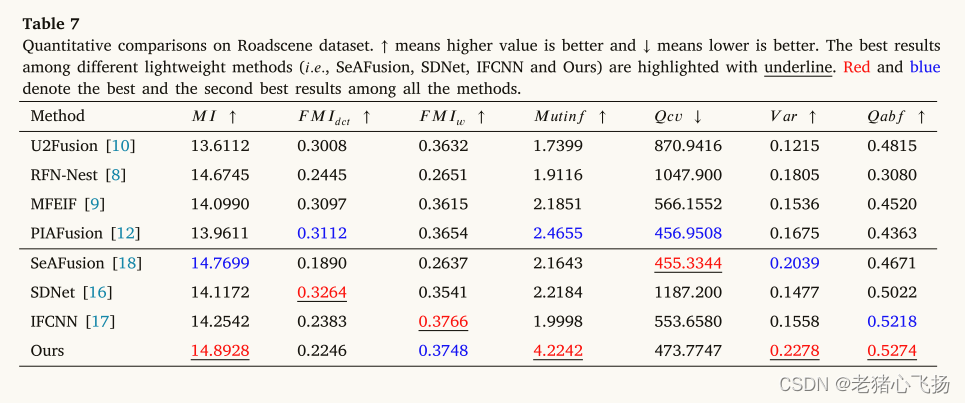

- 对比其他网络:Roadscene数据集的定量比较

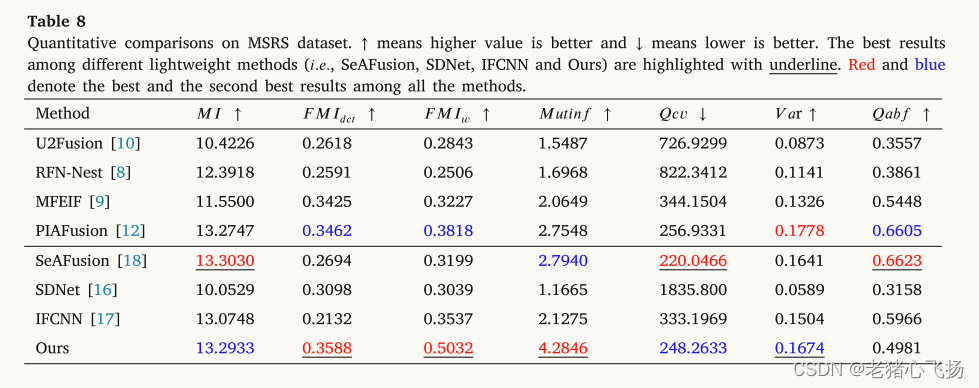

- 对比其他网络:MSRS数据集的定量比较

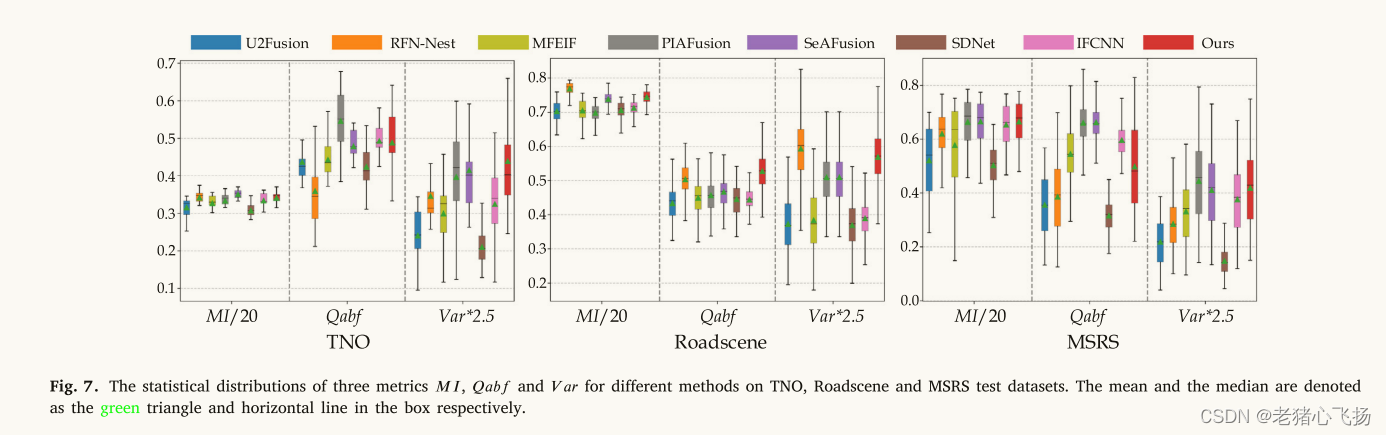

- 不同方法在TNO、Roadscene和MSRS测试数据集上的三个指标𝑀𝐼、𝑄𝑎𝑏𝑓和∑𝑎𝑟的统计分布。均数和中位数分别用框中的绿色三角形和水平线表示。

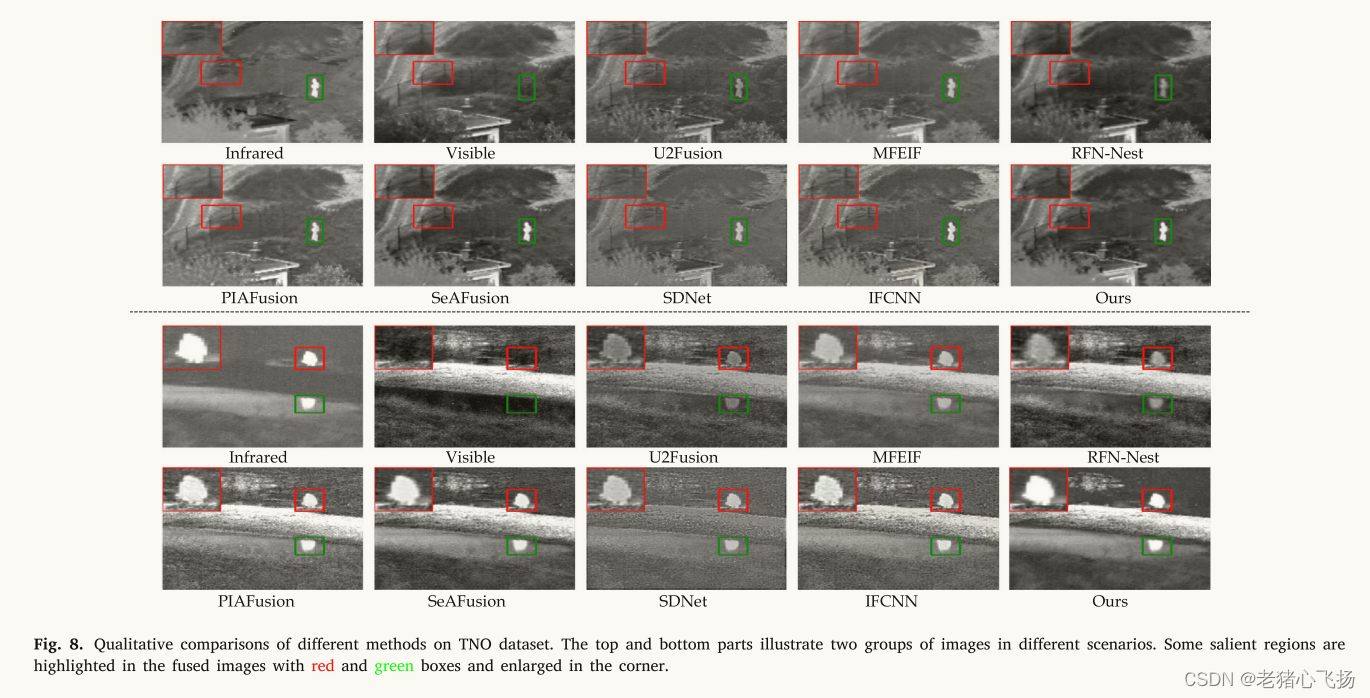

- TNO数据集上不同方法的定性比较

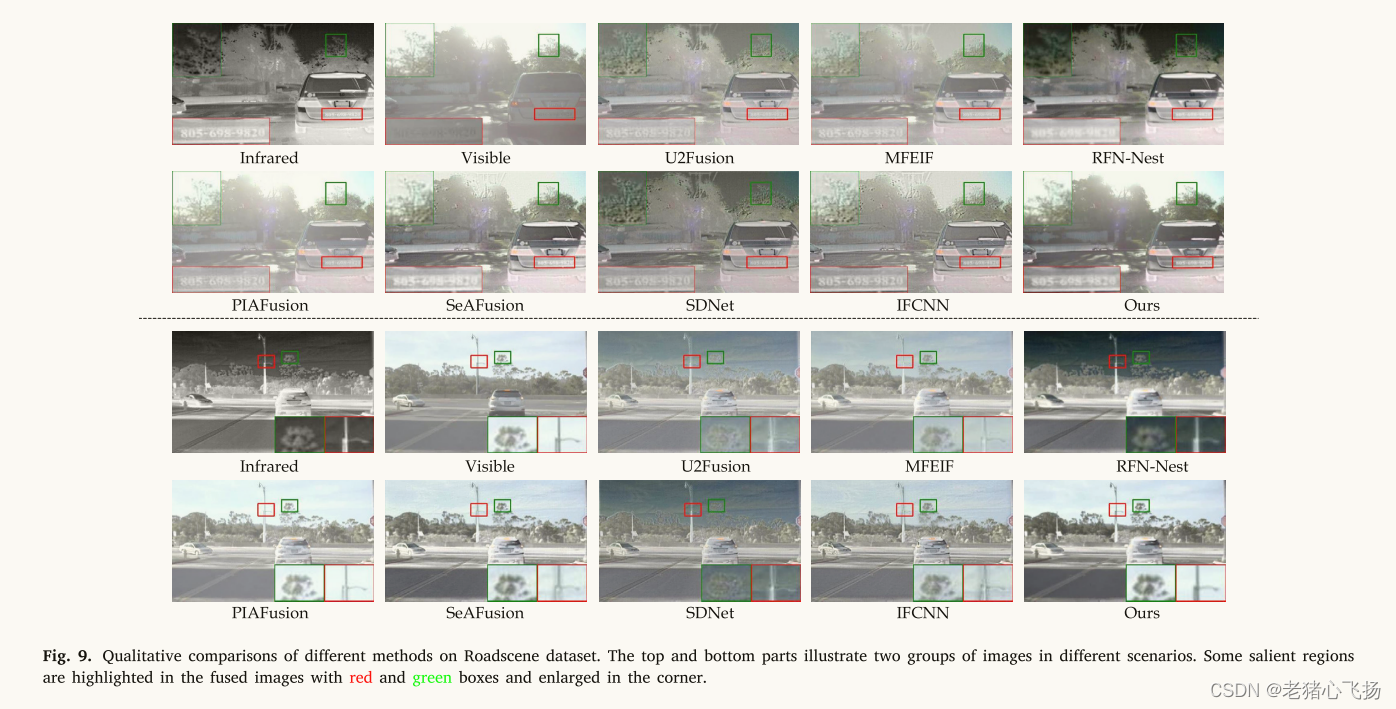

- Roadscene数据集上不同方法的定性比较

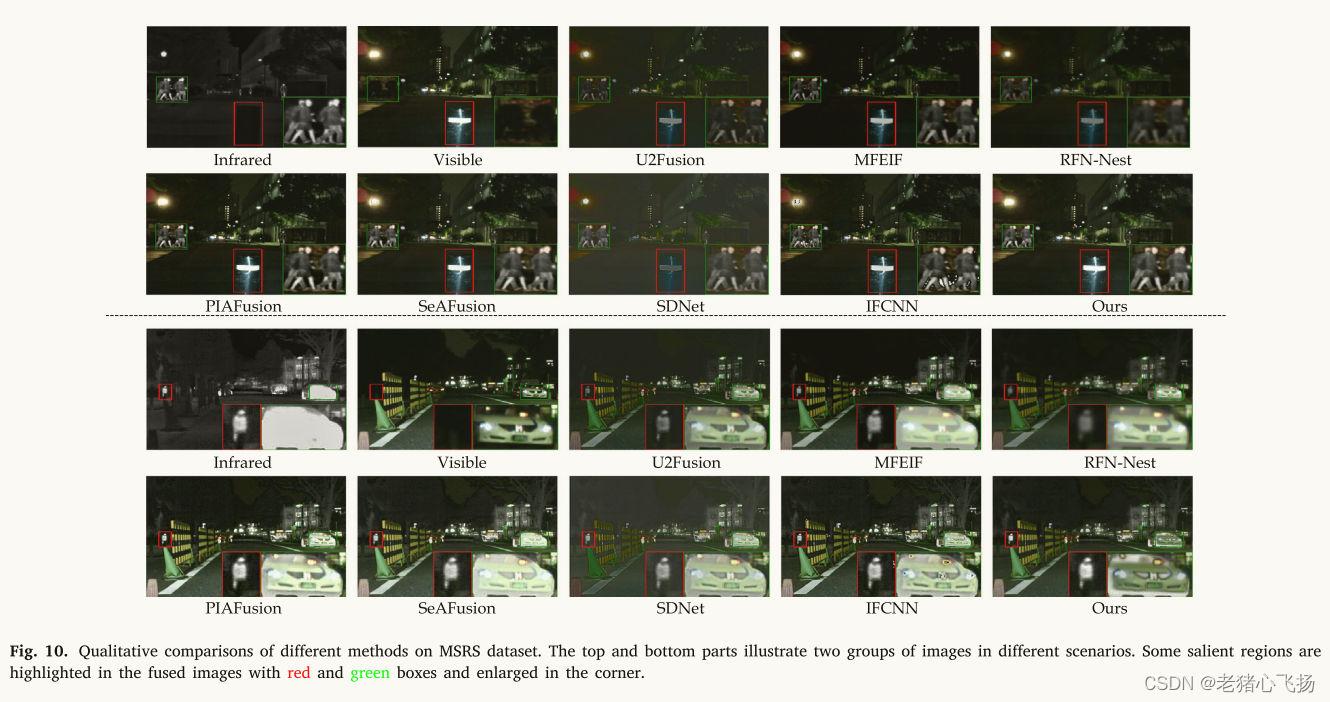

- MSRS数据集上不同方法的定性比较

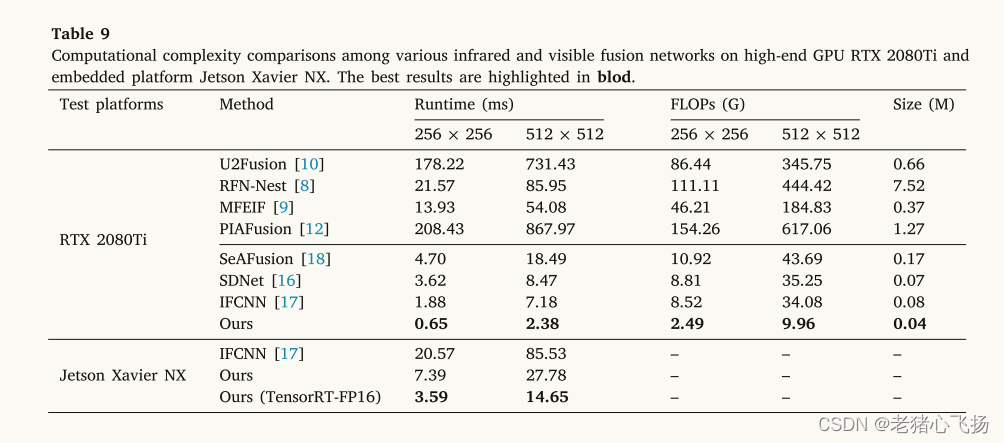

- 各方法在显卡和嵌入式平台的时间对比

8520

8520

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?