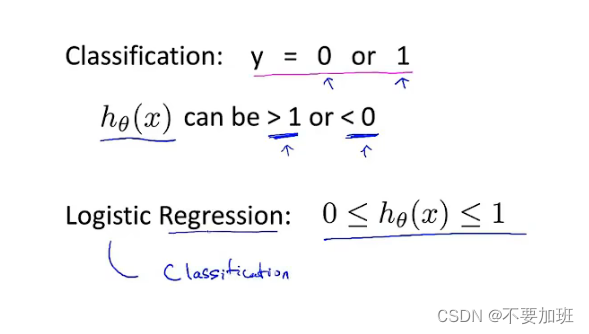

分类问题 Classification

与线性回归的区别:前者y值是连续的,后者y值是离散的

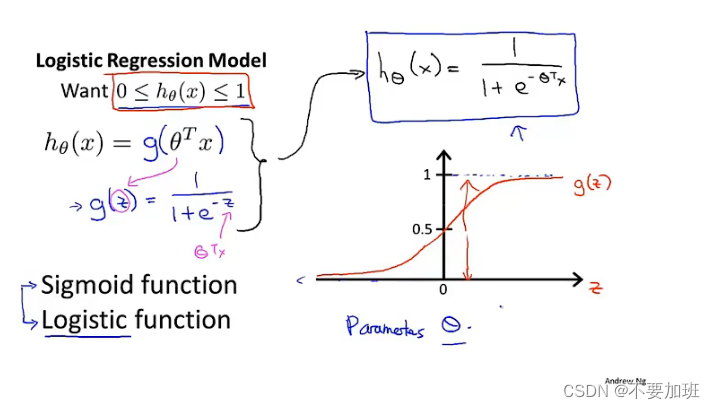

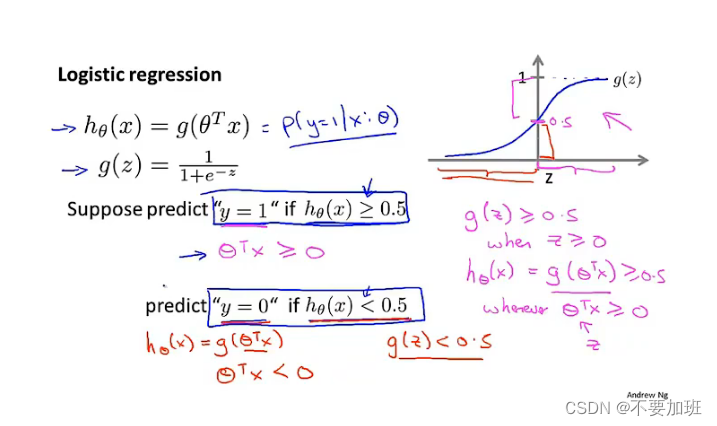

假设表示 Hypothesis Representation

逻辑回归函数模型

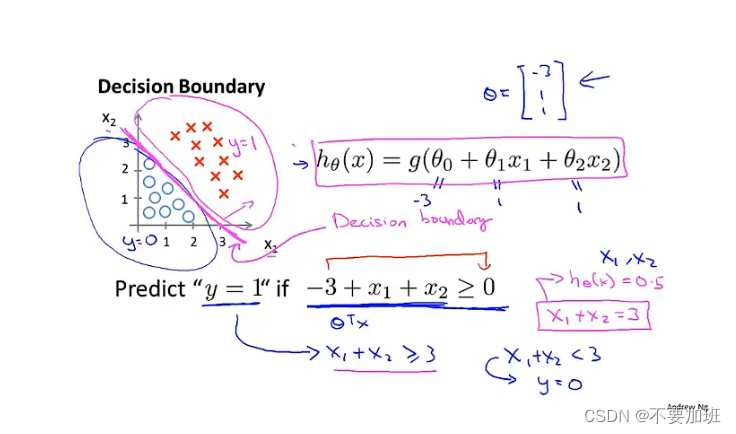

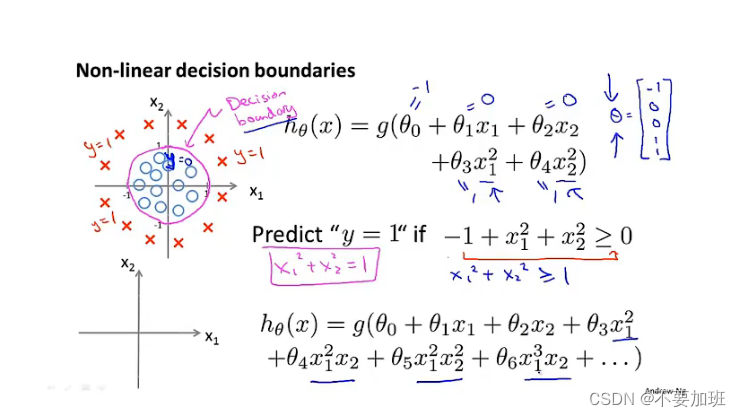

决策界限 Decision boundary

线性模型

非线性模型

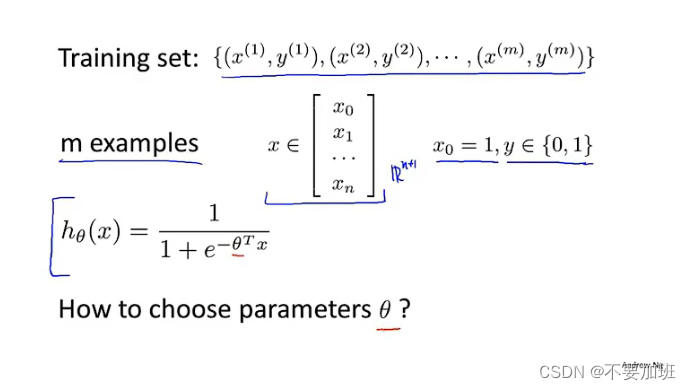

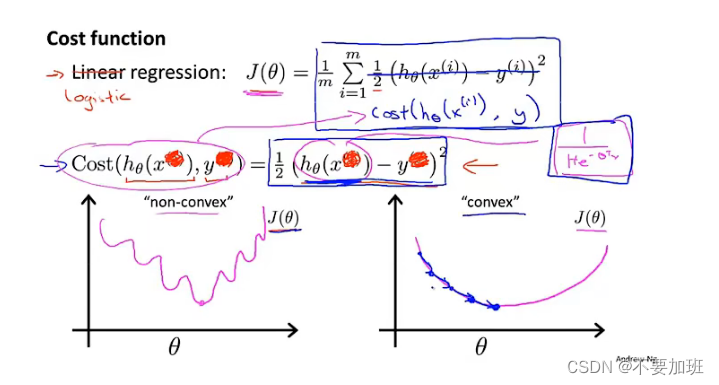

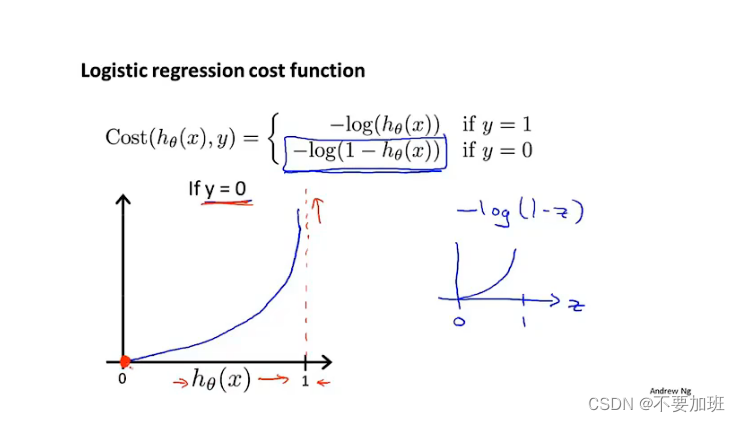

代价函数 Cost function

问题描述

逻辑回归不能使用线性回归的代价函数,因为sigmoid函数是非线性函数,这样会是得到的代价函数的图形是非凸函数,有局部最优点,无法使用梯度下降法去求解

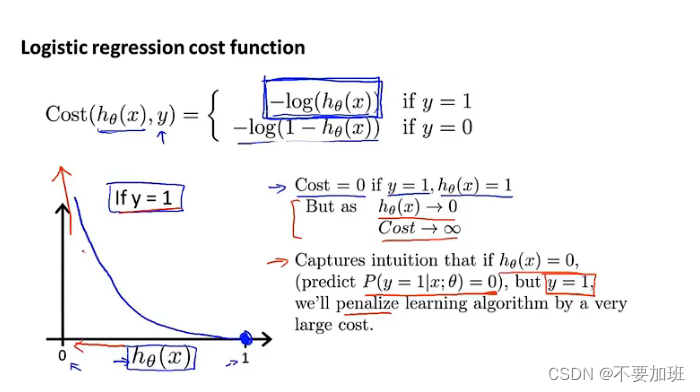

惩罚机制的函数

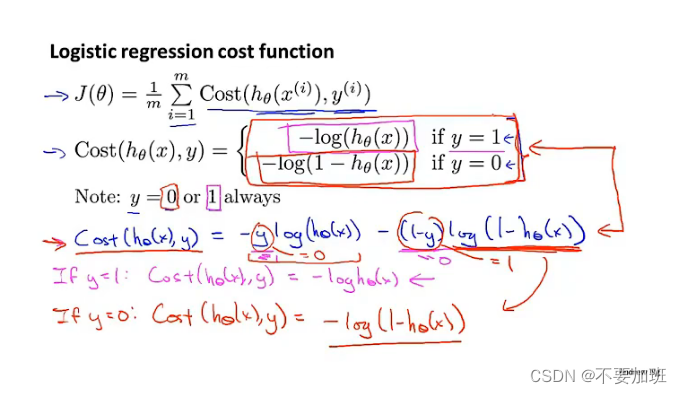

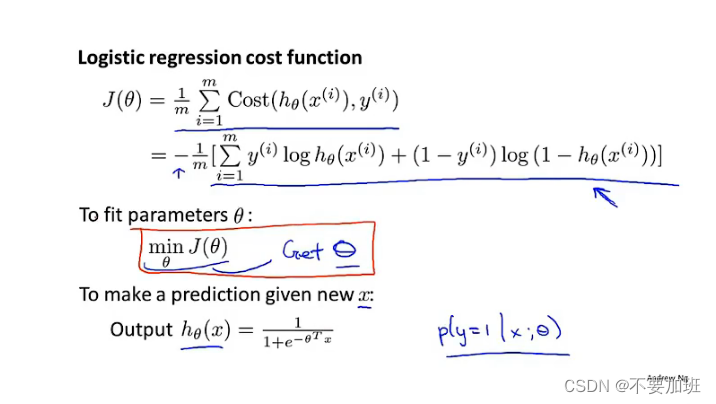

简化代价函数和梯度下降 Simplified cost function and gradient descent

代价函数

输出的是y=1的概率

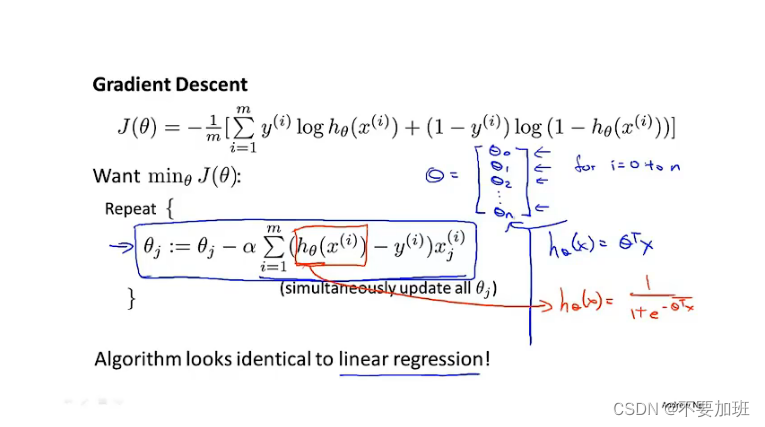

梯度下降

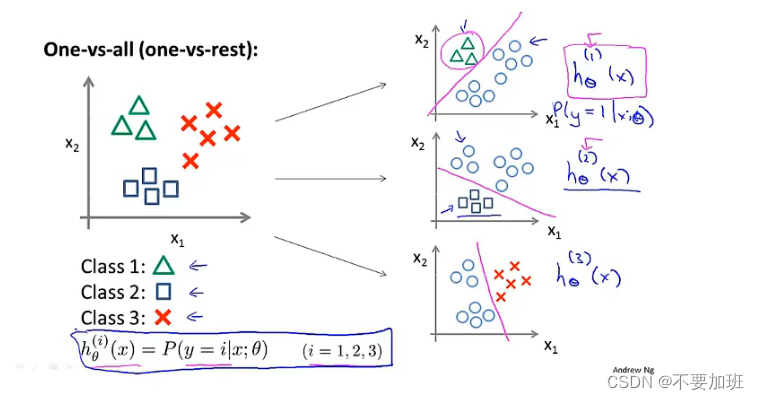

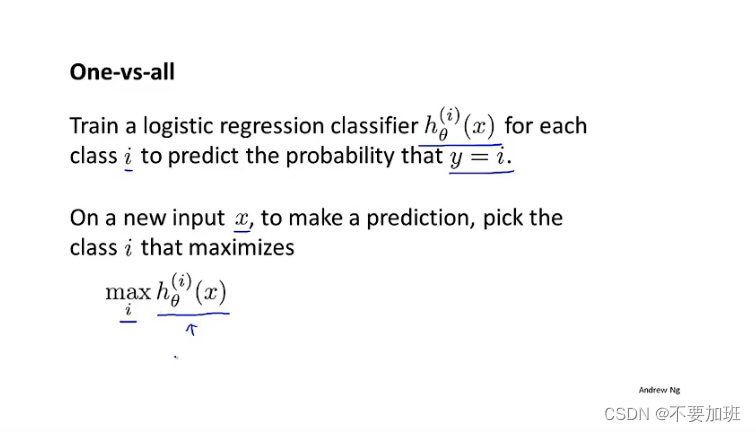

多元分类 Multi-class classification:one vs all

化为一对一再拟合

正则化 Regularization

就是用于解决过拟合的一种方法

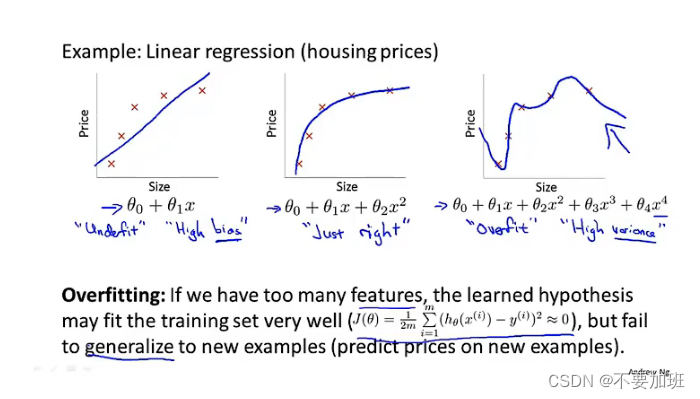

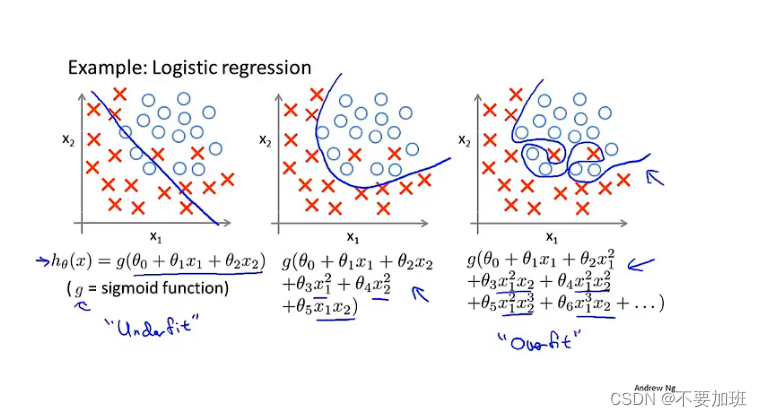

过拟合 The problem of overfitting

欠拟合 underfitting,也叫具有高偏差 high bias,即模型对于数据的预测具有很大的偏差

*过拟合 overfitting,也叫具有高方差 highvariance,即模型由于太过于契合数据所导致回归曲线的上下波动幅度大 *

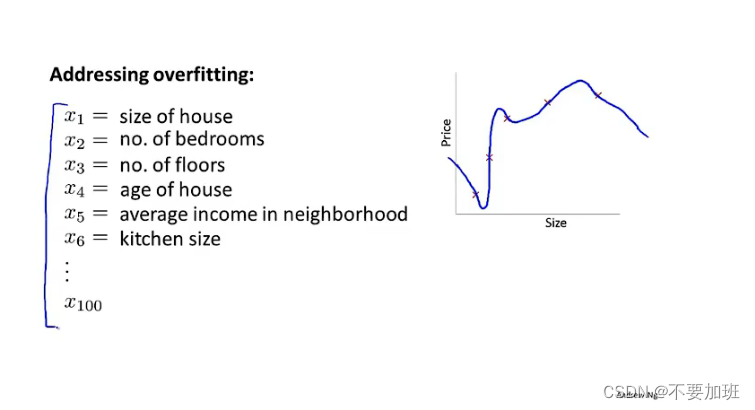

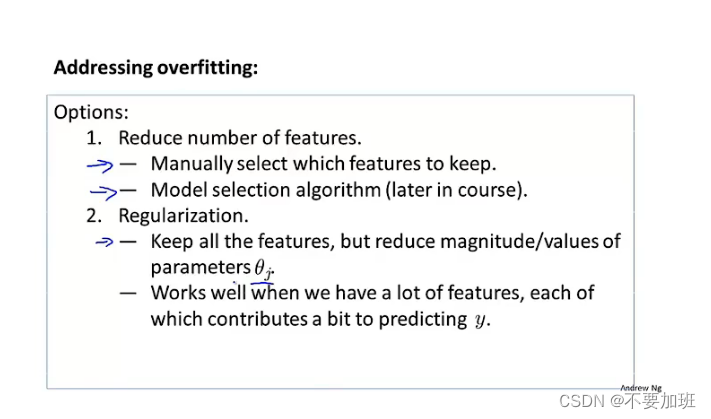

解决过拟合

在拟合数据的过程中,不仅确定拟合曲线的阶数十分困难,并且应该选择那些特征也是难以确定的,因为在一些问题中是有十分多特征的

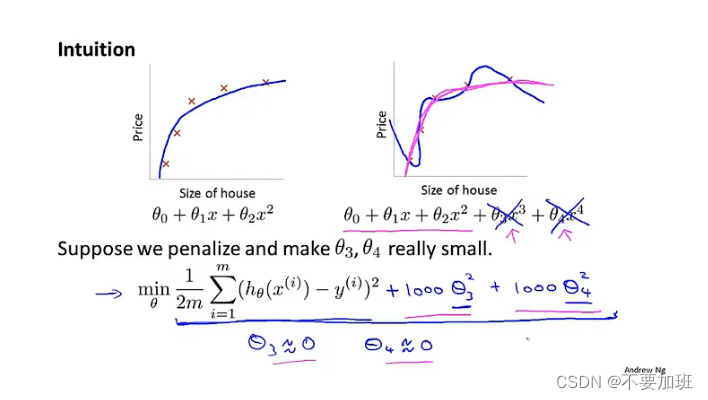

代价函数 Cost function

往代价函数中加入惩罚项

运用在线性回归和逻辑回归上也是这个道理,不再赘述,看实际代码怎么运行吧

959

959

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?