笔记整理:杜超超,天津大学硕士,研究方向为自然语言处理、大语言模型

论文链接:https://aclanthology.org/2024.acl-long.72.pdf

发表会议:ACL2024

1. 动机

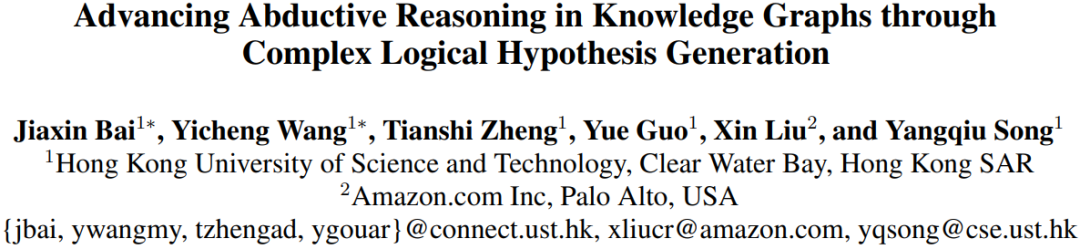

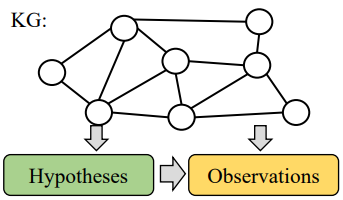

溯因推理是做出有根据的猜测,为观察结果提供解释的过程。虽然知识的应用已经很广泛,但是溯因推理与结构化知识(比如,知识图谱)的结合还没有被充分探索。本文的目标是生成一个复杂的逻辑假设,以此来解释一组观察结果,比如,“如果A和C都发生,并且D没有发生,那么B就会发生”。考虑图1的例子,一个逻辑假设(Hypotheses)可以为观察结果(Observations)提供一段合理的解释(Interpretations)。

图1 观察结果和推断逻辑假设的例子

处理这种推断任务的一种直接的方法就是基于搜索的技术,基于观察到的结果探索潜在的假设。但是这种方法面临两个挑战,

首先,知识图谱中的信息可能不完整。基于搜索的方法严重依赖于数据的完整性,知识图谱边的缺失会对这种方法产生消极影响。

其次,逻辑结构假设的复杂性。当处理候选假设的组合时,基于搜索的方法的搜索空间呈指数增长。

为了克服上述挑战,本文提出在监督学习框架内利用生成模型为给定的观测值生成逻辑假设,并使用教师强制(Teacher-forcing)方法训练基于Transformer的生成模型。经过有监督训练的生成模型可以生成在结构上更符合参考假设的逻辑假设,但是对于未知数据,不能保证模型的性能。因此,本文引入了基于知识图谱的强化学习方法(RLF-KG),使得模型在生成假设时,会根据知识图谱中的信息,调整生成的假设,使得这些假设推导出的结论与实际观察到的结果更加一致,它利用近端策略优化(PPO)来最小化观察到的证据与从生成的假设中得出的结论之间的差异。

2. 贡献

本文的主要贡献有:

(1)介绍了复杂逻辑假设生成任务,这项任务可以被视为与知识图谱进行溯因推理的一种形式。

(2)为了应对知识图谱的不完整性和逻辑假设的复杂性带来的挑战,本文提出了一种生成式方法,提高了生成的假设的质量。

(3)开发了基于知识图谱的强化学习(RLF-KG)技术,最大限度地减少观察结果与所生成假设结论之间的差异。

3. 方法

3.1 问题定义

定义一个知识图谱G=(V,R),V是顶点的集合,R是关系类型的集合,每一个关系类型r∈R都是一个函数:V×V→{true,false},r(u,v)=true表示在图谱中存在从顶点u到顶点v的类型r,反之为false。对于图谱中缺失的边,用unknown代替,而不是false。推理模型只能访问观察到的图谱G,而真实的图谱被隐藏 ,并且包含观察到的图谱G。

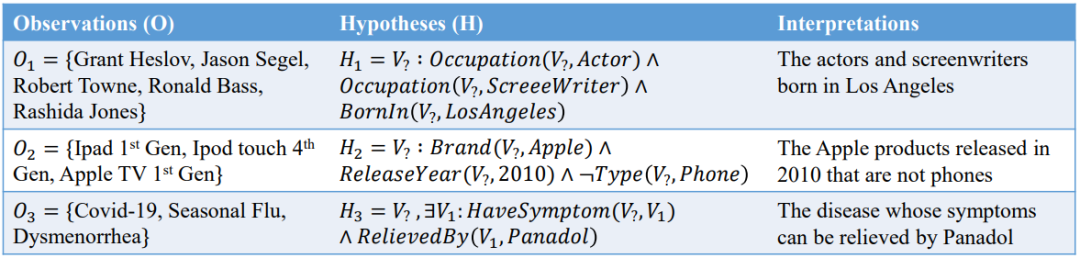

一个观察(observation)是V中实体的集合O,一个图谱中的逻辑假设H(hypothesis)被定义为一阶逻辑形式的变量顶点V的谓词,AND,OR,NOT。假设可以被写为联合范式:

表示假设是基于给定的图谱G制定的,这意味着假设中的所有实体和关系都必须在G中,可变顶点的域是G的实体集。

H的结论(conclusion)被表示为 ,是H在G上为true的一组实体:

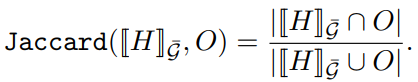

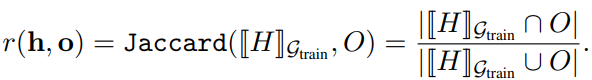

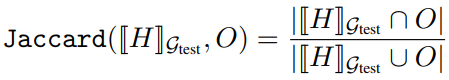

设O= { }表示一个观察,G是观察到的图谱, 是隐藏的图谱,溯因推理的目标就是在G上找到假设H,其在隐藏图 上的结论 与O最相似,在形式上,使用Jaccard指数对相似性进行量化:

3.2 方法

第一步,从观察到的训练知识图谱中随机抽样假设,首先随机选择一个假设,然后对训练图进行搜索以得出结论,然后将其视为与假设对应的观察结果。将假设和观察结果转换为序列,以输入给生成模型。对于观察,标准化每个元素的顺序,确保同一观测集合的排列产生相同的输出。观察中的每个实体都表示为一个唯一的分词,比如(Apple)和(Phone),并关联到一个嵌入表示。

图2 第一步,对观察-假设对进行采样

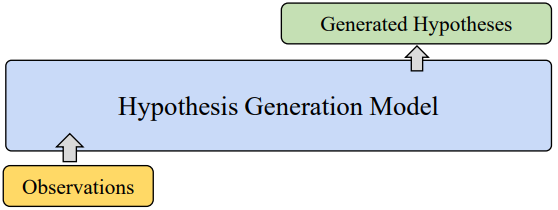

图3 第二步,训练假设生成模型

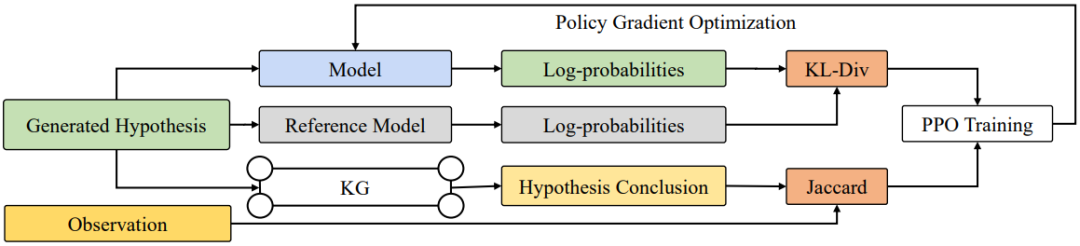

图4 第三步,使用RLF-KG优化假设生成模型

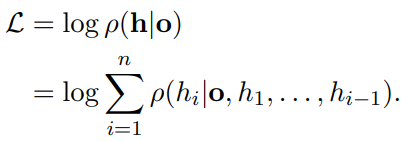

第二步,有监督训练一个假设生成模型。设O表示观察的分词序列,h表示假设,损失函数被定义为:

其中生成模型使用的是标准的Transformer。

第三步,为了解决模型对未知数据的局限性,本文采用强化学习结合知识图谱的反馈来增强训练好的条件生成模型ρ。奖励函数被定义为:

这里的模型ρ被视为参考模型,并用它初始化要优化的模型Π,然后引入KL散度惩罚来修改奖励函数。修改后的奖励为:

4. 实验

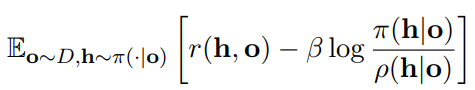

实验目的在于通过比较方法过程前后模型的Jaccard验证基于知识图谱的强化学习对增强假设生成模型的有效性。方法中对验证和测试假设做了一定的约束:与训练图 相比,每个验证假设必须在结论中包含额外的实体;与验证图 相比,每一个测试假设必须有额外的实体。数据集基本情况如下表:

表1 数据集统计

文中将构建的测试图视为隐藏图,其中包含10%的边,这些边在训练和评估阶段没有被观察到。给定一个观测值和生成的假设H,使用图搜索算法来确定H的结论:

为了使用ScoreSmatch评估复杂逻辑查询,本文将生成的假设H和引用假设 表示为 ,从而量化H与 对应的图之间的结构相似性。

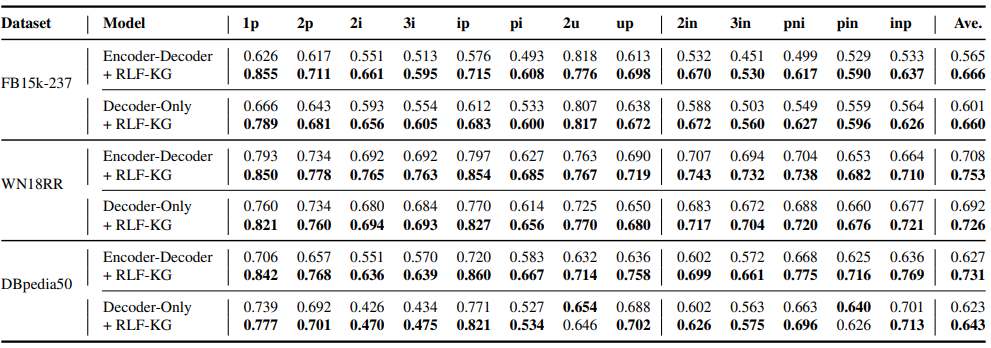

表2 FB15K-237、WN18RR和DBpedia50上13中假设类型的表现

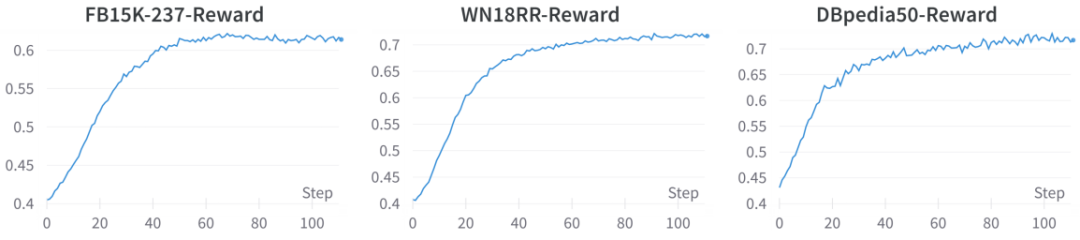

图5 RLF-KG训练在不同数据集上的奖励值

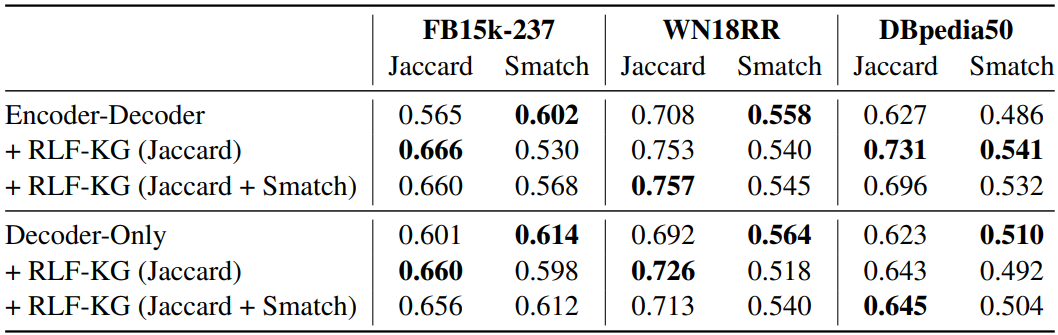

额外实验:本文还探索了将结构相似性注入PPO训练中使用的奖励函数所带来的好处,将 作为奖励函数中的额外项。

表3 Jaccard和Smatch表现出不同的奖励作用

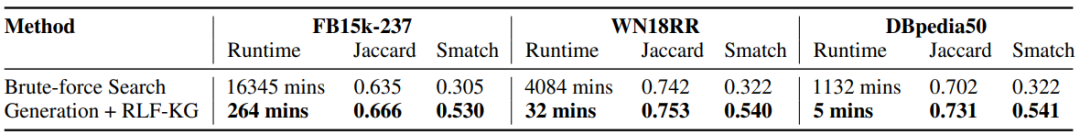

为了比较基于搜索的方法和生成式方法之间的差异,本文还进行了两种方法的对比试验。

表4 基于搜索的方法和生成式方法效率对比

5. 总结

本文研究了溯因逻辑与知识图谱结合的推理任务。同时提出了一种用于逻辑假设的生成式方法,从而解决知识图谱的不完整性和推理效率问题。此外,本文还论证了基于知识图谱的强化学习对增强假设生成模型的有效性。

如何学习大模型?

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。

这里给大家精心整理了一份全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

1. 成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

这里,我们为新手和想要进一步提升的专业人士准备了一份详细的学习成长路线图和规划。可以说是最科学最系统的学习成长路线。

2. 大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

3. 大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

4. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

5. 大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以微信扫描下方CSDN官方认证二维码,免费领取【

保证100%免费】

如有侵权,请联系删除

1725

1725

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?