目录

一、什么是PCA

主成分分析(Principal Component Analysis)是一种非监督的机器学习算法,它主要用于数据的降维,通过降维对数据可视化可以提高机器学习算法效率,方便于人类理解的特征。同时它还可以去噪,能够让机器学习算法识别率更好。

实现步骤如下:

- 将样本均值归为0(demean),即所有样本减去样本的均值

- 求一个轴方向w=(w1,w2),当我们所有样本映射到w之后,使得该方差值最大,即:

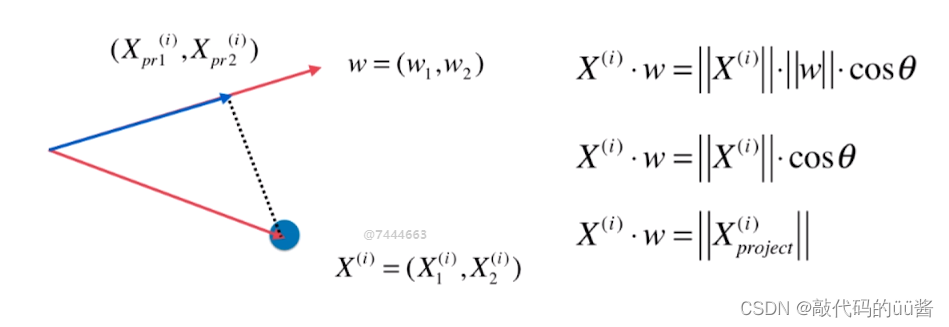

假设有一根红色的向量代表w=(w1,w2),一个蓝色的点代表X(i),它也是一个向量X(i)=(X1,X2),该点映射到w上的位置是(Xpr1,Xpr2),那么现在只需要求点X(i)在红色向量上那根蓝色的线距离,因此也推导出了如下公式:

因此,最终主成分分析问题转换成了一个目标函数的最优化问题,即求w,使得 最大。

二、使用梯度上升法求解PCA问题

1、相关原理

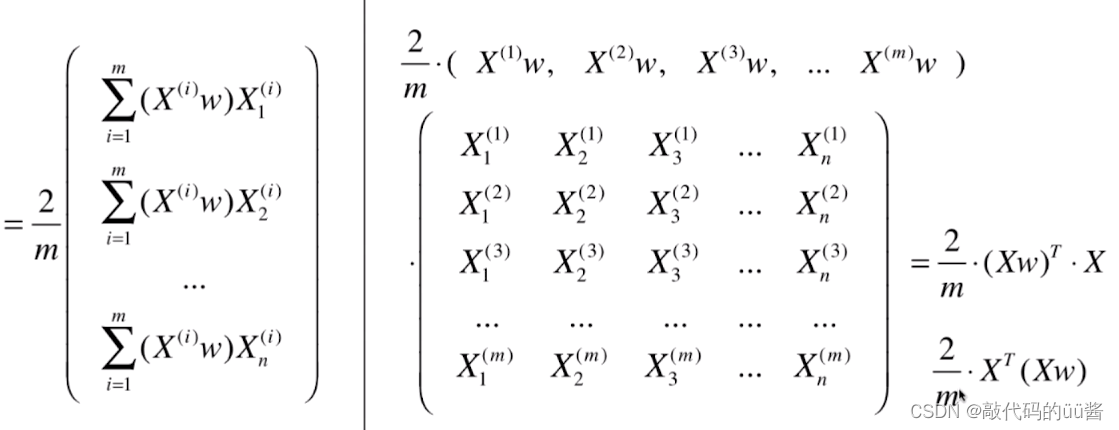

主成分分析问题目标:求w,使得 最大,对该式子进行推导如下:

因此,最终我们只需要求 这样一个式子即可。

2、具体实现

代码示例:

import numpy as np

import matplotlib.pyplot as plt

#生成虚拟测试用例

X = np.empty((100,2))

X[:,0] = np.random.uniform(0.,100.,size=100) #特征1——100个样本

X[:,1] = 0.75 * X[:,0] + 3.+ np.random.normal(0,10.,size=100) #特征2——与特征1有一个线性关系

#样本均值归0

def demean(X):

return X - np.mean(X,axis=0)

#设置目标函数

def f(w,X):

return np.sum((X.dot(w)**2)) / len(X)

##数学推导函数

def df_math(w,X):

return X.T.dot(X.dot(w)) * 2. / len(X)

#验证

def df_debug(w,X,epsilon=0.0001):

res = np.empty(len(w))

for i in range(len(w)):

w_1 = w.copy()

w_1[i] += epsilon

w_2 = w.copy()

w_2[i] -= epsilon

res[i] = (f(w_1,X) - f(w_2,X)) / (2 * epsilon)

return res

'''

在推导公式中,w实际上只代表方向,是一个单位向量,它的模=1;

但由于w = w + eta * gradient会导致w的模!=1,因此需要设置一个函数来使w始终保持为单位方向向量

'''

def direction(w):

return w / np.linalg.norm(w)

#梯度上升法

def gradient_ascent(df,X,initial_w,eta,n_iters = 1e4,epsilon=1e-8):

w = direction(initial_w)

i_iter = 0

while i_iter < n_iters:

gradient = df(w,X)

last_w = w

w = w + eta * gradient

w = direction(w) #每次求一个单位方向向量

if(abs(f(w,X) - f(last_w,X)) < epsilon):

break

i_iter += 1

return w

#随机一个初始向量——不能用0向量开始

initial_w = np.random.random(X.shape[1])

#训练

eta = 0.001

#gradient_ascent(df_debug,X_demean,initial_w,eta)

gradient_ascent(df_math,X_demean,initial_w,eta)

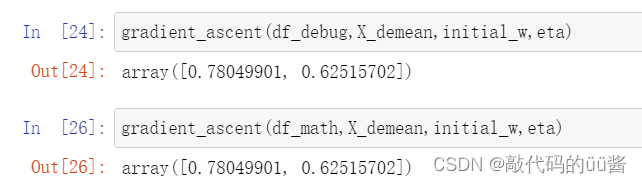

运行结果:

值得注意的是,在此过程中我们并没有使用StandardScaler标准化数据,这是因为PCA内部实现过程是基于用户给的数据X,如果X标准差为1,那么它的变化对于X来说并不是一个线性的变化,会导致最终求出来的主成分坐标轴方向和原始数据方向是不一样的。

代码示例:

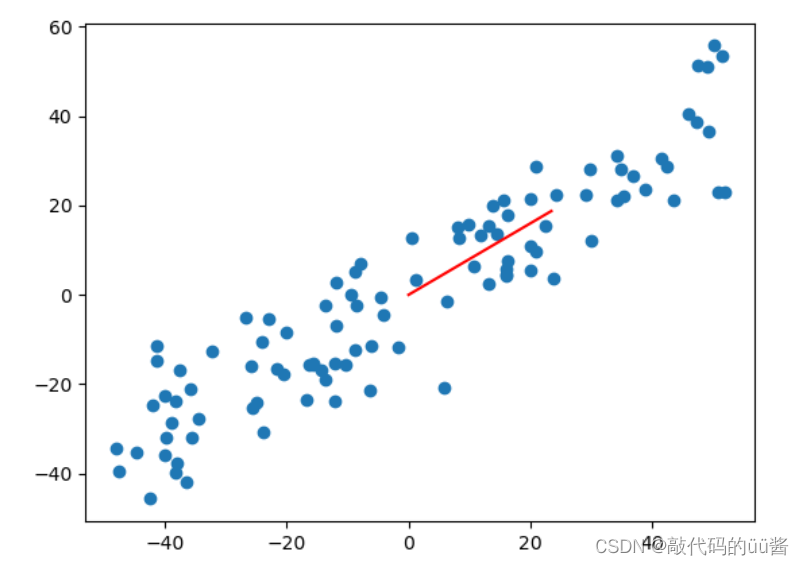

#可视化

w = gradient_ascent(df_math,X_demean,initial_w,eta)

plt.scatter(X_demean[:,0],X_demean[:,1])

plt.plot([0,w[0]*30],[0,w[1]*30],color='r')

plt.show()运行结果:

这根直线它对应的方向就是我们求出来的主成分,它把这些样本映射到这个轴上,并且样本间保持的方差是最大的。在这里它是我们求出来的第一个主成分,因此也叫做第一主成分。

3、求数据的前n个主成分

代码示例:

#求第二主成分

X2 = np.empty(X.shape)

for i in range(len(X)):

X2[i] = X[i] - X[i].dot(w) * w

w2 = gradient_ascent(df_math,X2,initial_w,eta)

#验证——如果结果趋近于0,则说明是w与w2互相垂直

w.dot(w2)运行结果:

![]()

代码示例:

#封装一个求前n个主成分的函数

def first_n_components(n,X,eta=0.01,n_iters = 1e4,epsilon=1e-8):

X_pca = X.copy()

X_pca = demean(X_pca)

res = []

for i in range(n):

initial_w = np.random.random(X_pca.shape[1])

w = gradient_ascent(df_math,X_pca,initial_w,eta)

res.append(w)

X_pca = X_pca - X_pca.dot(w).reshape(-1,1) * w #将减去分量的过程向量化

return res

#测试

first_n_components(2,X) #X只有两个维度,最多两个主成分运行结果:

![]()

265

265

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?