近年来,随着大型模型的发展,检索增强生成(Retrieval Augmented Generation)技术,简称 RAG,再次引起了广泛关注。在客服管理领域,RAG被视为目前最具潜力的大型语言模型(LLM)应用方案之一。各行业的领军企业都在积极构建内部知识库,如何充分利用这些资源,与客服管理相结合,赋能客服团队,其中蕴藏了大量商机和需求。

电商行业面临着客服流动性大的挑战。在淡季,可能只需要几个外包客服甚至兼职客服,而在旺季,则需要大量临时客服。在这个过程中,培训、管理和接待质检都是巨大的难题。因此,如何在客服管理方面进行成本降低和效率提高,成为整个行业亟需解决的问题。当企业希望提升客户服务水平时,将大模型用作客服协助工具成为一项极具吸引力的选项。

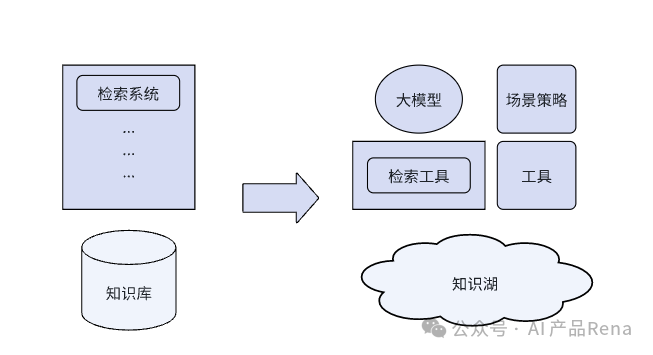

传统的检索系统通常需要建立一个结构化的、按目录分区管理的知识库,其中包含文档和表格等内容。用户在使用时需要类似搜索引擎的方式通过关键词检索,存在使用难度较大的问题,通常需要查阅多份资料、反复跳转才能找到答案。传统的知识库系统往往容易混乱和膨胀,导致治理成本高昂,个人常常会陷入知识查询和分析的困境中。客服更是难以掌握其中的知识结构和细节。在RAG技术的加持下,可以通过将相关文档输入到大型模型的方式,利用其强大的自然语言处理和机器学习能力,对文档进行分析和总结,直接给出答案内容。让大模型作为客服copilot是企业比较强的诉求。

由于大模型有比较强的阅读理解、分析推理、文本生成能力,一定程度也降低我们对于输入知识的严格要求,这也顺应了知识库升级知识湖的大趋势。

在开源领域中,结合大型模型的解决方案有多种选择。例如,像fastgpt和askanything这样的产品,以及像langchain和llama-index这样的开源项目,它们提供了许多实用案例。虽然这些方案可以解决一些文档知识的需求,但对于某些商品知识而言,利用向量相似度来实现精确匹配具有挑战性。举例来说,商品ID通常由数字和字母组成,重复率极高,因此向量相似度在召回效果上可能表现不佳。此外,单个商品的关联知识、属性和文档可能超过大型模型的token限制,需要进行裁剪才能处理。

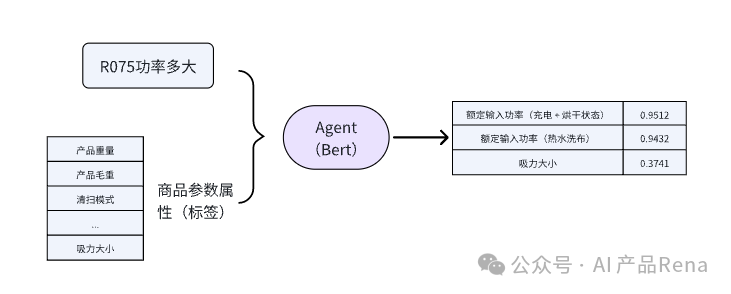

商家的商品参数知识通常以高度结构化的表格数据形式存在,大多存储在关系型数据库中,一个示例如下:

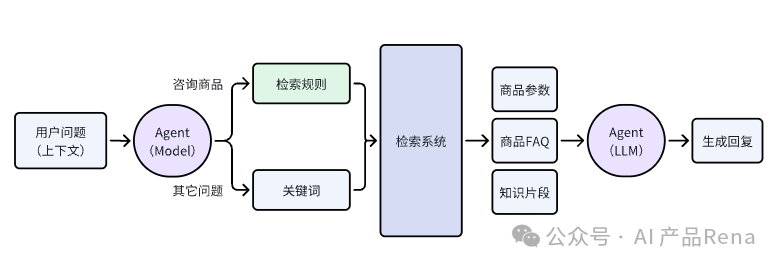

针对上面的知识结构,如果是用向量模型、语义检索来做召回,效果会大打折扣。开源的向量模型对于商品型号没有做过特殊的调优,语义层面无法很好地区分商品ID、型号、商品编号等无语义的内容,如不能精确区分R075与R075X是两个不同的商品,而基于开源模型微调成本较高且效果不可控;此外基于语义、关键词等召回无法满足范围检索的需求,比如客户需要某个尺寸、重量、价格范围内的——“长度不要超过4m”这样的诉求。所以可以补充一些工程的手段,如获取咨询过程中消费者发送的商品链接、下单信息等提取可能的商品ID。整体解决方案的关键需要一个基于业务且灵活的检索系统,除了常见的FAQ知识、文档之外还要能支撑表格的知识检索。

商品属性表非常大,有的品类的参数多达数百个,商品数更是多达数万个,需要扩展一个模型来进行更准确的recall。如商品参数问答、推荐得场景需要通过一些专属匹配模型来过滤相关属性。尤其商品检索、推荐等场景没有限定商品ID,整个知识内容会很长,上下文会超过大模型的token限制,从成本和性能层面考虑必须要做筛选。

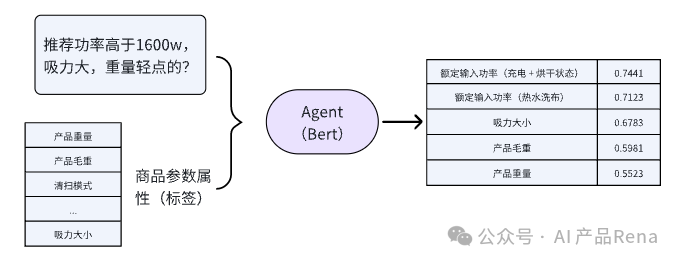

大型模型的强项在于分析决策,而非信息检索。如果将整个商品库交由大型模型处理,除了成本难以控制外,响应延迟可能较大,且无法保证回复质量。因此,将大型模型视作调用检索工具的大脑是更佳选择。鉴于商品数据通常以结构化形式存储于关系型数据库中,通过前期属性筛选可极大降低数据库IO压力。而余下的数据可通过构建规则语法进行进一步过滤。

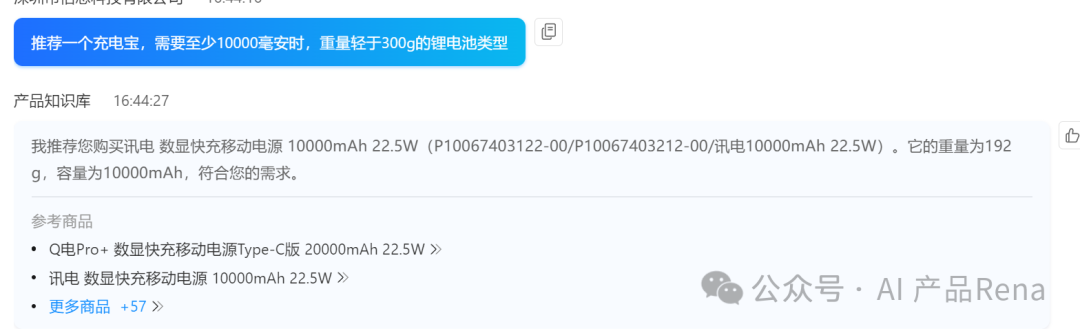

如下面的示例所示,可以让模型基于用户的问题生成规则,再拿这个规则匹配相关的数据

咨询问题:“推荐功率低于1600w的油烟机”`` ``{``type = "$gt",` `name = "功率",` `value = "1600w"``}`` ``// 进行规则运算过滤目标商品

线上实施效果显著,客服在处理咨询时能够快速地进行知识查询和回复,效果如同下文所示。我们已将此方案交付给多个客户使用,而他们的积极反馈也证实了这一方案的价值。

此外,RAG技术在电商客服领域的应用潜力巨大。以运营需求为例,我们可以利用RAG的智能推荐功能突出推广畅销商品,实现精准营销;而个性化回复则能够实现千人千面的定制化服务,提升用户体验。此外,通过引入rerank、人设等环节,我们能够进一步优化客服流程,提高问题解决效率,从而节省人力成本。未来,随着电商行业的不断发展,RAG技术在客服领域的应用前景仍然广阔,还有许多尚未被挖掘的优化空间等待我们去探索。

如何学习大模型 AI ?

由于新岗位的生产效率,要优于被取代岗位的生产效率,所以实际上整个社会的生产效率是提升的。

但是具体到个人,只能说是:

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段(10天):初阶应用

该阶段让大家对大模型 AI有一个最前沿的认识,对大模型 AI 的理解超过 95% 的人,可以在相关讨论时发表高级、不跟风、又接地气的见解,别人只会和 AI 聊天,而你能调教 AI,并能用代码将大模型和业务衔接。

- 大模型 AI 能干什么?

- 大模型是怎样获得「智能」的?

- 用好 AI 的核心心法

- 大模型应用业务架构

- 大模型应用技术架构

- 代码示例:向 GPT-3.5 灌入新知识

- 提示工程的意义和核心思想

- Prompt 典型构成

- 指令调优方法论

- 思维链和思维树

- Prompt 攻击和防范

- …

第二阶段(30天):高阶应用

该阶段我们正式进入大模型 AI 进阶实战学习,学会构造私有知识库,扩展 AI 的能力。快速开发一个完整的基于 agent 对话机器人。掌握功能最强的大模型开发框架,抓住最新的技术进展,适合 Python 和 JavaScript 程序员。

- 为什么要做 RAG

- 搭建一个简单的 ChatPDF

- 检索的基础概念

- 什么是向量表示(Embeddings)

- 向量数据库与向量检索

- 基于向量检索的 RAG

- 搭建 RAG 系统的扩展知识

- 混合检索与 RAG-Fusion 简介

- 向量模型本地部署

- …

第三阶段(30天):模型训练

恭喜你,如果学到这里,你基本可以找到一份大模型 AI相关的工作,自己也能训练 GPT 了!通过微调,训练自己的垂直大模型,能独立训练开源多模态大模型,掌握更多技术方案。

到此为止,大概2个月的时间。你已经成为了一名“AI小子”。那么你还想往下探索吗?

- 为什么要做 RAG

- 什么是模型

- 什么是模型训练

- 求解器 & 损失函数简介

- 小实验2:手写一个简单的神经网络并训练它

- 什么是训练/预训练/微调/轻量化微调

- Transformer结构简介

- 轻量化微调

- 实验数据集的构建

- …

第四阶段(20天):商业闭环

对全球大模型从性能、吞吐量、成本等方面有一定的认知,可以在云端和本地等多种环境下部署大模型,找到适合自己的项目/创业方向,做一名被 AI 武装的产品经理。

- 硬件选型

- 带你了解全球大模型

- 使用国产大模型服务

- 搭建 OpenAI 代理

- 热身:基于阿里云 PAI 部署 Stable Diffusion

- 在本地计算机运行大模型

- 大模型的私有化部署

- 基于 vLLM 部署大模型

- 案例:如何优雅地在阿里云私有部署开源大模型

- 部署一套开源 LLM 项目

- 内容安全

- 互联网信息服务算法备案

- …

学习是一个过程,只要学习就会有挑战。天道酬勤,你越努力,就会成为越优秀的自己。

如果你能在15天内完成所有的任务,那你堪称天才。然而,如果你能完成 60-70% 的内容,你就已经开始具备成为一名大模型 AI 的正确特征了。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

770

770

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?