大模型(如DeepSeek、Qwen等)参数规模动辄数百亿,全精度(FP32)存储和推理会占用大量显存且速度慢。而模型量化技术通过将浮点数压缩为低精度整数,不仅能让大模型“瘦身”至1/4甚至更小体积,还能显著提升推理效率。例如,175B参数的模型用FP32需700GB显存,而量化到INT4仅需约10GB。

一、概念解读

Quantization(模型量化)到底是个啥?

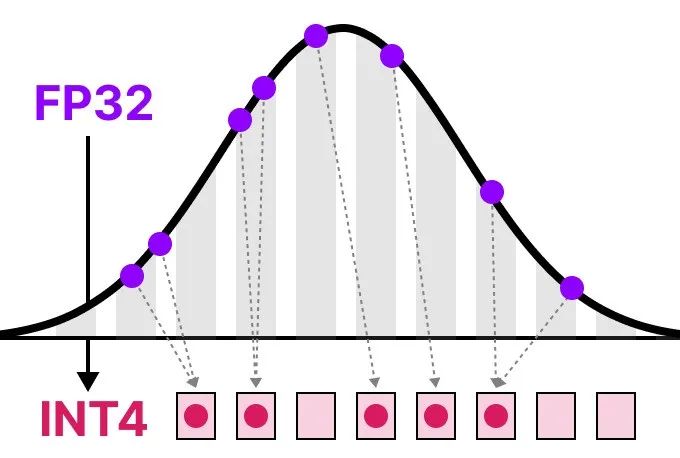

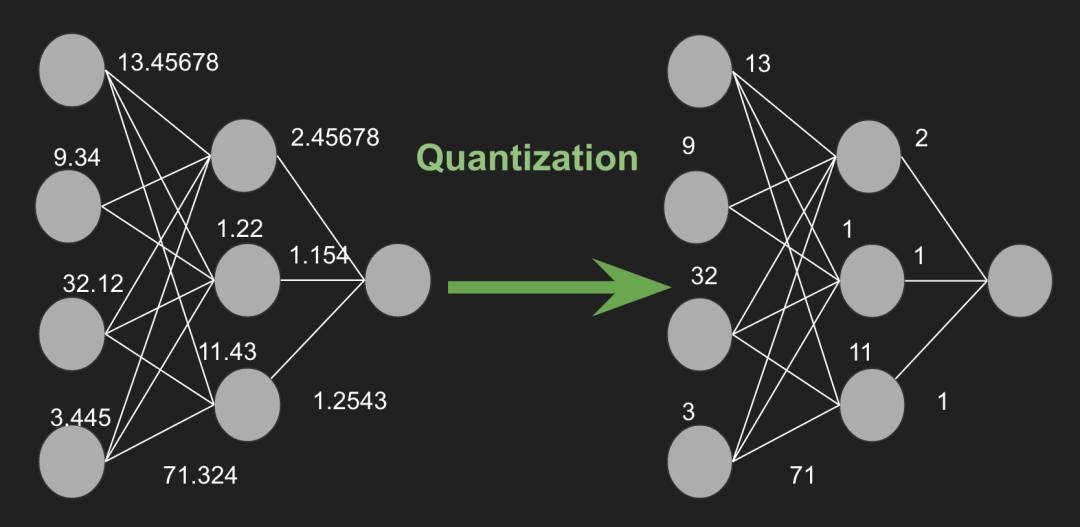

模型量化是一种参数压缩与加速技术,其核心逻辑是将模型中的高精度浮点数(如32位浮点数 FP32)转换为低精度整数(如8位整数 INT8 或4位整数 INT4),从而减少存储空间、提升推理速度并降低硬件能耗。

- FP32(浮点数):如同用科学计算器处理小数运算,精度高但计算慢、耗电多。

- INT8(整数):如同用算盘处理整数运算,速度快、能耗低,但需通过“单位换算”保证结果接近。

模型量化的本质是通过数学映射,在精度损失可控的前提下,将模型参数从“高精度”转换为“低精度”,实现性能与效率的平衡。

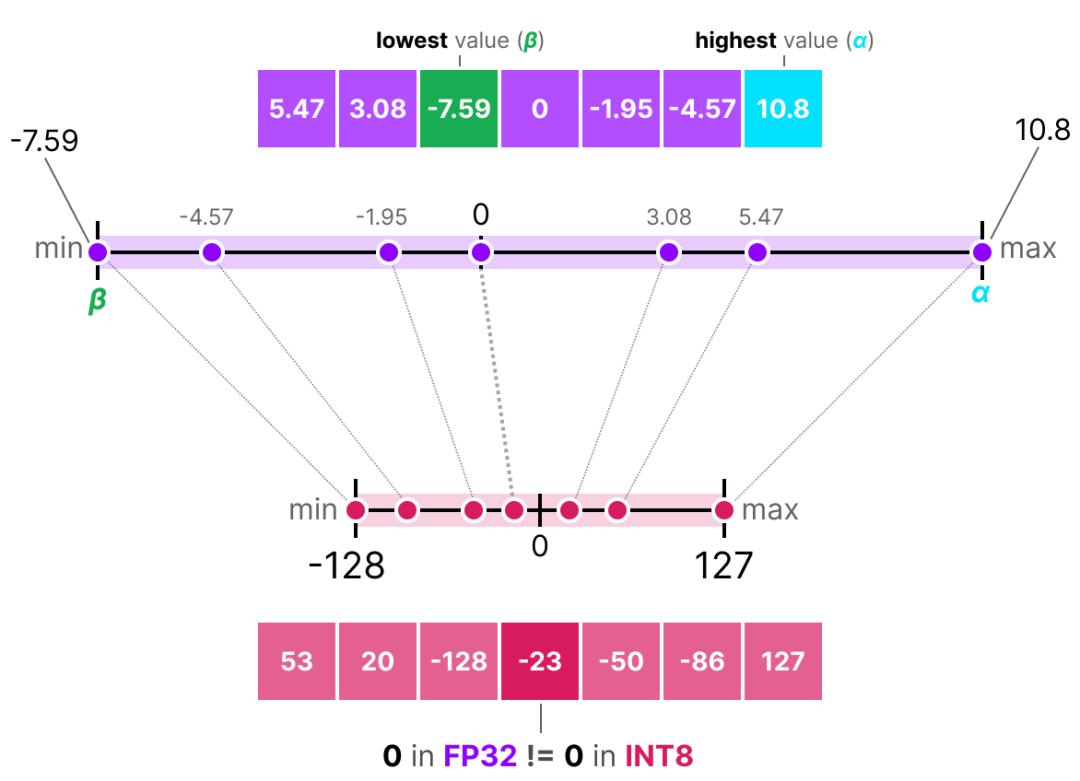

1. 确定量化范围

找到参数或激活值的最小值(min)和最大值(max)。

例如:权重参数范围:min=-1.2, max=0.8;激活值范围:``min=0.1, max=5.6。

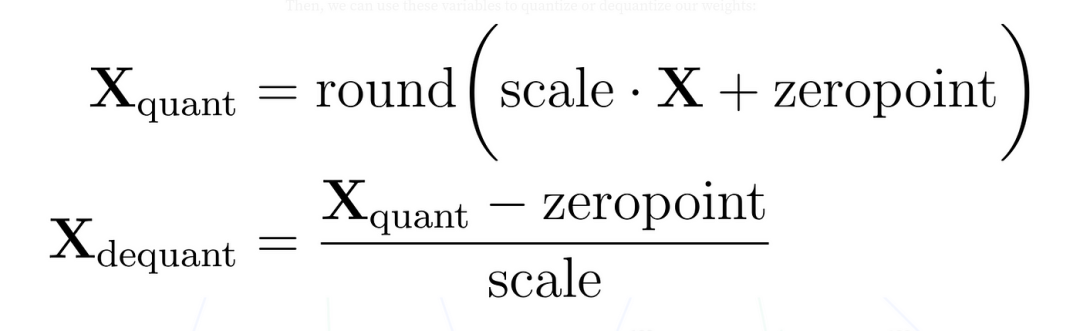

2. 计算缩放因子(Scale)与零点(Zero Point)

(1)缩放因子: scale = (max - min) / (2^n - 1)(``n为量化位数,如 INT8 时n=8,2^8-1=255)

(2)零点:zero_point = round(-min / scale)(确保浮点数 ``0 映射到整数 0,避免负数溢出)

例如:若 min=-1.2, max=0.8,INT8 量化:scale = (0.8 - (-1.2)) / 255≈0.00784,zero_point = round(-(-1.2) / 0.00784) ≈ 153

3. 量化与反量化公式

(1)量化:q = round(x / scale) + zero_point(将浮点数 x 映射为整数 q)

(2)反量化:x' = (q - zero_point) * scale(将整数 q 还原为浮点数x')

为什么需要Quantization(模型量化)?

为什么需要Quantization(模型量化)?

模型量化通过压缩内存占用和提升计算带宽效率,破解硬件资源受限与实时性需求矛盾。

- 存储维度:

INT8压缩4倍,INT4压缩8倍,实现“大象变蚂蚁”; - 带宽维度:内存访问量减少75%,推理速度提升2-4倍,打通“高速专线”。

二、技术实现

Quantization(模型量化)如何进行技术实现?

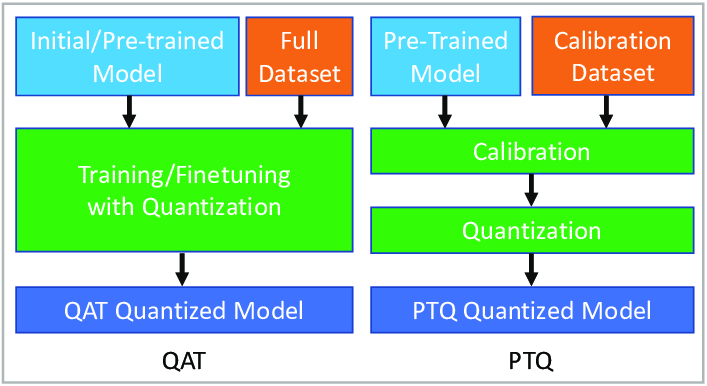

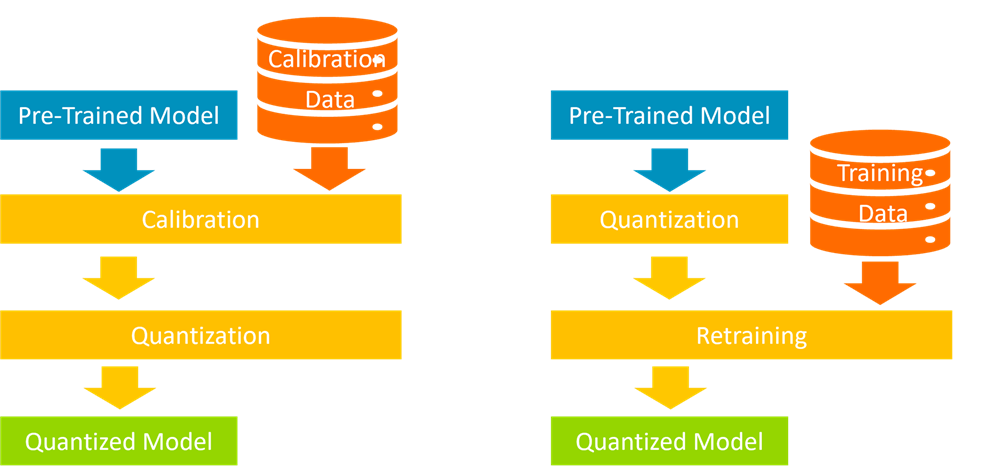

模型量化主要通过训练后量化(Post-Training Quantization,PTQ)和量化感知训练(Quantization Aware Training,QAT)两种方式实现。

1. PTQ(训练后量化)技术实现

PTQ在模型训练完成后,使用少量校准数据来估计权重和激活值的动态范围,进而确定量化参数(如缩放因子和零点),无需重新训练模型。实现简单,无需重新训练模型,能够显著减少计算开销和内存占用,适用于大多数场景。

2. QAT(量化感知训练)技术实现

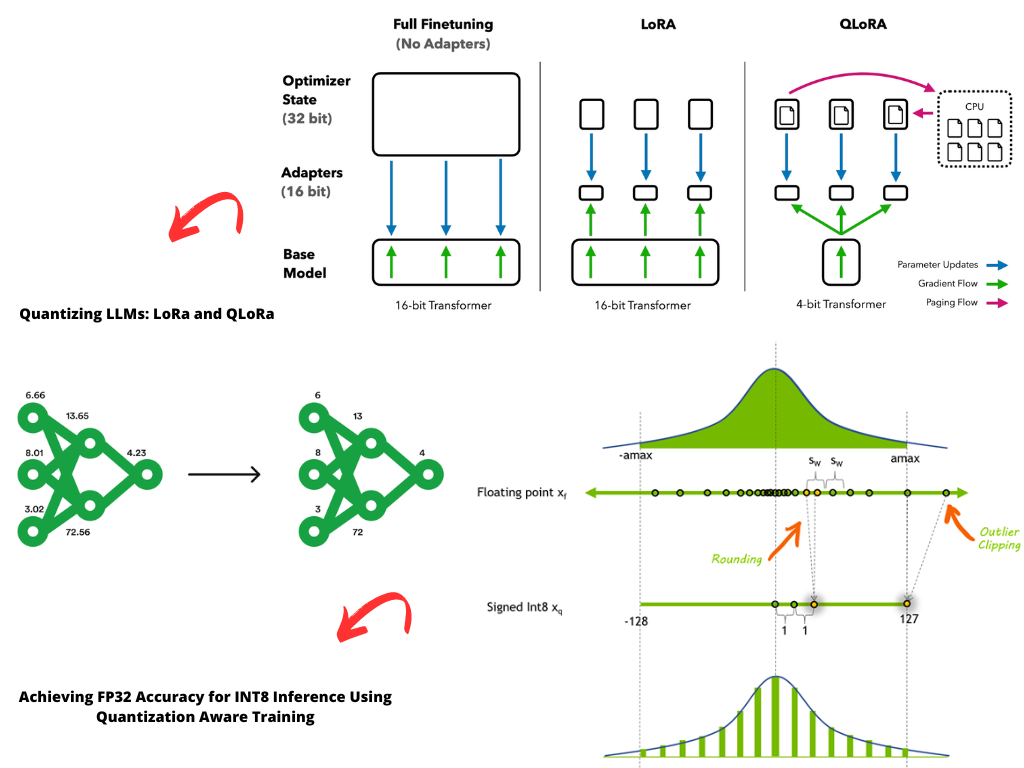

QAT在模型训练过程中就考虑量化效果,通过插入伪量化节点来模拟量化操作,模型在训练时即考虑到了量化误差,并通过反向传播算法调整模型的权重,从而使模型在量化后的推理阶段能够保持较高的精度。由于在训练过程中考虑了量化误差,QAT通常能保证量化后的模型精度接近未量化模型,适用于对精度要求较高的应用场景。

PyTorch如何实现Quantization(模型量化)?

PyTorch作为主流的深度学习框架,提供了完整的量化工具链,支持训练后量化(PTQ)、量化感知训练(QAT)和动态量化等多种方式。

1. 动态量化(Dynamic PTQ)

import torch

from torch.quantization import quantize_dynamic

# 加载预训练模型

model = torch.load('model.pth')

model.eval()

# 动态量化(量化Linear和LSTM层)

quantized_model = quantize_dynamic(

model,

{torch.nn.Linear, torch.nn.LSTM}, # 指定量化层类型

dtype=torch.qint8

)

2. 静态量化(Static PTQ)

from torch.quantization import prepare, convert

# 准备校准数据集

def calibrate(model, data_loader):

model.eval()

with torch.no_grad():

for inputs in data_loader:

model(inputs)

# 配置量化参数

model.qconfig = torch.quantization.get_default_qconfig('fbgemm')

model_prepared = prepare(model) # 插入Observer节点

calibrate(model_prepared, data_loader) # 校准激活值范围

quantized_model = convert(model_prepared) # 转换为量化模型

3. 量化感知训练(QAT)

from torch.quantization import prepare_qat, FakeQuantize

# 定义QAT模型

model.qconfig = torch.quantization.get_default_qat_qconfig('fbgemm')

model_prepared = prepare_qat(model) # 插入伪量化节点

# 训练阶段(模拟量化误差)

optimizer = torch.optim.SGD(model_prepared.parameters(), lr=0.01)

for inputs, labels in train_loader:

outputs = model_prepared(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

# 转换至最终量化模型

quantized_model = convert(model_prepared)

三、如何系统学习掌握AI大模型?

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。

这里给大家精心整理了一份

全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

1. 成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

这里,我们为新手和想要进一步提升的专业人士准备了一份详细的学习成长路线图和规划。可以说是最科学最系统的学习成长路线。

2. 大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

3. 大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

4. 2024行业报告

行业分析主要包括对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

5. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

6. 大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以

微信扫描下方CSDN官方认证二维码,免费领取【保证100%免费】

260

260

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?