深度可分离卷积其实是一种可分解卷积操作(factorized convolutions)。其可以分解为两个更小的操作:depthwise convolution 和 pointwise convolution。

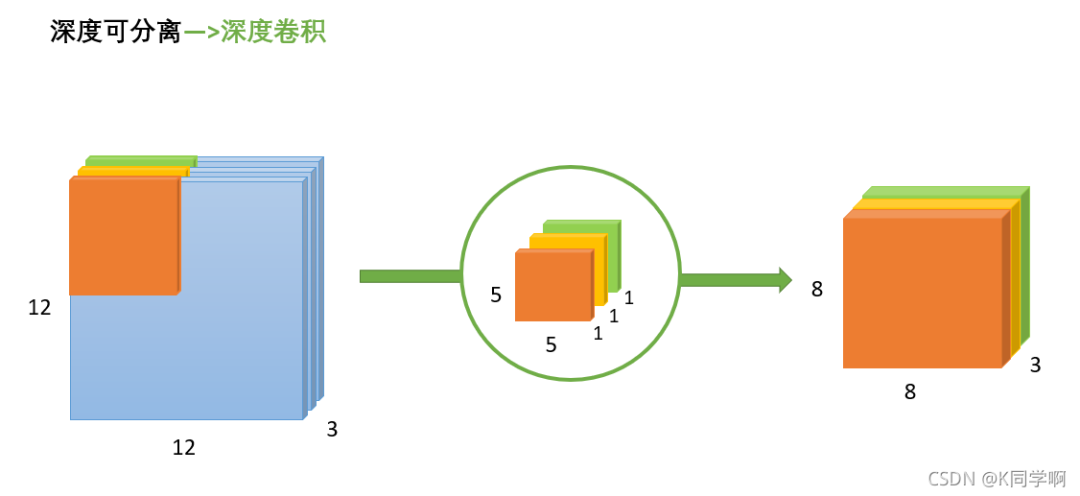

深度卷积

与标准卷积网络不一样的是,这里会将卷积核拆分成单通道形式,在不改变输入特征图像的深度的情况下,对每一通道进行卷积操作,这样就得到了和输入特征图通道数一致的输出特征图。如上图,输入12*12*3 的特征图,经过5*5*3的深度卷积之后,得到了8*8*3的输出特征图。输入和输出的维度是不变的3,这样就会有一个问题,通道数太少,特征图的维度太少,能获得足够的有效信息吗?

(3)逐点卷积

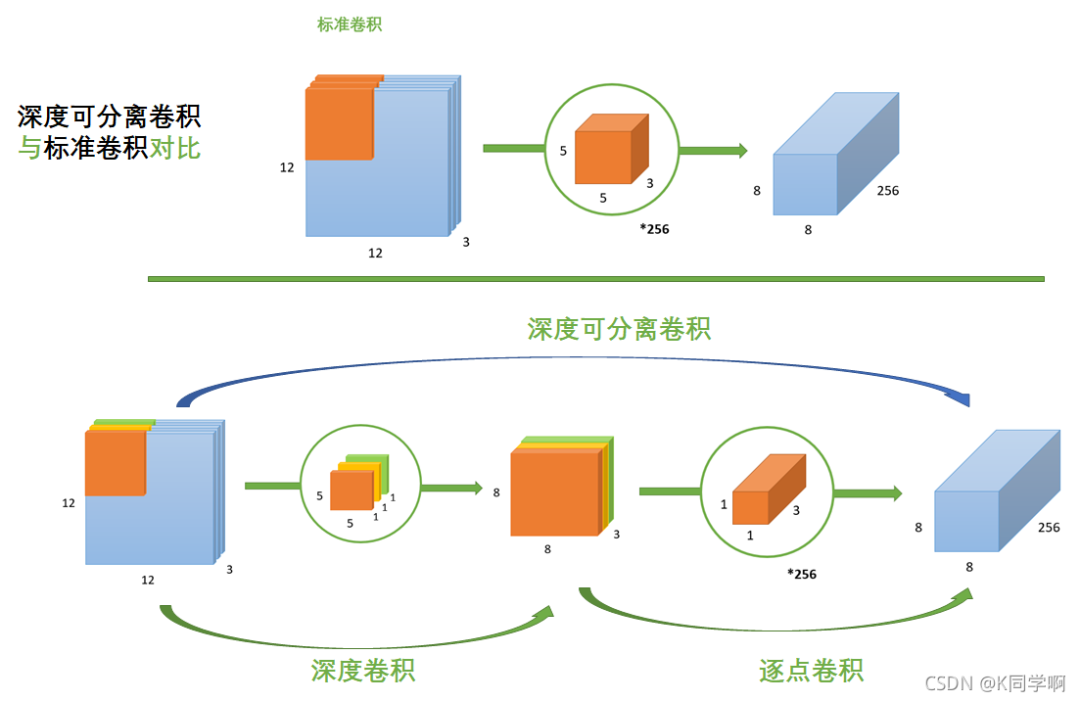

逐点卷积就是1*1卷积,主要作用就是对特征图进行升维和降维,如下图:

在深度卷积的过程中,我们得到了8*8*3的输出特征图,我们用256个1*1*3的卷积核对输入特征图进行卷积操作,输出的特征图和标准的卷积操作一样都是8*8*256了。

标准卷积与深度可分离卷积的过程对比如下:

(4)为什么要用深度可分离卷积?

深度可分离卷积可以实现更少的参数,更少的运算量。

将卷积乘法变成加法来实现相同的效果

1582

1582

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?