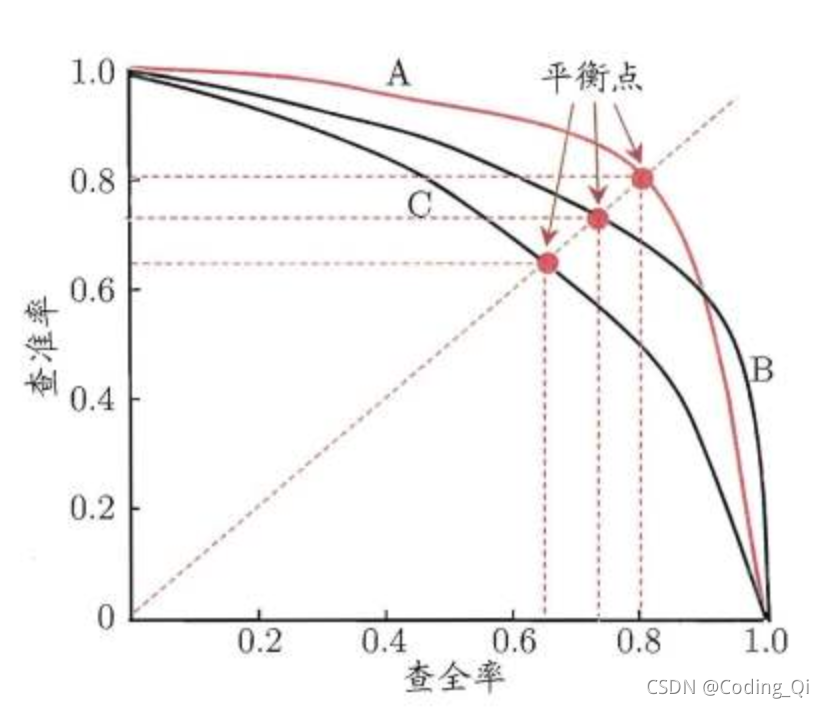

1、PR曲线

P-R曲线是精确率precision与召回率recall 曲线,以recall作为横坐标轴,precision作为纵坐标轴。在介绍精确率和召回率之前,先来看下如下的混淆矩阵:

| 真实情况\预测结果 | 正 | 负 |

| 正 | TP | FN |

| 负 | FP | TN |

把正例正确分类为正例,表示为TP(true positive),把正例错误分类为负例,表示为FN(false negative)

把负例正确分类为负例,表示为TN(true negative), 把负例错误分类为正例,表示为FP(false positive)

通过混淆矩阵可以计算出精确率precision和召回率recall:

此外还介绍两个和PR曲线无关的定义,TPR(敏感度)和TNR(特异度):

TPR(敏感度): 识别出的正例占所有实际正例的比例

TNR(特异度): 识别出的负例占所有实际负例的比例

介绍完准确率和召回率就可以绘制P-R曲线了。(说明:准确率又叫查准率,召回率又叫查全率)

平衡点BEP (Break-Event Point)是查准率=查全率时的取值。

一个重要的问题就是:如何通过P-R曲线比较两个机器学习模型的效果呢?

若一个学习器的P-R曲线被另一个学习器的曲线完全“包住”,则包住者性能优于被包住者

若2个P-R曲线交叉,则难于断言谁好谁坏,合理的判据是比较P-R曲线下的面积大小,但不

容易估算,设计了一些综合考虑查准率和查全率的性能度量,比如BEP。

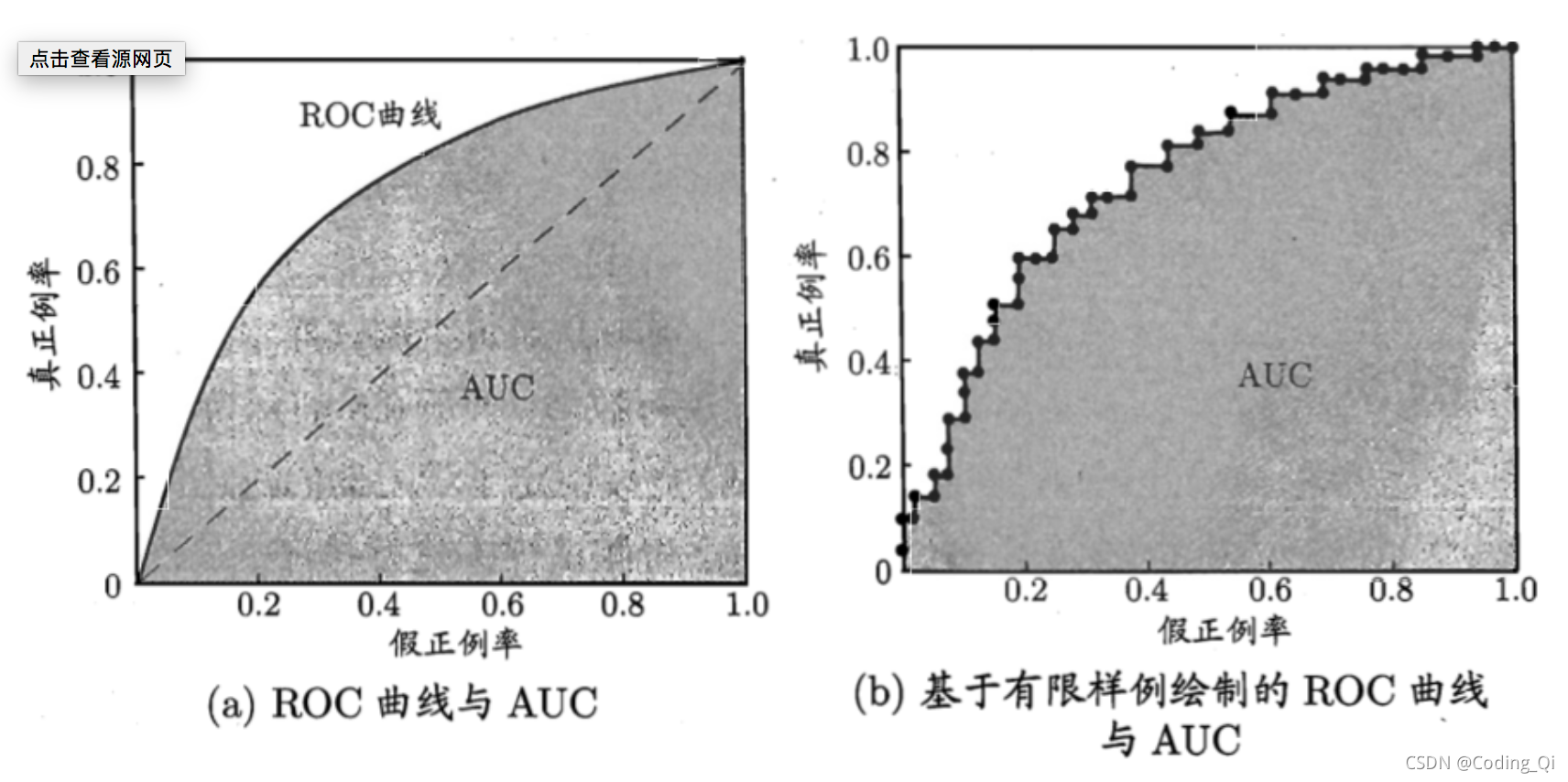

2、ROC曲线

首先介绍两个概念ROC和AUC:

ROC : Receiver Operating Characteristic

——受试者工作特征,用于比较不同分类器的相对性能

AUC : Area Under ROC Curve

——ROC曲线下的面积,提供了评价模型平均性能的另一种办法

随机猜测的模型位于连接点 (TPR=0,FPR=0) 和 (TPR=1,FPR=1) 的主对角线上

Why?

以固定概率p分为正类,比如包含n+正实例,n-负实例期望正确分类pn+个正实例误分pn-个负实例,因此

于是TPR = FPR,因此位于对角线上。

6028

6028

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?