三、目标:爬取所有股票每天每一分钟的数据,并且进行数据分析

四、最终效果图:

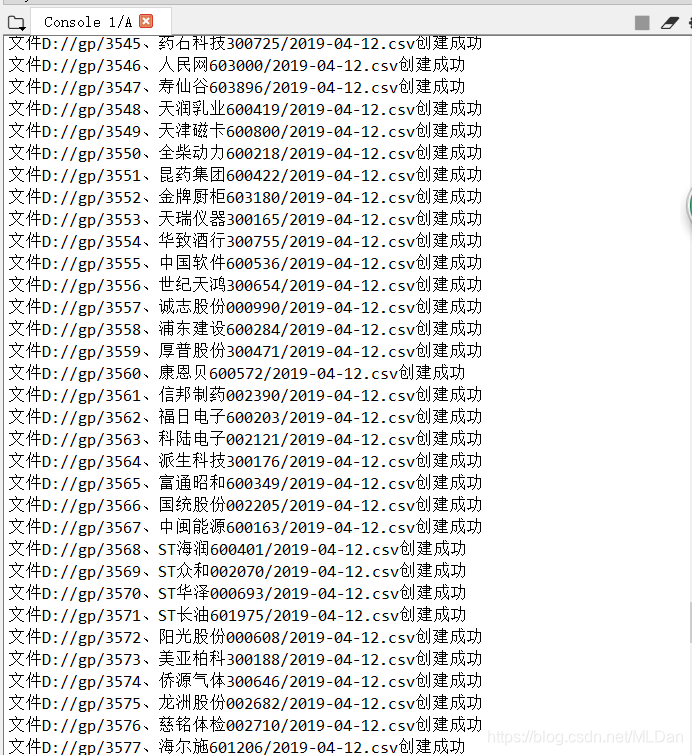

爬虫结果图

数据展示图

五、程序代码解析(源代码下载地址及数据库文章底部会提供):

1、把所有股票的基本信息都保存在一个mysql数据库中gp.sql,总过三千六百多条,如下图:

2、获取股票当天所有的数据get_gp_detail.py:

import pymysql

import numpy as np

import sys

import json

import urllib.request

import urllib

import os

import time

#连接数据库

db = pymysql.connect(host='127.0.0.1',user='root',password='root',db='gp_db',port=3306)

#获取cursor

cursor = db.cursor()# 使用 execute() 方法执行 SQL,如果表存在则删除

sql = "select * from gp"

cursor.execute(sql)

print("SELECT OK")

#all_gp = cursor.fetchmany(1)

all_gp = cursor.fetchall() #从数据库中获取所有股票的基本信息数据

arr = np.array(all_gp) #转化为numpy数据格式

now = int(time.time())

#转换为其他日期格式,如:"%Y-%m-%d %H:%M:%S"

timeStruct = time.localtime(now)

strTime = time.strftime("%Y-%m-%d", timeStruct)

gp_count = 1 #股票当天所有数据的保存编号

def mkdir(path): #股票保存路径函数

folder = os.path.exists(path)

if not folder: #判断是否存在文件夹如果不存在则创建为文件夹

os.makedirs(path) #makedirs 创建文件时如果路径不存在会创建这个路径

print(path)

def getData(url): #函数——从接口中获取单只股票当天每分钟的数据

content = ""

try: #网络会偶发出现奔溃情况,为了保证不中断和保证数据齐全,休息5秒重新执行

response = urllib.request.urlopen(url)

content = response.read().decode('utf-8')

except:

print("发生网络异常")

time.sleep(5)

return getData(url)

if content != "":

return content

else:

print("内容为空")

return getData(url)

def csv_create(path, msg): #函数——将单只股票的数据保存进指定文件夹

file = open(path,'w')

file.write(msg)

print("文件"+path+"创建成功")

file.close()

def tranformToCSV(content,filepath): #函数——将下载的数据转换为csv数据,以便读取

content = content.replace("(","").replace(")","")

json_str = json.loads(content)

a_str = json_str.get("data")

a_time = json_str.get("info").get("time")

a_date = str(a_time).split(" ")

mkdir(filepath)

array_str = np.array(a_str)

csv_str = "time,first,second,third,fourth\n" #time为当天时间点,first为该分钟股票价格

for item in array_str:

item = str(item)

items = item.split(",")

itemss = (str(items[0])).split(" ")

items0 = itemss[1]

csv_str += '"'+items0+'",'+items[1]+','+items[2]+','+items[3]+','+items[4]+'\n'

csv_create(filepath+"/"+a_date[0]+".csv",csv_str)

for item in arr:

url = "http://pdfm.eastmoney.com/EM_UBG_PDTI_Fast/api/js?rtntype=5&id="+item[3]+item[1]+"&type=r&iscr=false"

data = getData(url)

item2 = item[2].replace("*","")

tranformToCSV(data,"D://gp/"+str(gp_count)+"、"+item2+item[3]) #股票信息的保存路径是(D://pg/序号+股票名字+股票代号/日期.csv)

gp_count = gp_count+1;

# 使用 DebugLog

db.commit()

db.close()

get_gp_detail.py程序正确运行之后,D盘中将会出现我们所需要的数据,如下图:

3、对数据进行简单呈现plt_show.py:

import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

o=open('D:/gp/1045、广州港601228/2019-04-01.csv')

table = pd.read_csv(o)

plt.plot(table['time'], table['first'])

plt.rcParams['figure.figsize'] = (30.0, 20.0)

plt.show()

pd.to_numeric(table["first"],errors="ignore")

#print(table["first"])

max = np.argmax(table["first"],axis=1)

min = np.argmin(table["first"],axis=0)

wave_price = table["first"][max]-table["first"][min]

wave_price_rate = wave_price/table["first"][0]

final_wave_price = table["first"][240]-table["first"][0]

final_wave_price_rate = final_wave_price/table['first'][0]

print("最大值"+str(table["first"][max]))

print("最小值"+str(table["first"][min]))

print("波动区间"+str(wave_price))

print("波动幅度%.2f%%"% (wave_price_rate * 100))

print("最终价格差距"+str(final_wave_price))

print('最终价格幅度%.2f%%' % (final_wave_price_rate * 100))

效果图:

4、对所有股票数据进行简单的筛选和分析,筛选出2019-04-12,当天下午两点到三点之间,突然拉伸超过3%的所有股票并且保存进数据库find_feature.py:

import pymysql

import pandas as pd

import numpy as np

import matplotlib.pyplot as plt

文末有福利领取哦~

---------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------

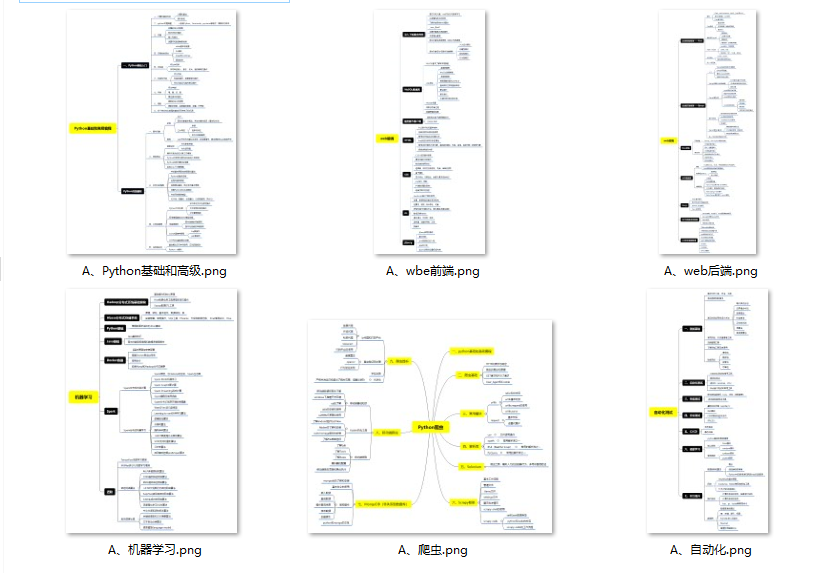

👉**一、Python所有方向的学习路线**

Python所有方向的技术点做的整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

👉**二、Python必备开发工具**

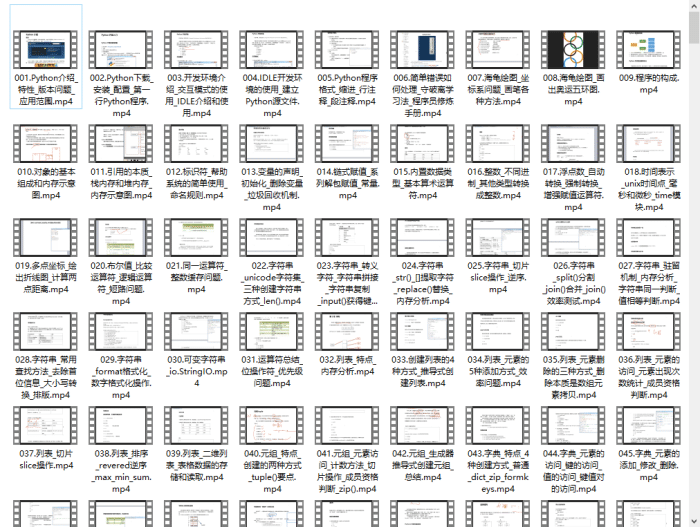

👉**三、Python视频合集**

观看零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

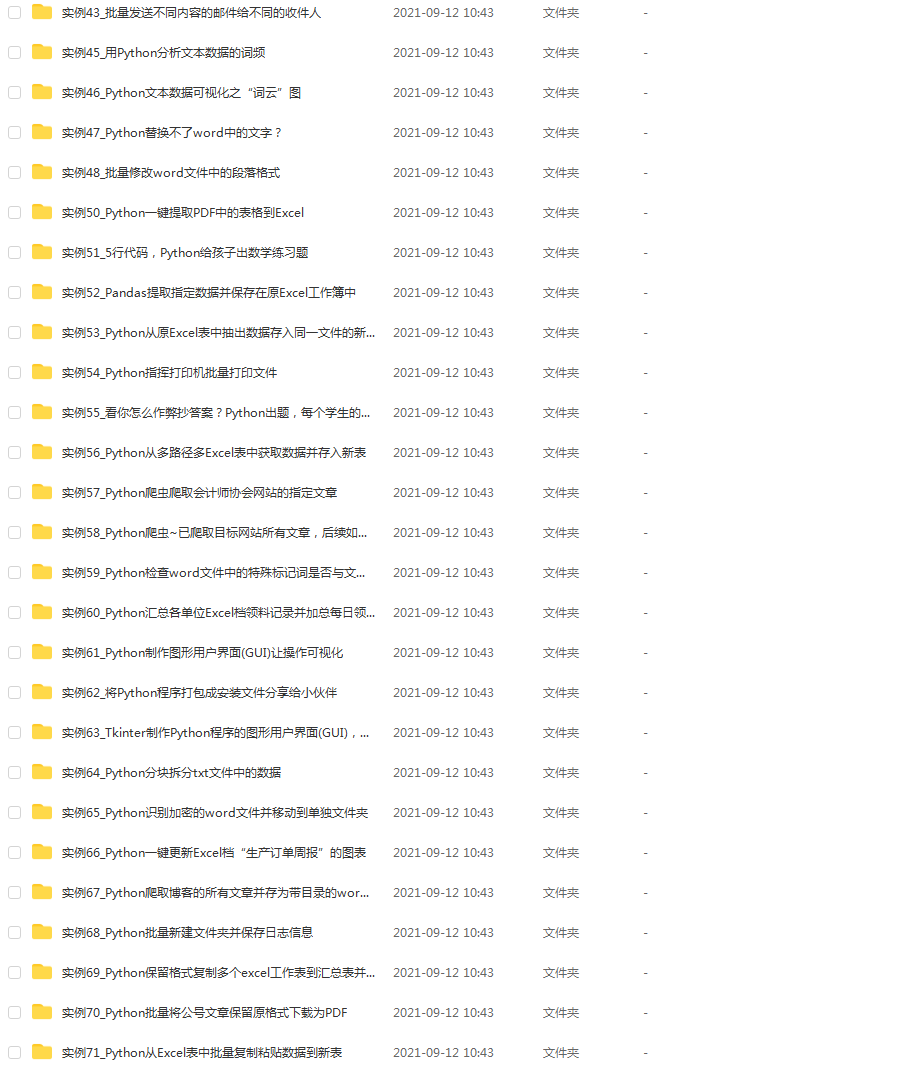

👉 **四、实战案例**

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。**(文末领读者福利)**

👉**五、Python练习题**

检查学习结果。

👉**六、面试资料**

我们学习Python必然是为了找到高薪的工作,下面这些面试题是来自阿里、腾讯、字节等一线互联网大厂最新的面试资料,并且有阿里大佬给出了权威的解答,刷完这一套面试资料相信大家都能找到满意的工作。

👉因篇幅有限,仅展示部分资料,这份完整版的Python全套学习资料已经上传

**网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。**

**[需要这份系统化学习资料的朋友,可以戳这里无偿获取](https://bbs.csdn.net/topics/618317507)**

**一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!**

3716

3716

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?