简介

支持向量机(support vector machines, SVM)是一种二分类模型,它的基本模型是定义在特征空间上的间隔最大的线性分类器,它通过在样本空间中找到一个划分超平面,将不同类别的样本分开,同时使得两个点集到此平面的最小距离最大,两个点集中的边缘点到此平面的距离最大。

也就是我们需要找到能够分离数据的最大间隔的这个分隔点,随着维度的上升,可以从一条直线上升到平面、超平面。

原理

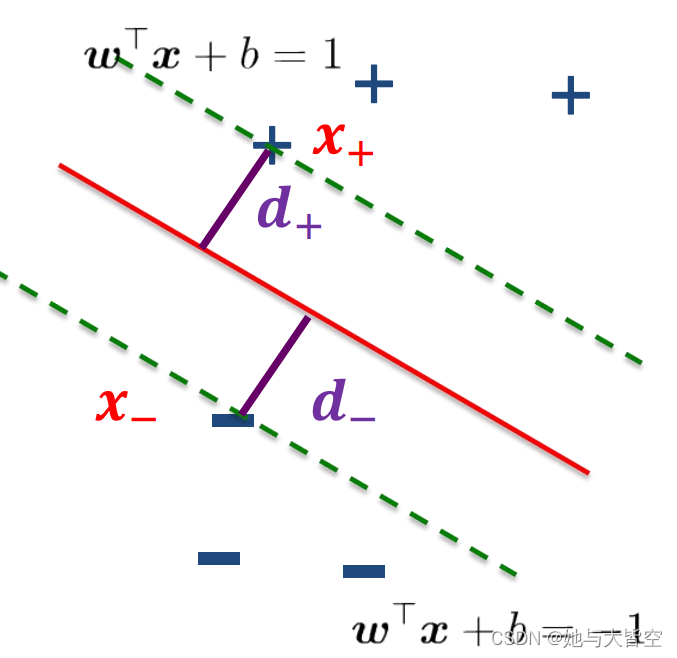

我们所要求的就是中间这条直线,其特征是使d最大。d的计算如下:

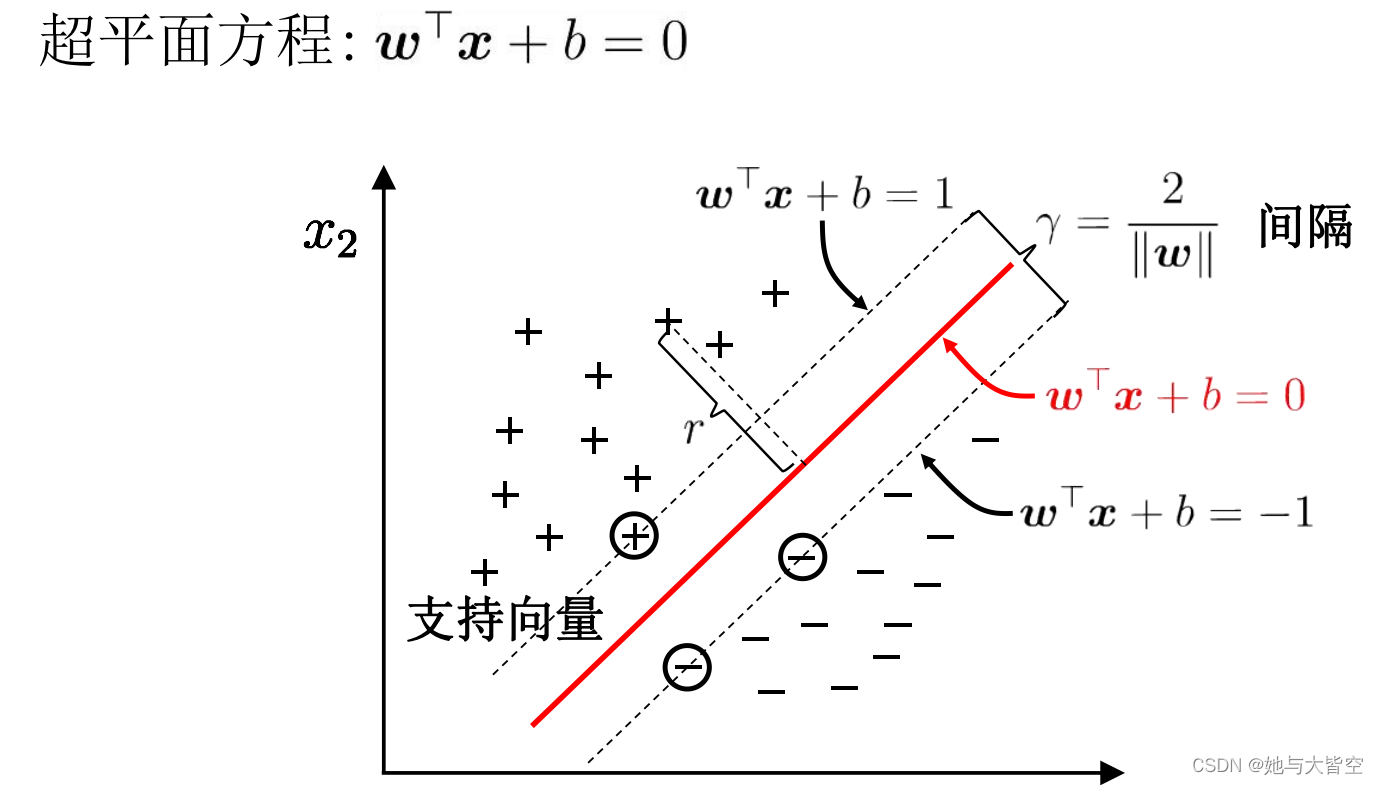

当我们拓展到超平面的时候就会得到如下结果

前面我们提到,我们的目地就是使这个间隔最大化,也就是寻找满足间隔最大化的表达式,通过机器学习确定其参数w和b。

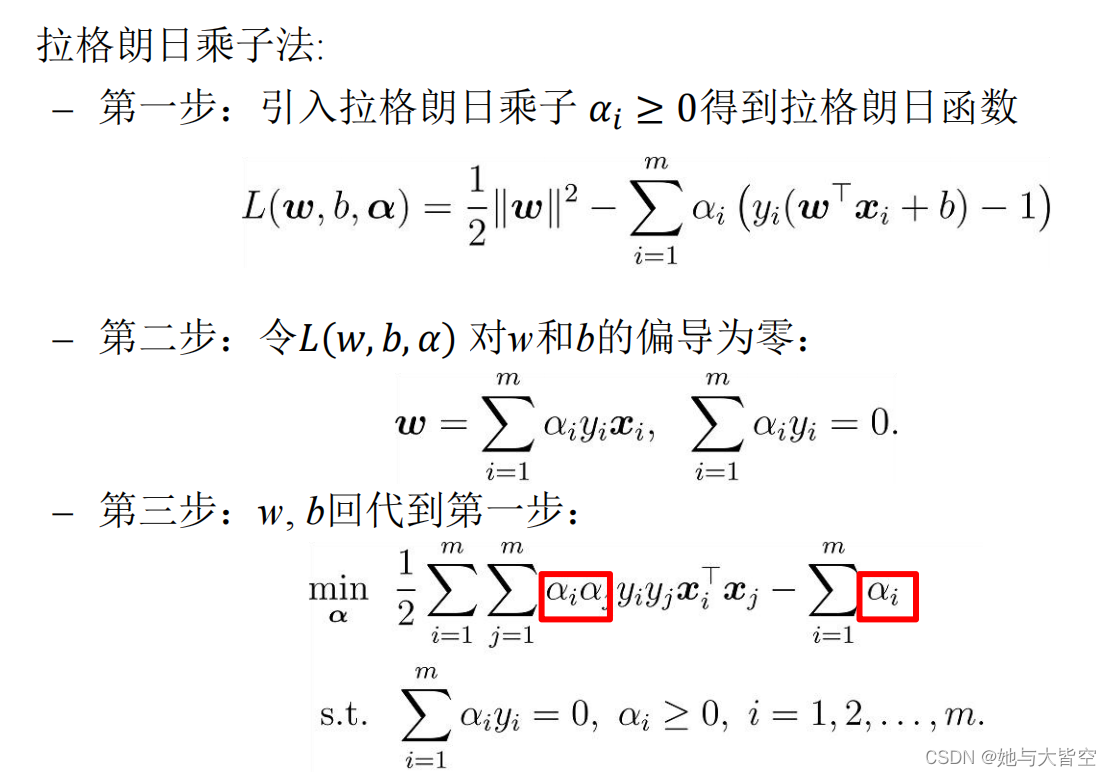

对偶问题

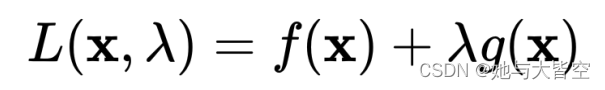

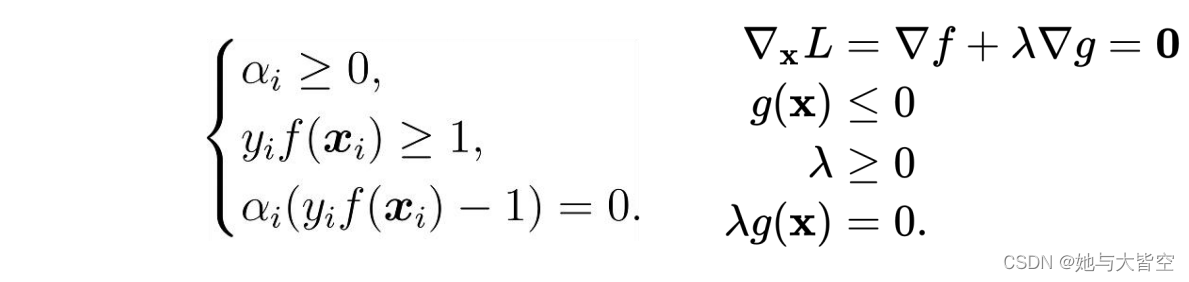

给定一个目标函数 f : Rn→R,希望找到x属于Rn ,在满足约束条件g(x)=0的前提

,将其转化为求解该拉格朗日函数的最小值,然后通过求偏导的方式求得解。这里引入拉格朗日乘子法来求解我们所需要的解

,将其转化为求解该拉格朗日函数的最小值,然后通过求偏导的方式求得解。这里引入拉格朗日乘子法来求解我们所需要的解

核函数

我们刚刚讨论的硬间隔和软间隔都是在说样本的完全线性可分或者大部分样本点的线性可分,但是我们也可能遇到线性不可分的情况,此时我们就需要引入核函数,核函数的特征就是线性不可分,高维可分。将原本的样本映射到更高维的空间,使其在更高维的空间线性可分。

软间隔

实际应用中,很难选择合适的核函数,使样本在特征空间中线性可 分; 此外,线性可分的结果也很难断定是否是由过拟合造成的.也就是我们允许个别不满足要求的样本存在,在满足约束条件的前提下我们要求这部分不满足要求的样本尽可能的少。

支持向量回归

我们允许模型输出与实际输出之间存在2θ的偏差,在偏差以内的输出我们不计算其损失。

17万+

17万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?