卷积神经网络统一处理输入特征。然而,并非所有特征对网络的预测都具有同等重要性。输入的某些部分可能比其他部分具有更重要的语义特征。因此,注意力机制变得必要,以根据其重要性动态地权衡特征,并选择输入的最关键部分。选择性地关注重要特征提高了网络学习区分性特征表示的能力,这可能会减少计算负荷。

注意力方法可以分为五类:通道注意、空间注意、时间注意、分支通道和混合注意。混合注意方法结合了其余方法,如通道和空间或空间和时间的注意。通道注意力将注意力引导到特定的输入部分(注意什么);空间注意力表明注意力应该指向哪里(在哪里注意);时间注意指定何时优先考虑基本特征(何时注意);而分支注意力描述了输入的哪个部分值得注意(需要注意的),主要用于多分支架构。

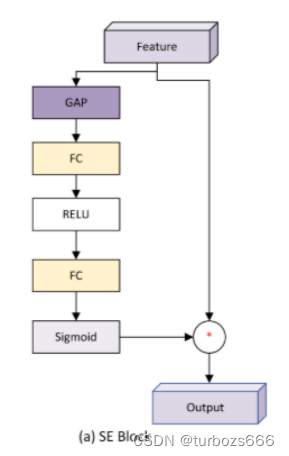

通道注意、空间注意以及通道和空间混合注意是目标检测中常用的注意方法。在通道注意力方法中,SENet 作为开创性的注意力模块之一脱颖而出。通道注意力可以被视为一种对象选择机制,因为每个通道对应于一个不同的对象。每个通道被视为一个独特的特征,允许通道注意力通过学习通道注意力权重来动态调整网络中不同通道(或特征图)的重要性。通道注意力机制涉及全局平均池(GAP)来总结空间维度上的特征图,然后是全连接层或卷积层来生成注意力权重。最后,这些权重被应用于原始特征图,放大信息通道并抑制不相关的通道。SENet注意模块包括两个组件:挤压和激励模块。挤压模块采用全局平均池化来聚合全局空间信息,如图(a)所示。相反,激励模块利用全连接层、ReLU激活和Sigmoid激活函数,通过捕获通道关系来生成注意力向量。随后,该注意力向量的输入特征被加权以计算注意力权重。这个注意力模块可以与CNN无缝集成,以获得鲁棒和有区别的特征表示。然而,该模块的主要限制是全局平均池化可能无法捕获复杂的全局信息,并且全连接层增加了参数的数量,可能会提高网络的复杂性。

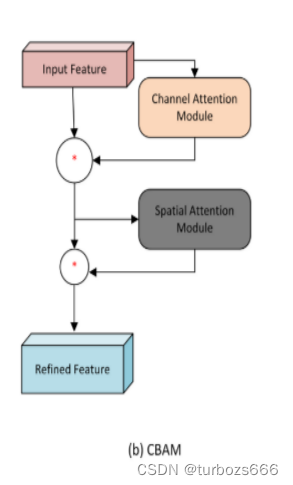

同样,空间注意力可以被看作是一种选择需要注意的区域的机制。像GENet 和PSANet 这样的模块是使用深度卷积和用于特征聚合的子网络设计的空间注意力方法。通道和空间注意力模块是一种自适应机制,用于选择对象和区域。以利用通道和空间注意力模块的优势,一些混合注意力模块,如剩余注意力网络和SCNet,联合预测通道和空间注意力网络。CBAM 使用通道和空间注意力来改善骨干网络的区域选择和对象选择能力,如图(b)所示。

4109

4109

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?