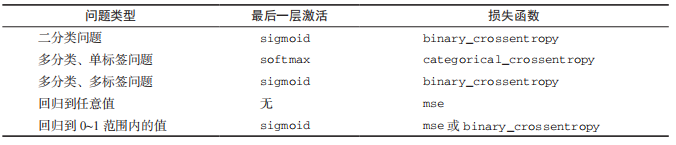

1.最后一层的激活。它对网络输出进行有效的限制。例如分类问题使用sigmoid函数,回归问题不使用激活。

处理多分类问题的标签有两种方法:

通过分类编码(也叫 one-hot 编码)对标签进行编码,然后使用 categorical_crossentropy 作为损失函数。

将标签编码为整数,然后使用 sparse_categorical_crossentropy 损失函数。

2.损失函数。它应该匹配你要解决的问题的类型。具体如上图所示。

3. 优化配置。使用哪种优化器?学习率是多少?大多数情况下,使用 rmsprop 及其默认的学习率是稳妥的。

关于损失函数的选择,需要注意,直接优化衡量问题成功的指标不一定总是可行的。有时难以将指标转化为损失函数,要知道,损失函数需要在只有小批量数据时即可计算(理想情况下,只有一个数据点时,损失函数应该也是可计算的),而且还必须是可微的(否则无法用反向传播来训练网络)。例如,广泛使用的分类指标 ROC AUC 就不能被直接优化。因此在分类任务中,常见的做法是优化 ROC AUC 的替代指标,比如交叉熵。一般来说,你可以认为交叉熵越小,ROC AUC 越大。

来源:《Python深度学习》

2067

2067

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?