引言

当谈到Wasserstein生成对抗网络(Wasserstein Generative Adversarial Network,WGAN)时,我们需要深入了解其背后的关键概念和特点。本文将分为多个部分,以详细介绍WGAN的相关内容。

第一部分:生成对抗网络(GAN)简介

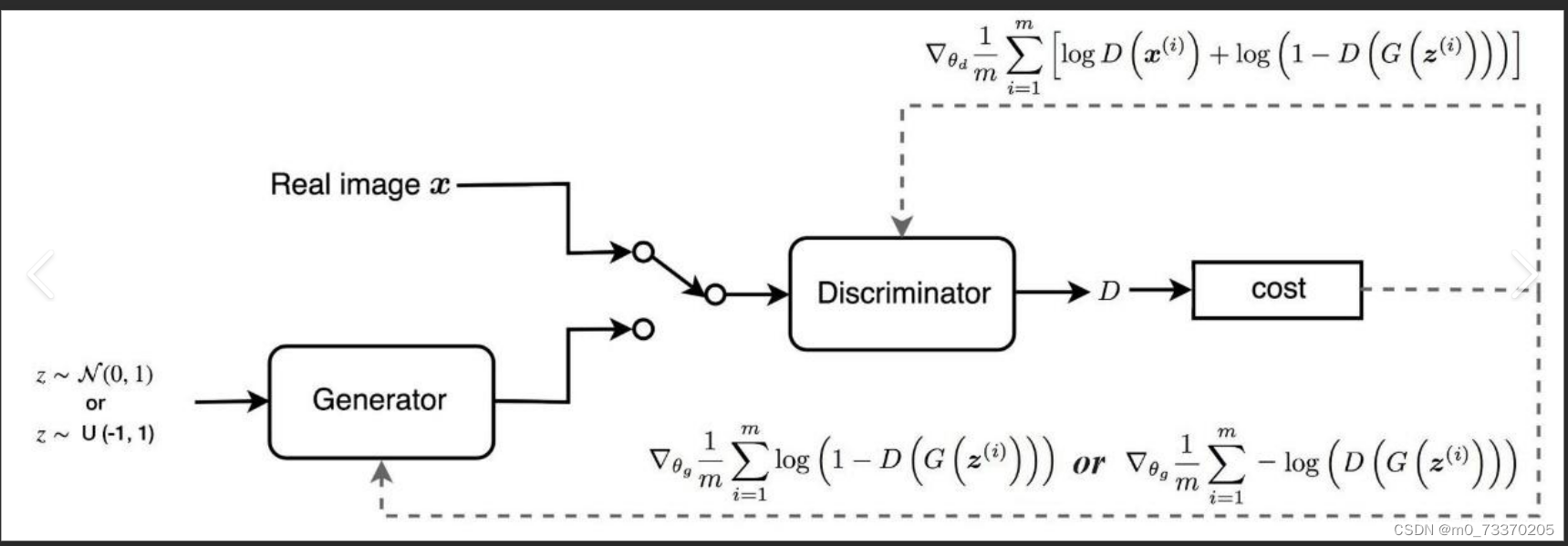

生成对抗网络是一种深度学习模型,由生成器和判别器组成。生成器试图生成与真实数据相似的样本,而判别器则试图区分真实数据和生成器生成的样本。这种对抗训练的过程可以让生成器不断改进,以生成更逼真的数据。

第二部分:WGAN的提出背景

传统的GAN在训练中面临一些问题,如训练不稳定性和模式崩溃。这些问题限制了GAN在生成高质量样本方面的表现。WGAN的提出是为了解决这些问题。

第三部分:Wasserstein距离的概念

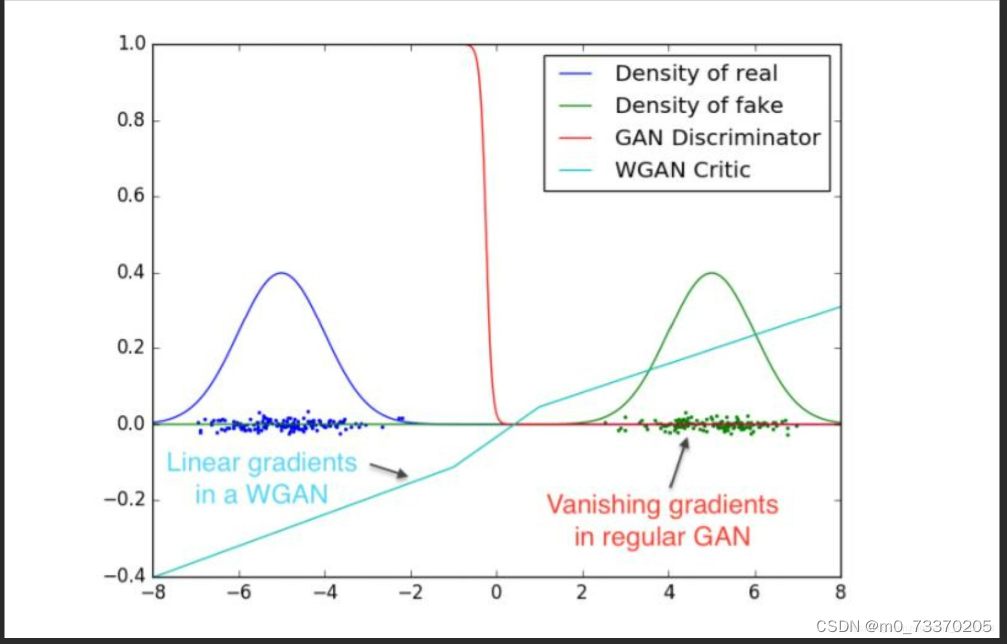

Wasserstein距离是WGAN的核心概念之一。它是一种衡量两个概率分布之间距离的方法。与传统损失函数(如JS散度和KL散度)相比,Wasserstein距离在分布重叠较小的情况下也能提供有意义的梯度信息,这使得WGAN在训练时更加稳定。

第四部分:WGAN的核心思想

WGAN的核心思想是使用Wasserstein距离作为损失函数,而不是传统的损失函数。这个选择是为了克服传统GAN中的训练问题。Wasserstein距离的数学性质使其成为一个更好的选择。

第五部分:训练WGAN的关键挑战

虽然WGAN在理论上更有前景,但它也面临着一些挑战。其中一个关键挑战是要求判别器具有Lipschitz连续性。为了满足这个条件,研究人员提出了不同的方法,如权重剪切和梯度惩罚。

第六部分:WGAN的优点和应用

WGAN相对于传统GAN有很多优势。它在生成高质量图像和样本方面表现更好,更稳定。这使得它在深度学习领域的应用非常广泛,包括图像生成、自然语言处理和医学图像处理等领域。

应用代码

Wasserstein生成对抗网络(WGAN)的应用代码通常需要使用深度学习框架,如TensorFlow或PyTorch,以及相应的数据集。以下是一个简单的WGAN示例代码,使用PyTorch和一个简单的二维数据集进行演示。

import torch

import torch.nn as nn

import torch.optim as optim

import numpy as np

import matplotlib.pyplot as plt# 定义生成器和判别器网络

class Generator(nn.Module):

def __init__(self, input_dim, output_dim):

super(Generator, self).__init__()

self.fc = nn.Sequential(

nn.Linear(input_dim, 128),

nn.ReLU(),

nn.Linear(128, output_dim),

nn.Tanh()

)def forward(self, x):

return self.fc(x)class Discriminator(nn.Module):

def __init__(self, input_dim):

super(Discriminator, self).__init__()

self.fc = nn.Sequential(

nn.Linear(input_dim, 128),

nn.ReLU(),

nn.Linear(128, 1)

)def forward(self, x):

return self.fc(x)# 定义WGAN损失函数

def wasserstein_loss(real, fake):

return torch.mean(real) - torch.mean(fake)# 创建生成器、判别器和优化器

input_dim = 2

output_dim = 2

generator = Generator(input_dim, output_dim)

discriminator = Discriminator(output_dim)

optimizer_g = optim.Adam(generator.parameters(), lr=0.0002)

optimizer_d = optim.Adam(discriminator.parameters(), lr=0.0002)# 训练WGAN

num_epochs = 10000

batch_size = 64for epoch in range(num_epochs):

for _ in range(5): # 判别器更新多次,提高稳定性

noise = torch.randn(batch_size, input_dim)

fake_data = generator(noise)

real_data = torch.randn(batch_size, output_dim)optimizer_d.zero_grad()

d_real = discriminator(real_data)

d_fake = discriminator(fake_data.detach())

loss_d = -wasserstein_loss(d_real, d_fake)

loss_d.backward()

optimizer_d.step()# 对判别器的参数进行截断,限制Lipschitz常数

for p in discriminator.parameters():

p.data.clamp_(-0.01, 0.01)noise = torch.randn(batch_size, input_dim)

fake_data = generator(noise)optimizer_g.zero_grad()

d_fake = discriminator(fake_data)

loss_g = -torch.mean(d_fake)

loss_g.backward()

optimizer_g.step()if epoch % 100 == 0:

print(f"Epoch [{epoch}/{num_epochs}], Loss D: {loss_d.item()}, Loss G: {loss_g.item()}")# 生成样本并可视化

noise = torch.randn(100, input_dim)

generated_samples = generator(noise).detach().numpy()plt.scatter(generated_samples[:, 0], generated_samples[:, 1])

plt.title("Generated Data")

plt.show()

此示例演示了如何使用PyTorch实现简单的WGAN,并在二维数据集上进行训练和生成样本。

第七部分:个人总结

Wasserstein生成对抗网络(WGAN)感觉这东西就像是生成对抗网络(GAN)的升级版。WGAN解决了一些让人头疼的问题,让GAN的训练变得更加靠谱。

传统的GAN有时候很烦,因为它们的损失函数有点难以处理,导致生成器和判别器的较量变得复杂。WGAN的点子就在于,引入了一种叫Wasserstein距离的新工具,用来度量生成器生成的东西和真实东西之间的差距。这玩意更稳定,不容易让训练崩溃,所以生成器更容易搞出高质量的东西。

另外,WGAN还要求判别器有点"文明",满足Lipschitz连续性的条件,这样训练过程更加可控。这么做是为了确保我们不会被一些乱七八糟的结果搞晕。

总之,WGAN是一个非常牛的深度学习玩意儿,可以用来生成高质量的图像、音频,甚至是文字。它让GAN的训练变得更容易,未来应用前景可期!

919

919

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?