1:集群规划

主要是宕机问题

基于前面博客Spark StandAlone环境部署

搭建好hadoop, zookeeper,并且启动

2:关闭spark集群

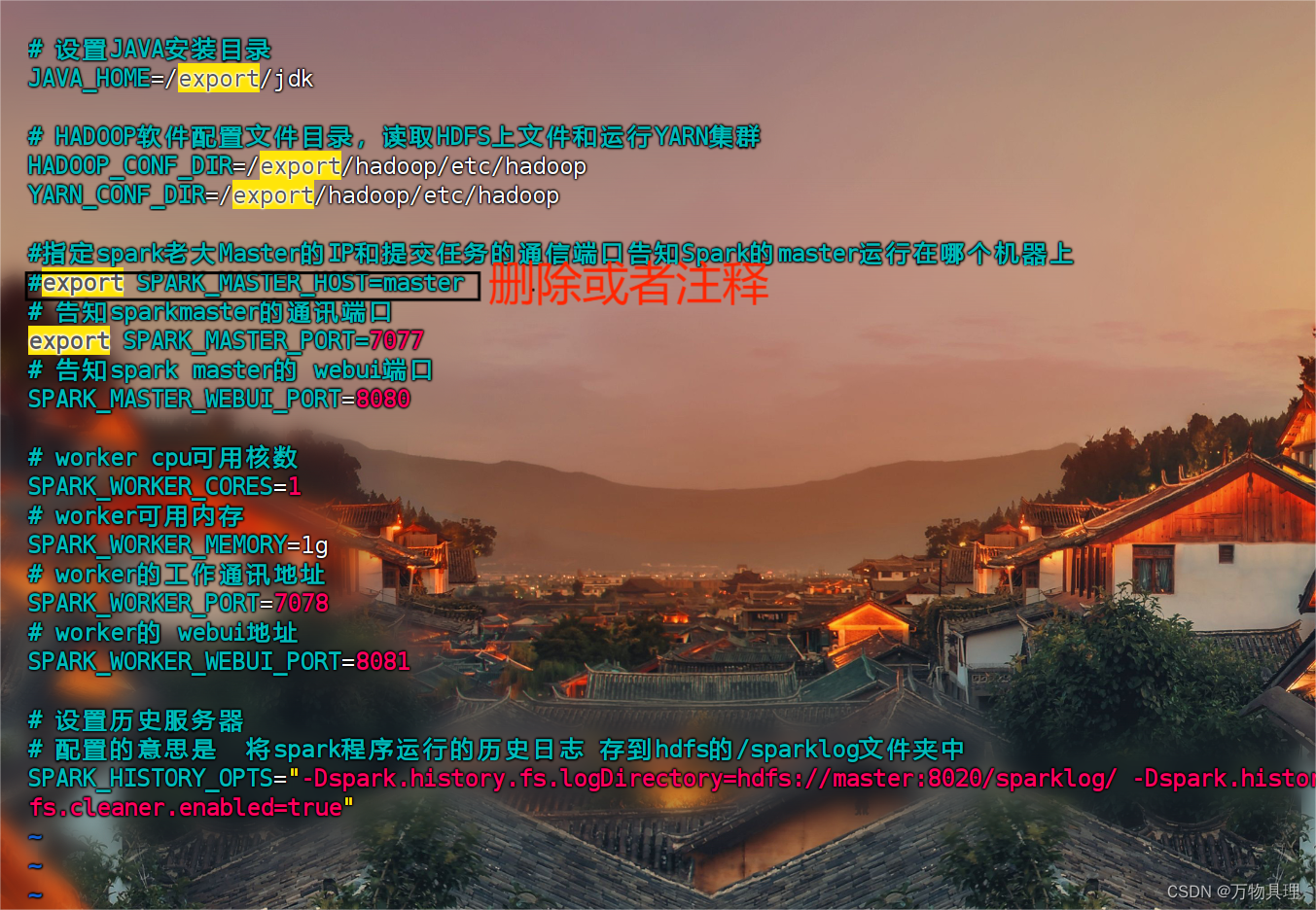

/export/spark/sbin/stop-all.sh3:配置spark-env.sh文件

vim /export/spark/conf/spark-env.sh删除或者注释掉SPARK_MASTER_HOST=master

4:把spark-env.sh文件分发到slave1,slave2上面

cd /export/spark/conf

scp spark-env.sh slave1:/export/spark/conf/

scp spark-env.sh slave2:/export/spark/conf/

5:启动集群

1: master在上 启动一个master 和全部worker

cd /export/spark

sbin/start-all.sh

# master在上 启动一个master 和全部worker

2:在slave1上启动一个备用的master进程

cd /export/spark

sbin/start-master.sh

4559

4559

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?