✅作者简介:热爱科研的Matlab仿真开发者,修心和技术同步精进,

代码获取、论文复现及科研仿真合作可私信。

🍎个人主页:Matlab科研工作室

🍊个人信条:格物致知。

更多Matlab完整代码及仿真定制内容点击👇

🔥 内容介绍

支持向量机(Support Vector Machine,SVM)是一种常用的分类和回归方法,它在机器学习领域有着广泛的应用。SVM的基本思想是将数据映射到高维空间中,从而将非线性问题转化为线性问题,然后找到一个最优的超平面,将数据分成两类。但是,SVM的训练时间较长,对于大规模数据的分类问题,效率较低。

Adaboost(Adaptive Boosting)是一种集成学习算法,它通过组合多个弱分类器,得到一个强分类器,提高了分类的准确率。Adaboost的基本思想是对训练样本进行加权,使得分类错误的样本得到更高的权重,然后训练一个新的分类器,直到达到预定的准确率或者分类器数量。

在实际应用中,SVM和Adaboost可以结合使用,提高分类效果和训练速度。libsvm是一个常用的SVM库,它支持多种核函数和参数调节方式,可以快速地训练SVM模型。下面介绍如何使用libsvm结合Adaboost进行数据分类预测。

-

数据准备

首先需要准备训练数据和测试数据。训练数据应该包括特征向量和标签,特征向量表示每个样本的各个属性值,标签表示样本所属的类别。测试数据只需要包含特征向量,没有标签。

-

训练模型

使用libsvm训练SVM模型,可以选择不同的核函数和参数调节方式。训练完成后,得到一个SVM分类器。

然后使用Adaboost算法,将多个SVM分类器组合成一个强分类器。Adaboost的训练过程中,需要设置分类器数量和迭代次数等参数。

-

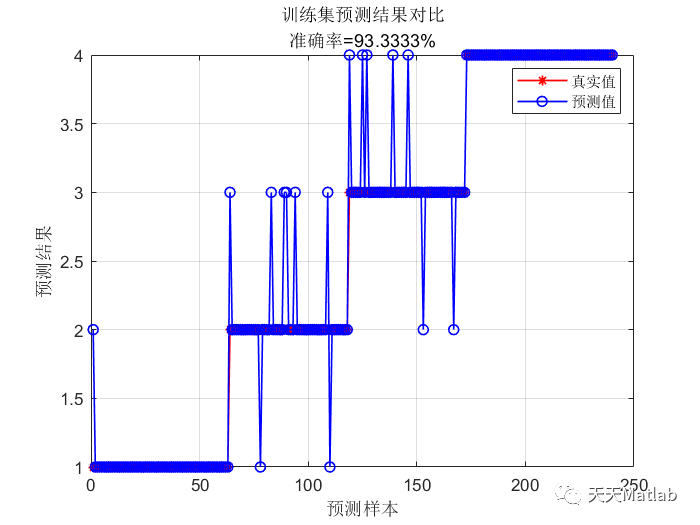

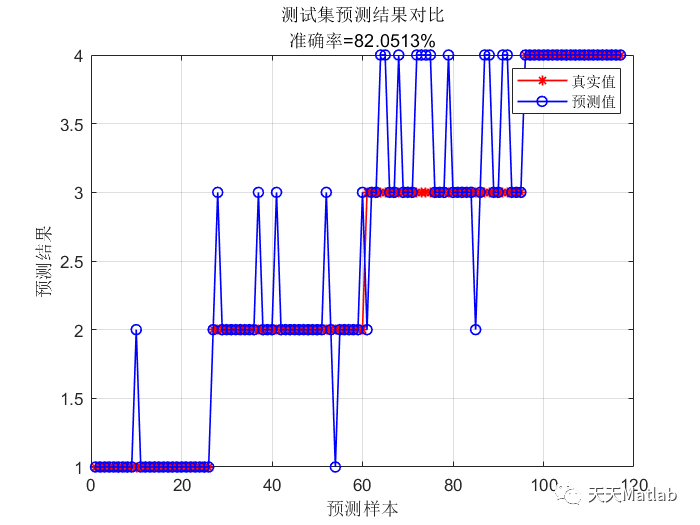

测试模型

使用训练好的模型对测试数据进行分类预测。将测试数据输入到SVM分类器中,得到分类结果。然后将多个SVM分类器的结果进行加权,得到最终的分类结果。

-

模型评估

对分类结果进行评估,可以使用混淆矩阵、准确率、召回率、F1值等指标。根据评估结果,可以对模型进行调整和优化。

总结

基于支持向量机结合Adaboost的数据分类预测,可以提高分类效果和训练速度。libsvm是一个常用的SVM库,可以快速地训练SVM模型。Adaboost算法可以将多个SVM分类器组合成一个强分类器,提高分类的准确率。在实际应用中,需要根据具体问题选择合适的核函数和参数调节方式,对模型进行调整和优化。

📣 部分代码

%% 清空环境变量warning off % 关闭报警信息close all % 关闭开启的图窗clear % 清空变量clc % 清空命令行%% 导入数据res = xlsread('数据集.xlsx');%% 划分训练集和测试集temp = randperm(357);P_train = res(temp(1: 240), 1: 12)';T_train = res(temp(1: 240), 13)';M = size(P_train, 2);P_test = res(temp(241: end), 1: 12)';T_test = res(temp(241: end), 13)';N = size(P_test, 2);%% 数据归一化[p_train, ps_input] = mapminmax(P_train, 0, 1);p_test = mapminmax('apply', P_test, ps_input);t_train = ind2vec(T_train);t_test = ind2vec(T_test );

⛳️ 运行结果

🔗 参考文献

[1]陈春萍.基于SVM与AdaBoost组合的分类算法研究[D].西安电子科技大学[2023-11-20].DOI:10.7666/d.y2067272.

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?