神经网络

BP神经网络过拟合

BP 神经网络经常遭遇过拟合。其训练误差持续降低,但测试误差却可能上升。有两种策略常用来缓解BP网络的过拟合

1、早停:若训练集误差降低但是验证集误差上升,则停止训练,返回具有最小验证集误差的连接权和阈值。

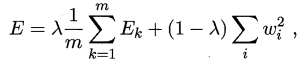

2、正则化:其基本思想是再误差目标函数中增加一个用于描述网络复杂度的部分,例如连接权与阈值的平方和。仍令 Ek 表示第k个训练样例上的误差,wi叫表示连接权和阙值,则误差目标函数 改变为

其中 λ∈(0,1) 用于对经验误差与网络复杂度这两项进行折中,常通过交叉验证法来估计。

全局最小与局部最小

跳出局部最小的方法

使用多组不同的参数值初始化多个神经网络。

模拟退火:在每一步以一定的概率接受比当前解更差的结果。

随机梯度下降:在计算梯度时加入了随机因素,在遇到极小值点时,有可能梯度仍

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?