目录

3、FCN Head 和 Bilinear Interpolate

前言

这篇文章是我根据 B 站 霹雳吧啦Wz 的《深度学习:语义分割篇章》中的 PyTorch 官方实现的 FCN 网络结构 所作的学习笔记,主要介绍了 PyTorch 官方实现的 FCN 网络结构,希望能为正在学习语义分割的小伙伴们提供一些帮助ヾ(^▽^*))) 因为才刚刚开始接触语义分割,所以在表达上可能比较幼稚,希望王子公主们多多包涵啦!如果存在问题的话,请大家直接指出噢~

在做笔记的过程中,我还参考了这篇博客:语义分割|学习记录(5)Pytorch官方实现的FCN网络结构-CSDN博客

一、原论文实现的 FCN 网络结构

相关论文:Fully Convolutional Networks for Semantic Segmentation

关于原论文的 FCN 网络结构,我在之前的文章中有具体的说明,文章链接贴在这里啦:

二、PyTorch 官方实现的 FCN 网络结构

PyTorch 官方实现的 FCN 网络结构与这篇论文在当年提出的 FCN 网络结构稍有不同,因为如今在 backbone 这块有了更多的选择:

- 原论文实现 FCN 网络结构时采用的 backbone 是 VGG16 网络

- PyTorch 官方实现 FCN 网络结构时采用的 backbone 是 Resnet50 网络

1、FCN 网络结构

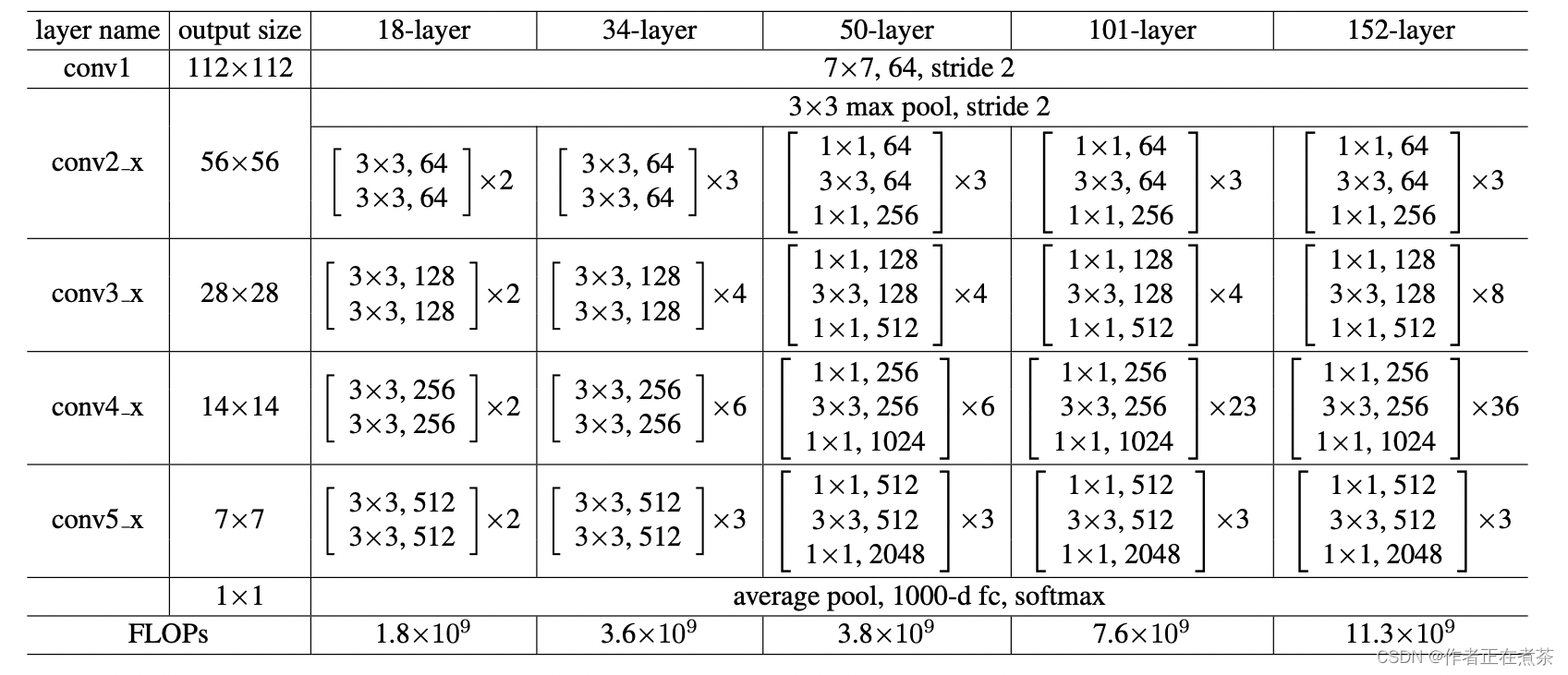

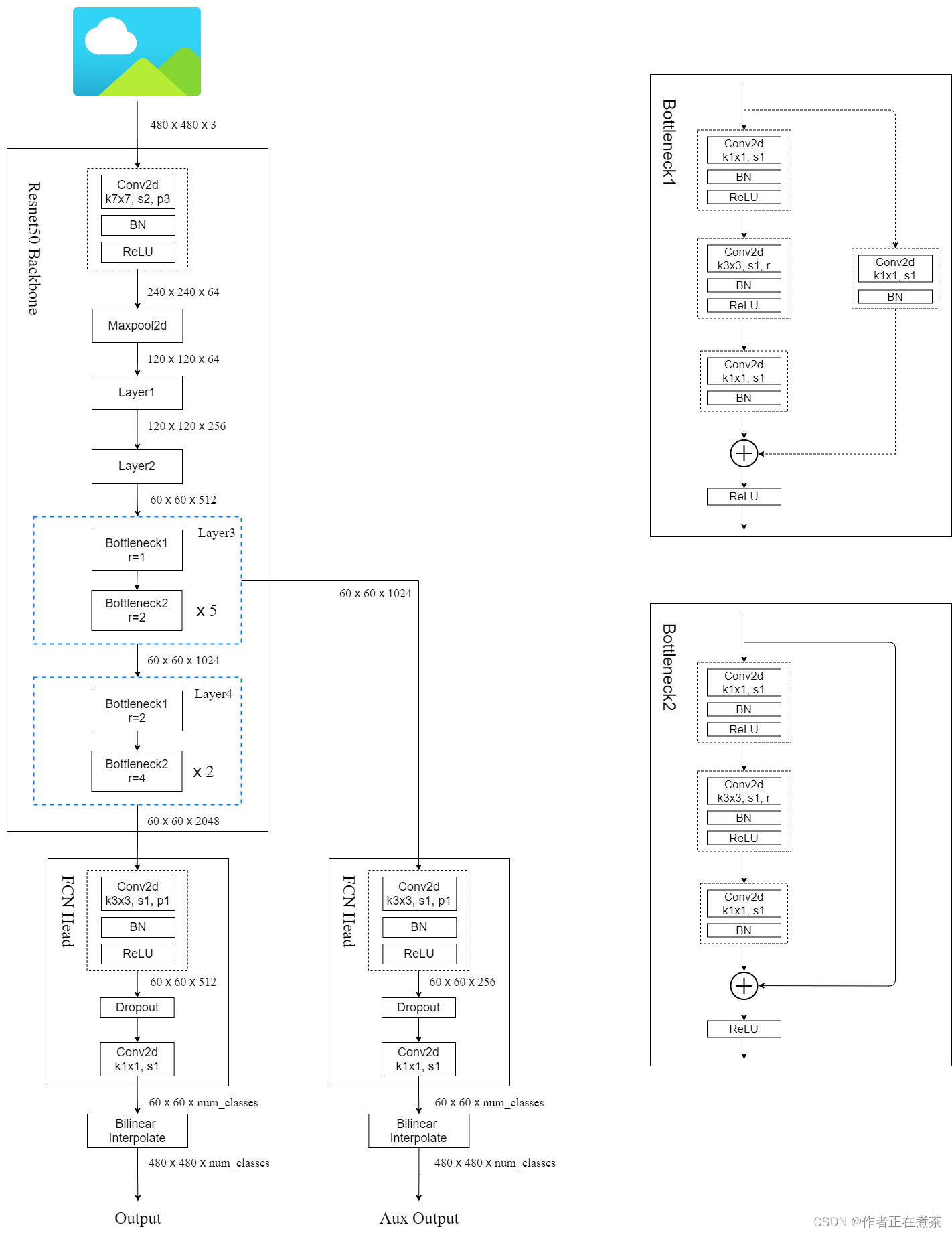

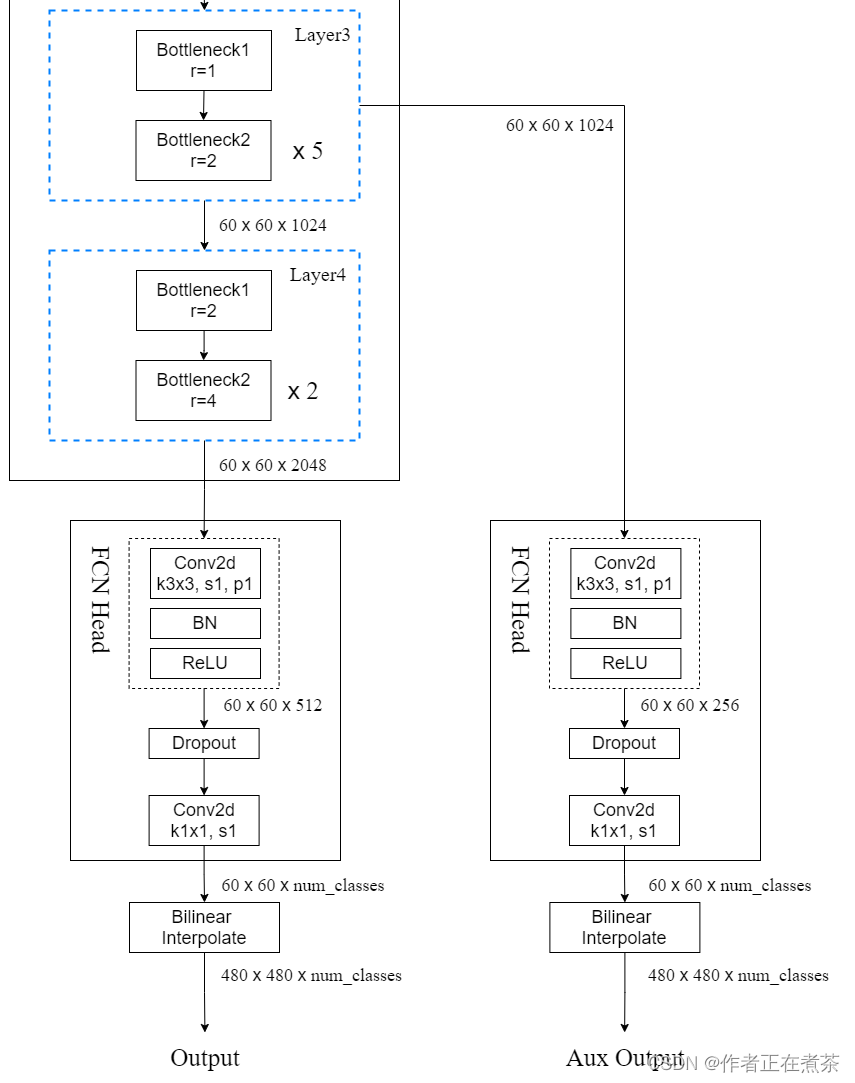

将下面的 FCN 网络结构与上面的 ResNet 网络详解对应起来:

- FCN 的 计算机卷积 对应 ResNet 中的 conv1( 同 VGG16 网络 )

- FCN 的 Maxpool2d 对应 ResNet 中 conv2_x 的 max pool( 同 VGG16 网络 )

- FCN 的 Layer1 对应 ResNet 中 conv2_x 的 3 个残差结构( 同 VGG16 网络 )

- FCN 的 Layer2 对应 ResNet 中 conv3_x 的 4 个残差结构( 同 VGG16 网络 )

- FCN 的 Layer3 对应 ResNet 中 conv4_x 的 6 个残差结构,Layer3 含 1个 Bottleneck1 和 5 个 Bottleneck2( 区别 )

- FCN 的 Layer4 对应 ResNet 中 conv5_x 的 3 个残差结构,Layer4 含 1个 Bottleneck1 和 2 个 Bottleneck2( 区别 )

2、Bottleneck1 和 Bottleneck2

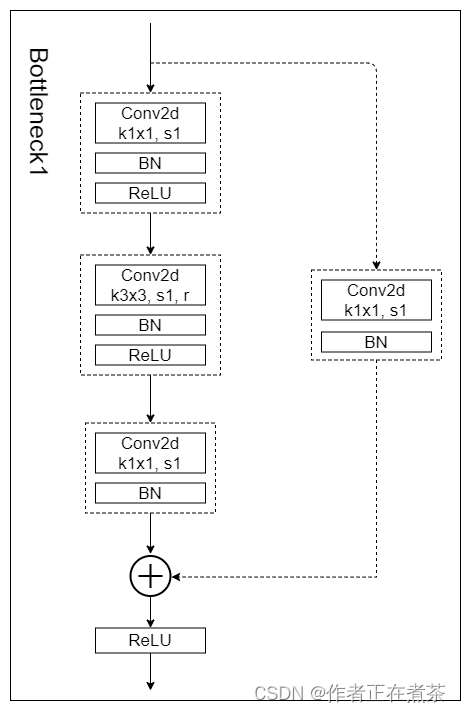

我们再来具体讲解 Bottleneck1 和 Bottleneck2 的结构:

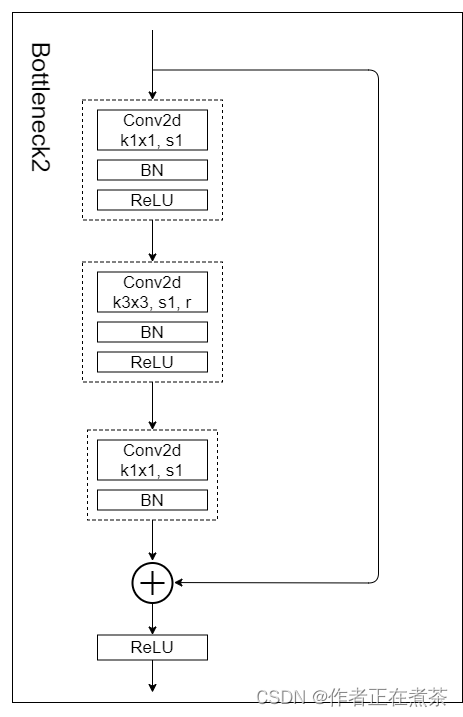

首先,Bottleneck1 对应原来的虚线残差结构,与 ResNet 中的区别在于它将捷径分支上 1 x 1 卷积层的步距 s 改成了 1 。在 ResNet 网络中的虚线残差结构会将输入特征图的宽高缩小为原来的一半,也就是进行下采样操作,而在这里没有进行下采样操作,因为在语义分割中,如果下采样倍率过大,还原回原图的尺寸时将会影响最终效果。除此之外, 3 x 3 卷积层的步距 s 也改成了 1 ,并引入了膨胀系数 r 。Bottleneck2 的改变类似于 Bottleneck1 ,也同样引入了 膨胀卷积 。

在 FCN 网络的 Layer3 和 Layer4 中都有对应的 Bottleneck1 和 Bottleneck2 ,并给它们赋予了不同的 r 值。

3、FCN Head 和 Bilinear Interpolate

经过 Resnet50 Backbone 后,会接着通过 FCN Head 模块:

- 经过一个 3 x 3 的卷积层,输入特征图的 channel 数将被调整为原来的四分之一,即 512

- 经过一个 Dropout 层

- 经过一个 1 x 1 的卷积层,调整特征层的 channel 数为类别个数 num_classes

经过 FCN Head 模块后,会接着通过 Bilinear Interpolate,即通过双线性插值的方法还原回原图的尺寸。

【补充】关于右侧的另一个 FCN Head 模块,官方给出的理由是:防止误差梯度没办法传递到网络浅层,因此在这里引入辅助分类器。训练时可以启用这个辅助分类器,但实际部署到真实环境后,我们只会使用 output ,而不会使用辅助分类器的 Aux Output ,因此我们可以将辅助分类器这个模块删除,从而提升 FCN 的网络性能。

三、PyTorch 官方实现的 FCN 源代码

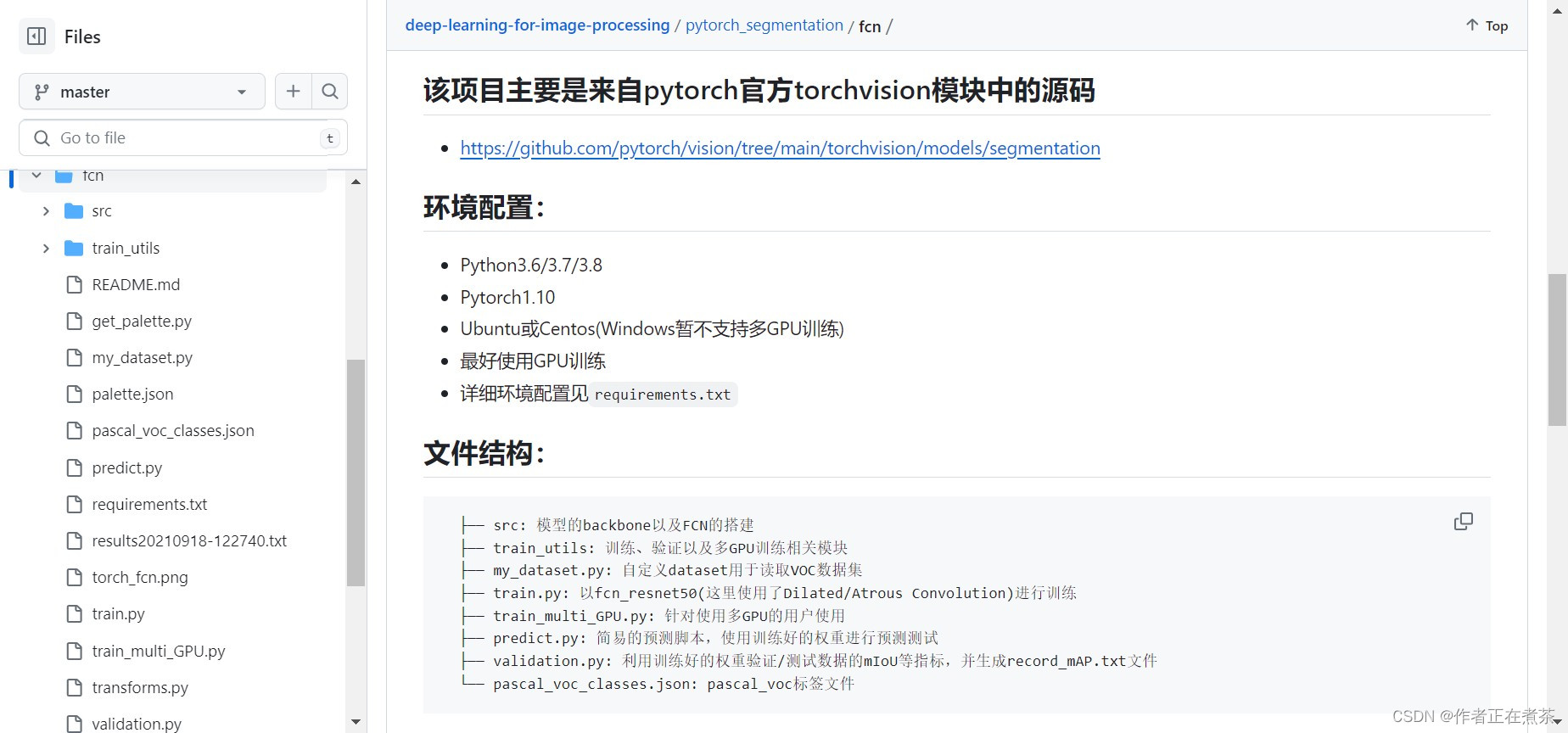

关于 PyTorch 官方实现的 FCN 网络结构,霹雳吧啦将其源代码进行了精简,点击【FCN】就可以跳转至 GitHub 进行查看噢~

【彩蛋】为了让王子公主们能够更方便地下载相关代码,我在这里放置了【Download】按钮 (●'◡'●) 值得注意的是,下载的代码是霹雳吧啦所有课程的代码,FCN 网络相关的代码在 \deep-learning-for-image-processing-master\pytorch_segmentation\fcn 目录下哟~

最后说些话

致亲爱的王子公主们:这篇文章可能比较简短,只是大概讲述了 PyTroch 官方实现的 FCN 网络结构,没有对其源码进行解析,后面有时间的话,微臣会在看完 FCN源码解析(PyTorch)视频后上传相关的学习笔记!到时会把文章链接贴在这里的ヾ(•ω•`)o

https://blog.csdn.net/nanzhou520/article/details/134854489

https://blog.csdn.net/nanzhou520/article/details/134854489

522

522

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?