默认已经安装了jdk和scala

下面说一下spark的eclispe的集成开发环境的搭建

eclipse4.2

update-site.zip

spark-1.0.2-bin-hadoop2.tgz

解压spark-1.0.2-bin-hadoop2.tgz,得到lib文件夹下的jar包spark-assembly-1.1.1-hadoop2.3.0.jar

下面开始进行配置

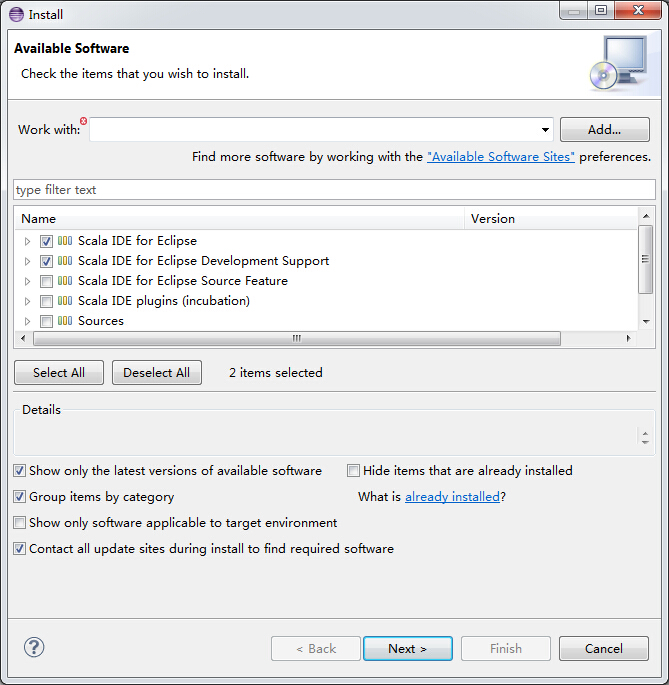

打开exlipse,选择Help下的install new software,点击add,在弹出的对话框中Name填写scala,选择下面的按钮Archive,选择上面下载下来的update-site.zip,出现如下的页面,选择前两项

一路next就可以了

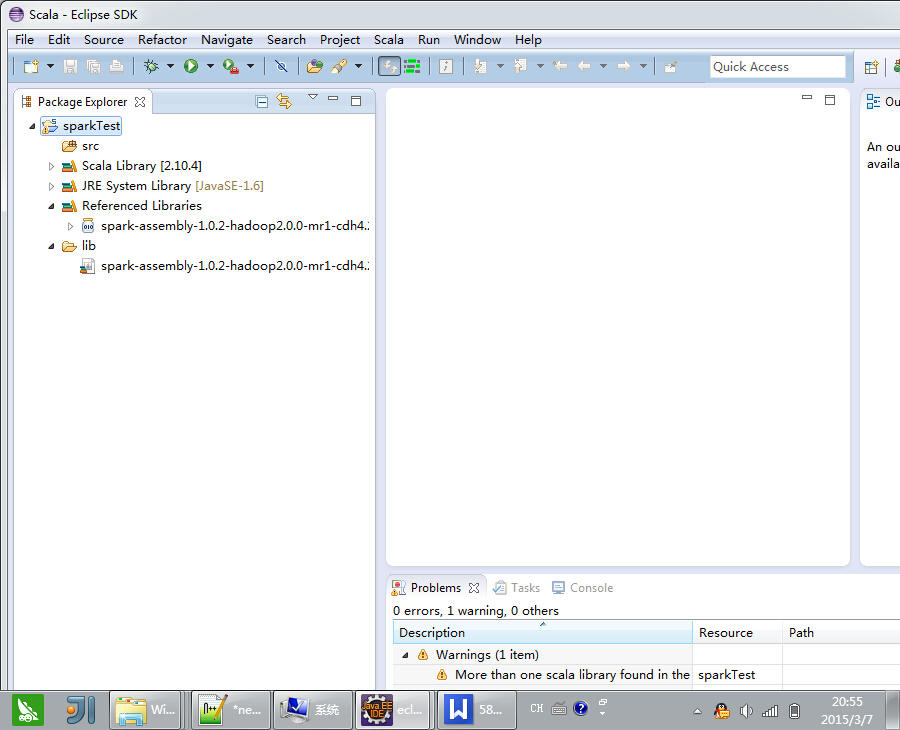

新建一个scala工程,在工程的根目录下新建一个lib包,将spark-assembly-1.1.1-hadoop2.3.0.jar放到这个lib包中,然后右键,build path,将jar包加入到buildbath中,得到

到这里集成环境就搭建完了,最重要的是三个版本的选择,要匹配

spark的eclispe的集成开发环境的搭建

最新推荐文章于 2023-01-03 23:55:22 发布

1146

1146

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?