1 简介

论文题目:Self-Attention Graph Residual Convolutional Network for Event Detection with dependency relations

论文来源:EMNLP 2021

组织机构:天津大学

论文链接:https://aclanthology.org/2021.findings-emnlp.28.pdf

代码链接:

1.1 创新

- 提出了一个Self-Attention Graph Residual Convolutional网络,使用注意力机制融合句法结构和潜在依赖关系,提高事件检测任务的性能,同时使用残差连接解决图信息消失问题。

2 方法

token的编码包括词编码、实体类型编码、依赖编码(包括两个非对称张量SUB(subject)和OBJ(object)),词编码和实体类型编码拼接后通过BiLSTM编码,得到

[

h

1

,

.

.

.

,

h

n

]

[h_1,...,h_n]

[h1,...,hn]。

自注意力模块

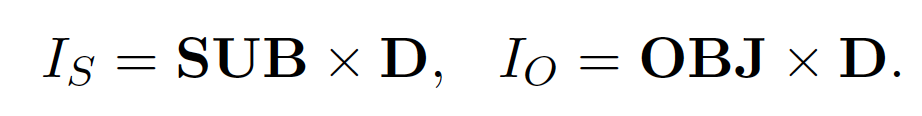

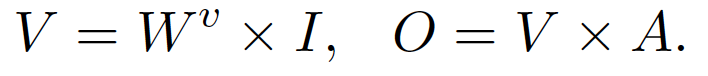

首先分别使用SUB和OBJ张量获得K、Q、V得到输出,最终输出为三部分的拼接(包括BiLSTM的输出),具体公式如下

|

|

|

|

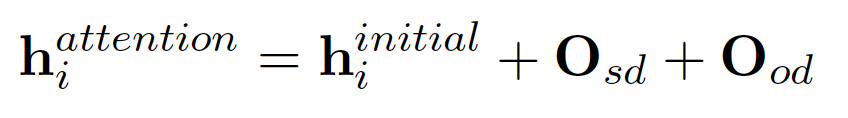

使用残差连接解决信息消失问题,公式如下:

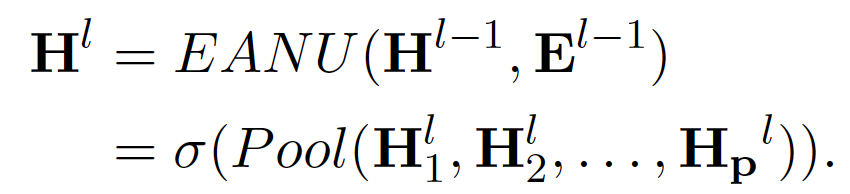

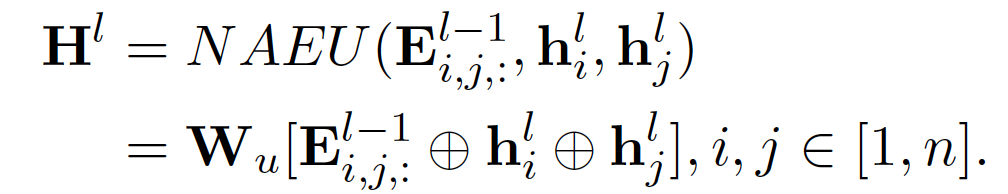

节点和边更新模块,公式如下(第三个公式为边更新公式(符号好像有错误)):

|

|

|

3 实验

实验数据集为ACE 2005,实验结果如下图:

消融实验如下:

注意力可视化:

682

682

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?