一、卷积层

1. 1d/2d/3d卷积

2. nn.Conv2d()

3. 转置卷积-nn.ConvTranspose

二、池化层

三、线性层

四、激活函数层

一、卷积层

首先我们了解卷积的概念,去区分是一维卷积还是二维卷积还是三维卷积。

然后学习nn.Conv2d()这个方法。最后学习转置卷积的概念及名字的由来。

1. 1d/2d/3d卷积

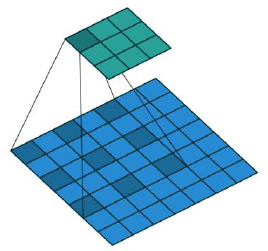

可以把卷积核看成是某种特征,某种模式。

我们可以从模板匹配的角度上去观察卷积操作。卷积操作就是拿着一个特征检测器,到我们的图像上进行扫描,不断地检测图像的每一个区域,与我们的特征检测器的模式是否相似。越相似,它的激活值越高,从而实现了一个特征提取功能。所以,在深度学习中,我们把卷积核看成是特征提取器的检测器。

我们看右边这张图,是AlexNet卷积核的一个可视化。我们发现卷积核学习到的是图像的一些细节特征。这也进一步验证了,卷积核是图像的某种特征提取。具体是哪一种特征,哪一种提取器,是由模型学习而来。

我们了解了卷积的基本操作,那我们该如何区分卷积是几维的呢?

在pytorch中,提供了一维二维三维卷积。

一般情况下,卷积核在几个维度上滑动,就是几维。 几维的卷积生成几维的特征图。

2. nn.Conv2d()

nn.Conv2d()方法主要对多个二维信号进行二维卷积。

in_channels:输入通道数。

out_channels:输出通道数。也就是常说的卷积核的个数。

padding:保持输入和输出的图像的尺寸不变。如下图,加入padding之后,图像的分辨率、尺寸大小是完全没有变化的。

dilation:空洞卷积大小。

阴影部分是卷积核的权值,权值之间是有间隔的,也可以理解为是带空洞的卷积核。这样的卷积核执行的卷积操作就是空洞卷积。空洞卷积通常应用于图像分割任务。它主要的 的作用是为了提升感受野,也就是输出图像一个像素能够看到前面图像更大的一个区域。

groups:设置分组卷积的组数。分组卷积通常用于模型的轻量化。例如我们的shuffleNet,..,mobleNet。其实我们的AlexNet也是采用分组卷积,但是它采用的分组卷积是由于硬件的限制,它采用了两个GPU进行训练。

下面我们来看尺寸是如何变化的。

简化版是不带padding,也不带dilation的。

下面来看一下卷积之后输出的图像:

# -*- coding: utf-8 -*-

"""

# @file name : nn_layers_convolution.py

# @brief : 学习卷积层,2d卷积

"""

import os

BASE_DIR = os.path.dirname(os.path.abspath(__file__))

import torch.nn as nn

from PIL import Image

from torchvision import transforms

from matplotlib import pyplot as plt

path_tools = os.path.abspath(os.path.join(BASE_DIR, "tools", "common_tools.py"))

assert os.path.exists(path_tools), "{}不存在,请将common_tools.py文件放到 {}".format(path_tools, os.path.dirname(path_tools))

from tools.common_tools import transform_invert, set_seed

set_seed(2 ) # 设置随机种子

# ================================= load img ==================================

path_img = os.path.join(os.path.dirname(os.path.abspath(__file__)), "lena.png")

img = Image.open(path_img).convert('RGB') # 0~255。采用PIL的形式读取进来。

# convert to tensor。转换成张量的形式。

img_transform = transforms.Compose([transforms.ToTensor()])

img_tensor = img_transform(img) #使用transforms.ToTensor方法将

img_tensor.unsqueeze_(dim=0) # C*H*W to B*C*H*W。 拓展到4维的张量。

# ================================= create convolution layer ==================================

# ================ 2d卷积

conv_layer = nn.Conv2d(3, 1, 3) # input:(i, o, size) weights:(o, i , h, w)。因为是RGB图像,有三个通道,所以in_channels为3。out_channels为1,即设置1个卷积核来观察。卷积核大小为3.

nn.init.xavier_normal_(conv_layer.weight.data) #对conv_layer进行初始化。

# calculation

img_conv = conv_layer(img_tensor) #把图像张量输入到卷积层中,得到输出。

# ================================= visualization ==============

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1761

1761

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?