通讯作者:Long Quan

第一作者:Zixin Luo

研究机构:港科大,清华,快手

自己的想法:

论文提出的方法解决了局部特征检测器和描述子的两个局限性:

- 在密集特征提取过程中,往往忽略了特征点的局部形状(尺度、方向等)的估计能力,而形状感知是获得较强几何不变性的关键。

- 检测到的特征点的定位精度不足以可靠地恢复相机的几何结构,这已成为3D重建等任务的瓶颈。

现有方法的关键点定位精度和low-level的表达特性都没有得到足够的重视。

本文解决方法的思路:

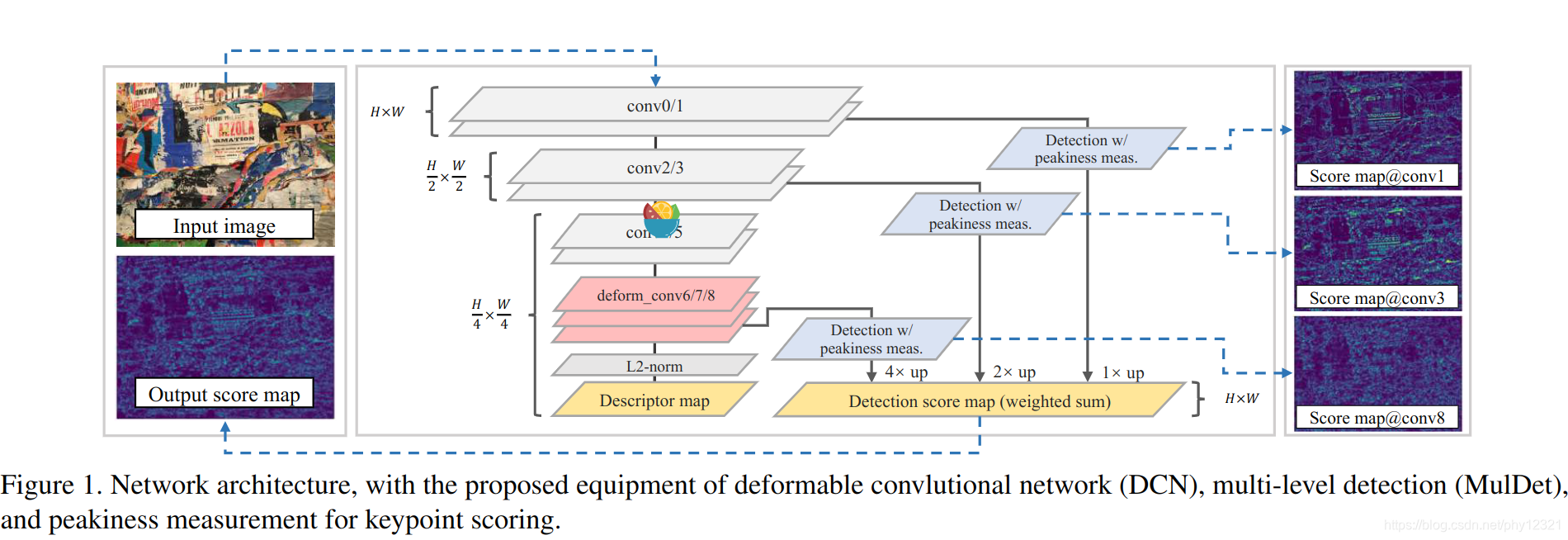

- 诉诸于可变形卷积网络(DCN)来密集地估计和应用局部变换

- 利用固有的特征层次结构来还原空间分辨率和low-level 的细节,提出了新的多尺度检测机制以实现准确的关键点定位。

先决条件:

模型的backbone是基于两个:

- DCN(deformable convolutional networks),用来预测和apply 稠密的空间变换

- D2-Net,《A trainable cnn for jointdetection and description of local features》,该方法可在检测到描述子同时得到特征点坐标。

DCN:

目的是学习动态感受野,以适应对几何变化进行建模的能力

传统的卷积公式:

y

(

p

)

=

∑

p

n

∈

R

w

(

p

n

)

⋅

x

(

p

+

p

n

)

y(p) =\sum_{p_n∈R}w(p_n)·x(p+p_n)

y(p)=pn∈R∑w(pn)⋅x(p+pn)

而DCN则加入了采样偏移量和特征幅值:

y

(

p

)

=

∑

p

n

∈

R

w

(

p

n

)

⋅

x

(

p

+

p

n

+

Δ

p

n

)

⋅

Δ

m

n

y(p) =\sum_{p_n∈R}w(p_n)·x(p+p_n+\Delta p_n)·\Delta m_n

y(p)=pn∈R∑w(pn)⋅x(p+pn+Δpn)⋅Δmn

D2-Net: 待填坑

DCN with Geometric Constraints:

原本的DCN包含过多的形变可能性,但是在本任务中其实主要需求的是三种:similarity、 affine 、homography

Selective and Accurate Keypoint Detection

Keypoint peakiness measurement

稍微改变了D2-Net中的特征点判断标准 主要是通道上使用峰值作为D2网络中的关键点测量标准

Multi-level keypoint detection (MulDet)

D2-Net 关键点的定位精度不够,原因在于检测是从低分辨率特征图获得的。恢复空间分辨率的方法有多种,例如通过学习额外的特征解码器或采用膨胀卷积,但是这些方法要么增加了学习参数的数量,要么消耗了巨大的GPU内存或计算能力。

作者提出了一个简单而有效的解决方案,不需要额外的学习权重,通过利用卷积网络固有的金字塔特征层次,从多个特征层次组合检测,即一种分层的尺度融合方法

Reference

https://blog.csdn.net/qq_17732497/article/details/105739055

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?