这周开始,Symbian北京的一个部门开始进行Agile培训,两个整天;接下来会对Agile 的Team Leader有一天的Agile培训;最后还有一个workshop,由Agile顾问公司RADTAC的核心人物主持.....

很幸运,我们部门正是这第一开始的部门。我已经结束了为期两天的Agile培训,接下来还要参加Agile Team Leader的培训。

London过来的讲师在两天的培训中讲了不少东西,庆幸的是,讲师是纯正的伦敦人,发音比较地道,听起来没什么障碍。

两天的课程,内容很多,还需要时间来消化,以后再以学习笔记的形式blog。今天就先看一下大的框架:

一、Agile宣言和Symbian Agile宣言:

Agile宣言:

1 、个体和交互胜过过程和工具

2 、可以工作的软件胜过面面俱到的文档

3 、客户合作胜过合同谈判

4 、相应变化胜过遵循计划

公司Agile宣言:

1、Agile团队对产品的发布负责;Agile团队拥有根据市场需求做重大决策的权力

2、系统总是在运行;核心是以自动化的测试和构造系统来反馈软件质量信息

3、与客户的沟通、协调、许诺仍然集中在长期的roadmaps和发布计划上

4、Prioritisation is at the centre of all engineering efforts, change is part

of the system to ensure consistency with customer priorities. Time

and quality is always maintained. The detailed scope is what changes

二、Agile团队必须要做的:

1. Development in iterations

2. Scope planning

3. The Agile Component Team / Product Owner contract

4. Lean requirements at scale

5. Frequent production-quality releases

6. Concurrent testing and integration

7. Adhere to product related reliability and security directives

8. Intentional architecture

9. Regular reflection

(有些东西还不是很理解究竟要做什么,看接下来的培训怎么说。)

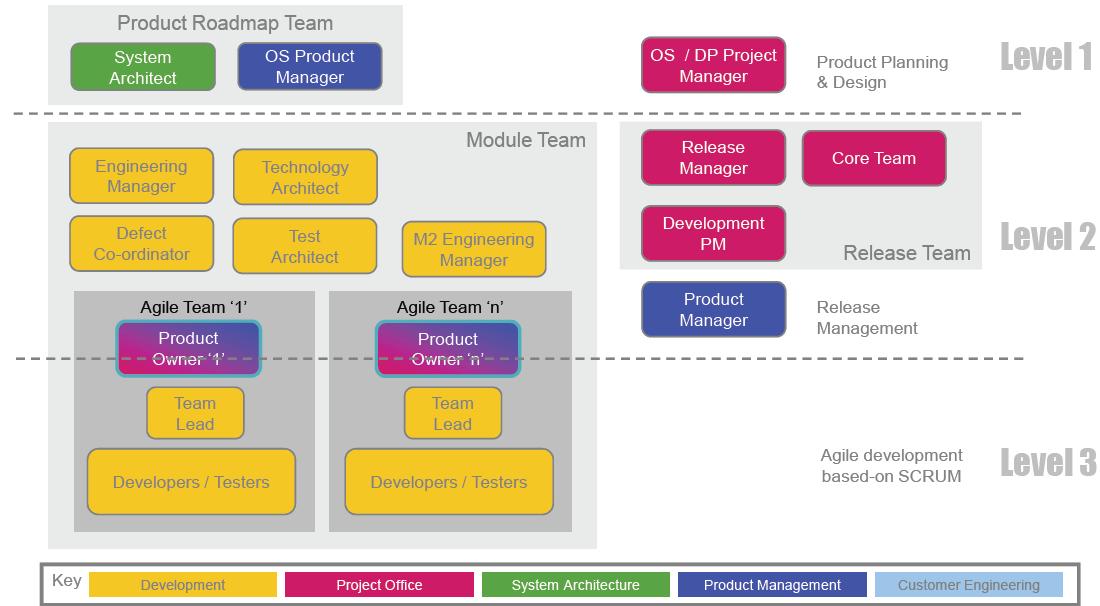

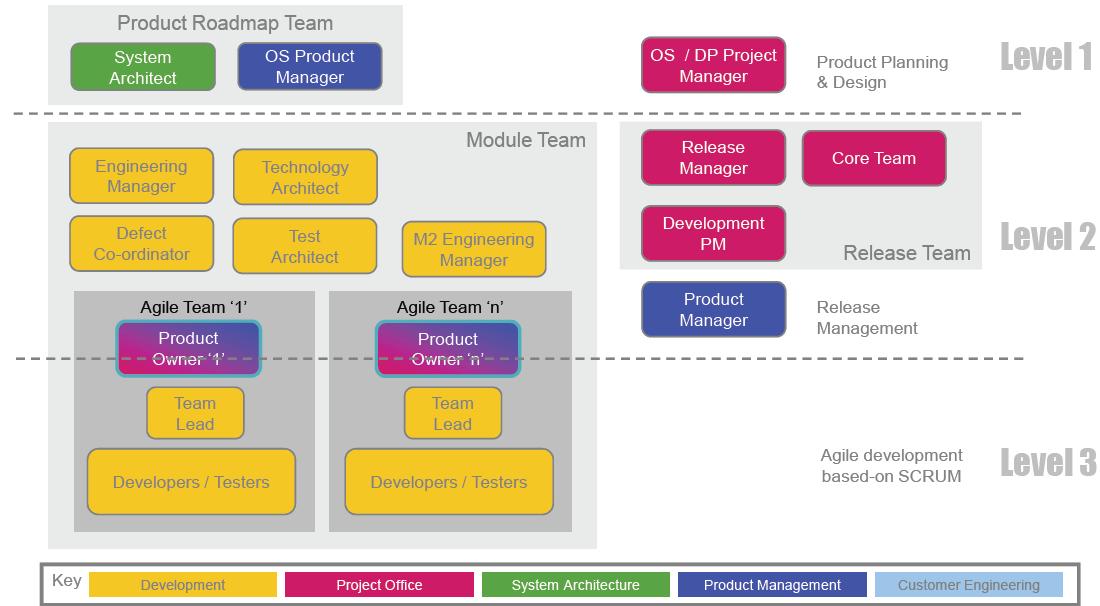

三、Agile组织结构

很幸运,我们部门正是这第一开始的部门。我已经结束了为期两天的Agile培训,接下来还要参加Agile Team Leader的培训。

London过来的讲师在两天的培训中讲了不少东西,庆幸的是,讲师是纯正的伦敦人,发音比较地道,听起来没什么障碍。

两天的课程,内容很多,还需要时间来消化,以后再以学习笔记的形式blog。今天就先看一下大的框架:

一、Agile宣言和Symbian Agile宣言:

Agile宣言:

1 、个体和交互胜过过程和工具

2 、可以工作的软件胜过面面俱到的文档

3 、客户合作胜过合同谈判

4 、相应变化胜过遵循计划

公司Agile宣言:

1、Agile团队对产品的发布负责;Agile团队拥有根据市场需求做重大决策的权力

2、系统总是在运行;核心是以自动化的测试和构造系统来反馈软件质量信息

3、与客户的沟通、协调、许诺仍然集中在长期的roadmaps和发布计划上

4、Prioritisation is at the centre of all engineering efforts, change is part

of the system to ensure consistency with customer priorities. Time

and quality is always maintained. The detailed scope is what changes

二、Agile团队必须要做的:

1. Development in iterations

2. Scope planning

3. The Agile Component Team / Product Owner contract

4. Lean requirements at scale

5. Frequent production-quality releases

6. Concurrent testing and integration

7. Adhere to product related reliability and security directives

8. Intentional architecture

9. Regular reflection

(有些东西还不是很理解究竟要做什么,看接下来的培训怎么说。)

三、Agile组织结构

1130

1130

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?