不懂微积分,如何精准调参和高效训练AI?

本文将从极限与导数、函数求导 函数最优化:梯度下降法三个方面,带您一文搞懂人工智能数学基础(上):微积分。

微积分

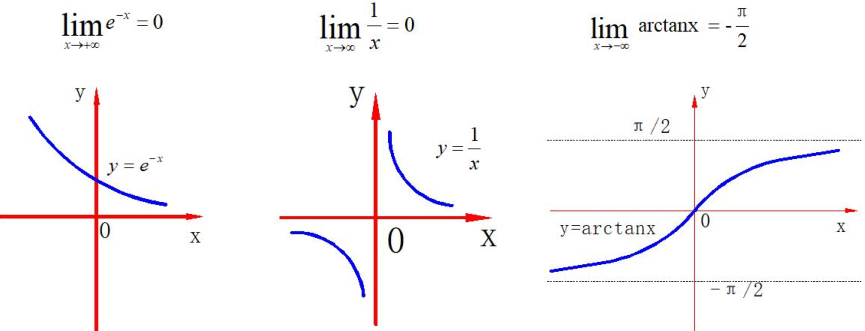

极限的本质: 无限靠近而永远不能到达。

极限的本质

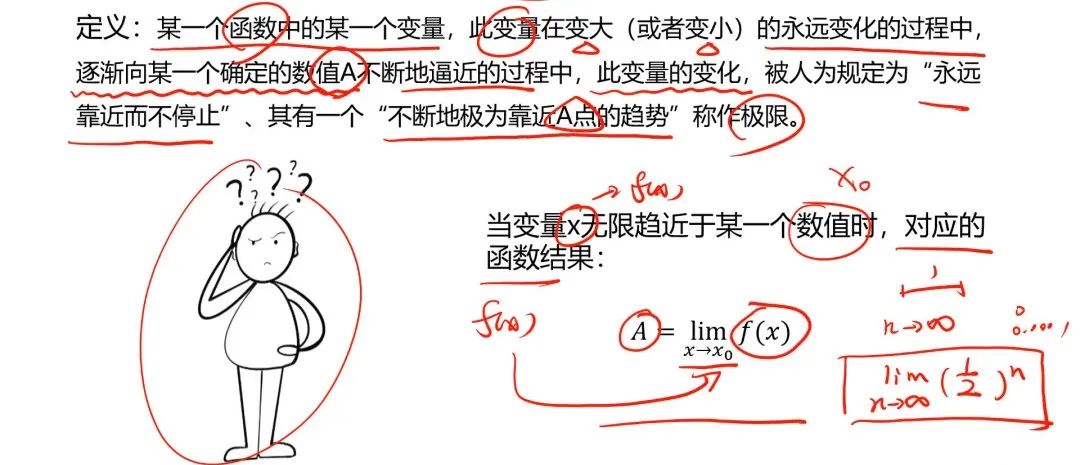

- 极限的定义:

极限的定义

-

极限的性质:

-

唯一性: 极限存在则唯一。

-

有界性: 收敛数列必有界。

-

保号性: 极限大于(或小于)0,则数列或函数值在极限点附近也大于(或小于)0。

-

极限的应用:

-

梯度下降算法: 通过迭代更新参数,使损失函数趋近于极限最小值。

-

神经网络收敛性: 极限理论用于分析神经网络训练是否达到预期效果。

-

概率论与统计: 大数定律和中心极限定理描述了随机变量的极限性质。

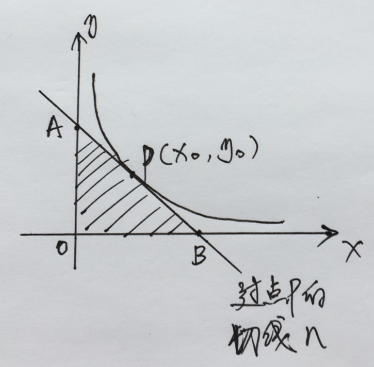

导数的本质: 反映了函数在某一点附近的局部性质,特别是函数图像的切线斜率和函数值的变化趋势。

导数的本质

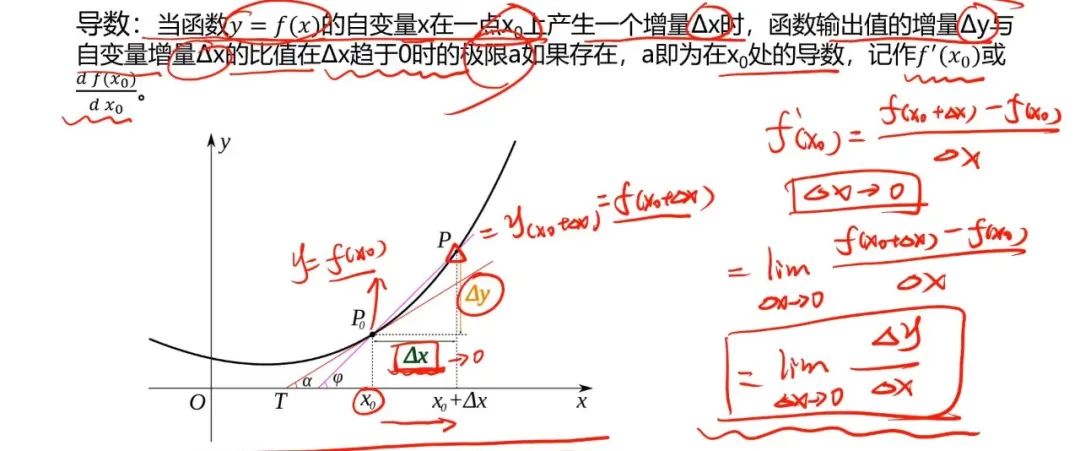

- 导数的定义:

导数的定义

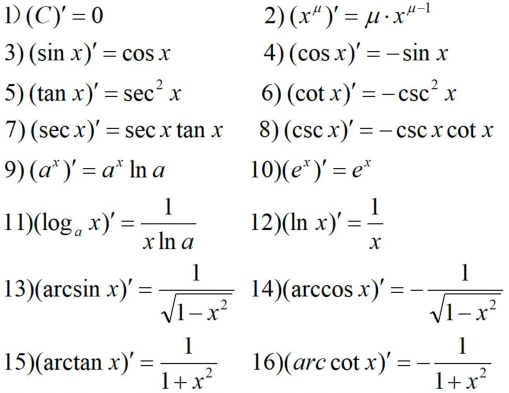

- 常用函数求导:

常用函数求导

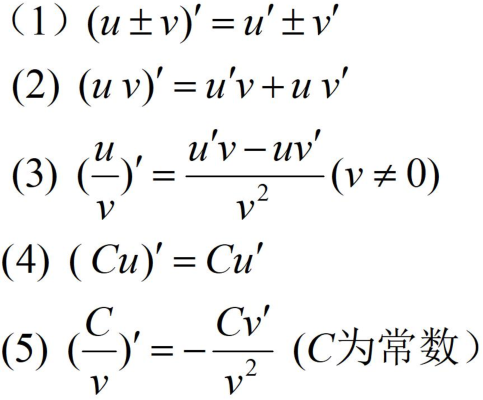

- 导数的四则运算:

导数的四则运算

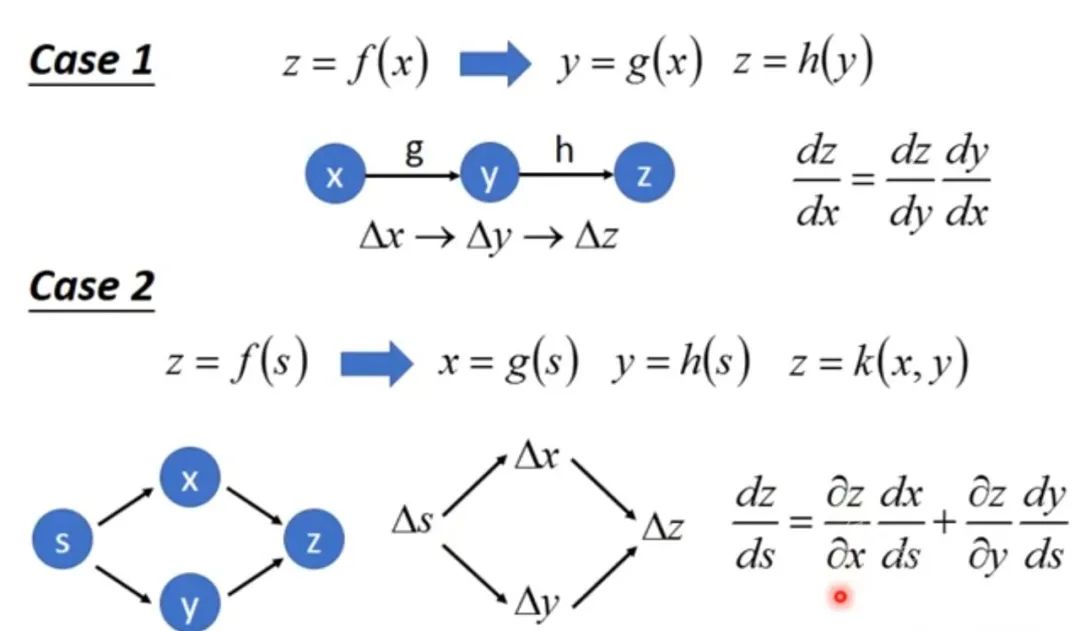

- 导数的链式法则:

导数的链式法则

一元函数求导: 求解函数在某点处切线的斜率或函数值随自变量变化的速率的过程。

一元函数求导

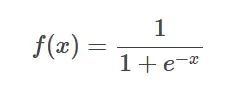

激活函数sigmoid是一种常用的非线性函数,可以将任何实数映射到0到1之间。它通常用于将不归一化的预测值转换为概率分布。

sigmoid函数公式

sigmoid函数公式

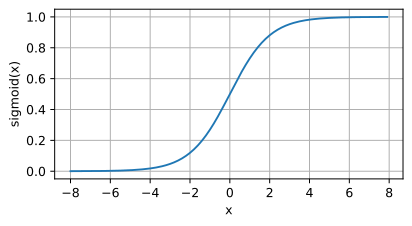

sigmoid函数图像

sigmoid函数图像

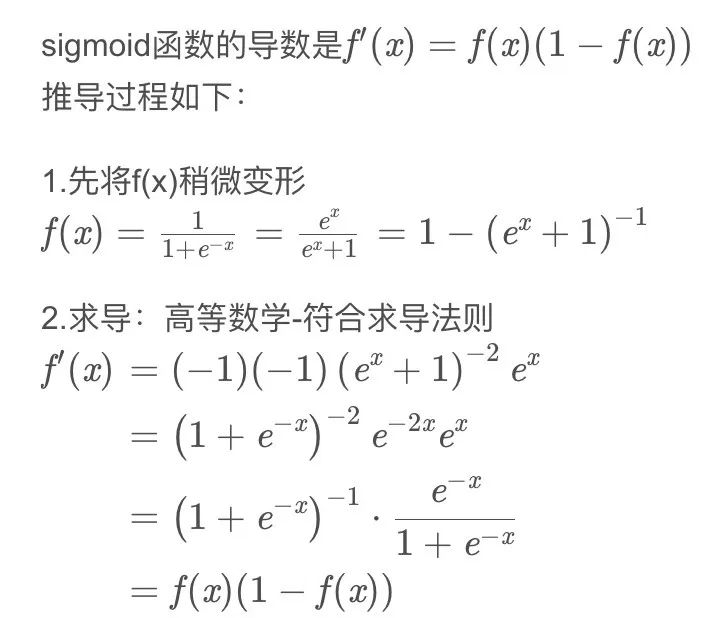

sigmoid求导过程

sigmoid函数求导过程

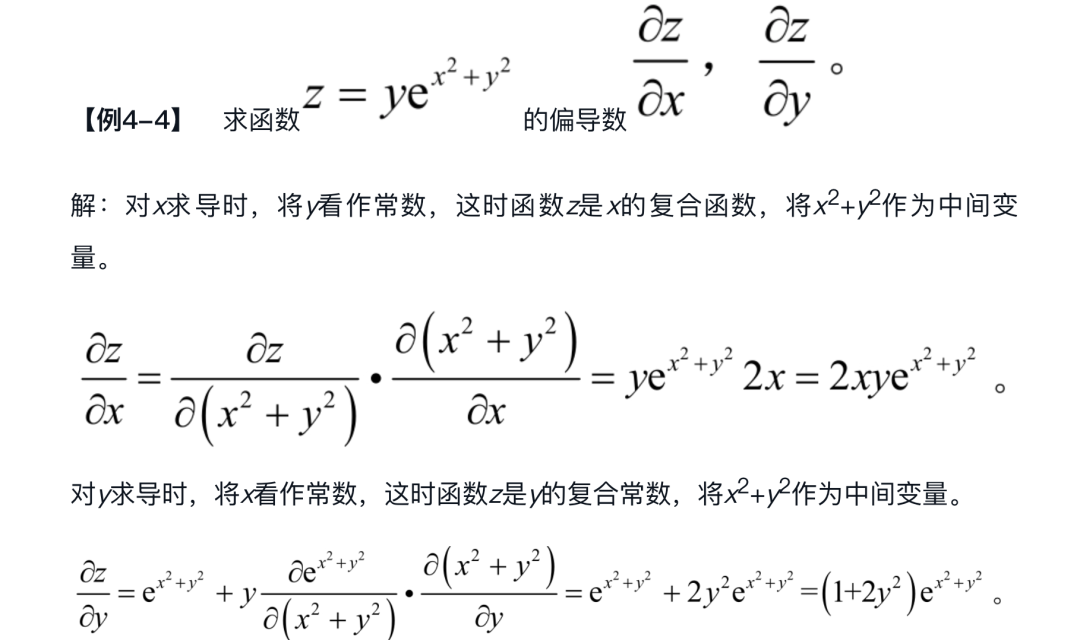

二元函数求导: 求解函数在某一点处关于两个自变量的偏导数,反映函数在该点附近沿不同方向的变化率。

二元函数求导

二元函数偏导数的计算是分别固定其中一个自变量,对另一个自变量求导,得到函数在该点处关于该自变量的偏导数。

二元函数偏导数的计算

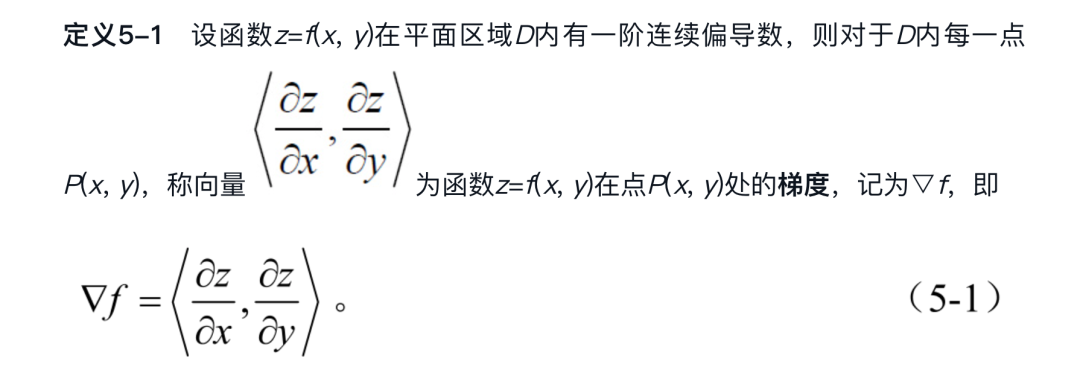

数学上可以证明,梯度方向是函数值增长最快的方向,而负梯度方向则是函数值下降最快的方向。

梯度的定义

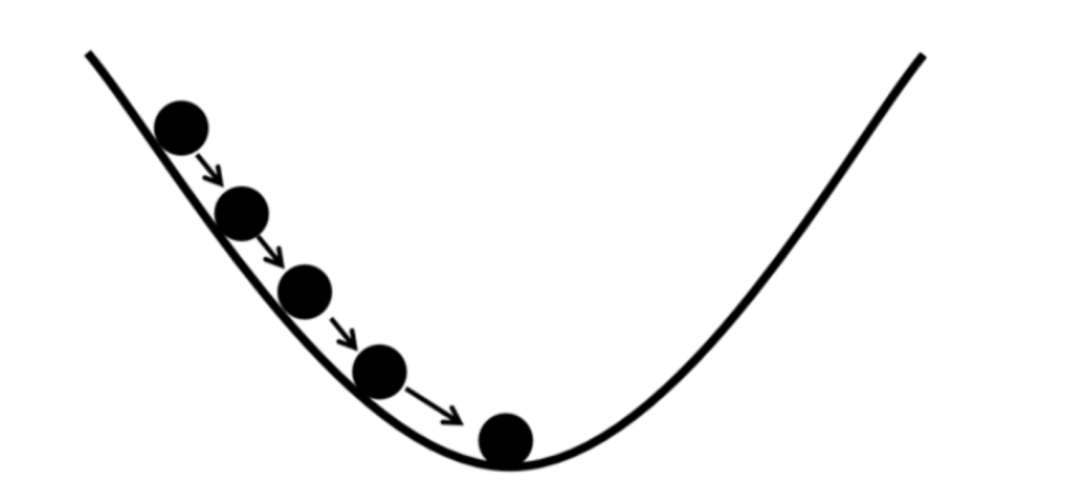

一元函数梯度下降法:通过不断沿函数下降方向调整参数,以寻找函数的最小值点或局部最优解。

一元函数梯度下降法

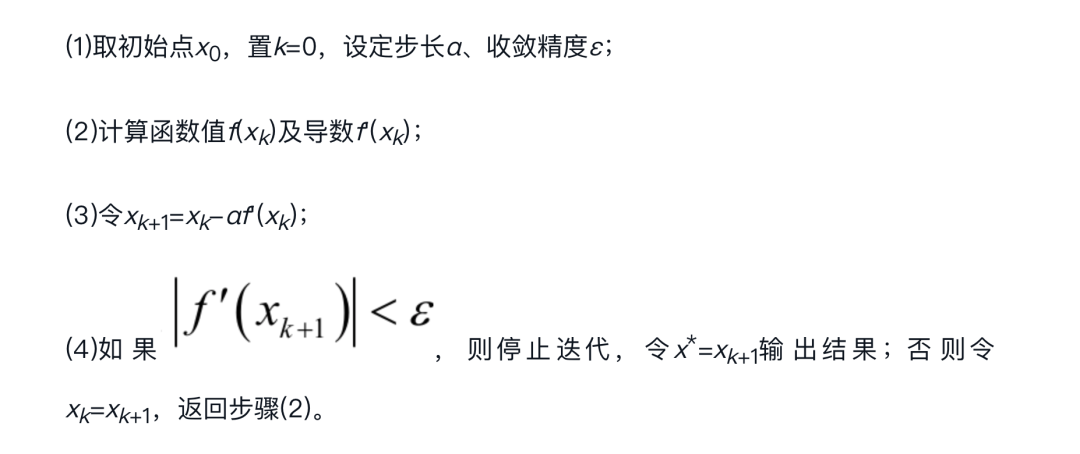

使用梯度下降法求y=f(x)极小值的步骤如下:

一元函数求解极小值

二元函数梯度下降法: 涉及处理多个变量,需计算每个变量的偏导数来确定下降方向,计算过程复杂,还需考虑变量间的相互影响,以实现全局或局部最小值。

二元函数梯度下降法

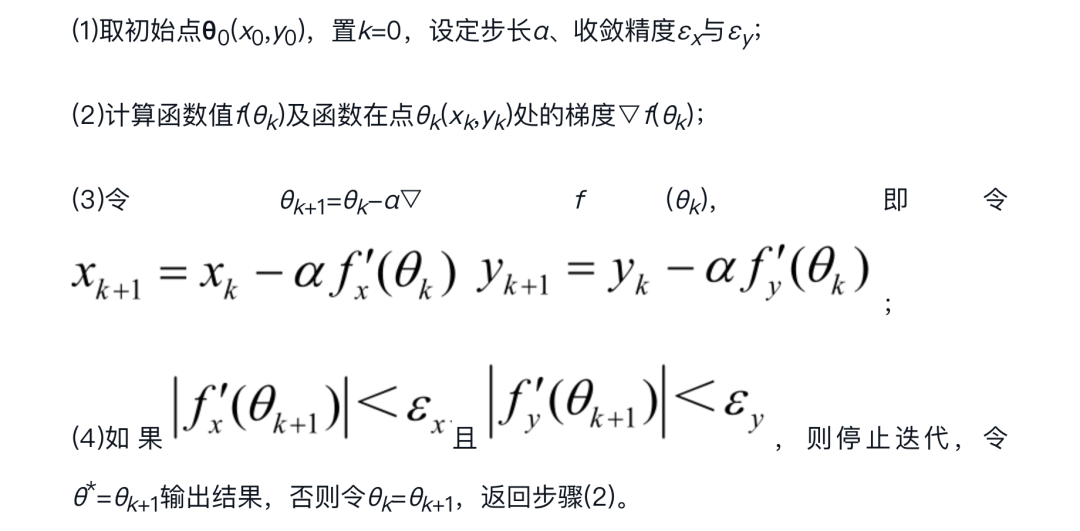

使用梯度下降法求z=f(x, y)极小值的步骤如下:

二元函数求解极小值

如何系统的去学习大模型LLM ?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高

针对所有自学遇到困难的同学们,我帮大家系统梳理大模型学习脉络,将这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码领取🆓↓↓↓

👉[CSDN大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)]()👈

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?