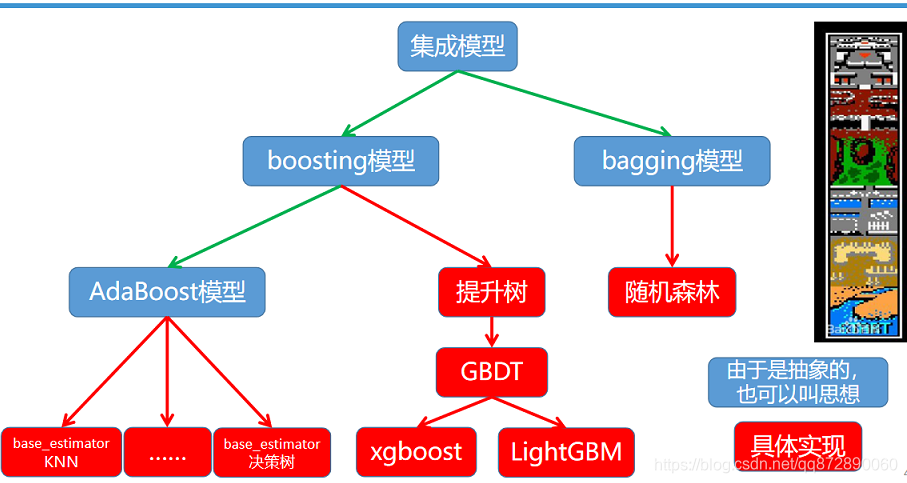

集成学习模型一览

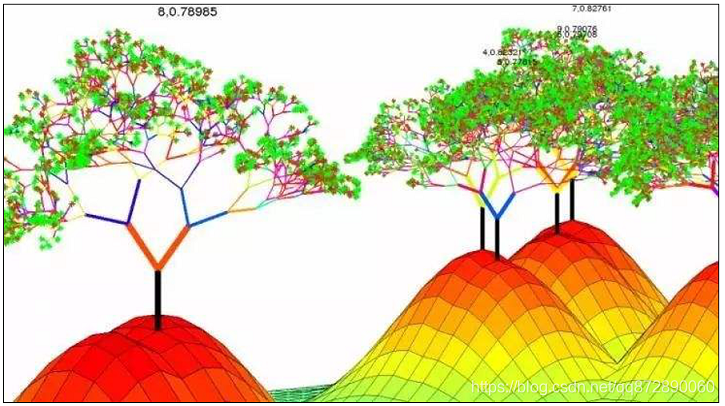

随机森林

走进森林,参天大树一棵棵相继出现

概念介绍

随机森林是基于决策树的集成学习模型,如果将一颗决策树比作一个决策者,那么随机森林就是一群决策者共同决定一件事情,所以相比于决策树等单个学习器的模型,随机森立的准确度和泛化能力往往更好和更高。

随机森林是多个学习器并行计算的算法模型,通过一定的结合策略,将这些弱学习器有机组合起来,形成一个强的学习器。

优点

- 机器学习中最成功的算法之一

- 可以做二分类,多分类,回归等学习任务

- 不需要特征缩放

- 可以捕获非线性关系

- 算法可以并行

随机森林的随机

随机森林的随机体现在样本随机和特征随机。

- 样本随机的目的是,增大样本的随机性,进而减少了模型的相似性,那么就降低了模型的相关性,也就是说提高了整体模型的健壮性,统一地说就是为了增加模型的泛化能力。

- 特征随机的目的是,不使用所有特征,可以更简单地划分平面,增强模型的可解释性,缩短了模型的训练时间,移除不重要的特征,达到降维效果的同时,去除选择不好特征的可能性。

- 样本随机产生的方法是:bootstrapping(拔靴法),有放回抽样。

- 特征随机产生的方法是:

简单法:随机从原始特征中抽取不重复的特征

复杂法:随机从原始特征中抽取不重复分特征,再将这些特征合并,产生新的特征。

特征选择的思考

如果可以计算出每个特征的重要性,即 importance(k) for k = 1, 2, … ,d。那就能将不重要的特征舍弃,达到降维的效果

置换检验

- 介绍:置换检验是统计学中显著性检测的一种

- 思想:如果特征k是重要的,那么用随机的值将该特征破坏&#

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?