总结:这篇文章首次将原始点云和基于图像和点云Depth Comopletion生成的伪点云进行融合,提出了3D-GAF和CPFE模块以及同步数据增强在KITTI上取得了sota,实验也表明该方法对Depth Comopletion具有鲁棒性,整个pipeline可以作为一个Frame

Abstract

稀疏点云由于缺乏几何和语义信息造成检测性能下降,为了提高远处和被遮挡的点云的检测质量,本文提出利用深度补全基于稀疏点云和图像生成伪点云与原始点云融合的方式的多模态融合框架SFD,同时提出三个创新点:

1.3D-GAF:这是一种新的RoI特征融合方法,在网格级进行特征融合同时融入注意力机制

2.CPFE:基于图像做空洞近邻搜索,在伪点云中同时融合3D几何特征与2D语义特征

3.SynAugment:在伪点云和原始点云中同步数据增强

Introduction

说明在远处和被遮挡的区域稀疏点云会造成检测困难,同时总结目前多模态融合方法比纯lidar方法性差的主要原因:

1.维度差异: 图像是规则的高分辨率的2维数据,点云是稀疏的3维数据

2.信息损失:根据外参将点云投影到图像上找点云特征会由于点云的稀疏性造成图像的信息的损失

3.数据增强: 由于点云和图像存在对应关系,纯lidar的数据增强方法难以直接应用

Method

1.整体网络结构

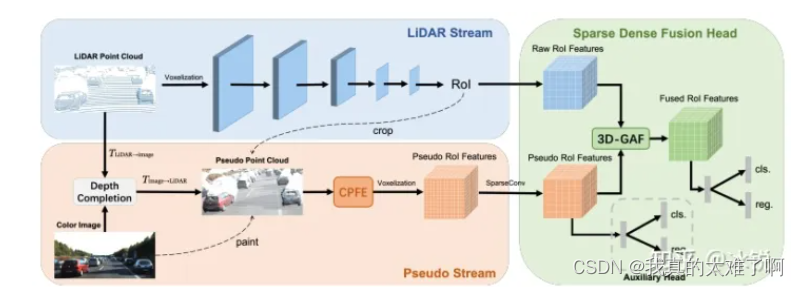

整个网络主要由3部分组成: LiDAR Stream, Pseudo Stream and Sparse Dense Fusion Head

LiDAR Stream:处理原始点云,获取RoI

Pseudo Stream:首先结合点云稀疏投影和原始图像做Depth Completion生成带有颜色的伪点云,然后根据LiDAR Stream:的RoI截取点云特征,通过CPFE模块提取特征,最后voxelize并利用sparse convolution进一步提取特征

Sparse Dense Fusion Head:在3D-GAF中融合原始点云和伪点云RoI特征

最后根据融合特征进行预测,回归损失采用3D GIoU损失,同时增加辅助分支去正则化网络(在inference阶段去除)

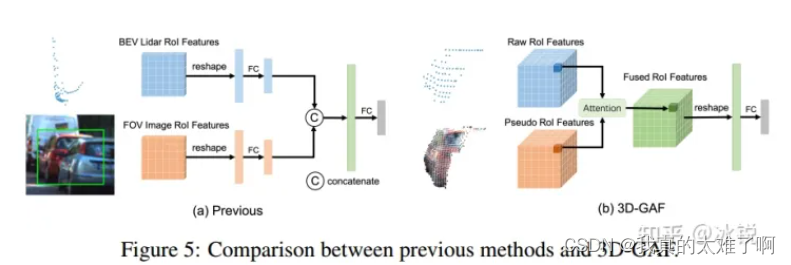

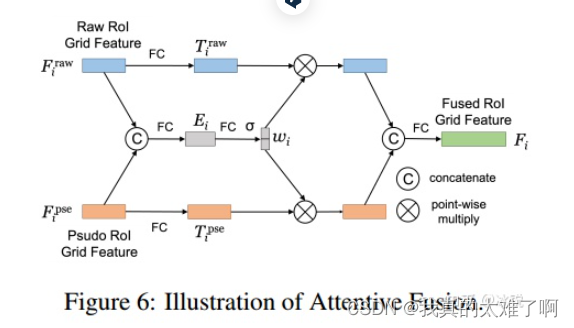

2.3D-GAF

3D-GAF与MMF相比在网格级的细粒度(fine-grained)上进行融合,同时Attention机制,可以避免之前的在2D平面融合因遮挡产生的特征混淆。

在Attention中通过FC层学习权重,相乘后在拼接。

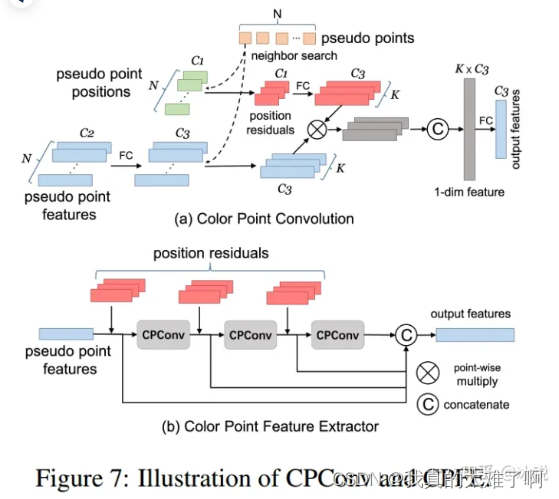

3.CPFE

这里受到Voxel RCNN的启发,在图像域(image domain)上进行空洞近邻查找,在提高receptive field的同时,可以在constant time内完成查找,

其次,在image domain上的近邻可以提取图像的2D特征,同时根据伪点云的(u, v)坐标可以容易地找到其在图像上的近邻 (这里在2D图像上进行查找是否考虑存在遮挡问题???)

在查找到每个点的k个近邻后,利用pointnet提取Pseudo Point Features ,同时计算该点与附近点的Position Residuals,利用pointnet提取局部特征作为weight与Pseudo Point Features相乘(类似Attention机制)

这里构成了CPC模块

CPFE模块是CPConvs的多尺度堆叠,融合高低层次特征

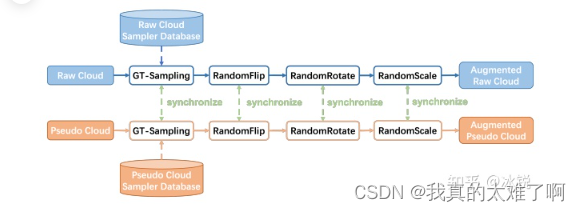

4.Synchronized Augmentation

对点云和伪点云同步数据增强

5.结果

在遮挡,远距离和前景与背景形状相似的情况下,本方法均有提升

3721

3721

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?