下面这俩篇文章不错

Back-propagation, an introduction

1 why 反向传播算法?

- 1.神经网络损失函数是什么?

- 2.怎样通过损失函数来更新模型参数,即w,b?

- 3.重点是如何求损失函数对每一层w,b的导数,假如很多层,如何计算更有效?

- 4.更新的表达式是什么?

2 反向传播算法的优点?

通过下一层的参数更新值来求这一层的更新值,加快求导过程,即后向传播算法。

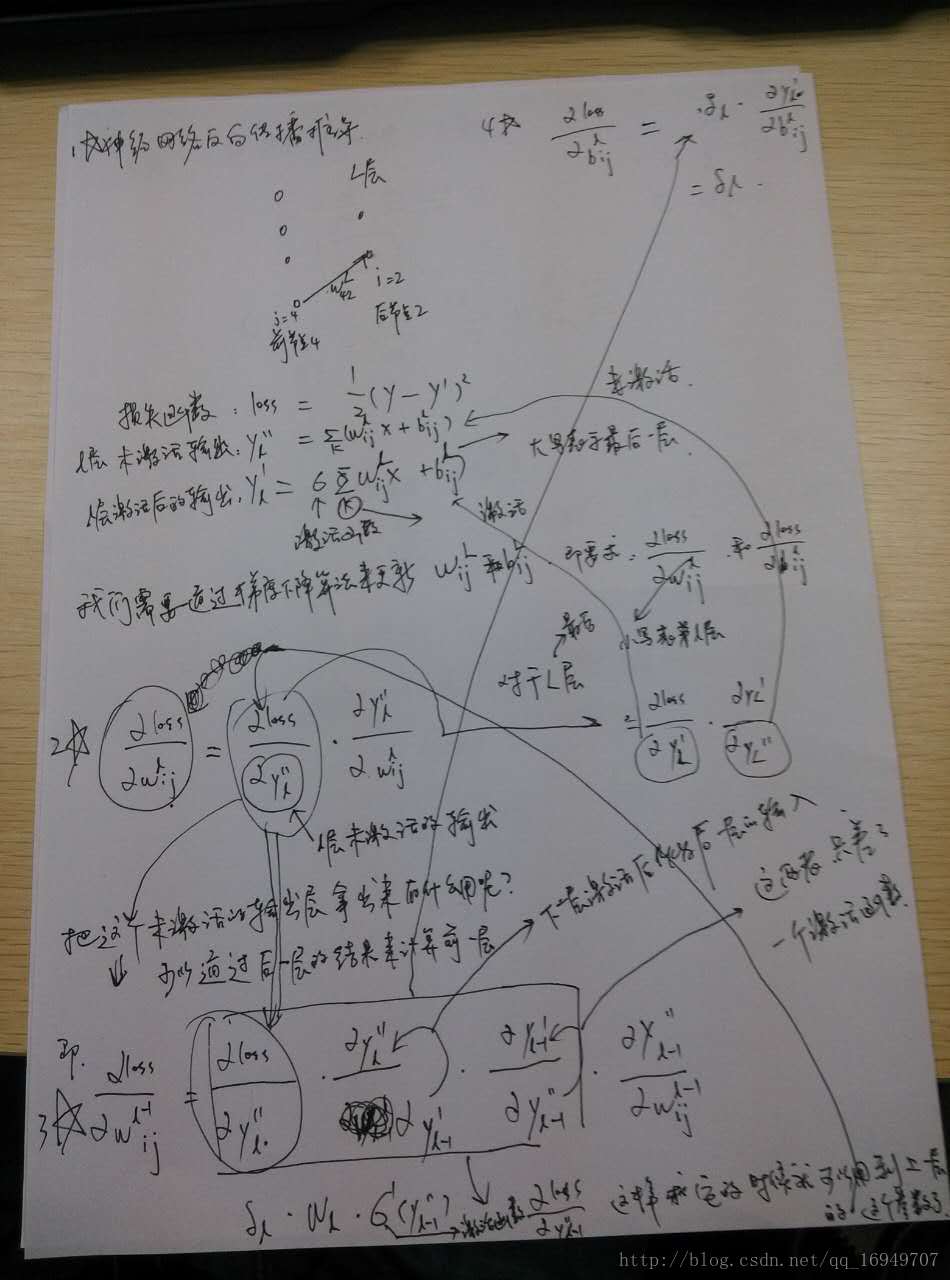

3 反向传播算法推导总流程

- 1.参数定义,以及明确我们的目标是利用反向传播原理来加快对参数求导的过程!!!

- 2.最后一层对w,b的导数是什么?

- 3.如何利用后面的层来更新前面的层?即后面层与前面层的关系!

- 4.权重更新公式!

下图对应上述几个步骤:

最后多层推导过程及更新公式可以参考这个:

反向传播算法(过程及公式推导)

多层神经网络BP算法 原理及推导

618

618

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?