❤️ 如果你也关注 AI 的发展现状,且对 AI 应用开发感兴趣,我会每日分享大模型与 AI 领域的开源项目和应用,提供运行实例和实用教程,帮助你快速上手AI技术!

🥦 AI 在线答疑 -> 智能检索历史文章和开源项目 -> 尽在微信公众号 -> 搜一搜:蚝油菜花 🥦

🎬 “剪辑师危机!这个AI把文案变电影:输入标题3分钟出成片,小白躺赚短视频红利”

大家好,我是蚝油菜花。你是否也经历过——

- 👉 想蹭热点但不会剪辑,眼睁睁错过流量风口

- 👉 熬夜剪视频到凌晨,播放量始终不过500

- 👉 请外包做一条剧情视频,报价够买十台iPhone

今天揭晓的 Story-flicks 正在掀起内容革命!这个支持多模型联动的AI神器,只需输入故事主题:

- ✅ 智能编剧:深度学习爆款结构自动生成剧本

- ✅ 跨模态生成:同步输出4K画面+情感化配音

- ✅ 字幕智能卡点:连抖音黄金3秒法则都帮你算好

无论是教学视频、品牌推广,还是儿童故事,Story-flicks 都能为你提供高效、便捷的创作体验。接下来,让我们一起探索这款神奇的工具吧!

🚀 快速阅读

Story-flicks 是一款基于AI大模型的视频生成工具,支持一键生成高清故事短视频。

- 核心功能:支持文本生成、图像生成、音频合成、字幕添加和视频合成。

- 技术原理:后端基于Python和FastAPI框架,前端使用React、Ant Design和Vite构建,支持多种AI模型提供商。

Story-flicks 是什么

Story-flicks 是一款基于AI大模型的视频生成工具,支持一键生成高清故事短视频。用户只需输入故事主题,系统便会基于AI技术生成包含图像、文本、音频和字幕的短视频。该项目支持多种模型提供商,如OpenAI、阿里云等,用户可以根据需求选择不同的文本和图像生成模型。

生成的视频长度取决于用户设置的故事片段数量。Story-flicks 基于灵活的配置和一键生成的功能,为用户提供了一种高效、便捷的短视频创作方式。

Story-flicks 的主要功能

- 文本生成:根据主题生成故事脚本。

- 图像生成:为每个故事片段生成对应的高清图像。

- 音频合成:为视频添加语音旁白。

- 字幕添加:在视频中嵌入字幕。

- 视频合成:将生成的图像、文本、音频和字幕整合成完整的短视频。

Story-flicks 的技术原理

- 后端架构:基于Python和FastAPI框架搭建后端服务,负责处理用户请求、调用AI模型、管理数据流和视频合成。

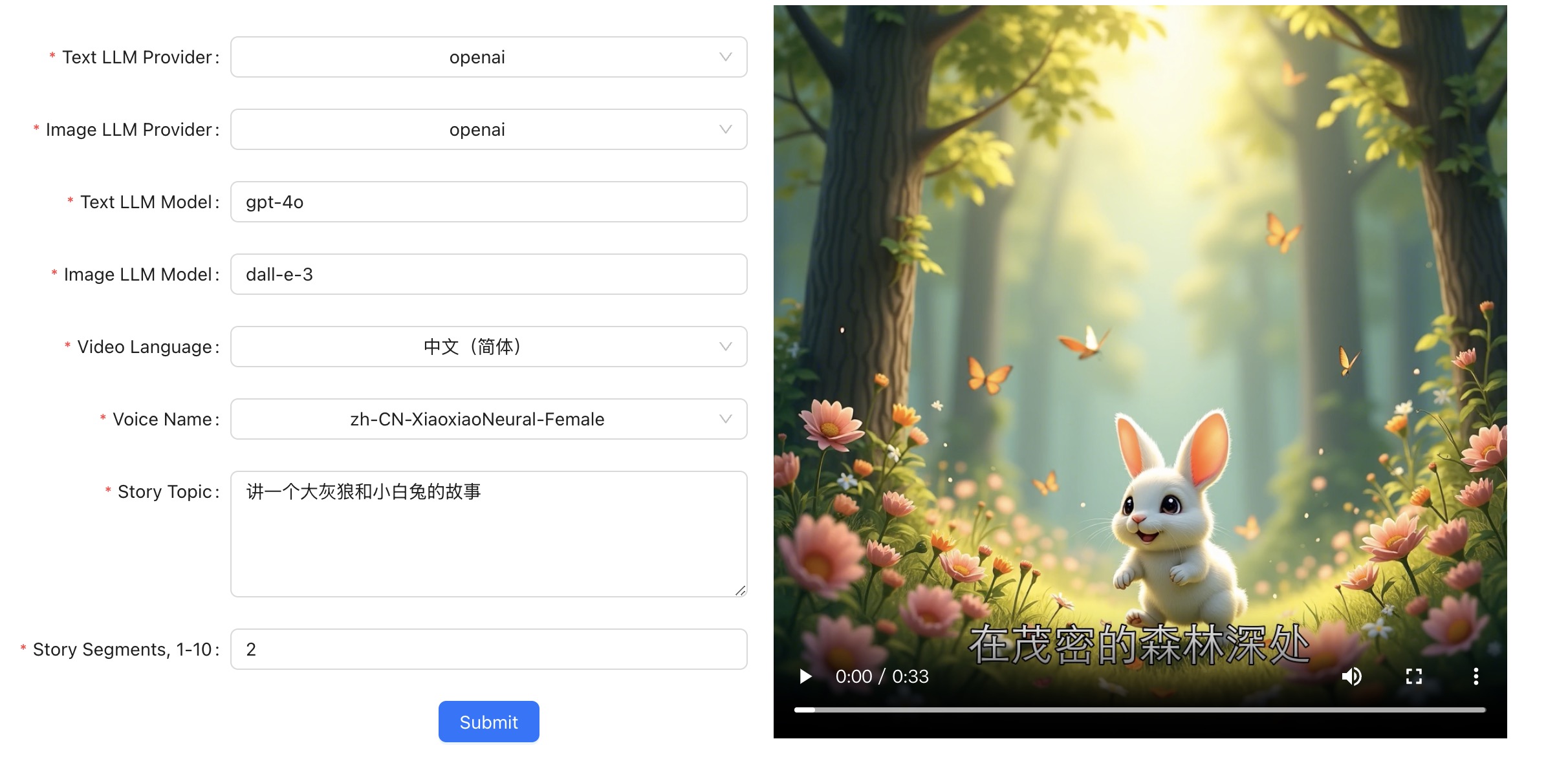

- 前端架构:基于React、Ant Design和Vite构建用户界面,提供交互式操作,让用户能选择模型、设置参数、触发视频生成。

- 多模型支持:支持多种AI模型提供商(如OpenAI、阿里云、DeepSeek等),用户根据需求选择不同的模型优化生成效果。

如何运行 Story-flicks

1. 下载项目

git clone https://github.com/alecm20/story-flicks.git

2. 设置模型信息

# 首先切换到项目的后端目录

cd backend

cp .env.example .env

在 .env 文件中设置以下内容:

text_provider = "openai" # 文本生成模型的提供商,目前支持 openai、aliyun、deepseek、ollama 和 siliconflow。

image_provider = "aliyun" # 图像生成模型的提供商,目前支持 openai、aliyun 和 siliconflow。

openai_base_url="https://api.openai.com/v1" # OpenAI 的基础 URL

aliyun_base_url="https://dashscope.aliyuncs.com/compatible-mode/v1" # 阿里云的基础 URL

deepseek_base_url="https://api.deepseek.com/v1" # DeepSeek 的基础 URL

ollama_base_url="http://localhost:11434/v1" # Ollama 的基础 URL

siliconflow_base_url="https://api.siliconflow.cn/v1" # SiliconFlow 的基础 URL

openai_api_key= # OpenAI 的 API 密钥

aliyun_api_key= # 阿里云 Bailian 的 API 密钥

deepseek_api_key= # DeepSeek 的 API 密钥

ollama_api_key= # Ollama 的 API 密钥

siliconflow_api_key= # SiliconFlow 的 API 密钥

text_llm_model=gpt-4o # 文本生成模型

image_llm_model=flux-dev # 图像生成模型

3. 启动项目

3.1 手动启动

启动后端项目

# 首先切换到项目根目录

cd backend

conda create -n story-flicks python=3.10 # 使用 conda,也可以使用其他虚拟环境

conda activate story-flicks

pip install -r requirements.txt

uvicorn main:app --reload

启动前端项目

# 首先切换到项目根目录

cd frontend

npm install

npm run dev

3.2 使用 Docker 启动

在项目根目录下运行:

docker-compose up --build

4. 开始使用

在界面中选择文本生成模型提供商、图像生成模型提供商、文本模型、图像模型、视频语言、语音、故事主题和故事片段,然后点击“生成”按钮即可生成视频。

资源

- GitHub 仓库:https://github.com/alecm20/story-flicks

❤️ 如果你也关注 AI 的发展现状,且对 AI 应用开发感兴趣,我会每日分享大模型与 AI 领域的开源项目和应用,提供运行实例和实用教程,帮助你快速上手AI技术!

🥦 AI 在线答疑 -> 智能检索历史文章和开源项目 -> 尽在微信公众号 -> 搜一搜:蚝油菜花 🥦

440

440

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?