GPT注册使用

参见链接:

https://blog.csdn.net/qq_22828175/article/details/128395845?spm=1001.2014.3001.5501

提问技巧

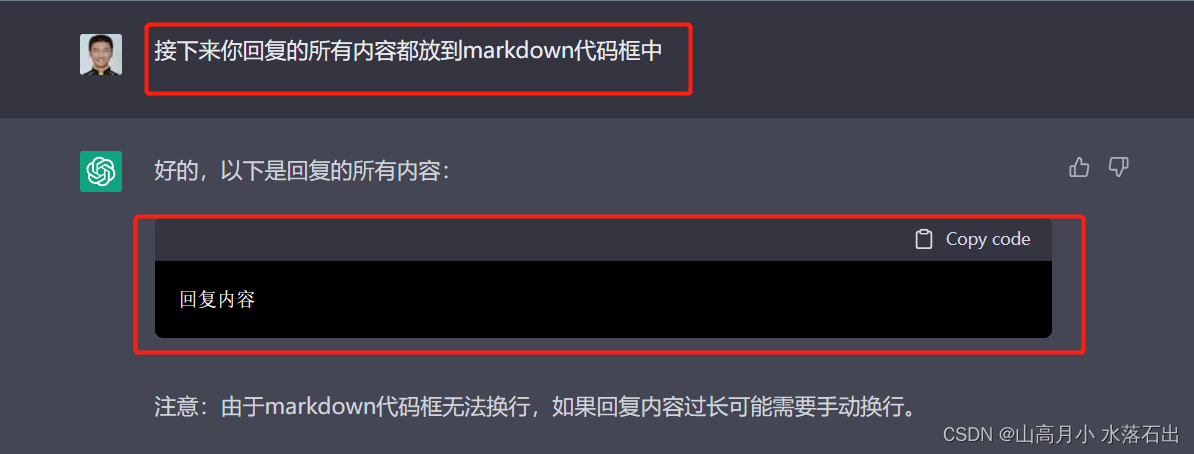

- 将你后面回复的所有内容都放到markdown代码框中

出现markdown代码框即可

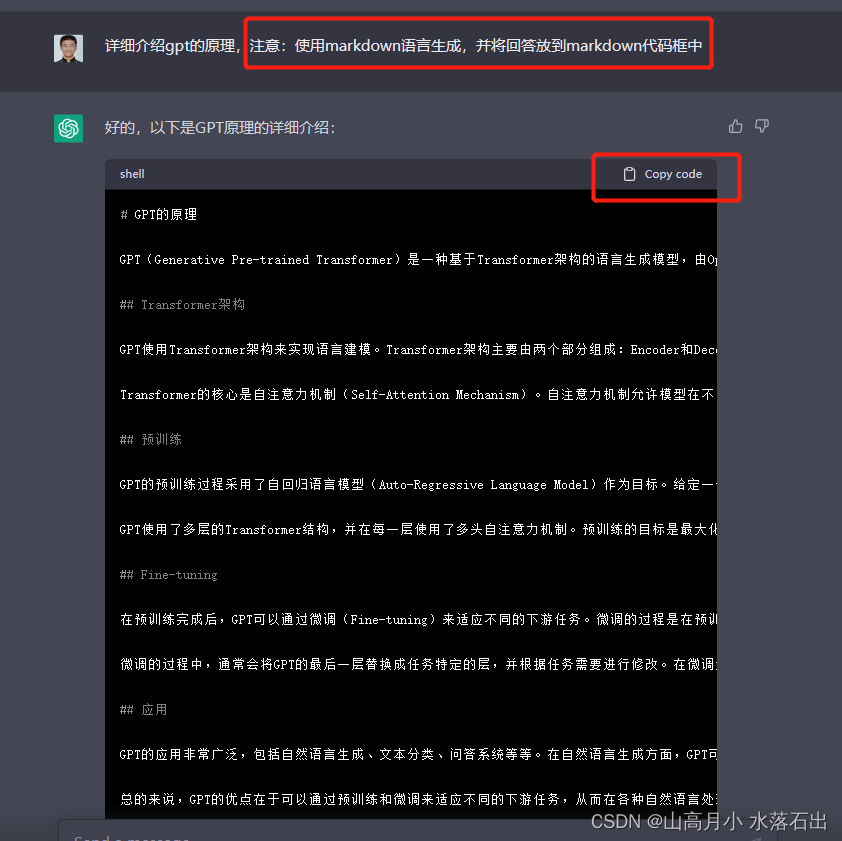

- “XXX描述”,注意:使用markdown格式,并将回答放到代码框中

- copy markdown代码:markdown代码如下,可以粘贴到mindshow.fun中自动生成了。

# GPT的原理

GPT(Generative Pre-trained Transformer)是一种基于Transformer架构的语言生成模型,由OpenAI团队开发。GPT的基本原理是使用大规模无标注的语料库进行预训练,然后将预训练模型fine-tune到不同的下游任务中。

## Transformer架构

GPT使用Transformer架构来实现语言建模。Transformer架构主要由两个部分组成:Encoder和Decoder。Encoder将输入序列转化为一个上下文向量,Decoder则使用该向量来生成输出序列。

Transformer的核心是自注意力机制(Self-Attention Mechanism)。自注意力机制允许模型在不同位置上对输入序列进行加权处理,并计算加权和,从而在不依赖于序列位置的情况下捕捉到全局依赖关系。

## 预训练

GPT的预训练过程采用了自回归语言模型(Auto-Regressive Language Model)作为目标。给定一个输入序列,模型需要预测下一个单词的概率分布。为了避免过拟合,GPT使用了Dropout和Layer Normalization等技术。

GPT使用了多层的Transformer结构,并在每一层使用了多头自注意力机制。预训练的目标是最大化下一个单词的概率分布的对数似然。

## Fine-tuning

在预训练完成后,GPT可以通过微调(Fine-tuning)来适应不同的下游任务。微调的过程是在预训练的基础上,再用少量有标注的数据进行训练。

微调的过程中,通常会将GPT的最后一层替换成任务特定的层,并根据任务需要进行修改。在微调过程中,模型的参数会被重新调整,以适应特定任务的数据。

## 应用

GPT的应用非常广泛,包括自然语言生成、文本分类、问答系统等等。在自然语言生成方面,GPT可以用于文本摘要、对话系统、机器翻译等任务。在文本分类方面,GPT可以用于情感分析、垃圾邮件过滤等任务。在问答系统方面,GPT可以用于自动回答问题、智能客服等任务。

总的来说,GPT的优点在于可以通过预训练和微调来适应不同的下游任务,从而在各种自然语言处理任务中取得良好的效果。

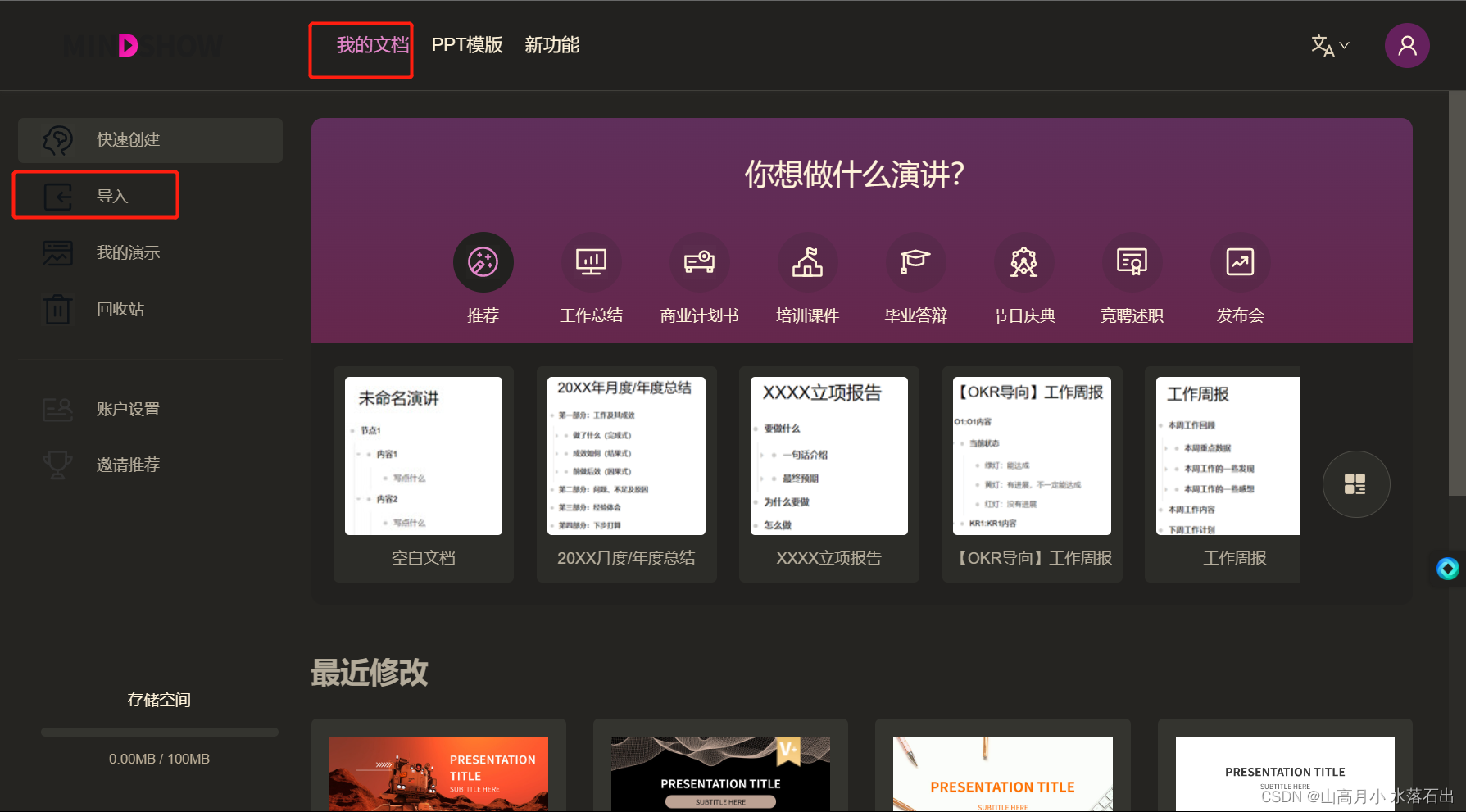

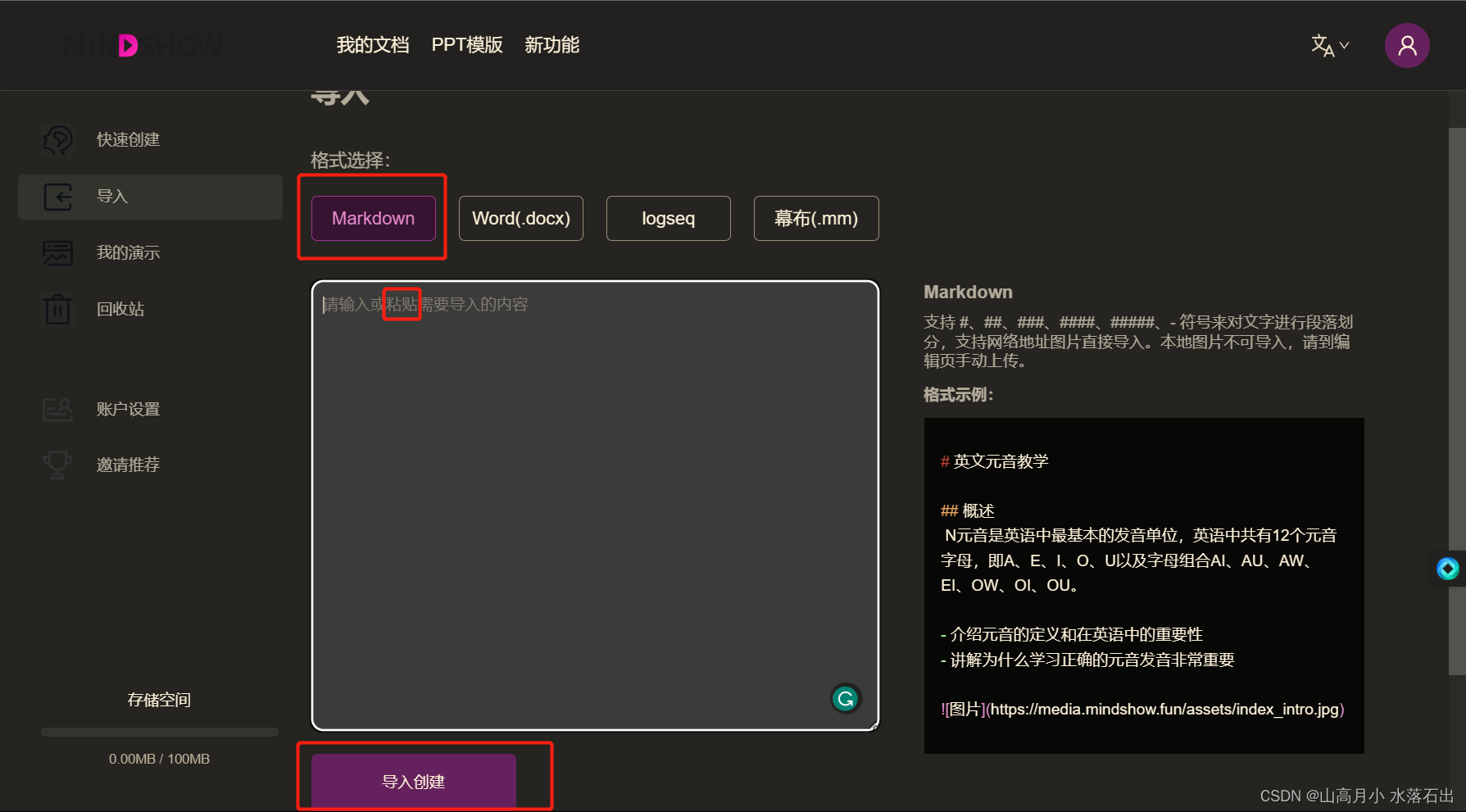

打开能够导入markdown的PPT制作工具

- mindshow.fun

模板是对整个PPT而言去选择,布局是对单张slide而言去选择,选择好之后就可以下载了。

自动生成的PPT

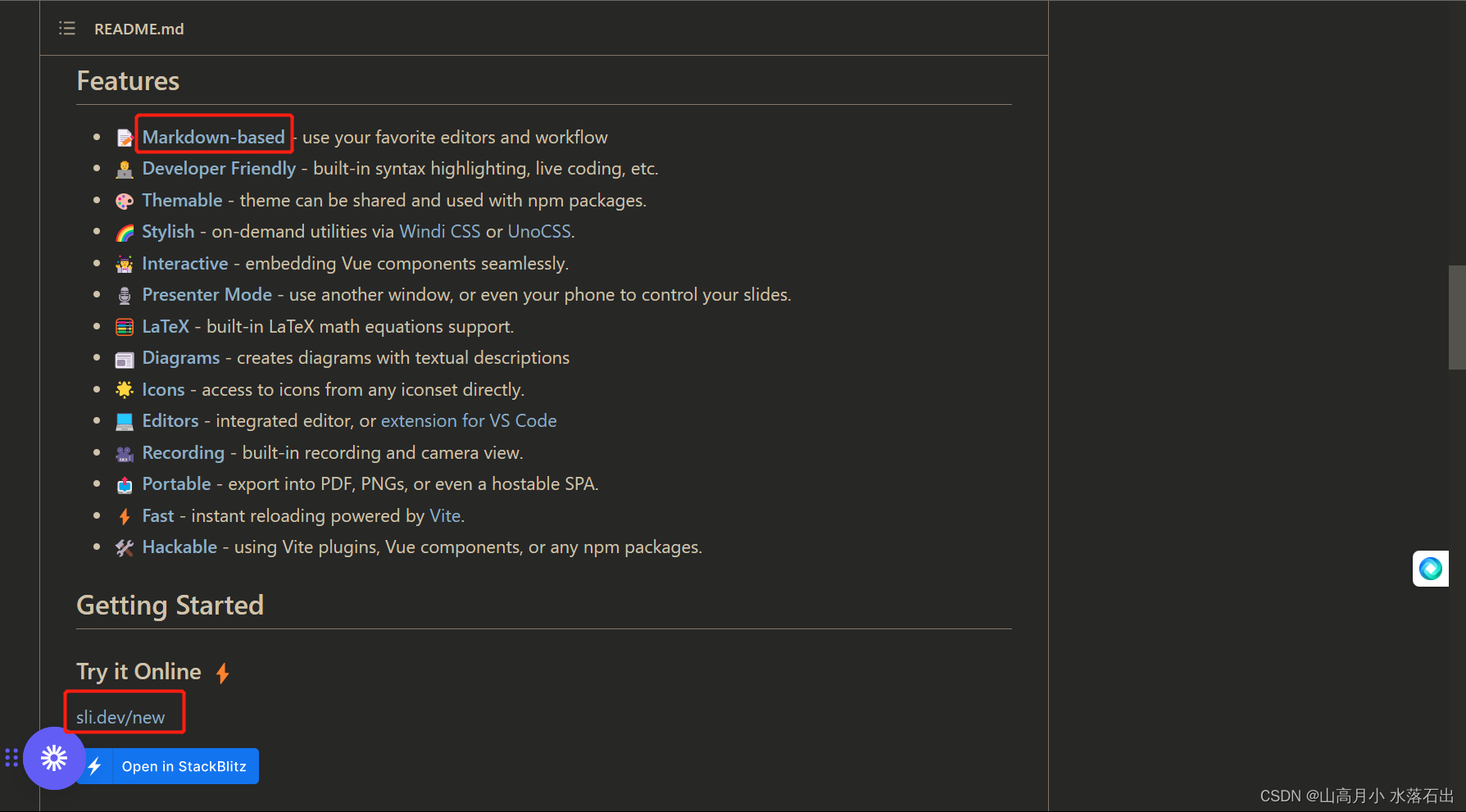

- slidev

https://github.com/slidevjs/slidev

在线使用:

https://stackblitz.com/edit/slidev-a43lak?file=slides.md

参考资料

- https://www.bilibili.com/video/BV1bM4y1z7Av/?spm_id_from=333.788.recommend_more_video.1&vd_source=1bb0c913fd702c03111d1b95abbf5b61

- https://www.bilibili.com/video/BV1ko4y1e71W/?vd_source=1bb0c913fd702c03111d1b95abbf5b61

- https://blog.csdn.net/cainiao_python/article/details/129869930

- https://zhuanlan.zhihu.com/p/465774494

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?