Exploiting temporal consistency for real-time video depth estimation∗

Github

摘要

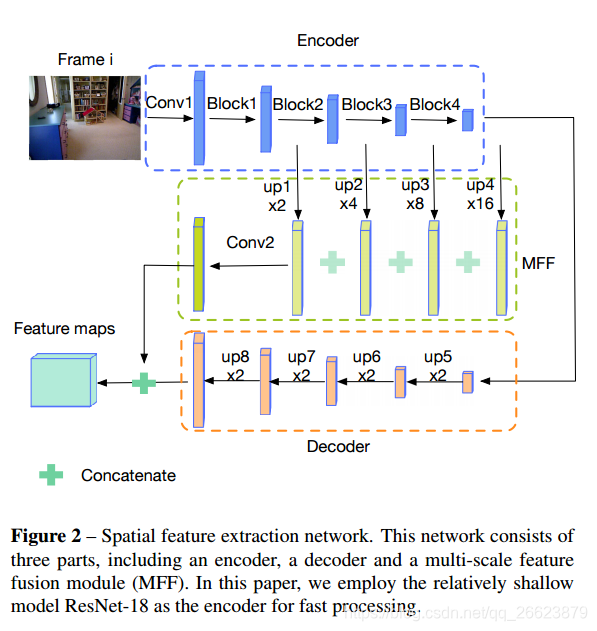

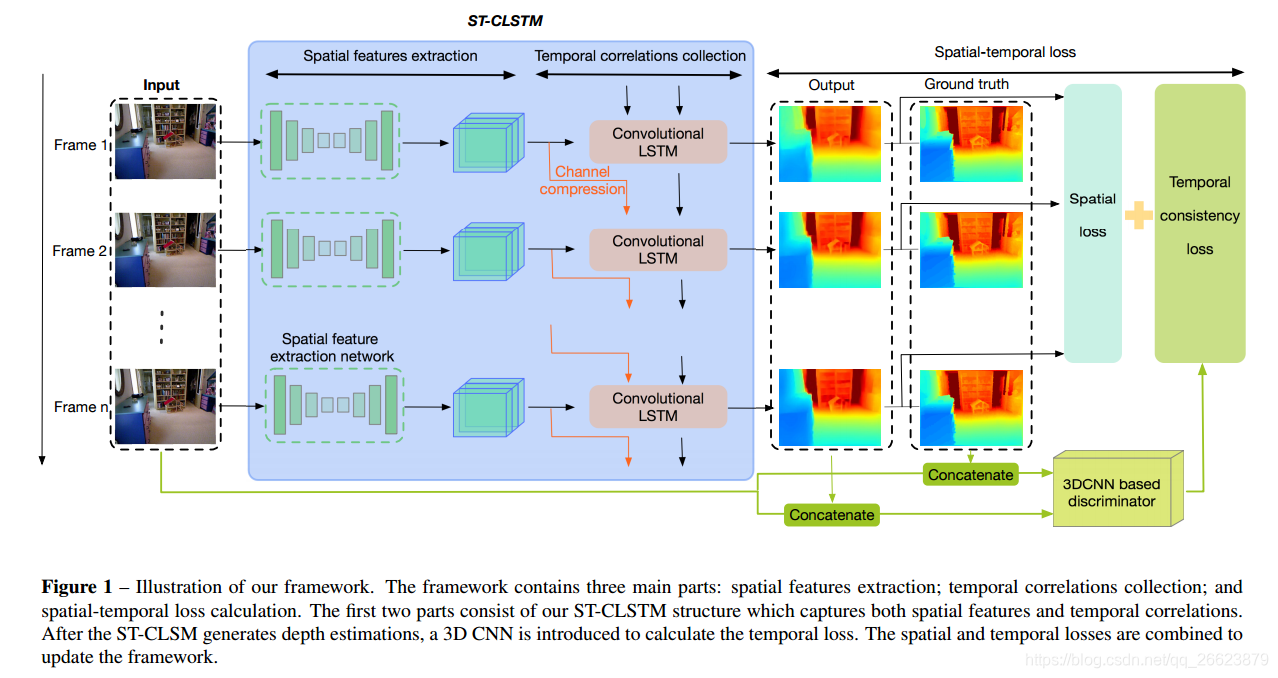

近年来,利用深卷积神经网络(cnns)的层次特征,提高了静态图像深度估计的精度。与静态图像相比,视频帧之间存在大量的信息,并且可以利用这些信息来提高深度估计性能。在这项工作中,我们着重于探索单眼视频中的时间信息以进行深度估计。具体来说,我们利用卷积长短期记忆(clstm)的优点,提出了一种新的时空csltm(st-clstm)结构。我们的ST-CLSTM结构不仅可以捕获连续视频帧的空间特征,而且可以捕获连续视频帧之间的时间相关性/一致性,计算开销几乎没有增加。此外,为了保持估计深度帧之间的时间一致性,我们采用生成性对抗学习方案,并设计了时间一致性损失。将时间一致性损失和空间一致性损失结合起来,对模型进行端到端的更新。通过利用时间信息,我们构建了一个实时运行的视频深度估计框架,产生了视觉上令人满意的结果。此外,我们的方法是灵活的,可以推广到大多数现有的深度估计框架。

贡献

我们提出了一种新的ST-CLSTM结构,该结构能够捕获用于视频深度估计的空间特征和时间相关性。据我们所知,这是clstm首次用于视频深度估计。

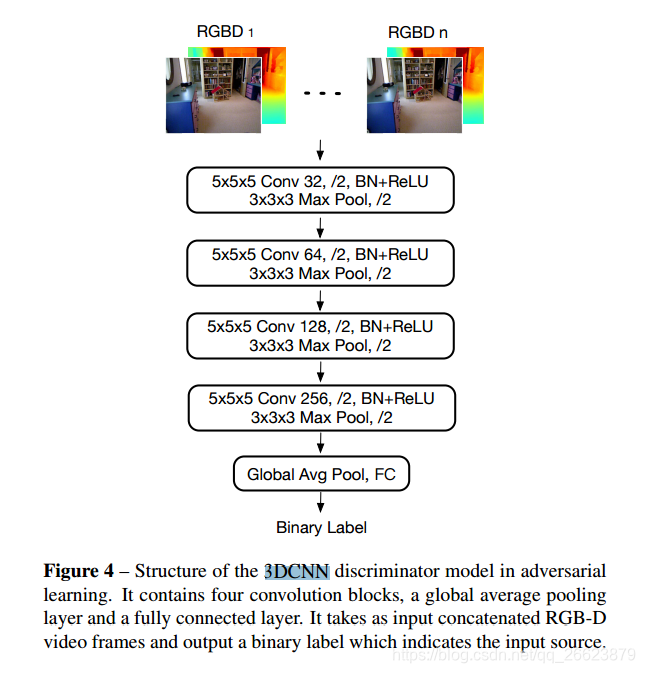

•我们使用生成性对抗学习方案设计了一种新的时间一致性损失。我们的时间损失可以进一步增强时间一致性,提高视频深度估计的性能。

•我们提出的视频深度估计框架可以实时执行,并且可以推广到大多数现有的深度估计框架。

空间-时间一致性深度生成网络

作者首次将空间一致性和时间一致性结合,在RGB encode 提取特征,通过融入时间一致性提高估计精度

有监督 GAN网络

输出深度和实际深度用GAN网络鉴别

同时输入网络,对抗训练方法

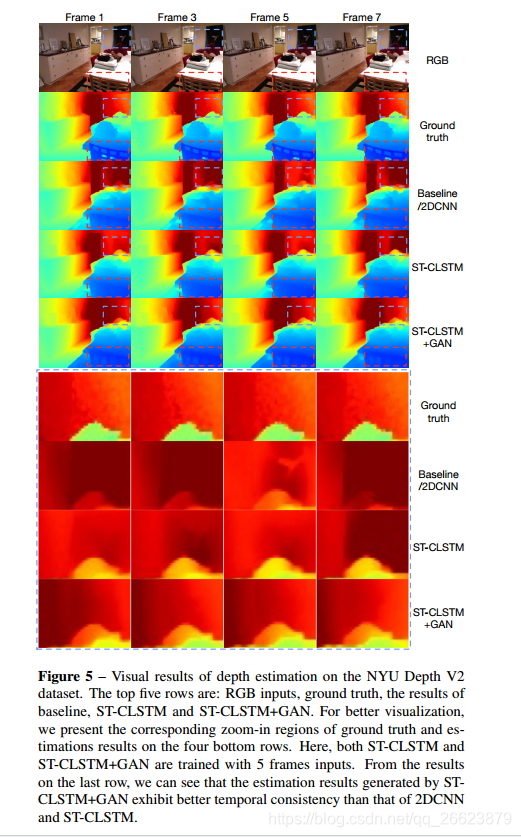

实验效果

本文介绍了一种利用卷积长短期记忆网络改进视频深度估计的方法。通过引入ST-CLSTM结构和时间一致性损失,实现了视频帧间深度估计的精确度提升和时间连贯性。此框架能实时运行并适用于多种深度估计模型。

本文介绍了一种利用卷积长短期记忆网络改进视频深度估计的方法。通过引入ST-CLSTM结构和时间一致性损失,实现了视频帧间深度估计的精确度提升和时间连贯性。此框架能实时运行并适用于多种深度估计模型。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?