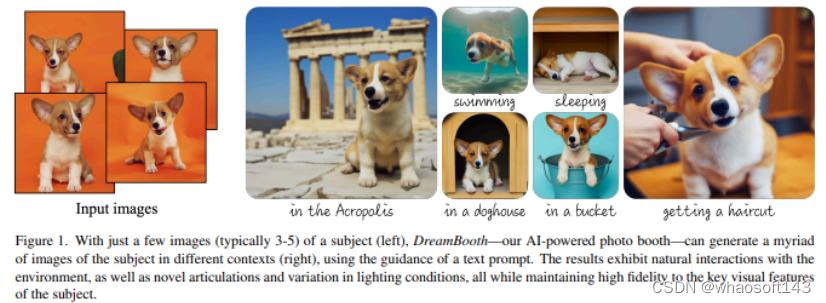

1、DreamBooth: Fine Tuning Text-to-Image Diffusion Models for Subject-Driven Generation

-

大型文本生成图像模型已取得显著进展,有能力从给定的文本提示中生成高质量和多样化的图像。然而,给定目标个体的一些参考图片(这里不妨称之为“主题”),这些模型还无法做到的是,在不同的上下文环境里去生成关于它们不同图片的能力。

-

DreamBooth是一种新的文本到图像扩散模型的“个性化”方法。给定一个主题的几张图像作为输入,对预训练的文本到图像模型进行微调,使其学会将一个唯一标识符(identifier)绑定到特定的主题。一旦主题被嵌入到模型的输出域中,唯一的标识符就可以用来生成不同场景下关于主题的新颖逼真图像。通过利用模型中嵌入的语义先验和一种类特定先验保留损失,能够在参考图像中没有出现的不同场景、姿势、视图和光照条件下合成主题。

-

在保留主题关键特征的同时,应用于主题重新背景化、文本引导的视图合成和艺术渲染等任务。此外,研究者还为这个新的主题驱动生成任务提供了一个新的数据集和评估协议。项目页面:https://dreambooth.github.io/

2、Ablating Concepts in Text-to-Image Diffusion Models

2、Ablating Concepts in Text-to-Image Diffusion Models

-

大规模的文本到图像扩散模型可以生成高保真图像。模型通常是根据大量互联网数据进行训练的,这些数据通常包含受版权保护的材料、许可图像和个人照片。此外,它们被发现可以复制各种艺术家的风格或记住准确的训练样本。如何在不从头开始重新训练模型的情况下删除此类受版权保护的概念或图像?

-

为了实现这一目标,提出了一种在预训练模型中消除概念的有效方法,即防止目标概念的生成。算法将希望消融的目标样式、实例或文本提示的图像分布与锚概念对应的分布相匹配。这可以防止模型在给定文本条件的情况下生成目标概念。大量实验表明,方法可以成功地防止消除概念的产生,同时在模型中保留密切相关的概念。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

4374

4374

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?