目标检测应用场景—数据集【NO.8】课堂行为检测

在前面:数据集对应应用场景,不同的应用场景有不同的检测难点以及对应改进方法,本系列整理汇总领域内的数据集,方便大家下载数据集今天分享一个非常好的非常小众的研究方向,有应用创新,可有利于发小论文和大论文,有需要的朋友可私信我。

数据集下载:

通过百度网盘分享的文件:课堂行为检测

链接:https://pan.baidu.com/s/17KsMPnKGTjCYawKYZCFe8Q?pwd=ddcx

提取码:ddcx

–来自百度网盘超级会员V6的分享

数据集介绍:

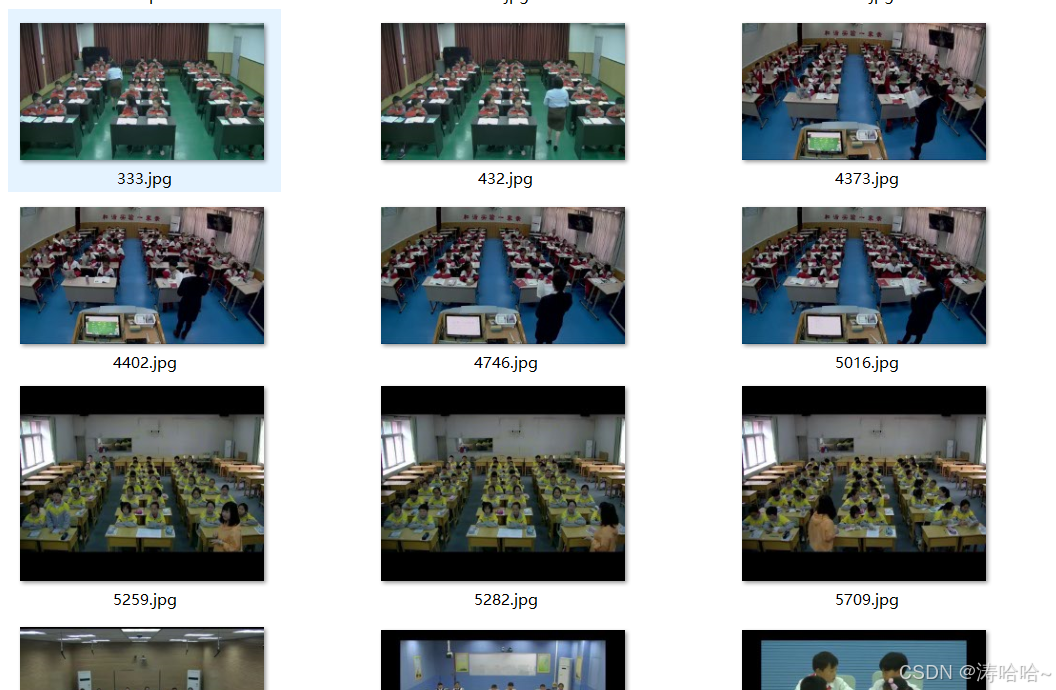

话不多说直接上图:图像数据集样本图如下所示 ,分为8个类别 ,具体类别如下 :

0 # 低头写字 dx 72462

1 # 低头看书 dk 58932

2 # 抬头听课 tt 117528

3 # 转头 zt 5339

4 # 举手 js 4183

5 # 站立 zl 4101

6 # 小组讨论 xt 4663

7 # 教师指导 jz 680

可以通过利用目标检测算法检测出的地方,可以应用在一些模型研究、毕设中等。

训练集的数据集一共8884 张图片。原数据集格式为xml格式

JPEGImages文件夹下为原图

Annotations 文件夹下为xml格式的标签

数据集展示:

识别展示:

628

628

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?