方法分类:

-

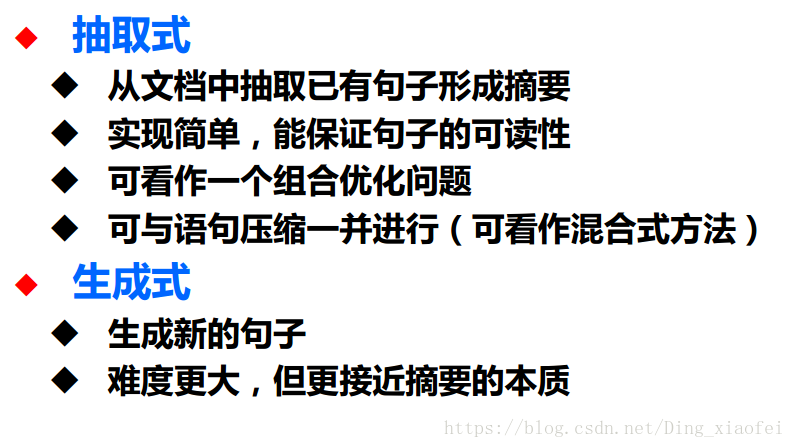

抽取式(传统基于统计学的)

相关算法:Text rank排序算法、BM25算法、TFIDF -

生成式(Automatic Summarization)

- seq2seq+attention

- sequence2sequence

- 2016year,cnn FAIR encoder &rnn decoder [FAIR ,Facebook AI Research]

- 2017/5 FAIR CNN encoder&decoder , multi-step Attention ,同时引入残差网络

- 2017/6 Google self-Attention & encoder-decoder attention《Attention is All you Need》

- Pointer N

- seq2seq+attention

评价方法:

- Edmundson

说明:标准摘要必须完全从文章中整句摘出,不允许概括抽象,评分以匹配数占比作为评分 - ROUGE

说明:基于摘要中n元词的共现信息来评价摘要,面向n元词召回率的评价方法 - Rouge-L

L即最长公共子序列的首字母

如何去衡量一个句子的重要性

- 句子长度

- 句子位置

- 句子中词语的TFIDF

- 句子是否包括线索词

- 句子是否与标题相似

6779

6779

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?