本文面向图像处理方向,结构为列举算法、以及其原理、训练所需要的数据、训练注意点,是对当前热门AI算法的一个介绍,暂不包含手把手教程。

其中开发者如果想定制某个算法,可以通过定制算法、训练需要输入数据,来调整自己的模型。非AI开发者可以使用他人已有的模型,图像化的方式直接应用这些AI 算法。

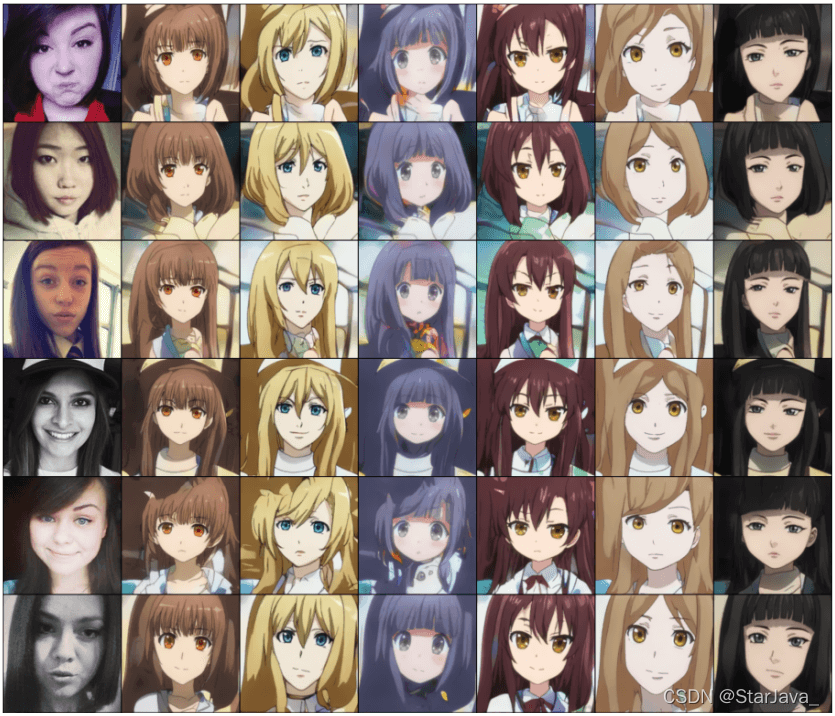

形象替换

应用

- 直播中自己的动作、表情,映射到虚拟的2D、3D的卡通人物中

- 动漫制作,不再需要制作每一帧,而是直接由演员演绎,算法把演绎录像转为动漫人物形象

- 特朗普宅舞

算法举例

- 人脸关键点检测

- 人体姿态估计

- 手势姿态估计

- Impersonator++

- GANsNRoses

算法大概原理

多种AI算法结合

人类思维映射

看到蔡徐坤在打篮球,想象出班主任模仿蔡徐坤打篮球的画面

超分辨率重建

将图片分辨率变得更高

应用

- 修复一些老的低分辨率的视频,动漫,电影等,回味经典

- 高清电视,人脸识别,医疗图像,卫星图像等

算法举例

- 早期是插值法,但效果太平滑(边界不够锐化)目前普遍是基于CNN / GAN的

- SRCNN、DRCN、ESPCN、SRResNet/SRGAN、SelfExSR

算法大概原理

人类思维映射

看到一只蚂蚁,脑部蚂蚁变大100倍占领地球

训练需要的输入数据

高清图片/视频以及降分辨率处理后的数据

注意点

可以直接用高清视频降分辨率喂入

AI 声音模仿

【自行脑部声音 - -】

应用

5s模仿任意一个人的声音,并可以合成这个人说任何词语句子,如高德地图、百度地图中的语音包。

算法举例

- MockingBird https://github.com/babysor/MockingBird3

- 基于 Transfer Learning from Speaker Verification to Multispeaker Text-To-Speech Synthesis

算法大概原理

算法分为三个模块:encoder模块、systhesis模块、vocoder模块。

- encoder模块将说话人的声音转换成人声的数字编码(speaker embedding)

- synthesis 模块将文本转换成梅尔频谱(mel-spectrogram)

- vocoder模块将梅尔频谱(mel-spectrogram)转换成(波形)waveform

人类思维映射

- A说了一句话,B耳朵听到了,B的大脑把声音理解为某种信号/数据,B的喉咙将这些数据回放输出为声音

- 鹦鹉学舌

训练需要的输入数据

不同人说不同话的声音以及对应文本(得到模型)

图像消除

添加链接描述

去掉前景、恢复背景,与该算法相对的是抠图算法(去背景,留前景)

应用

- 照片中去掉某个人,景区拍照去掉挡住景色的人,海滩去掉所有人

- 去掉墙上的乱写乱画

- 实现电影中的隐身术,如恐怖的没人荡秋千,无人粉笔写黑板等

- 去掉纹身

- 自动抠图

算法举例

- Animal Matting

- MODNet 背景替换

- SkinDeep

本文详细介绍了多种有趣的AI图像处理算法,包括形象替换、超分辨率重建、声音模仿、图像消除、去马赛克、AR及深度估计、历史重放、人脸替换和实时肖像演讲等。涉及的应用广泛,从直播、动漫制作到视频处理和游戏,算法原理与训练数据解析揭示了人类思维映射在AI技术中的重要作用。

本文详细介绍了多种有趣的AI图像处理算法,包括形象替换、超分辨率重建、声音模仿、图像消除、去马赛克、AR及深度估计、历史重放、人脸替换和实时肖像演讲等。涉及的应用广泛,从直播、动漫制作到视频处理和游戏,算法原理与训练数据解析揭示了人类思维映射在AI技术中的重要作用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3055

3055

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?