目录

前言

📅大四是整个大学期间最忙碌的时光,一边要忙着备考或实习为毕业后面临的就业升学做准备,一边要为毕业设计耗费大量精力。近几年各个学校要求的毕设项目越来越难,有不少课题是研究生级别难度的,对本科同学来说是充满挑战。为帮助大家顺利通过和节省时间与精力投入到更重要的就业和考试中去,学长分享优质的选题经验和毕设项目与技术思路。

🚀对毕设有任何疑问都可以问学长哦!

选题指导:

大家好,这里是海浪学长毕设专题,本次分享的课题是

🎯基于深度学习的复杂环境道路目标检测系统

设计思路

一、课题背景与意义

随着人工智能的发展,自动驾驶技术成熟度不断提高。然而,保持安全距离是防止追尾事故的关键,因此准确检测前方道路环境目标对于汽车自动驾驶至关重要。然而,城市道路的复杂性不断增加,导致目标在图像中占据小空间、提供有限特征信息;同时,车辆和行人之间相互遮挡,以及光照不佳、夜间环境和背景干扰等问题也使得目标检测更加困难。因此,目标检测算法需要更高的可靠性和准确性来应对这些挑战。

二、算法理论原理

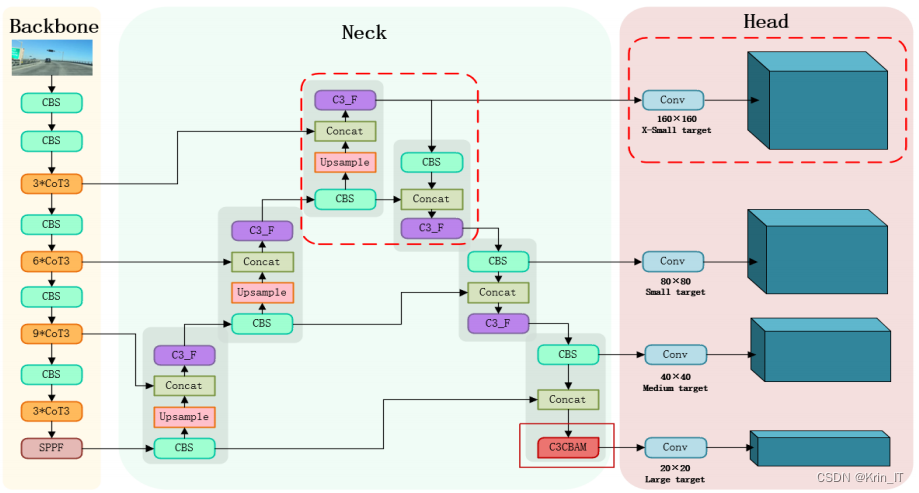

2.1 多尺度改进

在原始的YOLOv5中,采用三个尺度的检测,通过在Backbone部分进行步幅为2的下采样,可以获取更多语义信息,但会丢失许多细节特征信息,尤其是微小尺寸物体的语义特征。为了应对这个问题,本文受到Zhu等人在无人机捕获场景中的启发,新增加了一个更小的尺度来关注小目标任务,并将其相关特征融合到Neck部分中。通过跳跃连接,将附加的特征融合结构添加到Neck部分,以融合Backbone部分中的高级语义特征图和浅层中更详细的位置信息,从而增强对微小目标的检测能力。尽管增加了额外的检测尺度会增加网络参数和计算量,但它提高了对微小物体的检测能力,并且提供了相对丰富的位置信息,更适用于目标尺寸变化范围大的复杂道路场景。

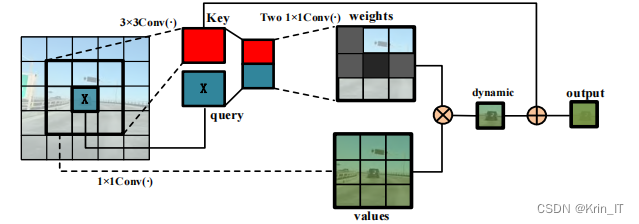

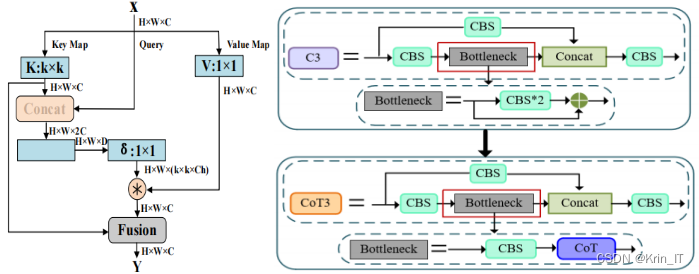

在传统的自注意力机制中,每个查询-键(query-key)关系都是相互独立的,导致丰富的上下文信息没有被充分探索。针对背景复杂的道路场景,为了提供更高层次的检测特征来合并全局信息,可以采用Transformer类型的模块来改善这个问题。CoT(Context Transformer)模块能够在同一个体系结构中挖掘上下文信息并集成自注意力机制,它可以促进自注意力的学习,并有效利用相邻像素的上下文信息,从而增强输出特征映射的表示能力。

通过将CoT模块融合到骨干特征提取网络中,在替换CBS模块后,对C3结构进行重构,形成了新的CoT3模块。这样做增强了上下文信息的连续性,并提取出显著的特征。

相关代码示例:

import torch

import torch.nn as nn

class CoT3(nn.Module):

def __init__(self, in_channels, out_channels, reduction_ratio=16):

super(CoT3, self).__init__()

self.conv1 = nn.Conv2d(in_channels, out_channels, kernel_size=3, padding=1)

self.conv2 = nn.Conv2d(out_channels, out_channels, kernel_size=3, padding=1)

self.relu = nn.ReLU(inplace=True)

self.avg_pool = nn.AdaptiveAvgPool2d(1)

self.max_pool = nn.AdaptiveMaxPool2d(1)

self.fc = nn.Sequential(

nn.Conv2d(out_channels, out_channels // reduction_ratio, 1, bias=False),

nn.ReLU(inplace=True),

nn.Conv2d(out_channels // reduction_ratio, out_channels, 1, bias=False),

nn.Sigmoid()

)

def forward(self, x):

identity = x

x = self.conv1(x)

x = self.relu(x)

x = self.conv2(x)

x = self.relu(x)

avg_out = self.fc(self.avg_pool(x))

max_out = self.fc(self.max_pool(x))

out = avg_out + max_out

out = out * x

out = out + identity

out = self.relu(out)

return out

# 测试CoT3模块

input_tensor = torch.randn(1, 64, 256, 256)

cot3 = CoT3(64, 64)

output = cot3(input_tensor)

print(output.shape)2.2 注意力机制

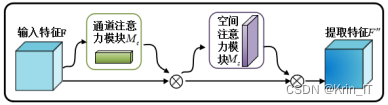

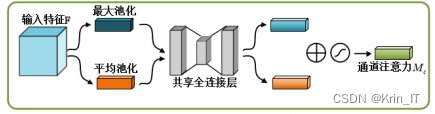

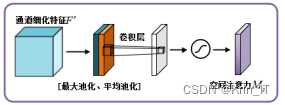

注意力机制是一种模仿人类注意力的深度学习优化策略,已广泛应用于深度学习的多个领域。注意力模块通过选择相关和不相关的信息特征,构建动态权重,并帮助网络捕捉位置关系和估计不同信息的重要性。通过这种方式,无用的信息被削弱,而重要的信息被加强,从而提高了网络的效率。常见的注意力机制包括通道注意力机制、空间注意力机制和混合注意力机制。

通道注意力机制:通过对输入特征图的通道进行相关性选择,生成通道级别的注意力权重,用于区分不同通道的特征重要性。

空间注意力机制:通过对输入特征图的空间位置进行相关性选择,生成空间区域的注意力权重,用于区分不同空间区域的特征重要性。

混合注意力机制:同时引入通道注意力机制和空间注意力机制,通过综合考虑通道权值不平衡和空间维度不平衡来提高特征表示能力

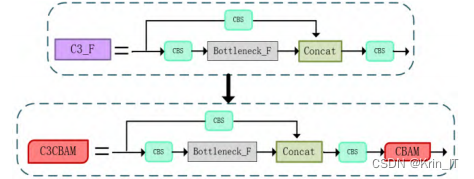

常见的注意力模块CBAM是一种高效、轻量级的注意力模块,可以集成到任何卷积神经网络架构中,并与基本网络进行端到端训练。CBAM同时考虑了不同通道之间的权值不平衡和空间维度的不平衡。注意力机制通过选择性强化和削弱特征的方式,帮助网络更好地利用信息并提高性能。

相关代码:

import torch

import torch.nn as nn

class ChannelAttention(nn.Module):

def __init__(self, in_channels, reduction_ratio=16):

super(ChannelAttention, self).__init__()

self.avg_pool = nn.AdaptiveAvgPool2d(1)

self.max_pool = nn.AdaptiveMaxPool2d(1)

self.fc = nn.Sequential(

nn.Conv2d(in_channels, in_channels // reduction_ratio, 1, bias=False),

nn.ReLU(inplace=True),

nn.Conv2d(in_channels // reduction_ratio, in_channels, 1, bias=False),

nn.Sigmoid()

)

def forward(self, x):

avg_out = self.fc(self.avg_pool(x))

max_out = self.fc(self.max_pool(x))

out = avg_out + max_out

return out * x

# 测试通道注意力机制模块

input_tensor = torch.randn(1, 64, 256, 256)

cam = ChannelAttention(64)

output = cam(input_tensor)

print(output.shape)三、检测的实现

3.1 数据集

由于网络上缺乏现有适用的数据集,我决定亲自前往复杂环境的道路进行拍摄,收集照片并创建一个全新的数据集。这个数据集将包含各种复杂环境下的道路场景,其中包括不同类型的目标物体和交通标志。通过现场拍摄,我能够捕捉到真实的场景和多样的道路条件,这将为我的研究提供更准确、可靠的数据。我相信这个自制的数据集将为复杂环境道路目标检测的研究提供有力的支持,并为该领域的发展做出积极的贡献。

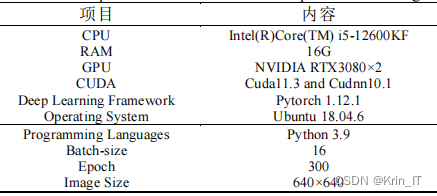

3.2 实验环境搭建

3.3 实验及结果分析

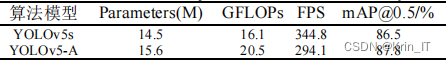

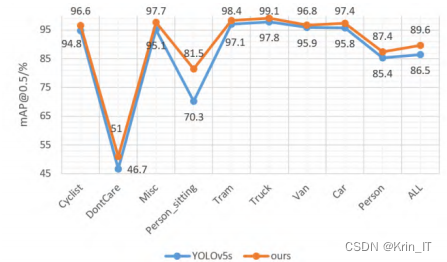

基于原始的YOLOv5s模型进行改进,提出了YOLOv5-A算法,主要改进了多尺度特征融合部分。在改进中,增加了160×160的检测尺度,而其他部分保持不变。通过这个改进,YOLOv5-A算法的模型参数数量、计算量和体积略微增加,但FPS略微降低,仍然在可接受范围内。

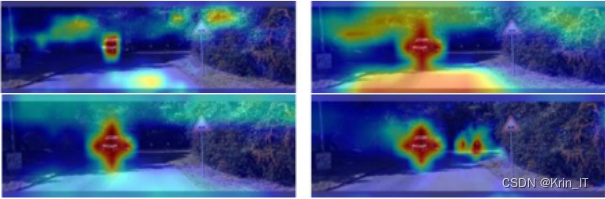

通过对比图清晰展示了各个注意机制模块的效果。SE和ESE模块关注的区域过小,无法提取到完整的特征信息,而GAM模块则过度关注了无用的信息。其他的注意力模型没有显著提升模型性能的效果,只有CBAM模块充分关注到了位置信息。CBAM模块在保留更多瑕疵细节特征的同时,增强了瑕疵显著特征的提取。这个改进方法增强了算法在阴影模糊等复杂环境下对目标特征的学习能力,提高了图像信息处理的效率和准确性。

通过改进多尺度特征融合部分,并引入CBAM模块等注意力机制,改进后的模型在目标检测任务中取得了显著的提升。特别是在处理小目标类别时,性能的提升更为明显。这证明了改进方法的有效性,并为模型的实际应用提供了更好的性能表现。

相关代码如下:

# 加载预训练的YOLOv5模型

model = torch.hub.load('ultralytics/yolov5', 'yolov5s')

# 设置输入图像的预处理转换

preprocess = transforms.Compose([

transforms.Resize((640, 640)), # 调整图像大小为640x640(根据模型要求)

transforms.ToTensor(), # 转换为Tensor

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]) # 标准化

])

# 加载图像

image_path = 'path/to/image.jpg' # 图像文件路径

image = Image.open(image_path).convert('RGB')

# 对图像进行预处理

input_image = preprocess(image)

# 将图像输入模型进行目标检测

results = model([input_image])

实现效果图样例

创作不易,欢迎点赞、关注、收藏。

毕设帮助,疑难解答,欢迎打扰!

本文介绍了一种针对复杂道路环境的自动驾驶目标检测系统,通过多尺度改进和注意力机制(如CoT和CBAM)提高检测性能。作者分享了课题背景、理论原理、数据集创建和实验结果,展示了改进后的YOLOv5在小目标检测上的显著提升。

本文介绍了一种针对复杂道路环境的自动驾驶目标检测系统,通过多尺度改进和注意力机制(如CoT和CBAM)提高检测性能。作者分享了课题背景、理论原理、数据集创建和实验结果,展示了改进后的YOLOv5在小目标检测上的显著提升。

692

692

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?